شهد مجالا التكنولوجيا والعملات الرقمية تطورات سريعة في السنوات الأخيرة، وكان من أبرزها صعود تقنيات الذكاء الاصطناعي مع إمكانية استخدامه في هذين المجالين. هذا التقاطع بين الذكاء الاصطناعي والعملات الرقمية أثار اهتمام الخبراء والمستثمرين، إذ يُنظر إلى الذكاء الاصطناعي على أنه ربما يكون «الثورة القادمة في عالم العملات الرقمية».

في الوقت نفسه، يتساءل البعض عمَّا إذا كانت أدوات الذكاء الاصطناعي ستجعل الاستثمار في العملات المُشفَّرة أكثر ذكاءً وسهولة، أم أنها قد تؤدي إلى زيادة التقلبات والتلاعب في الأسواق، وفق مجلة «فوربس» الأميركية.

فيما يلي نستعرض تأثير الذكاء الاصطناعي على سوق العملات الرقمية من خلال ثلاث زوايا: كيفية استخدامه في تحليل السوق، والتحديات التي تواجه دمجه مع هذا المجال، وأخيراً مدى قدرته على التنبؤ بأسعار العملات الرقمية بدقة.

كيف يُستخدم الذكاء الاصطناعي في تحليل سوق العملات الرقمية؟

تعزيز القدرة على فهم سوق العملات الرقمية واتخاذ القرارات

يُسهم الذكاء الاصطناعي اليوم في تعزيز قدرة المحللين والمستثمرين على فهم سوق العملات الرقمية واتخاذ القرارات بشكل أسرع وأكثر دقة. تستخدم منصات التداول خوارزميات ذكاء اصطناعي لتحليل كميات هائلة من البيانات في وقت قصير، مما يسمح بتنفيذ عمليات التداول الآلي بسرعة تفوق بكثير قدرة البشر، حسب منصة «كوينبيس»، (Coinbase)، الأميركية لتداول الأصول الرقمية.

تنفيذ آلاف الصفقات بسرعة

على سبيل المثال، بفضل التداول الخوارزمي algorithm (تداول آليّ ذكيّ) المدعوم بالذكاء الاصطناعي يمكن تنفيذ آلاف الصفقات في الثانية الواحدة استناداً إلى استراتيجيات مبرمجة مسبقاً، وهذا مهم بشكل خاص في سوق العملات الرقمية التي تشهد تغيرات سعرية سريعة وحادة.

رصد أنماط خفية في تحركات الأسعار

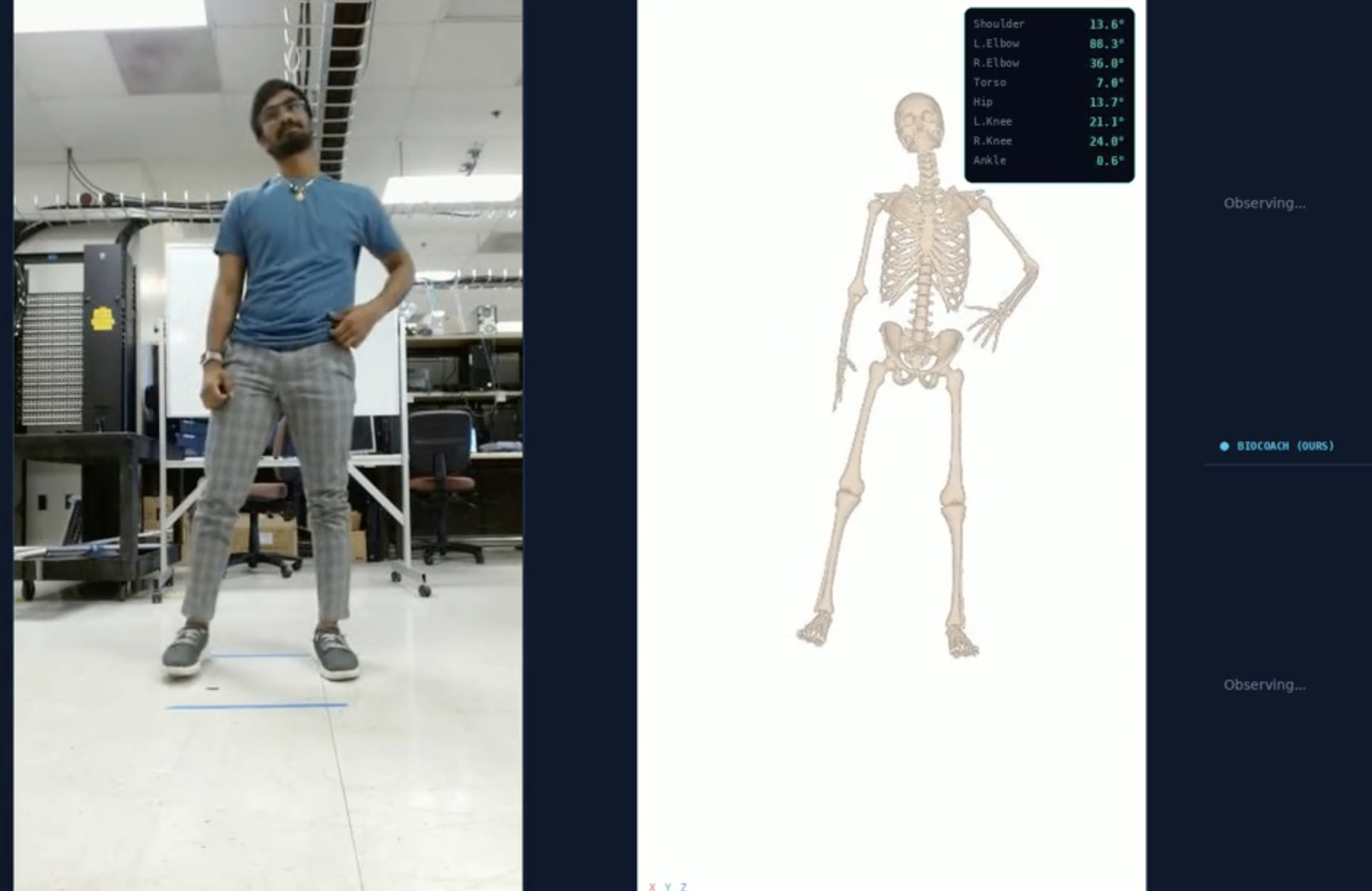

وبالإضافة إلى السرعة، يتميّز الذكاء الاصطناعي بقدرته على التعمّق في تحليل السوق. حيث يمكنه رصد أنماط خفية في تحركات الأسعار لا يستطيع الإنسان ملاحظتها بسهولة، وذلك عبر تحليل بيانات تاريخية ضخمة. بناءً على هذه الأنماط، تستطيع أنظمة الذكاء الاصطناعي تقديم توقعات أو تنبؤات بشأن اتجاهات الأسعار المحتملة، حسب تقرير منصة «كوينبيس».

«تحليل المشاعر» لقراءة المزاج العام للسوق

كما تُستخدم تقنيات «تحليل المشاعر» لقراءة مزاج السوق العام من خلال تتبّع الأخبار ووسائل التواصل الاجتماعي؛ لمعرفة ما إذا كان المزاج السائد للمستثمرين يتجه نحو التفاؤل أم الخوف، مما يساعد في توقع تحركات الأسعار.

يُذكر أن تقنيات «تحليل المشاعر» هي نوع من تقنيات الذكاء الاصطناعي تُستخدم لفهم المزاج العام أو الرأي العام من خلال تحليل النصوص التي يكتبها الناس لا سيما على وسائل التواصل الاجتماعي.

توسع استخدام الذكاء الاصطناعي من المؤسسات إلى الأفراد

لم يعد استخدام الذكاء الاصطناعي في سوق العملات الرقمية مقتصراً على المؤسسات المالية الكبرى فحسب، بل امتد إلى المستثمرين الأفراد أيضاً. فقد بات البعض يستعين بمساعدات ذكاء اصطناعي مثل نماذج المحادثة، مثل «شات جي بي تي»، للحصول على تحليلات مبسّطة وفورية للسوق. على سبيل المثال، يمكن لهذه النماذج تلخيص الأخبار الاقتصادية أو تفسير رسوم بيانية معقدة بلغة بسيطة، وحتى ابتكار استراتيجيات تداول مبدئية بناءً على معطيات سوقية معيّنة، حسب موقع «كوينتيلغراف»، (Cointelegraph)، الدولي المتخصّص في تغطية أخبار العملات الرقمية.

ويشير خبراء إلى أن دور هذه الأدوات هو دعم قرارات المستثمر وليس استبدال العقل البشري كلياً، تماماً كما عززت البرامج الحاسوبية فيما مضى عمل جيل من المحللين الماليين دون أن تلغي دورهم.

ما التحديات التي تواجه دمج الذكاء الاصطناعي مع العملات الرقمية؟

على الرغم من الفرص الكبيرة التي يتيحها الذكاء الاصطناعي في عالم العملات الرقمية، هناك جملة من التحديات تعترض طريق الدمج الكامل بين التقنيتين.

التعقيد التقني لدمج خوارزميات الذكاء الاصطناعي

أول هذه التحديات هي التعقيد التقني؛ فدمج خوارزميات الذكاء الاصطناعي مع أنظمة قائمة على تقنية سلسلة الكتل (البلوكتشين) ليس أمراً سهلاً.

وسلسلة الكتل أو «بلوك تشين» (Blockchain) هي تقنية رقمية مبتكرة تُستخدم لتخزين البيانات بطريقة آمنة، شفافة، ولا مركزية، وهي تشكّل البنية التحتية الأساسية للعملات الرقمية مثل بتكوين وإيثيريوم.

موارد حاسوبية كبيرة

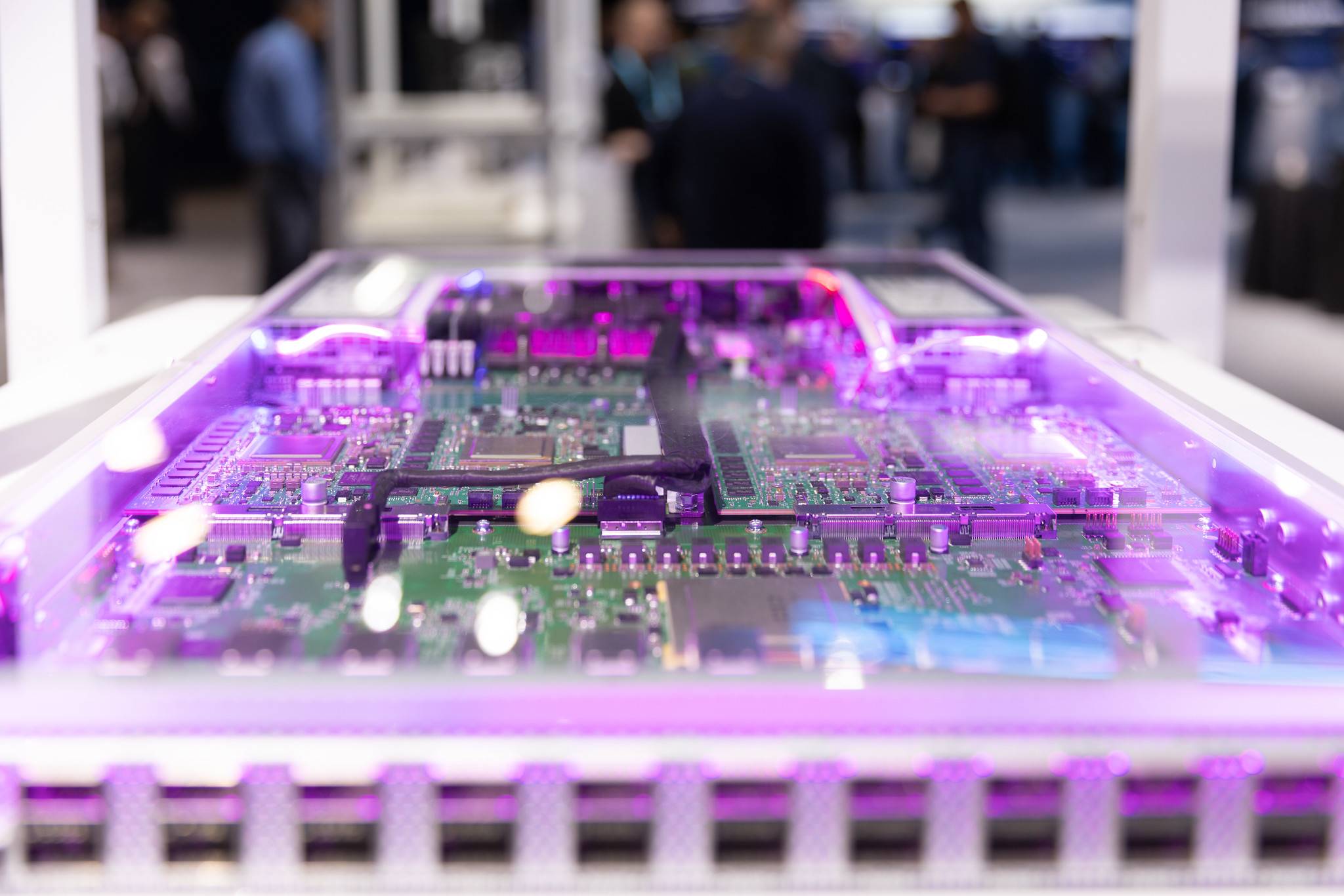

كذلك، يتطلب تشغيل خوارزميات الذكاء الاصطناعي موارد حاسوبية هائلة، وفي المقابل تعاني شبكات العملات الرقمية أحياناً من محدودية في السرعة والاستيعاب، وهذا يعني أن الجمع بين الذكاء الاصطناعي والعملات الرقمية قد يجعل تنفيذ المعاملات أبطأ أو أكثر تكلفة، خصوصاً عندما يزداد عدد المستخدمين، وفقاً لموقع «كوينتيلغراف».

غياب الشفافية والثقة

تحدٍّ آخر أمام دمج الذكاء الاصطناعي مع العملات الرقمية، هو مدى تحقيق الشفافية والثقة. فكثير من نماذج الذكاء الاصطناعي المتقدمة تعمل كصندوق أسود، حيث يصعب فهم الآلية الداخلية التي تتخذ بها القرارات.

في المقابل، تعتمد ثقة المستخدمين في عالم العملات الرقمية على الشفافية وإمكانية التحقق. فإذا قدّم نظام ذكاء اصطناعي توصية استثمارية أو توقعاً سعرياً دون شرح واضح للأسباب، قد يتردد المستثمرون في الأخذ به، لأنّ عدم قدرة المستخدمين على فهم كيفية توصل الذكاء الاصطناعي إلى قراراته قد يولّد مخاوف ويثني البعض عن استخدامه.

تحديات دمج الإطار التنظيمي للذكاء الاصطناعي بسوق العملات الرقمية

من جهة أخرى، يظل الإطار التنظيمي لدمج الذكاء الاصطناعي بالعملات الرقمية تحدياً مهماً؛ فكل من هاتين التقنيّتين حديثتا العهد وسريعتا التطور، وهذا يعني أن القوانين واللوائح التنظيمية لا تواكب سرعة التطوّر التقني.

هذا الفراغ أو الغموض القانوني يزيد من صعوبة دمج الذكاء الاصطناعي مع منصات التداول أو المشاريع القائمة على البلوكتشين، خوفاً من مخالفة أنظمة تنظيمية حالية أو مستقبلية، حسب «كوينتيلغراف».

جودة البيانات والتوقعات

ولا يمكن إغفال تحديات متعلقة بجودة البيانات والتوقعات. تعتمد دقة مخرجات أنظمة الذكاء الاصطناعي على جودة البيانات التي تُدرَّب عليها؛ فإذا كانت البيانات تاريخية منحازة أو غير كاملة، ستنعكس العيوب على القرارات والتنبؤات. في سوق شديدة التقلب كسوق العملات المشفرة، قد يصعب على الذكاء الاصطناعي التنبؤ بالأحداث غير المتوقعة أو الصدمات المفاجئة مثل تغييرات تشريعية أو تصريحات مؤثرة من شخصيات بارزة. وفي الواقع، يشدد الخبراء على أن أنظمة الذكاء الاصطناعي قد ترتكب أخطاء فادحة إذا استندت إلى بيانات أو نماذج فيها عيوب، مما قد يسبب خسائر مالية جسيمة، فضلاً عن أن غياب الشفافية في قرارات هذه الأنظمة قد يقوّض ثقة المستثمرين ويفسح المجال للتلاعب بالسوق.

لذا فإن دمج الذكاء الاصطناعي بشكل آمن وفعال في عالم العملات الرقمية يتطلب معالجة هذه التحديات التقنية والأخلاقية والتنظيمية بعناية.

هل يمكن للذكاء الاصطناعي التنبؤ بأسعار العملات الرقمية بدقة؟

يتطلع الكثيرون إلى إجابة هذا السؤال المحوري: هل بوسع الذكاء الاصطناعي أن يتنبأ بحركة أسعار البتكوين أو غيرها من العملات الرقمية بدقة عالية وبشكل موثوق؟

لقد حقق الباحثون بالفعل بعض النجاحات المحدودة في هذا المجال. على سبيل المثال، إن معهد ماساتشوستس للتكنولوجيا (MIT) -وهو معهد أميركي ينشر آخر ما توصلت إليه الأبحاث العلمية والتقنية- تمكّن قبل نحو عقد من الزمن من تطوير خوارزمية تعلُّم آلة تتوقع أسعار بتكوين على مدار ثوانٍ، ونجح فريق العمل عبرها في مضاعفة استثماراته خلال فترة خمسين يوماً فقط.

مثل هذه النتائج أظهرت إمكانات واعدة لاستخدام النماذج الرياضية والتعلم الآلي في التداول الآلي لتحقيق أرباح سريعة.

صعوبة التنبؤ الدقيق

إلا أن خبراء الذكاء الاصطناعي والمال يؤكدون أن هذه الحالات تظل استثنائية، ولا تعني قدرة عامة على التنبؤ الدقيق. كما يقول أحد خبراء شركة «غوغل» في مجال الذكاء الاصطناعي: «يمكنك دائماً تحليل البيانات التاريخية، لكنك لن تستطيع أبداً التنبؤ بالمستقبل بدقة تامة. حاول المحللون لسنوات، ولا يوجد أحد يستطيع توقع الأسعار بشكل صحيح دائماً»، حسبما أفاد به موقع «كريبتو نيوز»، وهو موقع إخباري دولي يغطّي أحدث تطورات سوق العملات الرقمية.

احتمالات وليست ضمانات لتطور الأسعار

الواقع أن الذكاء الاصطناعي يبرع في رصد الاتجاهات والأنماط المحتملة اعتماداً على المعطيات الحالية، لكنه يفتقر إلى قدرة الإدراك الشامل لكل العوامل المؤثرة الخارجة عن البيانات، مثل التطورات السياسية أو النفسية للمستثمرين. لذلك، فإن أي توقعات يصدرها تبقى في إطار الاحتمالات، وليست ضماناً أكيداً. حتى النماذج اللغوية الذكية مثل «شات جي بي تي» تعترف بأنها لا تمتلك دقة آنية في التنبؤ بالأسعار، وأن ما تُقدّمه من توقعات ليست إلا سيناريوهات افتراضية للاسترشاد بها لا أكثر، وفقاً لموقع «كوينتيلغراف».

وبناءً على ذلك، يبقى الذكاء الاصطناعي أداةً مفيدةً لاستشراف الاتجاهات في سوق العملات الرقمية، لكنه لا يضمن تنبؤاً دقيقاً بالأسعار المستقبلية.