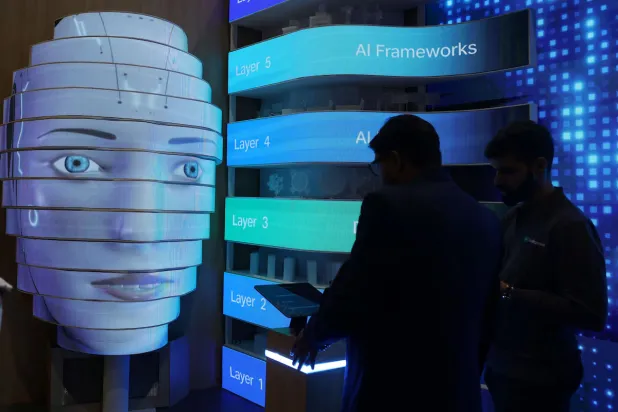

سرعان ما أصبح الذكاء الاصطناعي جزءاً لا يتجزأ من حياتنا اليومية، وشيئاً فشئياً، غيّر الذكاء الاصطناعي طريقة عملنا وتواصلنا مع العالم من حولنا.

وتعمل تقنيات الذكاء الاصطناعي الآن بوتيرة أسرع بكثير من الإنتاج البشري، لديها القدرة على توليد مجموعة واسعة من الاستجابات الإبداعية، مثل النصوص والصور ومقاطع الفيديو التي لا يمكن تفريقها عن الحقيقية.

وفي حين أن سرعة توسع الذكاء الاصطناعي غير مسبوقة، من المفيد فهم كيف بدأ. فللذكاء الاصطناعي تاريخ طويل يمتد إلى خمسينات القرن الماضي.

ما هي أبرز التحولات التي شهدها الذكاء الاصطناعي منذ ظهوره؟

لفهم التحولات التي طرأت على الذكاء الاصطناعي، لا بد من تتبع مراحل تطوره التاريخي والتقني، من البدايات النظرية إلى التطبيقات العملية الحديثة.

بدايات الذكاء الاصطناعي: خمسينات القرن الماضي

في خمسينات القرن الماضي، كانت الآلات الحاسوبية تعمل أساساً كآلات حاسبة ضخمة. وعندما احتاجت منظمات مثل «ناسا» إلى إجابة لحسابات محددة، مثل مسار إطلاق صاروخ، لجأت بشكل متكرر إلى «أجهزة حاسوب» بشرية أو فرق من النساء مُكلَّفة بحل تلك المعادلات المعقدة.

قبل وقت طويل من تطور الآلات الحاسوبية إلى ما هي عليه اليوم، تصوَّر عالم رياضيات وعالم حاسوب إمكانية الذكاء الاصطناعي. ومن هنا بدأت أصول الذكاء الاصطناعي.

وضع الأساس: ستينات وسبعينات القرن الماضي

شهدت هذه المرحلة بدايات جادة في تطوير أنظمة محادثة أولية ومحاولات لمحاكاة الذكاء البشري على مستوى الأجهزة.

- «إليزا»

ابتكر عالم الحاسوب في معهد ماساتشوستس للتكنولوجيا، جوزيف وايزنباوم، روبوت المحادثة إليزا عام 1966، ويُعتبر على نطاق واسع أول روبوت محادثة، وكان الهدف منه محاكاة العلاج من خلال إعادة توظيف إجابات المستخدمين في أسئلة تُثير المزيد من النقاش.

- الروبوت «شايكي»

بين عامي 1966 و1972، طوّر مركز الذكاء الاصطناعي في مبادرة ستانفورد للأبحاث الروبوت شايكي، وهو نظام روبوت متحرك مزود بأجهزة استشعار وكاميرا تلفزيونية، يُستخدم للتنقل في بيئات مختلفة.

وكان الهدف من ابتكار شايكي «تطوير مفاهيم وتقنيات في الذكاء الاصطناعي تُمكّن الروبوت من العمل بشكل مستقل في بيئات واقعية»، وفقاً لورقة بحثية نشرتها مبادرة ستانفورد للأبحاث لاحقاً.

حماسة الذكاء الاصطناعي المبكرة: الثمانينات

- أول سيارة ذاتية القيادة

اخترع إرنست ديكمانس، وهو عالم يعمل في ألمانيا، أول سيارة ذاتية القيادة عام 1986. من الناحية الفنية، كانت السيارة عبارة عن شاحنة مرسيدس مزودة بنظام حاسوبي وأجهزة استشعار لقراءة البيئة، ولم تكن قادرة على السير على الطرق إلا بدون سيارات وركاب آخرين.

نمو الذكاء الاصطناعي وتطبيقاته المعاصرة: من 2000 إلى اليوم

شهدت العقود الأخيرة تسارعاً هائلاً في تطوير أنظمة ذكاء اصطناعي متقدمة وشبه مستقلة، وظهرت العديد من التطبيقات التفاعلية.

- «كيزميت»

يمكن تتبع أبحاث كيزميت، وهو «روبوت اجتماعي» قادر على تحديد ومحاكاة المشاعر البشرية إلى عام 1997، إلا أن المشروع أثمر في عام 2000. صُمم كيزميت في مختبر الذكاء الاصطناعي بمعهد ماساتشوستس للتكنولوجيا (MIT) بقيادة الدكتورة سينثيا بريزيل، وكان يحتوي على أجهزة استشعار وميكروفون وبرمجة تُحدد «عمليات المشاعر البشرية».

- مركبات ناسا الجوالة

كان المريخ يدور على مسافة أقرب بكثير من الأرض عام 2004، فاستغلت ناسا تلك المسافة الصالحة للملاحة بإرسال مركبتين جوالتين (سُميتا سبيريت وأوبورتيونيتي) إلى الكوكب الأحمر. زُوّدت كلتاهما بذكاء اصطناعي ساعدهما على اجتياز تضاريس المريخ الصخرية الصعبة.

-«سيري» و«أليكسا»

خلال عرض تقديمي لهاتف آيفون عام 2011، عرضت «أبل» ميزة جديدة: مساعدة افتراضية تدعى سيري. بعد ثلاث سنوات، أطلقت أمازون مساعدتها الافتراضية أليكسا. تتمتع كلتاهما بقدرات معالجة اللغة الطبيعية، ما يسمح لهما بفهم السؤال المنطوق والإجابة عليه. مع ذلك، لا تزال قدراتهما محدودة.

- «صوفيا»

شهدت الروبوتات قفزة نوعية عندما ابتكرت شركة هانسون روبوتيكس الروبوت صوفيا عام 2016، وهو روبوت شبيه بالإنسان قادر على التعبير عن نفسه وإلقاء النكات والمحادثات.

أوبن «إيه آي» و«تشات جي بي تي»

قامت شركة «OpenAI» لأبحاث الذكاء الاصطناعي ببناء مُحوِّل توليدي مُدرَّب مسبقاً (GPT)، الذي تطوّر بشكل كبير وصولاً إلى GPT-3 الذي أحدث ضجة متزايدة عند إصداره عام 2020.

ما مخاطر استخدام الذكاء الاصطناعي؟

لكن رغم الطفرة التي حققها الذكاء الاصطناعي، فإنه أصبح يُمثل بعض المخاطر الجسيمة من فقدان الوظائف إلى المخاوف المتعلقة بالأمن والخصوصية والمعلومات المضللة. فيما يلي أكبر مخاطر الذكاء الاصطناعي بحسب مجلة «فوربز»:

1. انعدام الشفافية

يُمثل انعدام الشفافية في أنظمة الذكاء الاصطناعي، خاصةً في نماذج التعلم العميق التي قد تكون معقدة ويصعب تفسيرها، مشكلةً مُلحة. يُعيق هذا الغموض عمليات صنع القرار والمنطق الكامن وراء هذه التقنيات.

عندما لا يستطيع الناس فهم كيفية وصول نظام الذكاء الاصطناعي إلى استنتاجاته، فقد يؤدي ذلك إلى انعدام الثقة ومقاومة تبني هذه التقنيات.

2. الخصوصية

غالباً ما تجمع تقنيات الذكاء الاصطناعي كميات هائلة من البيانات الشخصية وتحللها، مما يثير تساؤلات حول خصوصية البيانات وأمنها. وللتخفيف من مخاطر الخصوصية، يجب علينا الدعوة إلى لوائح صارمة لحماية البيانات وممارسات آمنة للتعامل مع البيانات.

3. المعضلات الأخلاقية

يُمثل غرس القيم الأخلاقية والمعنوية في أنظمة الذكاء الاصطناعي، خاصةً في سياقات صنع القرار ذات العواقب الوخيمة، تحدياً كبيراً. يجب على الباحثين والمطورين إعطاء الأولوية للآثار الأخلاقية لتقنيات الذكاء الاصطناعي لتجنب الآثار المجتمعية السلبية.

4. المخاطر الأمنية

مع ازدياد تطور تقنيات الذكاء الاصطناعي، تزيد أيضاً المخاطر الأمنية المرتبطة باستخدامها واحتمالية إساءة استخدامها. يمكن للقراصنة والجهات الخبيثة تسخير قوة الذكاء الاصطناعي لتطوير هجمات إلكترونية أكثر تطوراً، وتجاوز التدابير الأمنية، واستغلال نقاط الضعف في الأنظمة.

كما يثير صعود الأسلحة ذاتية التشغيل التي تعمل بالذكاء الاصطناعي مخاوف بشأن مخاطر استخدام الدول المارقة أو الجهات الفاعلة غير الحكومية لهذه التقنية، خاصةً عندما نأخذ في الاعتبار احتمال فقدان السيطرة البشرية في عمليات صنع القرار الحاسمة.

للتخفيف من حدة هذه المخاطر الأمنية، يتعين على الحكومات والمنظمات تطوير أفضل الممارسات لتطوير الذكاء الاصطناعي ونشره بشكل آمن، وتعزيز التعاون الدولي لوضع معايير ولوائح عالمية تحمي من تهديدات أمن الذكاء الاصطناعي.

5. الاعتماد على الذكاء الاصطناعي

قد يؤدي الاعتماد المفرط على أنظمة الذكاء الاصطناعي إلى فقدان الإبداع ومهارات التفكير النقدي والحدس البشري. لذا، يُعد تحقيق التوازن بين اتخاذ القرارات بمساعدة الذكاء الاصطناعي والمساهمة البشرية أمراً حيوياً للحفاظ على قدراتنا المعرفية.

6. فقدان الوظائف

قد تؤدي الأتمتة المعتمدة على الذكاء الاصطناعي إلى فقدان الوظائف في مختلف القطاعات، خاصةً للعمال ذوي المهارات المحدودة، على الرغم من وجود أدلة على أن الذكاء الاصطناعي والتقنيات الناشئة الأخرى ستخلق وظائف أكثر مما ستلغيها.

مع استمرار تطور تقنيات الذكاء الاصطناعي وزيادة كفاءتها، يتعين على القوى العاملة التكيف واكتساب مهارات جديدة للحفاظ على أهميتها في ظل هذا المشهد المتغير. وينطبق هذا بشكل خاص على العمال ذوي المهارات المحدودة في القوى العاملة الحالية.

7. فقدان التواصل الإنساني

قد يؤدي الاعتماد المتزايد على التواصل والتفاعلات القائمة على الذكاء الاصطناعي إلى تراجع التعاطف والمهارات الاجتماعية والروابط الإنسانية. وللحفاظ على جوهر طبيعتنا الاجتماعية، يجب أن نسعى جاهدين للحفاظ على التوازن بين التكنولوجيا والتفاعل الإنساني.

8. التضليل والتلاعب

يساهم المحتوى المُولّد بالذكاء الاصطناعي، مثل التزييف العميق، في نشر المعلومات الكاذبة والتلاعب بالرأي العام. وتُعدّ الجهود المبذولة للكشف عن المعلومات المضللة المُولّدة بالذكاء الاصطناعي ومكافحتها أمراً بالغ الأهمية للحفاظ على سلامة المعلومات في العصر الرقمي.

9. المخاطر الوجودية

يُثير تطوير الذكاء الاصطناعي العام (AGI) الذي يتفوق على الذكاء البشري مخاوف طويلة الأمد على البشرية. وقد يؤدي احتمال تطوير الذكاء الاصطناعي العام إلى عواقب غير مقصودة، وربما كارثية، إذ قد لا تتوافق أنظمة الذكاء الاصطناعي المتقدمة هذه مع القيم أو الأولويات الإنسانية.

كيف يمكن أن يؤثر الذكاء الاصطناعي على سوق العمل؟

لعل أكثر ما يقلق البشرية من تطور الذكاء الاصطناعي هو تأثيره على سوق العمل. وتتركز المخاوف حول احتمال تسريح أعداد كبيرة من الموظفين بسبب الأتمتة أو تخفيضات الميزانية، مما يثير تساؤلات عديدة حول مستقبل التوظيف.

لا يُمكن إنكار تأثير الذكاء الاصطناعي على التوظيف، تماماً كأي تقنية ثورية أخرى في عصره. ومع ذلك، لا تُشير هذه التغييرات بالضرورة إلى انخفاض نهائي في الوظائف أو عواقب سلبية فحسب. السؤال الأساسي هو: أين سيكون لهذه التقنية التأثير الأكبر؟

تتجلى تأثيرات الذكاء الاصطناعي بشكل أوضح في الأدوار التي تنطوي على مهام متكررة تتطلب الحد الأدنى من الإبداع أو المشاركة. في الوقت نفسه، يزداد الطلب على المتخصصين القادرين على تشغيل الذكاء الاصطناعي وتسخير إمكاناته. ومع انخفاض عدد الوظائف، تظهر فرص عمل جديدة عديدة، مما يُحقق مكاسب صافية في التوظيف. علاوة على ذلك، مع نمو المعرفة بالذكاء الاصطناعي، فإنه يُمكّن من التكيف وإعادة تأهيل القوى العاملة بشكل أفضل.

غالباً ما يؤدي تطبيق الذكاء الاصطناعي إلى تحولات في أدوار الموظفين داخل المؤسسات. ويُعد تقديم الدعم من خلال التدريب والتوجيه أمراً بالغ الأهمية. فالشركات التي تستثمر في تطوير موظفيها من خلال رفع مهاراتهم تُقلل بشكل كبير من خطر الاستبعاد التكنولوجي، مما يضمن انتقالاً أكثر سلاسة نحو التحول الرقمي.

الهدف الرئيسي من دمج الذكاء الاصطناعي في الأعمال هو أتمتة المهام الروتينية المتكررة وتقليلها. من خلال زيادة الإنتاجية وتوفير وقت الموظفين، يمكن للمؤسسات التركيز على مبادرات أكثر استراتيجية وإبداعاً. وهذا أيضاً يُعزز العمليات اليومية من خلال تقليل الأخطاء وتحسين الجودة.

التخفيف من خطر الاستبعاد التكنولوجي

يُمثل الذكاء الاصطناعي أحد التحديات التي يُمثلها، لا سيما بين الموظفين ذوي الكفاءات الرقمية المحدودة أو من الأجيال الأكبر سناً، إمكانية الاستبعاد التكنولوجي. وقد يُفاقم هذا من عدم المساواة في سوق العمل من خلال زيادة الطلب على العمال ذوي المهارات العالية وتهميش الآخرين.

آليات تُساعد في تخفيف مخاطر الذكاء الاصطناعي

لمعالجة تلك المخاطر والتحديات، يجب وضع استراتيجيات محكمة تركز على الإنسان أولاً.

1. التواصل الفعال

يُعد التواصل الشفاف أمراً أساسياً لإدارة التغيير. يجب على الموظفين إدراك أن التطورات التكنولوجية تهدف إلى تبسيط العمليات، وتحسين الإنتاجية، وتحسين جودة العمل، بدلاً من إلغاء الوظائف. يجب على المؤسسات مُعالجة المخاوف مُبكراً من خلال شرح أسباب التغييرات وأهدافها قبل تنفيذها.

2. الاستراتيجية طويلة المدى

لا ينبغي اعتبار تبني الذكاء الاصطناعي مشروعاً لمرة واحدة. يجب على الشركات تقييم المجالات الرئيسية لعملياتها التي ستستفيد من الأتمتة، ووضع استراتيجية متعددة السنوات للتنفيذ.

3. تكيف القوى العاملة

يجب على المؤسسات الاستفادة من مهارات الموظفين الحالية وتوفير برامج إعادة التأهيل المهني وتطوير المهارات التقنية والمعلوماتية.