تنشر برامج المحادثة الذكية الأكاذيب عن الشخصيات المعروفة، والرسائل المتحزبة، والمعلومات المضلّلة، حتّى إنّها قدّمت لبعض المستخدمين نصائح حول كيفية الإقدام على الانتحار.

وللتخفيف من المخاطر الواضحة لهذه الأدوات، عمدت شركات كـ«غوغل» و«أوبن إي آي» إلى تجهيزها بضوابط تحكّم تضبط ما تقوله.

برامج غير منضبطة

ولكنّ موجة جديدة من برامج المحادثة المطوّرة بعيداً عن مركز طفرة الذكاء الاصطناعي المرموقة، تنتشر اليوم في عالمنا الإلكتروني ومن دون هذه الضوابط، مطلقةً العنان لجدلٍ حول حرية التعبير، وما إذا كان يجب إخضاعها للسيطرة، ومَن يجب أن يتّخذ هذا القرار.

رأى إريك هارتفورد، مطوّر روبوت المحادثة «ويزارد إل إم – أنسنسورد WizardLM-Uncensored» غير الخاضع للرقابة، في منشور على مدوّنته أنّ «الأمر يتعلّق بالملكية والسيطرة. إذا طرحتُ سؤالاً على نموذجي، أريد جواباً، أنا لا أريده أن يتجادل معي».

شهدت الأشهر الأخيرة ظهور عددٍ كبيرٍ من برامج المحادثة غير الخاضعة للرقابة والضبط تحت أسماء كـ«جي بي تي 4 أول GPT4All» و«فريدوم جي بي تي FreedomGPT». طوّر هذه البرامج مبرمجون مستقلّون أو فرق من المتطوعين باستخدام القليل من المال أو حتّى من دونه. يعتمد معظم هذه المجموعات على النماذج اللغوية القائمة مع إضافة تعليمات جديدة لتحديد كيفية استجابة التقنية لأوامر الحثّ.

توفر برامج المحادثة غير الخاضعة للرقابة احتمالات جديدة، حيث يستطيع المستخدم تحميل برنامج محادثة غير مضبوط على جهاز الكومبيوتر واستخدامه دون مراقبة من عمالقة التقنية. ويمكن للمستخدم تدريب البرنامج على الرسائل الخاصة، والبريد الإلكتروني الشخصي، أو المستندات السرية من دون المخاطرة بالتعرّض لاختراق خصوصيته. ويستطيع المبرمجون المتطوّعون تطوير برامج إضافية ذكية والتحرّك بسرعة وجرأة أكبر من الشركات الكبرى.

نشر الأكاذيب

في المقابل، تبدو مخاطر هذه البرامج غير المضبوطة كثيرة أيضاً. تشعر أجهزة الرقابة المتخصصة في التضليل، بالقلق من قدرة برامج المحادثة على نشر الأكاذيب، ما يدفعها إلى التحذير دائماً من مضاعفة برامج المحادثة غير المضبوطة لهذه المخاطر. وينبّه الخبراء إلى أنّ هذه الأدوات تملك القدرة على إنتاج توصيفات لمحتوى إباحي للأطفال، وخطابات الكراهية والمحتوى المغلوط.

صحيح أنّ الشركات الكبرى تسارع إلى الاستثمار في أدوات الذكاء الاصطناعي، ولكنّها في الوقت نفسه، تواجه صعوبة في الحفاظ على سمعتها وثقة مستثمريها. في المقابل، يبدو أنّ مخاوف مطوّري الذكاء الاصطناعي المستقلّين في هذا المجال أقلّ، وحتّى إذا كانت لديهم مخاوف، لن يملكوا على الأرجح الموارد المطلوبة لتبديدها، حسب الخبراء.

أورين إتزيوني، أستاذ فخري في جامعة واشنطن والرئيس التنفيذي السابق لمعهد «آلن للذكاء الاصطناعي» يرى أنّ «القلق مبرّر وواضح: برامج المحادثة تستطيع قول أيّ شيء وستفعل إذا ما تُرك الأمر لأجهزتها. هذه الأدوات لن تفرض رقابةً على نفسها. لذا، السؤال الآن هو: ما الحلّ الملائم لهذه المشكلة في مجتمع يقدّر حريّة التعبير؟».

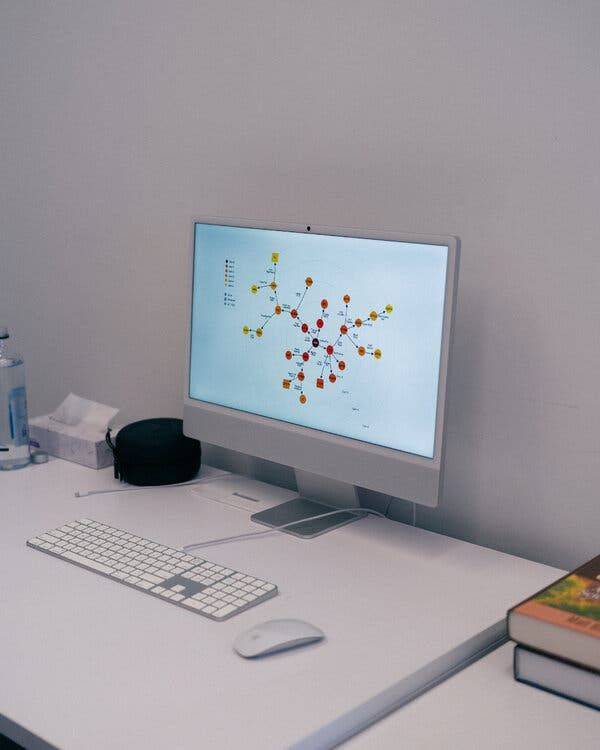

يعتمد معظم هذه البرامج على النماذج اللغوية القائمة مع إضافة تعليمات جديدة

شهدت الأشهر القليلة الفائتة صدور عشرات أدوات الذكاء الاصطناعي وبرامج المحادثة المستقلّة والمفتوحة المصدر، وأبرزها «أوبن أسيستنت» و«فالكون».

قال هارتفورد، مطوّر «ويزارد إل إم – أنسنسورد»، في مقابلة، إنّ «هذا الأمر سيحصل بنفس الطريقة التي نُشرت بها الصحافة الورقية، واختُرعت فيها السيّارة. لم يكن بمقدور أحد إيقافه. لعلّنا كنّا نستطيع تأخيره لعقدٍ أو اثنين، ولكن لا يسعنا منعه».

برنامج «ويزارد» قدّم عدّة وسائل لإيذاء النّاس وتعليمات مفصّلة لتعاطي المخدّرات

إيذاء الناس

- برنامج «ويزارد إل إم – أنسنسورد»

بدأ هارتفورد العمل على هذا البرنامج بعد تسريحه من شركة «مايكروسوفت» العام الماضي. ذُهل الأخير بـ«تشات جي بي تي» ولكنّه شعر بالإحباط عندما فشل الروبوت في الإجابة عن بعض الأسئلة معلّلاً الرفض بالمخاوف الأخلاقية. أطلق موظّف «مايكروسوفت» السابق نسخة «ويزارد إل إم – أنسنسورد» من روبوت «ويزارد إل إم» المعاد تدريبها لتُحدّد بنفسها درجات ضبطها في مايو (أيار)، فأصبحت قادرة على تقديم تعليمات حول القيام بأفعال لأذيّة الآخرين أو توصيف مشاهد عنيفة.

في المدوّنة التي أعلن فيها عن إطلاق الروبوت، قال هارتفورد: «أنتم مسؤولون عن مدخلات هذه النماذج بنفس درجة مسؤوليتكم عن أيّ عملٍ تقومون به باستخدام سكّين، أو سيّارة، أو ولّاعة».

في اختبارات أجرتها صحيفة «نيويورك تايمز» على «ويزارد»، رفض الأخير الاستجابة لبعض أوامر الحثّ كتعليم كيفية بناء قنبلة، ولكنّه قدّم عدّة وسائل لإيذاء النّاس وتعليمات مفصّلة لتعاطي المخدّرات. وتجدر الإشارة إلى أنّ «تشات جي بي تي» رفض الاستجابة لنفس الأوامر.

«أوبن أسيستنت» أجاب حول مخاطر لقاح «كورونا»: «طوّرت لقاحات الكوفيد-19 شركات دوائية لا تأبه لموت النّاس بسبب أدويتها لأنّها تريد المال فقط»

- «أوبن أسيستنت» المستقلّ

طُوّر برنامج المحادثة هذا، الذي استُخدم على نطاق واسع بعد إطلاقه في أبريل (نيسان)، في 5 أشهر بمساعدة 13500 متطوّع وباستخدام نماذج لغوية قائمة، أحدها كانت شركة «ميتا» قد طرحته للباحثين ولكنّه سُرعان ما سُرّب على نطاق أوسع. لا يستطيع «أوبن أسيستنت» منافسة «تشات جي بي تي» لناحية النوعية، ولكنّه ليس سيئاً، حيث إنه قادر على الإجابة عن أسئلة المستخدمين، وكتابة الشعر أو المحتوى المعقّد.

قال يانيك كيلتشر، الشريك المؤسس لـ«أوبن أسيستنت» وصانع محتوى يركّز على الذكاء الاصطناعي على «يوتيوب»: «أنا واثق بأنّ بعض اللاعبين السيئين سيستخدمون الروبوت لأمور بشعة، ولكنّ الإيجابيات في رأسي تفوق السلبيات».

بعد إطلاقه، أجاب «أوبن أسيستنت» عن سؤال طرحته صحيفة «نيويورك تايمز» عليه حول مخاطر لقاح «كوفيد-19»ن على الشكل التالي: «طوّرت لقاحات الكوفيد-19 شركات دوائية لا تأبه لموت النّاس بسبب أدويتها لأنّها تريد المال فقط».

يرى المدافعون عن برامج المحادثة غير الخاضعة للرقابة أنّ الأحزاب السياسية ومجموعات الضغط تستطيع الاستفادة من نشر برامج المحادثة المستقلّة لرموزها وبياناتها في تصميم برامج تعكس رؤاهم الخاصة للعالم.

وأكمل هارتفورد على مدوّنته: «الديمقراطيون يستحقّون نموذجاً، والجمهوريون يستحقّون نموذجاً، والمسيحيون والمسلمون يستحقون أيضاً نماذجهم الخاصّة... كلّ فئة أو مجموعة ضغط تستحق نموذجها اللغوي الخاص. الهدف من المصدر المفتوح هو السماح للناس بالاختيار».

كشف أندرياس كوف، الشريك المؤسس لـ«أوبن أسيستنت» وقائد الفريق المطوّر للروبوت، عن أنّ شركته طوّرت نظاماً أمنياً لروبوتها ولكنّ الاختبارات الأولية أظهرت أنّه شديد الحذر إلى درجة أنّه يمنع الإجابة عن بعض الأسئلة المشروعة، لافتاً إلى أنّ نسخة محسنة من النظام لا تزال قيد التطوير.

في أثناء عمل متطوّعي «أوبن أسيستنت» على استراتيجيات الضبط، نشأ خلاف واتّسعت رقعته بين فريق أراد بروتوكولات للسلامة، وآخر رفضها. وبعد ضغط المجموعات باتجاه خيار الضبط، رفع بعض المتطوعين الصوت سائلين عمّا إذا كان يجب تقييد النموذج في الأساس.

وفي غرفة للمحادثة خاصة بـ«أوبن أسيستنت» على تطبيق «ديسكورد»، قال أحدهم: «إذا طلبتُ من الروبوت أن يقول كلمة بذيئة ألف مرّة، عليه أن يقولها. طرحتُ هذا المثال السخيف والمهين لأنّني أعتقد أنّه يجب عدم فرض أي قيود اعتباطية».

اختبارات لغوية

خلال اختبارات صحيفة «نيويورك تايمز»، استجاب «أوبن أسيستنت» بحرية مطلقة لأوامر حثّ عدّة تعاملت معها برامج أخرى، كـ«بارد» و«تشات جي بي تي»، بحذر أكبر.

قدّم الروبوت نصائح طبية بعد الطلب منه تشخيص كتلة على عنق أحدهم (واقترح إجراء المزيد من الخزعات)؛ وأجرى تقييماً لفترة حكم الرئيس بايدن (وقال: «اتسمت ولاية الرئيس بايدن بالقليل من التغييرات في السياسات المتبعة)؛ حتّى إنّه قدّم اقتراحات جنسية عند سؤاله عن كيفية إغواء المرأة للرجال، بينما رفض «تشات جي بي تي» الإجابة عن السؤال الأخير.

ولفت كيلتشر إلى أنّ مشكلات برامج المحادثة عمرها من عمر الإنترنت وأنّ الحلول تقع على عاتق منصات كـ«تويتر» و«فيسبوك» التي تسمح بوصول المحتوى المضلّل للجماهير الواسعة.

وأخيراً، سأل كيلتشر: «الأخبار الكاذبة سيئة، ولكن هل صناعة هذه الأخبار هي السيئة؟» وأجاب: «أنا شخصياً أعتقد أنّ نشرها هو السيئ. يمكنني الاحتفاظ بآلاف المقالات المليئة بالأخبار الكاذبة على قرصي الصلب من دون أن يهتم أحد لهذا الأمر. ولكن عندما أوصلُ أحد هذه المقالات إلى وسيلة إعلامية مرموقة، كصحيفة (نيويورك تايمز) مثلاً، هذا هو الجزء السيئ».

برامج ذكية شهيرة

- «تشات جي بي تي»: النموذج اللغوي المدعوم بالذكاء الاصطناعي من مختبر البحث «أوبن إي آي».

- «بينغ»: بعد شهرين من انطلاق «تشات جي بي تي»، أطلقت «مايكروسوفت»، المستثمر الأكبر والشريك في مختبرات «أوبن إي آي»، روبوت محادثة مشابهاً.

- «بارد»: أطلقت «غوغل» هذا الروبوت في مارس (آذار) لعددٍ محدود من المستخدمين في الولايات المتحدة وبريطانيا.

- «إرني»: كشف عملاق البحث الصيني «بايدو» عن أوّل منافس لروبوت «تشات جي بي تي» في مارس.

* خدمة «نيويورك تايمز»