يقول المدرسون إنهم يرغبون في تمكين طلاب المرحلة الثانوية من قيادة الذكاء الاصطناعي، بدلاً من أن يكونوا مجرد مُتلقّين تُسيّرهم برامج الدردشة الآلية.

وفي الجلسة الأولى من دورة جديدة في الذكاء الاصطناعي أقيمت هذا الشهر لطلاب الصف الثاني عشر في «مدرسة واشنطن بارك الثانوية» في نيوآرك، لم يطرح أي شيء عن الذكاء الاصطناعي بل إنها خُصصت للذكاء البشري... بشكلٍ كامل.

كان واجب الطلاب: مُقارنة أوقات تصفّحهم السلبي لمنشورات وسائل التواصل الاجتماعي التي يُديرها الذكاء الاصطناعي، مع أوقات اختيارهم المُباشر للفيديوهات أو نتائج بحث «غوغل» التي يرغبون هم في مُشاهدتها.

«هل تُسيّر التكنولوجيا أم أنها هي التي تُسيّرك؟»

«هل تُسيّر أنت التكنولوجيا أم أنها هي التي تُسيّرك؟» هكذا طُرح السؤال من خلال شريحة عرض (سلايد) على السبورة البيضاء في مدرسة واشنطن بارك الثانوية.

وفي نقاشٍ صفّيٍّ تلا ذلك، قال طالبٌ يُدعى أدريان فاريل، 18 عاماً، إنه سيطر على الذكاء الاصطناعي من خلال طلبه من برنامج دردشة آلي مُراجعة واجباته المنزلية في الرياضيات للتأكّد من دقّتها. بينما قالت الطالبة بريانا بيريز، البالغة من العمر 18 عاماً، إنها دخلت في «وضع الراكب» عند استخدام ميزة «دي جي الذكاء الاصطناعي» في موقع «سبوتيفاي». وأضافت: «إنها تشغل موسيقاي المفضلة، فلا داعي لتغييرها».

«محو أمية الذكاء الاصطناعي» - مادة تعليمية

تسعى المدارس في جميع أنحاء الولايات المتحدة جاهدةً لإدخال مادة جديدة: معرفة (محو أمية) الذكاء الاصطناعي A.I. literacy. وفيما يسميها بعض التربويين «رخصة قيادة» للذكاء الاصطناعي، تهدف الدروس الجديدة إلى تعليم الطلاب كيفية فحص أحدث الأدوات التقنية واستخدامها بمسؤولية. ويقول المعلمون إنهم يريدون إعداد الشباب للتعامل مع عالم يتشكل بشكل متزايد بفعل الذكاء الاصطناعي، حيث تقوم برامج الدردشة الآلية بتأليف نصوص تبدو كأنها من صنع البشر، فيما يستخدم أصحاب العمل الخوارزميات للمساعدة في تقييم المرشحين للوظائف.

برامج ذكية في المناهج الدراسية

ويركز بعض المدارس على برامج الدردشة الآلية التي تعمل بالذكاء الاصطناعي، حيث تعلم الطلاب كيفية استخدام مساعد غوغل «جيميناي» أو مساعد مايكروسوفت «كوبايلوت». بينما تقوم مدارس أخرى بإدخال الذكاء الاصطناعي في المناهج الدراسية. وبوصفه موضوعاً جديداً في المناهج الدراسية، تتناول الدروس التداعيات المجتمعية مثل انتشار الصور العارية المُولّدة بالذكاء الاصطناعي، وهي الظاهرة المعروفة باسم «التزييف العميق».

تحسين التعليم أم تدميره؟

تزداد دروس الذكاء الاصطناعي شيوعاً في المدارس مع احتدام الجدل حول ما إذا كانت برامج الدردشة الآلية ستُحسّن التعليم أم ستُدمّره. يقول المؤيدون إن على المدارس أن تُعلّم الشباب سريعاً استخدام الذكاء الاصطناعي وأنه ضروري لدعم تعلّمهم، وإعدادهم للوظائف، ومساعدة الولايات المتحدة على منافسة الصين. وفي العام الماضي، أصدر الرئيس ترمب أمراً تنفيذياً يحثّ المدارس على تدريس «أساسيات الذكاء الاصطناعي» بدءاً من رياض الأطفال.

في مقابل ذلك يُحذر باحثون في مجال التعليم من أن برامج الدردشة الآلية قد تُلفّق المعلومات، وتُسهّل الغش، وتُضعف التفكير النقدي. ووجدت دراسة حديثة أجرتها مطبعة جامعة كمبردج و«مايكروسوفت للأبحاث» أن الطلاب الذين دوّنوا ملاحظات على النصوص كانوا أكثر فهماً للقراءة من الطلاب الذين تلقوا مساعدة من برامج الدردشة الآلية.

مخاطر الذكاء الاصطناعي أكبر من فوائده

في الوقت الراهن، «تفوق مخاطر استخدام الذكاء الاصطناعي في التعليم فوائده»، هذا ما خلصت إليه مؤسسة بروكينغز Brookings Institution الشهر الماضي في تقرير حول استخدام الذكاء الاصطناعي في المدارس.

موقف وسط

في خضمّ هذا الجدل، تتخذ مدارس مثل مدرسة واشنطن بارك الثانوية موقفاً وسطاً، إذ تتعامل مع الذكاء الاصطناعي كما لو كان سيارة، وتساعد الطلاب على وضع قواعد لاستخدامه.

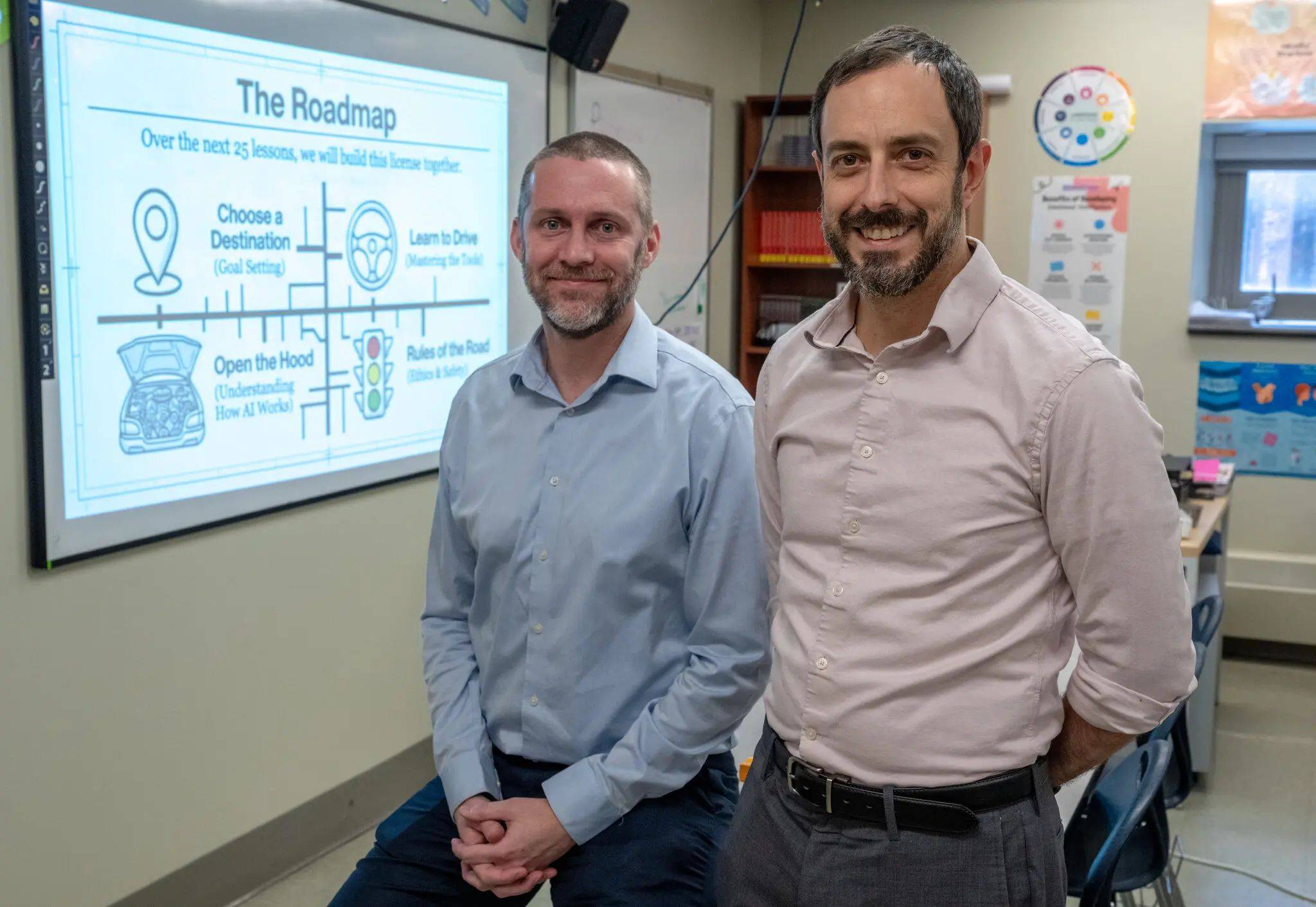

وشبّه مايك تاوبمان، 45 عاماً، وهو مُدرّس استكشاف المسارات المهنية، الذي شارك في تطوير منهج محو الأمية الجديد في المدرسة، هذه الحصة الدراسية بتحضير المراهقين لاختبار رخصة القيادة.

وتساءل تاوبمان: «إلى أين تريدون الوصول؟ وهل يُمكن للذكاء الاصطناعي مساعدتكم على ذلك؟». وأضاف أن الطلاب بحاجة إلى تعلّم كيفية استخدام أدوات الذكاء الاصطناعي، وتحليل وظائفها، ووضع إرشادات للاستخدام الشخصي، وتصميم سياسات سلامة مثالية.

وتابع: «ما القوانين والقواعد والمعايير التي يجب أن تُطبّق على الذكاء الاصطناعي في مدينتي وبلدي؟».

تجربة مدرسية

يخدم مبنى واشنطن بارك، وهو مبنى من أربعة طوابق بواجهة من الطوب الأحمر في وسط نيوآرك، نحو 900 طالب في المرحلة الثانوية. وهو جزء من شبكة مدارس أنكومون، وهي شبكة مدارس مستقلة في شمال شرقي الولايات المتحدة الأميركية تركز على إعداد الطلاب للجامعة والمسارات المهنية.

وقد ابتكر تاوبمان مع سكوت كيرن، مدرس التاريخ الأميركي، فكرة المقرر الدراسي الاختياري الجديد حول الذكاء الاصطناعي. وكان كلاهما قد أدخل أدوات ومواضيع الذكاء الاصطناعي في مقرراتهما الدراسية.

وشارك كيرن، البالغ من العمر 45 عاماً، أخيراً في برنامج «بلاي لاب Playlab»، وهي منظمة غير ربحية تساعد المعلمين على إنشاء تطبيقات ذكاء اصطناعي مخصصة لمقرراتهم الدراسية. ولمساعدة طلابه على صقل مهاراتهم في الكتابة الجدلية، طوَّر كيرن روبوتات محادثة لصفوف التاريخ الأميركي بناءً على مواد المقرر الدراسي وتقييمات الطلاب. كما وضع إرشادات واضحة للطلاب حول متى يجب استخدام روبوتات الذكاء الاصطناعي ومتى يجب تجنب استخدامها.

مناقشة تاريخية اصطناعية-بشرية

وفي تجربة صفّية درّس السيد كيرن جانباً دراسياً متقدماً في تاريخ الولايات المتحدة حول أحداث شغب شيكاغو العرقية، وهي احتجاجات عنيفة اندلعت إثر مقتل مراهق أسود عام 1919. في البداية، طلب من الطلاب قراءة قصاصات صحافية قديمة ووثائق تاريخية أخرى. ثم أدار نقاشاً صفّياً حول الاتجاهات الأوسع التي أسهمت في تأجيج التوترات.

بعد ذلك، طلب السيد كيرن من الطلاب تخصيص بضع دقائق لوصف السبب الرئيسي للشغب لبرنامج دردشة آلي كان قد أنشأه خصيصاً لهذا الفصل.

وبعد بضع دقائق أخرى، أخبر كيرن الطلاب أن وقتهم مع الروبوت قد انتهى، واستأنف نقاش الصف. وأكد أن التعلم الأساسي للطلاب يجب أن يبقى نشاطاً خالياً من الذكاء الاصطناعي. وقال كيرن: «في أي وقت نرغب فيه أن يتفاعل الطلاب بعضهم مع بعض أو أن يمارسوا التفكير النقدي الأولي، لا أريد أبداً أن يتدخل الذكاء الاصطناعي أو أي نوع من التكنولوجيا المشابهة في ذلك».

وفي قسم آخر من المدرسة، كان تاوبمان يُدرّس دورة استكشاف المسارات المهنية. وقد طوّر مجموعة متنوعة من برامج الدردشة الآلية لمحاكاة المسارات المهنية لطلابه.

«رخصة قيادة» الذكاء الاصطناعي

وأقرّ كيرن وتاوبمان بأن تعبير «رخصة القيادة: الذي استخدموه له حدود. إذ سيعاني الطلاب من صعوبات اتخاذ قرارات مدروسة بشأن مخاطر أنظمة الذكاء الاصطناعي القوية... حتى الحين الذي سيتم فيه تزويد برامج الدردشة الآلية بآليات حماية مُدمجة تُشبه أحزمة الأمان والوسائد الهوائية.

وقال كيرن إنه يأمل أن يتمكن الطلاب يوماً ما من «التأثير في بناء هذه الأدوات بطريقة أفضل وأكثر عدلاً وأكثر مراعاةً للبيئة مما هو موجود الآن».

* خدمة «نيويورك تايمز».