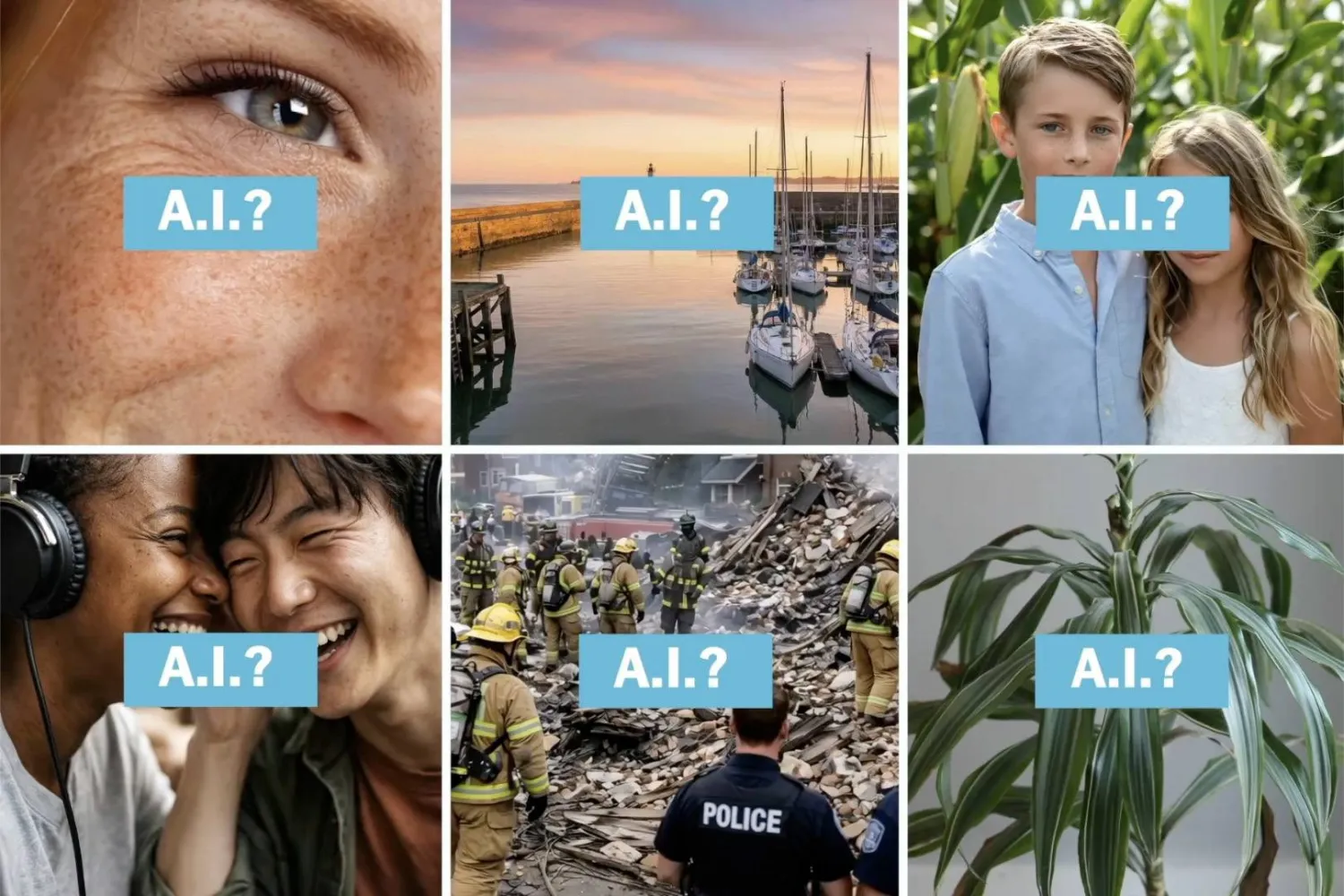

بلغ المحتوى المُولّد بواسطة الذكاء الاصطناعي مستوى عالياً من الواقعية لدرجة أنه يصعب في كثير من الأحيان، التمييز بين ما هو حقيقي وما هو زائف من مقاطع الفيديو والصور المتداولة عبر وسائل التواصل الاجتماعي.

«كاشف الذكاء الاصطناعي»

هنا يأتي دور «كاشف الذكاء الاصطناعي» AI detector. وفي الوقت الراهن، تزعم أكثر من اثنتي عشرة أداة على الإنترنت قدرتها على التمييز بين المحتوى الحقيقي والآخر المُولّد بواسطة الذكاء الاصطناعي، عبر البحث عن علامات مائية مخفية، وأخطاء في التركيب، وغيرها من الدلائل الرقمية.

ومع ذلك، يتسم الواقع بتعقيد أكبر، حسبما كشفت سلسلة من الاختبارات التي أجرتها صحيفة «نيويورك تايمز». إذ وفي الوقت الذي نجح كثير من الأدوات في كشف بعض محتوى الذكاء الاصطناعي، فإنها لم تكن دقيقة بما يكفي لمنح المستخدمين ثقة تامة.

وتكشف النتائج أن هذه الأدوات قد تساعد في تأكيد الشكوك حول الوسائط المُولّدة بواسطة الذكاء الاصطناعي، لكن من الصعب الاعتماد عليها لإصدار أحكام قاطعة. وهذا يطرح تحديات جديدة أمام مستخدمي الإنترنت ومدققي الحقائق، الذين يحاولون السيطرة على التزييف الناتج عن الذكاء الاصطناعي، الذي اجتاح وسائل التواصل الاجتماعي في الأشهر الأخيرة.

بشكل عام، وجدنا أن أي استنتاجات تتوصل إليها هذه الأدوات، يجب أن تكون مدعومة بأبحاث أخرى، مثل التفاصيل الموجودة في الصور الرسمية أو التقارير الإخبارية.

رصد الاحتيال

ومع ذلك، ينظر كثيرون إلى أدوات الكشف، التي لم تعد تحلل الصور فقط، بل كذلك مقاطع الفيديو والصوت، بصفتها أدوات قوية للتحقق من حقيقة المحتوى المصور، في لحظة حاسمة ينتشر فيها المحتوى المُولّد بالذكاء الاصطناعي عبر وسائل التواصل الاجتماعي، ويضلل المستخدمين خلال أحداث عاجلة. وتتبنى البنوك وشركات التأمين مثل هذه الأدوات، في محاولة لكشف عمليات الاحتيال المدعومة بالذكاء الاصطناعي، والمعلمون في البحث عن الانتحال، ومُحققو الإنترنت في محاولة للتحقق من الصور ومقاطع الفيديو المتداولة على وسائل التواصل الاجتماعي.

في هذا الصدد، قال مايك بيركنز، الأستاذ في الجامعة البريطانية في فيتنام، الذي درس أدوات كشف الذكاء الاصطناعي، وخلص إلى أن أدوات كشف النصوص غير موثوقة: «لن تجد أبداً أداة كشف قادرة على تحديد استخدام الذكاء الاصطناعي بنسبة 100 في المائة في النصوص أو الصور أو مقاطع الفيديو، أياً كان شكلها». وأضاف أنه مع تطور مولدات الذكاء الاصطناعي، ستواجه أدوات الكشف صعوبة في مواكبة هذا التطور، ما يُؤدي إلى ما يشبه «سباق تسلح».

اختبار 21 أداة

وبالعودة إلى الاختبارات التي أجريناها، فقد تم فحص أكثر من 12 أداة كشف ذكاء اصطناعي وبرامج دردشة آلية، قادرة على تحديد مقاطع الفيديو والصوت والموسيقى والصور الزائفة، وأجرينا أكثر من 1000 عملية مسح إجمالاً.

وهذا ما خلصنا إليه:

• نجاح الكشف عن التزييفات البسيطة. نجح كثير من الأدوات في ذلك. ومن المعروف أن معظم الصور الزائفة التي تُنتجها أدوات الذكاء الاصطناعي والمنتشرة على الإنترنت اليوم لا تتطلب جهداً كبيراً لإنشائها: إذ يكفي أن يُدخل المستخدمون عبارات بسيطة، ليحصلوا على صورة أو مقطع فيديو واقعي لأشخاص يبدون حقيقيين. وقد انتشر هذا النوع من المحتوى على الإنترنت في أعقاب اعتقال نيكولاس مادورو، الرئيس الفنزويلي المخلوع، في يناير (كانون الثاني) الماضي.

ولاختبار ذلك، طلبنا من «تشات جي بي تي»، برنامج دردشة آليّ من تطوير «أوبن إيه آي»، إنشاء صورة لشخصين يضحكان. وبالفعل، أنتج صورة واقعية، إلا أنها احتوت على عدة مؤشرات تدل على أنها مُولّدة بواسطة الذكاء الاصطناعي: فالإضاءة والتكوين والملامح جاءت مثالية بشكل مبالغ فيه، إضافة إلى أن حركة اليد بدت غير طبيعية.

وقد رصد معظم برامج كشف التزييف بسرعة أن الصورة مُولّدة بواسطة الذكاء الاصطناعي، باستثناءات قليلة. على سبيل المثال، لم يستطع «تشات جي بي تي» كشف الصورة الزائفة التي أنشأها قبل لحظات.

وعادة ما يجري تدريب أنظمة كشف الذكاء الاصطناعي على مجموعات ضخمة من الأعمال المُولَّدة بواسطة الذكاء الاصطناعي، لتتعلم رصد الإشارات الرقمية التي تتركها هذه الأدوات.

من جهتها، شاركت «التايمز» نتائج الاختبارات مع شركات أنظمة كشف الذكاء الاصطناعي. وأفادت الكثير منها بأنه لا يوجد نظام كشف دقيق بشكل كامل في جميع الأوقات. وفي دلالة على سرعة تطور مجال كشف الذكاء الاصطناعي، صرَّحت عدة شركات بأنها على وشك إصدار تحديثات رئيسة لنماذجها لتحسين أدائها.

صعوبة رصد الفيديو المزيف

• صعوبة التعامل مع الصور الأشد تعقيداً. واجهت أدوات التحقق صعوبةً أكبر في التعامل مع صور معقدة، مثل مشهد خيالي لميناء ساحلي، يحتوي على عدد قليل للغاية من المؤشرات الدالة على أنها مولدة بواسطة الذكاء الاصطناعي. وربما يكون السبب أن بعض هذه الأنظمة مُدرَّبة في الغالب على تحديد الوجوه، لاستخدامها في أغراض الأمن ومكافحة الاحتيال.

• صعوبة القدرة على تحليل مقاطع الفيديو. إذ لم تتمكن سوى قلة من هذه الأدوات. بمرور الوقت، تتحول مقاطع الفيديو المُولّدة بالذكاء الاصطناعي، إلى تهديد متنام لوسائل التواصل الاجتماعي؛ فقد أدى إطلاق تطبيق «سورا»، الخاص بتوليد مقاطع الفيديو بالذكاء الاصطناعي من تطوير شركة «أوبن إيه آي»، إلى انتشار واسع لمقاطع الفيديو المُزيّفة عبر هذه المنصات، مع قلة من العلامات التي تُشير إلى تزييفها من قِبل شركات التواصل الاجتماعي.

لا يمتلك سوى عدد قليل من أدوات كشف التزييف بالذكاء الاصطناعي، القدرة على تحليل الفيديو والصوت، وقد حققت هذه الأدوات نتائج متفاوتة.

اللافت أن مواد الفيديو والمواد الصوتية برزت بوصفها تهديدات أمنية رئيسة للشركات: تخيّل مكالمة من رئيس تنفيذي، بينما يكون صوته في الواقع مُقلّداً بالذكاء الاصطناعي، أو مؤتمر فيديو مع شخصية مُولّدة بالذكاء الاصطناعي تبدو حقيقية.

وقد استثمرت الشركات المعنية بأدوات الكشف مبالغ طائلة لكشف هذا التزييف، ووفرت بالفعل القدرة على تحديد ما إذا كان الفيديو أو الصوت أو الموسيقى مُولّداً بالذكاء الاصطناعي، بل وحتى تحليل البث المباشر لمؤتمرات الفيديو. وقد سلطت بعض التحليلات الضوء على أجزاء الفيديو المُزيّفة، والأجزاء التي عُدت حقيقية.

الصوت المزيف وتمييز الصور الحقيقية

• كفاءة في كشف الصوت المُزيّف. وأكثر الأدوات حققت ذلك. سرعان ما تفوقت المواد الصوتية المولدة بالذكاء الاصطناعي على الصور والفيديوهات، وأصبحت شديدة الواقعية.

وتُنتج أدوات مثل تلك التي توفرها «إليفين لابس» ElevenLabs، أصواتاً واقعية بشكل ملحوظ، تتضمن التنفس والتوقفات في أثناء الحديث ونبرة صوت ديناميكية. وتُستخدم هذه الأصوات في مقاطع الفيديو و«الميمات» المنتشرة، وكذلك في عمليات الاحتيال عبر الجوال وانتحال الشخصيات.

وبالفعل، تمكّنت سبعة من برامج كشف تزييف الصوت وبرامج الدردشة الآلية، التي اختبرناها من التحقق من الصوت المُزيّف، وكان أداء «سنسيتي» Sensity و«ريزمبل » Resemble للذكاء الاصطناعي الأفضل في هذا المجال. حتى عندما كان الصوت معدلاً بدرجة كبيرة، استطاعت هذه الأدوات أن تُحدّد بثقة عالية أن الأصوات أو الموسيقى مُولّدة بالذكاء الاصطناعي. كما رصدت الأصوات الحقيقية في اختباراتنا.

• كفاءة أكبر في تحديد الصور الحقيقية. من مخاطر برامج كشف تزييف الصوت باستخدام الذكاء الاصطناعي أنها قد تُصنّف شيئاً ما بصفته مُزيّفاً بينما هو حقيقي، ما يُسبّب فوضى في الأحداث الإخبارية الجارية أو يُثير الشكوك حول صحة الصور. مثلاً، عندما انتشرت صورة مروعة لجثة متفحمة على مواقع التواصل الاجتماعي مع بداية الصراع بين إسرائيل و«حماس»، عدّها بعض المراقبين صورة مفبركة باستخدام الذكاء الاصطناعي. ورجّح كثير من الخبراء أنها حقيقية، لكن الشكوك حيالها كانت قد انتشرت على نطاق واسع.

بوجه عام، أظهرت أدوات الكشف عن الصور المزيفة قدرةً أفضل على تمييز الصور الحقيقية.

كما أبلت بلاءً حسناً في تحليل مقاطع الفيديو الحقيقية، مثل التسجيلات من جوال «آيفون» أو مقاطع الأخبار المحملة من الإنترنت. ورغم أن الصوت المُولّد بالذكاء الاصطناعي خدع بعض الأدوات بالفعل، فإنها صنّفت جميعها مقطعاً لمراسل يقرأ نصاً مولداً بالذكاء الاصطناعي بصفته حقيقياً.

وقد انطوت الصور الحقيقية المُعدّلة بالذكاء الاصطناعي على تحديات استثنائية، إذ تمزج بعض الصور المزيفة المُولّدة بالذكاء الاصطناعي بين المحتوى الحقيقي والوسائط المُولّدة بالذكاء الاصطناعي، لإنشاء صور مزيفة تحمل صبغة واقعية يصعب على العين المجردة كشفها. ومثلاً، نشر البيت الأبيض صورة مُعدّلة لامرأة اعتُقلت في مينيابوليس، الشهر الماضي. ورجّحت معظم أدوات الكشف أن الصورة المُعدّلة حقيقية.

وأخيرا وجدنا أن معظم أدوات الكشف قد أغفلت التغييرات التي أجريت أثناء اختباراتنا أيضاً.

* خدمة «نيويورك تايمز»