بينما تقوم شركات مثل «أوبن إيه آي» OpenAI و «ميد جورني» Midjourney ببناء برامج الدردشة ومولدات الصور وغيرها من أدوات الذكاء الاصطناعي التي تعمل في العالم الرقمي، تستخدم الآن شركة ناشئة أسسها ثلاثة باحثين سابقين في «أوبن إيه آي» أساليب تطوير التكنولوجيا التي طورت برامج الدردشة بهدف بناء تكنولوجيا الذكاء الاصطناعي التي يمكنها التنقل في العالم المادي.

دمج الذكاء التوليدي بالروبوتات

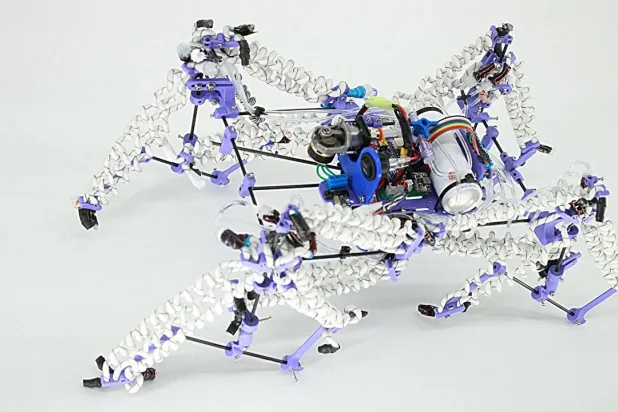

تعمل شركة «كوفارينت» Covariant، وهي شركة روبوتات مقرها في إميريفيل، كاليفورنيا، على ابتكار طرق للروبوتات لالتقاط المنتجات وفرزها أثناء نقلها عبر المستودعات ومراكز التوزيع. ويتمثل الهدف في مساعدة الروبوتات على فهم ما يجري حولها وتحديد ما يجب عليهم فعله بعد ذلك. كما تمنح هذه التقنية الروبوتات فهماً واسعاً للغة الإنجليزية، مما يسمح للأشخاص بالدردشة معها كما لو كانوا يتحدثون مع «جي بي تي» ChatGPT.

آلات تتحادث وتفهم الصور

التكنولوجيا، التي لا تزال قيد التطوير، ليست مثالية. ولكنها علامة واضحة على أن أنظمة الذكاء الاصطناعي التي تدير برامج الدردشة عبر الإنترنت ومولدات الصور ستعمل أيضاً على تشغيل الآلات في المستودعات، وعلى الطرق، وفي المنازل.

ومثل روبوتات الدردشة ومولدات الصور، تتعلم تكنولوجيا الروبوتات مهاراتها من خلال تحليل كميات هائلة من البيانات الرقمية. وهذا يعني أن المهندسين يمكنهم تحسين التكنولوجيا من خلال تزويدها بالمزيد والمزيد من البيانات.

روبوتات تجارية

لا تقوم شركة «كوفارينت» المدعومة بتمويل قدره 222 مليون دولار، ببناء الروبوتات بل تبني البرنامج الذي يشغل الروبوتات.

وتهدف الشركة إلى نشر تقنيتها الجديدة لنظام «روبوتك باتويل سيستم» مع روبوتات المستودعات، مما يوفر خريطة طريق للآخرين للقيام بالشيء نفسه في مصانع التصنيع وربما حتى على الطرق التي بها سيارات ذاتية القيادة.

شبكات عصبية ذكية

تُسمى أنظمة الذكاء الاصطناعي التي تقود برامج الدردشة ومولدات الصور بالشبكات العصبية، نسبة إلى شبكة الخلايا العصبية في الدماغ. ومن خلال تحديد الأنماط في كميات هائلة من البيانات، يمكن لهذه الأنظمة أن تتعلم كيفية التعرف على الكلمات والأصوات والصور، أو حتى توليدها بنفسها. هذه هي الطريقة التي قامت بها «أوبن إيه غي» ببناء ChatGPT، مما يمنحها القدرة على الإجابة على الأسئلة بشكل فوري وكتابة أوراق بحثية وإنشاء برامج كومبيوتر.

وقد تعلمت البرامج هذه المهارات من النصوص المنتقاة عبر الإنترنت. إلا أن العديد من الشركات يقوم الآن ببناء أنظمة يمكنها التعلم من أنواع مختلفة من البيانات في الوقت نفسه. فمن خلال تحليل مجموعة من الصور والتعليقات التوضيحية التي تصف تلك الصور، على سبيل المثال، يمكن للنظام فهم العلاقات بين الاثنين. ولذا يمكن أن يتعلم البرنامج أن كلمة «موز» تصف فاكهة صفراء منحنية.

توظيف مولد الصور «سورا»

استخدمت شركة «أوبن إيه آي» هذا النظام لبناء مولد الفيديو الجديد «سورا» Sora. إذ ومن خلال تحليل الآلاف من مقاطع الفيديو ذات التعليقات التوضيحية، تعلم النظام إنشاء مقاطع فيديو عند إعطائه وصفاً قصيراً لمشهد ما، مثل «عالم مصنوع من الورق بشكل رائع للشعاب المرجانية، مملوء بالأسماك الملونة والمخلوقات البحرية».

استخدمت شركة «كوفارينت»، التي أسسها بيتر أبيل، الأستاذ في جامعة كاليفورنيا، بيركلي، وثلاثة من طلابه السابقين، بيتر تشين، وروكي دوان، وتيانهاو تشانغ، تقنيات مماثلة في بناء نظام يقود روبوتات المستودعات. وتساعد الشركة في تشغيل روبوتات الفرز في المستودعات في جميع أنحاء العالم.

وقد أمضت الشركة سنوات في جمع البيانات - من الكاميرات وأجهزة الاستشعار الأخرى - التي توضح كيفية عمل هذه الروبوتات. وقال تشين: «إنها تستوعب جميع أنواع البيانات التي تهم الروبوتات، التي يمكن أن تساعدهم على فهم العالم المادي والتفاعل معه».

روبوتات بفهم أوسع للمحيط

ومن خلال الجمع بين تلك البيانات والكميات الهائلة من النصوص المستخدمة لتدريب روبوتات الدردشة مثل ChatGPT، قامت الشركة ببناء تقنية الذكاء الاصطناعي التي تمنح الروبوتات الخاصة بها فهماً أوسع بكثير للعالم من حولها. وبعد تحديد الأنماط في هذا المزيج من الصور والبيانات الحسية والنصوص، تمنح التكنولوجيا الروبوت القدرة على التعامل مع المواقف غير المتوقعة في العالم المادي.

يعرف الروبوت كيفية التقاط الموز، حتى لو لم ير موزة من قبل. ويمكنه أيضاً الاستجابة للغة الإنجليزية البسيطة، تماماً مثل برنامج الدردشة الآلي. إذا أخبرته أن «يلتقط موزة»، فهو يعرف ماذا يعني ذلك. إذا طلبت منه «التقاط فاكهة صفراء»، فإنه يفهم ذلك أيضاً. ويمكنه أيضاً إنشاء مقاطع فيديو تتنبأ بما قد يحدث أثناء محاولته التقاط موزة.

وقال أبيل: «إذا كان بإمكانه (الروبوت) التنبؤ بالإطارات التالية في مقطع الفيديو، فيمكنه تحديد الاستراتيجية الصحيحة التي يجب اتباعها».

أخطاء وأخطار الروبوتات «التوليدية»

إلا أن التكنولوجيا، التي تسمى RFM، نسبة إلى تعبير «النموذج التأسيسي لعلم الروبوتات» robotics foundational model، ترتكب أخطاء، مثلما تفعل برامج الدردشة.

وعلى الرغم من أن الروبوت غالباً ما يفهم ما يطلبه الناس منه، فإن هناك دائماً احتمال ألا يفعل ذلك، فهو يسقط الأشياء من وقت لآخر. وقال غاري ماركوس، رجل أعمال في مجال الذكاء الاصطناعي وأستاذ فخري في علم النفس والعلوم العصبية في جامعة نيويورك، إن التكنولوجيا يمكن أن تكون مفيدة في المستودعات وغيرها من المواقف التي تكون فيها الأخطاء مقبولة. لكنه قال إن نشرها في المصانع وغيرها من المواقف التي يحتمل أن تكون خطرة سيكون أكثر صعوبة وأكثر خطورة. وأضاف: «إن الأمر يتعلق بتكلفة الخطأ، إذا كان لديك روبوت يزن 150 رطلاً (الرطل 453 غراماً) ويمكنه القيام بشيء ضار، فقد تكون التكلفة مرتفعة».

اختلاف روبوتات الحاضر والمستقبل

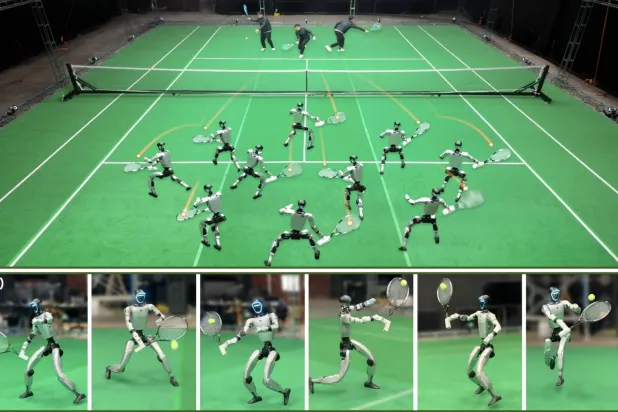

وبينما تقوم الشركات بتدريب هذا النوع من الأنظمة على مجموعات كبيرة ومتنوعة من البيانات، يعتقد الباحثون أنها ستتحسن بسرعة. وهذا يختلف تماماً عن الطريقة التي عملت بها الروبوتات في الماضي. ففي العادة، يقوم المهندسون ببرمجة الروبوتات لأداء الحركة الدقيقة نفسها مراراً وتكراراً، مثل التقاط صندوق بحجم معين أو تثبيت أداة في مكان معين على المصد الخلفي للسيارة. لكن الروبوتات لا تستطيع التعامل مع المواقف غير المتوقعة أو العشوائية.

لكن ومن خلال التعلم من البيانات الرقمية - مئات الآلاف من الأمثلة لما يحدث في العالم المادي - يمكن للروبوتات أن تبدأ في التعامل مع ما هو غير متوقع. وعندما تقترن هذه الأمثلة باللغة، يمكن للروبوتات أيضاً الاستجابة للاقتراحات النصية والصوتية، كما يفعل برنامج الدردشة. وهذا يعني أنه مثل برامج الدردشة ومولدات الصور، ستصبح الروبوتات أكثر ذكاءً. وقال تشين: «ما هو موجود في البيانات الرقمية يمكن أن ينتقل إلى العالم الحقيقي».

* خدمة «نيويورك تايمز»