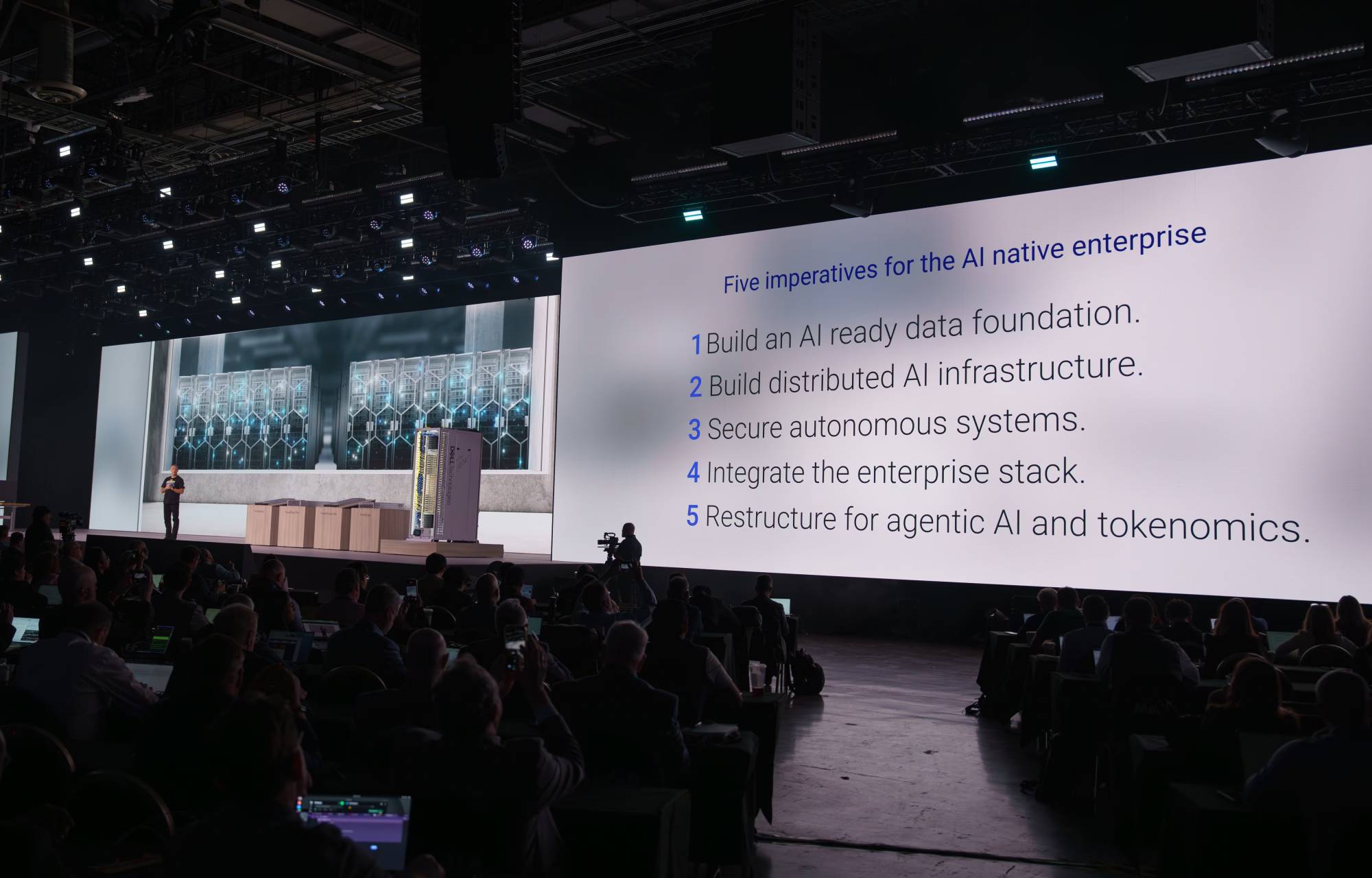

في الوقت الذي تُحدث فيه تقنيات الذكاء الاصطناعي ثورة في طريقة عملنا وتعلمنا وتواصلنا، تزداد وتيرة الاعتماد على نماذج اللغة الكبيرة (LLMs) والأدوات التوليدية، مثل «تشات جي بي تي» وأمثاله. هذه الأدوات توفر للمستخدمين راحة وكفاءة غير مسبوقتين، ولكن تأتي هذه الراحة على حساب الخصوصية أحياناً.

تقرير جديد صادر عن «إنكوغني» (Incogni) يلقي الضوء على كيفية تعامل أبرز منصات الذكاء الاصطناعي مع بيانات المستخدمين، كاشفاً عن فروق كبيرة في مدى احترام الخصوصية والشفافية.

بين الابتكار والانتهاك

مع تسارع انتشار أدوات الذكاء الاصطناعي، نادراً ما يسأل المستخدمون: من يرى ما أكتبه؟ وما مصير تلك البيانات؟ تعتمد هذه النماذج في تدريبها وتحسين أدائها على البيانات بما فيها ما يدخله المستخدمون بأنفسهم. لكن طريقة استخدام تلك البيانات تختلف بشكل كبير من منصة إلى أخرى.

قامت«إنكوغني» بتحليل تسع منصات رائدة باستخدام 11 معياراً متعلقاً بالخصوصية، لتقييم مدى التزامها بحماية معلومات المستخدمين.

منصات تجمع بين الأداء والخصوصية

1. Le Chat (Mistral AI)

جاءت هذه المنصة في المرتبة الأولى، بفضل جمعها المحدود للبيانات، وإتاحة خيار عدم مشاركة بيانات المستخدم مع النموذج. رغم أن الشفافية ليست مثالية، فإنها تُعدّ الأكثر احتراماً للخصوصية.

2. ChatGPT (OpenAI)

حلّت «ChatGPT» في المرتبة الثانية، بفضل سياسات واضحة تتيح للمستخدمين إلغاء مشاركة المحادثات مع النظام، إلى جانب توفير وثائق خصوصية سهلة الوصول والفهم.

3. Grok (xAI)

نموذج «غروك» من شركة «xAI» احتل المركز الثالث. وتبين أنه يتمتع بأداء جيد فيما يتعلق بالخصوصية، لكنه متأخر نسبياً في مجالات الشفافية ومشاركة البيانات.

كما جاءت نماذج «Claude» من شركة «Anthropic» في مرتبة قريبة، وإن كانت هناك بعض المخاوف حول كيفية تفاعلها مع بيانات المستخدم.

من جاء في قاع التصنيف؟

احتلت الشركات التقنية الكبرى المراتب الأدنى في التصنيف. جاءت «ميتا إيه آي» (Meta AI) في ذيل القائمة، تليها «جيمناي» (Gemini) من «غوغل» و«كوبايلوت» من «مايكروسوفت». وُجد أن هذه المنصات لا تتيح للمستخدمين خيار إلغاء استخدام محادثاتهم لأغراض التدريب. كما أنها تشارك البيانات داخلياً، وأحياناً مع جهات خارجية. وأيضاً تستخدم سياسات خصوصية عامة وغامضة لا تفصل كيفية تعاملها مع بيانات الذكاء الاصطناعي تحديداً.

المعايير المتبعة

اعتمدت «إنكوغني» في تصنيفها لمدى احترام منصات الذكاء الاصطناعي للخصوصية على ثلاث فئات رئيسة من المعايير، تشكل مجتمعة صورة شاملة لكيفية تعامل كل منصة مع بيانات المستخدم.

المعيار الأول يتمثل في استخدام بيانات التدريب، ويقيس ما إذا كانت المنصات تستخدم محادثات المستخدمين في تدريب نماذجها، وما إذا كان بإمكان المستخدم إلغاء هذا الاستخدام. أظهرت النتائج أن منصات مثل OpenAI وMicrosoft وMistral وxAI تتيح للمستخدمين خيار الانسحاب من عملية استخدام بياناتهم لأغراض التدريب، وهو ما يُعدُّ خطوة مهمة نحو تعزيز التحكم الشخصي. في المقابل، لا توفر منصات مثل Google وMeta وDeepSeek وPi AI هذا الخيار؛ ما يثير تساؤلات حول مدى التزامها بمنح المستخدمين حرية الاختيار. من جهة أخرى، تميزت نماذج «كلود» (Claude) التابعة لشركة «أنثروبيك» (Anthropic) بعدم استخدامها بيانات المستخدمين في التدريب على الإطلاق.

أما المعيار الثاني، فهو الشفافية، والذي يقيّم مدى وضوح المنصة في شرح سياساتها المتعلقة بجمع البيانات واستخدامها. في هذا المجال، حصلت OpenAI وAnthropic وMistral وxAI على أعلى التقييمات، بفضل وثائقها الواضحة وسهولة الوصول. في المقابل، جاءت «مايكروسوفت» و«ميتا» في مرتبة أقل نظراً لصعوبة الوصول إلى التفاصيل الدقيقة في وثائقهما، بينما لجأت «غوغل» و«ديب سيك» و«باي إيه آي» و«Pi AI» إلى دفن المعلومات المهمة داخل سياسات خصوصية مطوّلة يصعب على المستخدم العادي تتبعها أو فهمها.

أما الفئة الثالثة والأخيرة، فهي جمع البيانات ومشاركتها، حيث ركّز التقييم على نوعية البيانات التي تجمعها التطبيقات، وما إذا كانت تشارك هذه البيانات مع أطراف خارجية. برزت منصتا «Le Chat» و«Pi AI» أكثر الأدوات احتراماً لخصوصية المستخدم في هذا الجانب؛ إذ جمعتا الحد الأدنى من بيانات الهاتف المحمول. على النقيض، كشفت الدراسة عن أن «Meta AI» و«Gemini» و«Grok» تجمع كميات كبيرة من البيانات الحساسة مثل الموقع الجغرافي، الصور، وأرقام الهواتف، بل وتقوم أحياناً بمشاركتها مع جهات خارجية؛ وهو ما يشكل مصدر قلق حقيقي فيما يخص أمن المعلومات الشخصية.

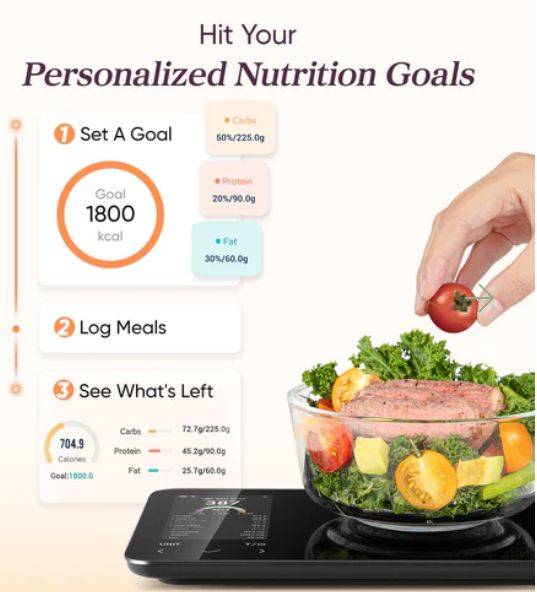

تطبيقات الهواتف المحمولة

نظراً لأن عدداً كبيراً من المستخدمين يتفاعلون مع أدوات الذكاء الاصطناعي من خلال تطبيقات الهواتف الذكية، شمل تقرير «إنكوغني» أيضاً تحليلاً دقيقاً لإصدارات «آي أو إس» (iOS) و«أندرويد» (Android) الخاصة بهذه المنصات؛ بهدف تقييم مستوى الأمان والخصوصية في بيئة الهاتف المحمول.

وقد أظهر التحليل تبايناً واضحاً في مستويات جمع البيانات بين التطبيقات. في المقدمة، جاء تطبيقا «Le Chat» و«Pi AI» أكثر التطبيقات التزاماً بالخصوصية، حيث اقتصر جمع البيانات فيهما على الحد الأدنى؛ ما جعلهما من بين الخيارات الأكثر أماناً للمستخدمين على الهاتف.

أما تطبيق «تشات جي بي تي» فصُنّف في فئة المخاطر المتوسطة؛ إذ يجمع بعض البيانات، لكنها لا تُقارن من حيث الكم أو النوع مع المنصات الأخرى الأقل احتراماً للخصوصية.

في المقابل، احتلت تطبيقات «Grok» و«Claude» و«Gemini» و«DeepSeek» مرتبة عالية في مستوى جمع البيانات، في حين جاءت «Meta AI» في ذيل القائمة بوصفها الأسوأ من حيث الخصوصية. فقد تبين أنها تجمع مجموعة كبيرة من البيانات الحساسة مثل الاسم والموقع الجغرافي والبريد الإلكتروني، بل وتقوم بمشاركة هذه المعلومات أحياناً مع أطراف خارجية؛ ما يُثير قلقاً كبيراً بشأن حماية معلومات المستخدمين الشخصية في بيئة الهاتف المحمول.

ما أهمية التصنيف؟

تبرز أهمية هذا التصنيف في كونه أكثر من مجرد ترتيب تقني؛ فهو يمثل أداة توعوية وتنظيمية في آنٍ واحد، تخدم المستخدمين وصناع القرار والشركات على حد سواء.

أولاً، على مستوى الأفراد، يسهم التصنيف في توعية المستخدمين؛ إذ يسلط الضوء على كيفية تعامل كل منصة مع البيانات الشخصية، وهو أمر لا يعرفه الكثير من المستخدمين عند استخدام أدوات الذكاء الاصطناعي. ومن خلال هذا التقييم، يصبح بإمكانهم اتخاذ قرارات مبنية على وعي ومعرفة، واختيار المنصات التي تحترم خصوصيتهم فعلياً.

ثانياً، يلعب التصنيف دوراً تحفيزياً في دفع المنصات نحو مزيد من الشفافية، حيث يشكّل الضغط المجتمعي أداة فعالة لإجبار الشركات على تحسين سياساتها وتقديم خيارات أكثر وضوحاً وتحكماً للمستخدم فيما يتعلق بالبيانات التي يتم جمعها أو استخدامها.

وأخيراً، يُعدّ هذا التصنيف مفيداً أيضاً على صعيد السياسات العامة؛ إذ يساهم في تمكين الجهات التنظيمية من خلال توفير بيانات موثوقة، ومبنية على تحليل دقيق؛ ما يساعد في صياغة تشريعات رقمية أكثر توازناً وحداثة تستجيب للتطورات المتسارعة في عالم الذكاء الاصطناعي.

الخيارات أمام المستخدم

أما بالنسبة للمستخدم، فإن التقرير يقدم مجموعة من الخيارات العملية التي يمكن اتخاذها لتعزيز الخصوصية الرقمية عند استخدام أدوات الذكاء الاصطناعي.

في البداية، يُنصح باختيار منصات مثل «Le Chat» و«ChatGPT» و«Grok»؛ كونها من الأدوات التي توفر مستوى جيداً من الشفافية وتتيح للمستخدمين التحكم الفعلي في كيفية استخدام بياناتهم، بما في ذلك إمكانية إلغاء مشاركة المحادثات في تدريب النماذج.

كما يُعدّ تعديل إعدادات الخصوصية خطوة ضرورية، حيث ينبغي على المستخدمين التأكد من تفعيل خيار الانسحاب من استخدام المحادثات في التدريب إن توفر، والاطلاع على خيارات مشاركة البيانات المتاحة في إعدادات الحساب.

أخيراً، وقبل تثبيت أي تطبيق ذكاء اصطناعي على الهاتف، من المهم مراجعة أذونات التطبيق بعناية خصوصاً تلك المتعلقة بجمع البيانات مثل الموقع الجغرافي أو جهات الاتصال أو الصور، ومعرفة ما إذا كانت تُشارك مع جهات خارجية؛ لضمان تقليل المخاطر على الخصوصية الشخصية إلى أدنى حد ممكن.

التوازن هو الحل

تستمر أدوات الذكاء الاصطناعي في دفع حدود الابتكار، ولكن كما أظهر «تصنيف خصوصية» عام 2025، ليست كل المنصات سواءً في احترام بياناتك. الدرس واضح: اختر أدوات تُصمم بخصوصيتك في الاعتبار، وادعم السياسات التي تحاسب المنصات، وساهم في بناء مستقبل رقمي لا يُضحّي بالحقوق من أجل الراحة.