بينما يبدأ الناخبون الأميركيون الإدلاء بأصواتهم في الانتخابات الرئاسية لعام 2024، تولي صناعة التكنولوجيا في أميركا اهتماماً كبيراً للنتائج المحتملة التي ستكون لها تأثيرات كبيرة على الذكاء الاصطناعي، وخصوصية البيانات، وتنظيمات مكافحة الاحتكار، والابتكار التقني بشكل عام. هذه القضايا أصبحت أكثر إلحاحاً مع استمرار نمو الاقتصاد الرقمي، ما يجعل من الضروري تقييم كيفية تأثير سياسات كل مرشح على مستقبل التكنولوجيا.

الذكاء الاصطناعي بين الابتكار والسلامة

يعدّ الذكاء الاصطناعي أحد القضايا التقنية الأكثر أهمية في هذه الانتخابات، حيث تتسارع وتيرة تطوير وتطبيق تكنولوجيا الذكاء الاصطناعي، وكذلك النقاشات حول تنظيمها، والمعايير الأخلاقية، والتنافسية العالمية.

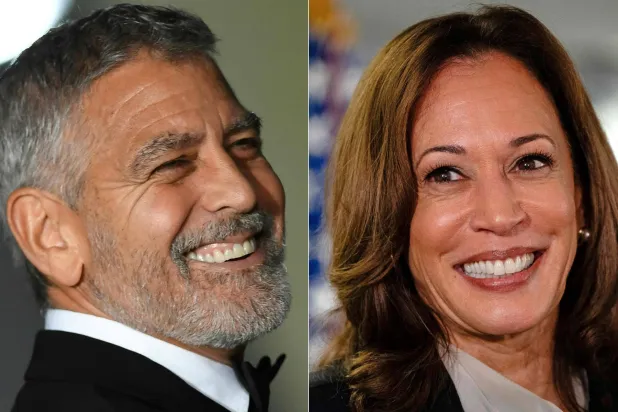

وقد أعربت المرشحة عن الحزب الديمقراطي كامالا هاريس عن التزام قوي بتطوير الذكاء الاصطناعي بشكل مسؤول، مركزةً على أهمية الالتزام بمعايير أخلاقية لتكنولوجيا الذكاء الاصطناعي. وقد أطلقت إدارة بايدن - هاريس تنظيمات جديدة للذكاء الاصطناعي في عام 2023، تهدف إلى معالجة قضايا مثل الشفافية الخوارزمية، والتحيزات المحتملة، ومعايير الأمان. وتهدف هذه التدابير إلى حماية المستهلكين ومنع الاستخدامات الضارة للذكاء الاصطناعي، ولكن بعض خبراء الصناعة يخشون أن تعيق هذه التدابير الابتكار. وترى هاريس أنه من دون الضوابط المناسبة، يمكن أن يؤدي الذكاء الاصطناعي إلى تفاقم عدم المساواة القائمة، وعواقب غير مقصودة، ما يعكس نهجاً حذراً لتكامل الذكاء الاصطناعي بشكل مسؤول مع مراعاة المخاوف الأخلاقية.

على النقيض من ذلك، يدعو مرشح الحزب الجمهوري دونالد ترمب إلى اتباع نهج أكثر حرية فيما يتعلق بتنظيم الذكاء الاصطناعي. ترمب يرى أن التنظيم الزائد يمكن أن يعرقل بقاء الولايات المتحدة في سباق الذكاء الاصطناعي العالمي، خاصة أمام دول مثل الصين التي تستثمر بشكل كبير في هذه التكنولوجيا مع قيود تنظيمية أقل. ومن المتوقع أن يركز ترمب، بالتعاون مع قادة التكنولوجيا مثل إيلون ماسك مالك شركة «إكس» على تخفيف الضوابط حول تطوير الذكاء الاصطناعي لدفع الابتكار بوتيرة أسرع. وقد يساهم هذا النهج في تحقيق تقدم تكنولوجي أسرع، لكن البعض يخشى أن يؤدي ذلك إلى تأثيرات اجتماعية غير متوقعة ويخلق تحديات فيما يتعلق بالشفافية والمساءلة في استخدام الذكاء الاصطناعي.

الاختلاف بين هاريس وترمب حول الذكاء الاصطناعي يعكس النقاشات الأوسع حول تحقيق توازن بين الابتكار والتنظيم، حيث تركز هاريس على ضرورة ضمان الأمان والاعتبارات الأخلاقية، بينما يركز ترمب على الميزة التنافسية مع حواجز تنظيمية أقل أمام قطاع التكنولوجيا.

خصوصية البيانات

بلا أدنى شك، أضحت خصوصية البيانات واحدة من أهم القضايا الملحة في مشهد التكنولوجيا، حيث ازداد الوعي بالطرق التي تتبعها الشركات لجمع وتخزين واستخدام البيانات الشخصية، ما يخلق طلباً متزايداً على قوانين شاملة لحماية خصوصية البيانات التي تضمن حقوق الأفراد وتدعم النمو الرقمي.

ولطالما كانت كامالا هاريس مناصرة قوية لحماية خصوصية البيانات، مستلهمةً من خلفيتها كمدعية عامة سابقة لولاية كاليفورنيا، حيث أشرفت على تنفيذ قانون خصوصية المستهلك في كاليفورنيا (CCPA) الذي يمكن لجميع سكان كاليفورنيا بموجبه ممارسة الحق في طلب جميع البيانات الخاصة بهم التي قامت الشركات بتخزينها. وتؤمن هاريس بأهمية وضع معايير فيدرالية لحماية البيانات، تدعم من خلالها تمكين الأفراد من السيطرة على بياناتهم، وتنظم كيفية جمع ومشاركة الشركات للمعلومات، وتعزز الشفافية. ويمكن أن توفر هذه التدابير ثقة أكبر للمستهلكين في الخدمات الرقمية، لكنها قد تفرض أيضاً أعباء امتثال إضافية على شركات التكنولوجيا، خاصة الشركات الصغيرة التي تملك موارد محدودة.

في مقابل ذلك، لم يحدد دونالد ترمب موقفاً واضحاً بشأن خصوصية البيانات. خلال فترة رئاسته السابقة، كانت إدارته تفضل تقليل الأعباء التنظيمية على الشركات، وامتد هذا النهج إلى تشريعات الخصوصية. ويركز ترمب بشكل عام على تعزيز النمو الاقتصادي، مشيراً إلى أن تقليل القوانين التنظيمية يسمح للشركات بالازدهار دون تدخل بيروقراطي. في حين أن هذا النهج قد يوفر مرونة لشركات التكنولوجيا، فإن النقاد يرون أنه يمكن أن يأتي على حساب حقوق خصوصية المستهلك وأمن البيانات.

وجهات النظر المتباينة بين المرشحَين حول خصوصية البيانات تؤكد على أهمية الانتخابات المقبلة في تحديد المستقبل الرقمي، حيث يمكن أن يؤدي موقف هاريس إلى مشهد أكثر تنظيماً يهدف إلى حماية بيانات المستهلك، بينما قد يركز نهج ترمب على مرونة الشركات، ما يترك حماية الخصوصية بشكل أكبر للشركات نفسها.

تنظيمات مكافحة الاحتكار

دور الشركات التكنولوجية الكبيرة في الاقتصاد هو موضوع آخر مثير للجدل في انتخابات 2024. هيمنة شركات مثل «أبل» و«غوغل» و«ميتا» و«أمازون» أدت إلى دعوات من كلا الحزبين لتشديد الرقابة المتعلقة بمكافحة الاحتكار واتخاذ إجراءات تهدف إلى تعزيز المنافسة العادلة. ويدرك كلا المرشحين التحديات التي تطرحها هذه الشركات القوية، لكنهما يقترحان حلولاً مختلفة.

أبدت كامالا هاريس دعماً مستمراً لنهج إدارة جو بايدن الصارم تجاه تطبيق قوانين مكافحة الاحتكار. وقد قامت الإدارة بملاحقة عدد من القضايا البارزة ضد شركات التكنولوجيا الكبرى، بهدف كبح الممارسات الاحتكارية، وزيادة المنافسة، وخلق ظروف سوق أكثر عدالة. كما يشمل برنامج هاريس التزاماً بتفكيك الاحتكارات التكنولوجية إذا لزم الأمر، مع التركيز على الحالات التي تتحكم فيها الشركات التكنولوجية الكبرى بشكل مفرط في الأسواق أو تعرقل الابتكار. ويشير نهج هاريس إلى استعدادها لاستخدام السلطة الفيدرالية لمساءلة الشركات الكبرى ومنع الممارسات غير التنافسية، بهدف تحقيق توازن بين مصالح المستهلكين والشركات الصغيرة.

دونالد ترمب كان أيضاً ناقداً للتكنولوجيا الكبيرة، لكن نهجه في تنفيذ قوانين مكافحة الاحتكار كان أقل تنظيماً. بينما عبّر ترمب عن استيائه من شركات التكنولوجيا الكبيرة، غالباً ما كانت دوافعه مدفوعة بخلافات شخصية، ولم تتبع إدارة ترمب نهجاً ثابتاً تجاه تنظيم الاحتكار. إذا فاز ترمب في الانتخابات، فمن المتوقع أن تتبنى إدارته نهجاً أقل تنظيماً بشكل عام، مع التركيز على تقليل التدخل الحكومي في الاقتصاد. قد يوفر هذا مزيداً من الحرية للشركات التكنولوجية الكبرى، لكنه قد يثير المخاوف بشأن قوة السوق غير المقيدة وقلة المنافسة.

الاستثمار في الاقتصاد المستقبلي

يعتمد مستقبل قطاع التكنولوجيا في الولايات المتحدة أيضاً على آراء كل مرشح حول تعزيز الابتكار. ويدرك كل من هاريس وترمب أهمية الاستثمار في التكنولوجيا من أجل النمو الاقتصادي، لكن لديهما رؤى مختلفة حول أفضل السبل لدعم الابتكار في عالم رقمي سريع التغير.

كامالا هاريس قدّمت نفسها كداعم لسياسات داعمة للتكنولوجيا، بما في ذلك المبادرات للاستثمار في وصول الإنترنت عريض النطاق، وصناعة أشباه الموصلات، والبنية التحتية الرقمية. ويعكس تركيزها على خلق بيئة تقنية تنافسية ومنظمة إيمانها بدور الحكومة في توجيه الابتكار المسؤول. وتدعو هاريس أيضاً إلى سياسات تشجع على تكوين قوة عمل تقنية متنوعة وشاملة، بهدف جعل الاقتصاد الرقمي متاحاً لجميع الأميركيين. ومع ذلك، فإن التزامها بالإجراءات التنظيمية، خاصة في مجالات مثل الذكاء الاصطناعي وخصوصية البيانات، دفع بعض قادة الصناعة إلى التساؤل عما إذا كانت سياساتها قد تؤدي إلى تباطؤ وتيرة التقدم التكنولوجي.

أما دونالد ترمب فيظهر دعماً لبيئة غير منظمة لتشجيع الابتكار، مع التركيز على الحوافز الاقتصادية وتقليل تدخل الحكومة. اختياره جيه دي فانس شريكاً مرشحاً له يدعم موقفه الذي يحظى بدعم شخصيات بارزة في وادي السيليكون الذين يفضلون الحد الأدنى من التنظيم، خاصة فيما يتعلق بالشركات الناشئة في مجال التكنولوجيا واستثمارات رأس المال الجريء. ومن المتوقع أن تركز سياسات ترمب على تقليل الحواجز أمام شركات التكنولوجيا الناشئة وخلق بيئة صديقة للأعمال مع قيود تنظيمية أقل. في حين أن هذا النهج قد يحفز النمو الاقتصادي، فإن النقاد يرون أنه يمكن أن يؤدي إلى نقص الرقابة، ما قد يضرّ بالمستهلكين أو يؤدي إلى ممارسات تجارية غير أخلاقية.

ومن خلال التركيز على التنظيم والاعتبارات الأخلاقية أو على إلغاء التنظيم والنمو الاقتصادي، يعكس كل مرشح نهجه في الابتكار الفجوة الآيديولوجية الأوسع حول كيفية تطوير قطاع التكنولوجيا في الولايات المتحدة.

محورية لمستقبل التكنولوجيا

يقدم المرشحان في الانتخابات الرئاسية الأميركية للناخبين رؤيتين متمايزتين لمستقبل سياسة التكنولوجيا. يتمحور نهج كامالا هاريس حول التنظيم المسؤول، وحماية المستهلك، والمعايير الأخلاقية، بهدف خلق قطاع تكنولوجي يركز على العدالة والمساءلة. على النقيض من ذلك، يركز نهج دونالد ترمب على إلغاء التنظيم والابتكار السريع، مع أولوية للنمو الاقتصادي والتنافسية الوطنية.

وكما يبدو، يمثل كل مسار فوائده ومساوئه المحتملة، حيث يمكن أن يؤدي نهج هاريس إلى صناعة تقنية أكثر أماناً وعدالة، لكنه قد يبطئ بعض أشكال الابتكار، بينما قد تسهم سياسات ترمب في تسريع التقدم التقني والنمو الاقتصادي، لكنها قد تثير المخاوف بشأن الخصوصية واحتكار السوق والممارسات الأخلاقية.