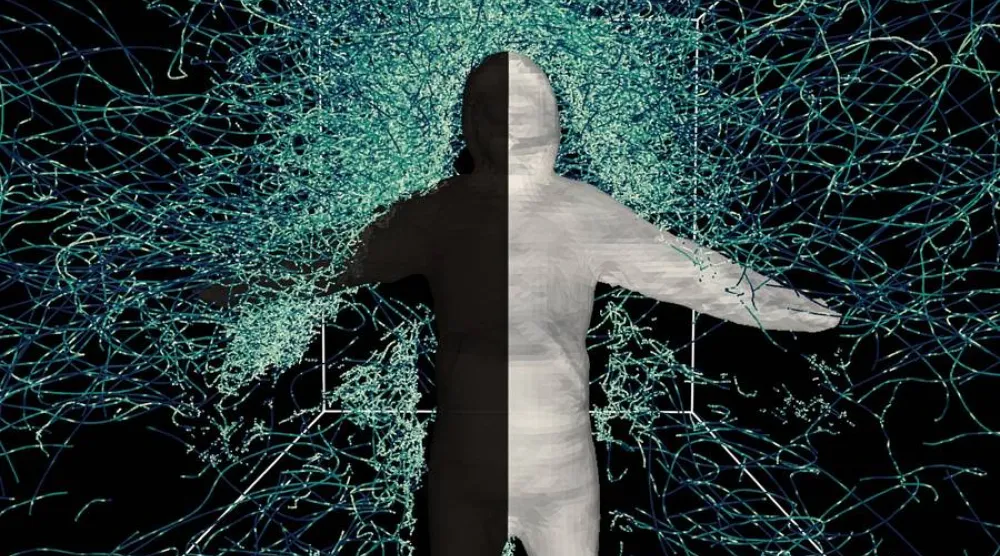

في الماضي، كان تزوير مقاطع الفيديو بشكل يجعلها تبدو واقعية، يتطلب كثيراً من الوقت والخبرات، ولكنّه اليوم لم يعد كذلك.

طوال عقود مضت، كانت مقاطع الفيديو المزيّفة والمقنعة تظهر في أفلام الخيال العلمي، كـ«حرب النجوم» فقط. ولكن بفضل تصاعد تطبيقات الذكاء الصناعي، أصبح تزوير مقاطع الفيديو أسهل من أي وقت مضى. وهو ما يعرِّض - برأي الباحثين - الأمن القومي لمخاطر جمّة.

رأى هاني فريد - وهو أستاذ محاضر بعلوم الكومبيوتر في جامعة «دارتموث كوليدج» - أنّه «وحتى وقت ليس ببعيد، كنّا نستطيع الوثوق بالتسجيلات الصوتية ومقاطع الفيديو، إلا أنّ التطور الذي شهدته تقنية التعلم الآلي، أتاح أدوات صناعة الفيديوهات والتسجيلات الصوتية المعقدة والمقنعة للجميع». وأضاف فريد في حديث نقلته «يو إس إي توداي» أنّ «معرفة كيفية استخدام هذه الفيديوهات المزيفة للتلاعب بالانتخابات، أو زرع الاضطرابات المدنية، أو حتى ارتكاب عمليات الاحتيال لا يتطلب مخيّلة واسعة».

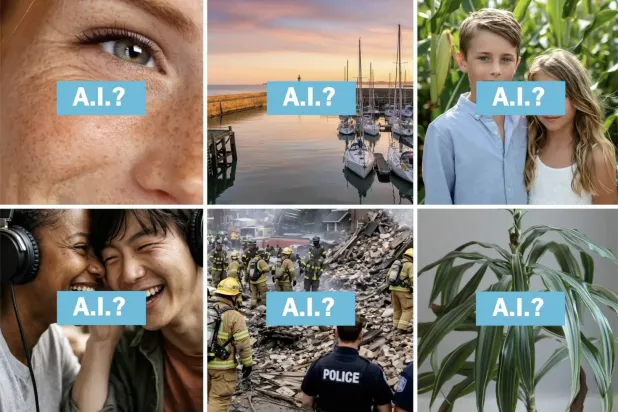

مع اقتراب انتخابات 2020 في الولايات المتحدة، والقلق المتنامي لدى وكالات الدفاع الأميركية من الفيديوهات المضللة للناخبين، يتسابق المشرعون والمؤسسات التعليمية نحو تطوير برامج رقمية قادرة على رصد وحظر ما يعرف بالـ«ديب فيكس» حتى قبل وصولها إلى الإنترنت.

التزييف العميق

في أواخر عام 2017، أخذت المخاوف من فكرة تزوير الفيديوهات تتصدر عناوين الصحف، عندما بدأ استخدام برامج الكومبيوتر لدس صور المشاهير في المواد الإباحية.

من أهمّ الأمثلة على هذا التلاعب كان تسجيلاً ابتكرته شركة الإنتاج التي يملكها المخرج جوردن بيلي في 2018، وفيه يظهر الرئيس السابق باراك أوباما وهو يحذّر الناس من تصديق كلّ ما يشاهدونه على الإنترنت.

ولكنّ الحقيقة هي أنّ المتكلّم لم يكن أوباما؛ بل بيلي نفسه، مستخدماً صوت أوباما.

ومنذ ذلك الحين، بدأت وزارة الدفاع في تطوير وسائل لرصد مقاطع الفيديو التي تدخل في فئة «ديب فيكس» (التزييف العميق) عبر وكالة مشروعات الأبحاث الدفاعية المتقدمة (داربا).

في مارس (آذار) الماضي، قال متحدّث باسم الوكالة، إنّ كثيراً من هذه الفيديوهات تتمّ صناعتها بهدف المرح، ولكنّ مقاطع أخرى تشكّل خطراً كبيراً، بسبب احتمال استخدامها لنشر البروباغندا والتضليل.

برامج مضادة

تسعى المنظمة اليوم إلى تطوير إشعارات وفلترات إلكترونية تمنع المحتوى المزيّف من الوجود على الإنترنت.

يشرح سيوي ليو - وهو باحث يعمل حالياً مع وزارة الدفاع على تطوير برنامج إلكتروني لرصد وتفادي انتشار المقاطع المعدّلة «ديب فيكس» - أنّ «صناعة فيديو مزيف بشكل عميق حقيقي ومقنع تتطلّب نحو 500 صورة ومقطع فيديو مدّته 10 ثوانٍ فقط»، محذّراً من أنّ «أي شخص ينشر صوراً على مواقع التواصل الاجتماعي، مثل «إنستغرام» معرّض للاستغلال في صناعة الـ«ديب فيكس».

يعمل البرنامج الأوّل الذي طوّره ليو وفريقه البحثي من جامعة ألباني العام الماضي، على رصد فيديوهات الـ«ديب فيكس» بغمضة عين، حرفياً، من خلال تحليل عدد المرّات التي تطرف فيها عينا الوجه الظاهر في المقطع، أو لا تطرف.

من جهته، قال ليو: «اكتشفنا أنّ عيني أبطال فيديوهات (ديب فيكس) لا تطرف كثيراً، وأحياناً لا تطرف أبداً. ومن ثمّ تساءلنا: لمَ لا يحصل هذا الأمر».

ووجد الباحثون أنّ البرنامج المستخدم لصناعة فيديوهات «ديب فيكس» يعتمد غالباً على الصور الموجودة على الإنترنت. ولفت ليو إلى أنّ صور المشاهير المنتشرة على الإنترنت التي يظهرون فيها مغمضي العينين ليست كثيرة، وبالتالي، فإنّ عيني الشخصيات الظاهرة في الفيديوهات المزيفة لن تطرف.

ومع مواجهة صناع الـ«ديب فيكس» لطريقة عمل البرنامج الجديد، طور الباحثون وسائل جديدة لرصد هذه الفيديوهات المعدلة، باستخدام خوارزميات ترصد حركات غير طبيعية بين الوجوه والرؤوس، بالإضافة إلى برنامج يحلّل غياب أصغر التفاصيل عن مقطع الفيديو.

وشرح ليو أنّ «البشرة في الوجوه المستخدمة في مقاطع (ديب فيكس) تكون غالباً أكثر نقاوة، وأنّ بعض التفاصيل المتعلّقة بالشعر والأسنان لا تكون موجودة. إذا نظرتم إلى الأسنان عن قرب، فسترون كتلة بيضاء واحدة، وليست أسناناً طبيعية منفصلة».

يعمل باحثون من جامعة واشنطن أيضاً على اختبار تقنيات الـ«ديب فيكس»، ونجحوا عام 2017 في التوصّل إلى وسيلة لتحويل المقاطع الصوتية إلى مقاطع فيديو، تتزامن فيها حركة شفاه الشخص الظاهر فيها مع الشخص الذي نطق بهذه الكلمات.

يشكّك ليو بقدرة فيديوهات الـ«ديب فيكس» على التسبب في حرب، ويستبعد احتمال تمتّعها بتأثير طويل الأمد على المجتمع، في ظلّ تنامي وعي الناس بهذه الظاهرة. كما رجّح تراجع حساسية الناس تجاه هذه المقاطع المعدّلة.

توليد الصوت والصورة

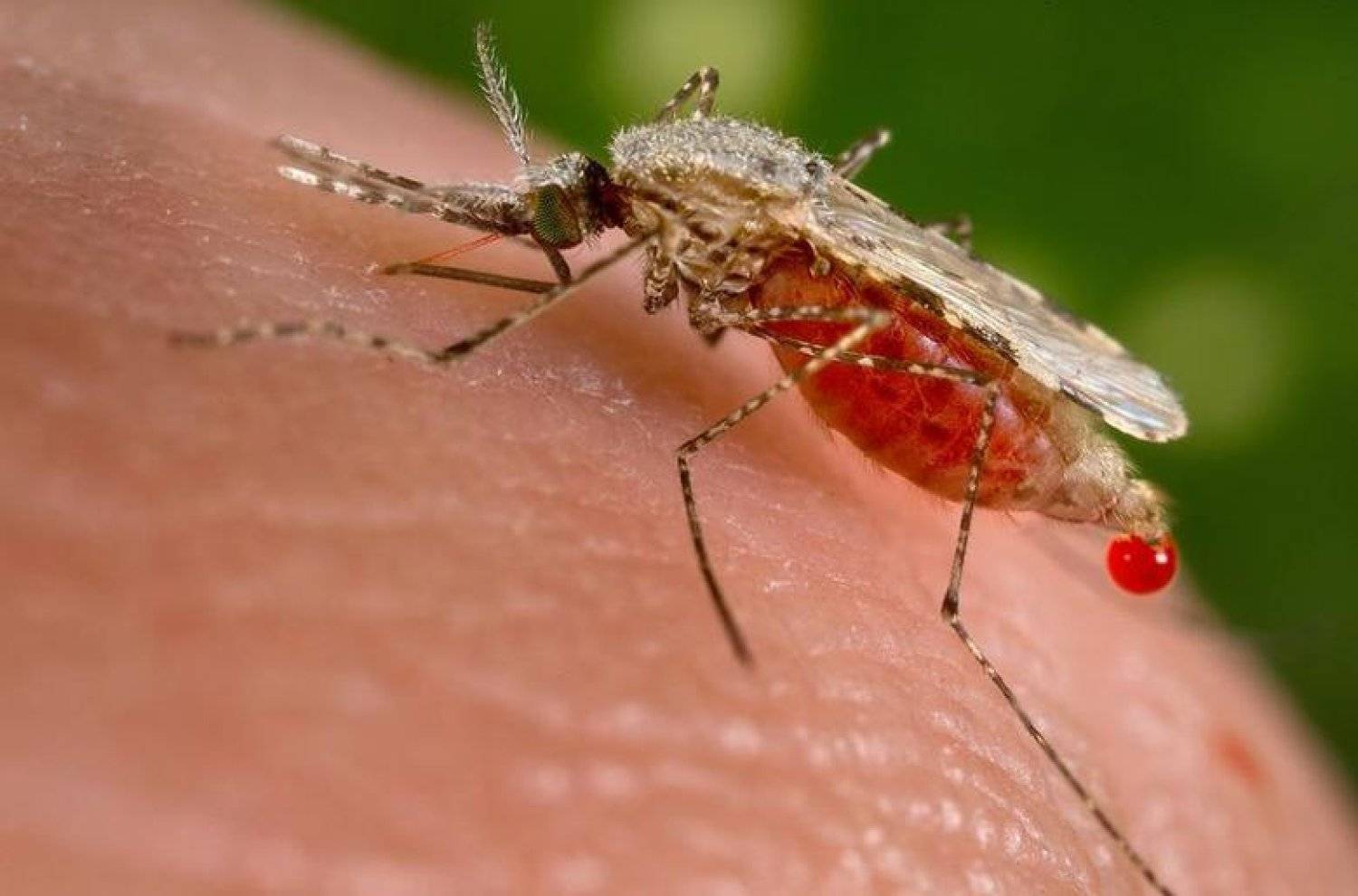

استخدمت تقنية تعديل الإدراك في أبريل (نيسان) لكسر الحواجز اللغوية، في حملة توعية عالمية حول «الملاريا»، بطلها لاعب الكرة البريطاني ديفيد بيكهام. وكانت منظمة «مالاريا نو مور» قد نشرت مقطع فيديو على «يوتيوب» يسلّط الضوء على كيفية استخدامها لتقنية «ديب فيكس» لمزامنة حركة شفتي ديفيد بيكهام بدقّة، مع أصوات عدّة أشخاص آخرين.

استخدمت الجمعية غير الربحية تقنية التعديل الصوتي والبصري، لإنتاج إعلان مصوّر مدّته 55 ثانية، يظهر بيكهام وهو يتكلّم بعدّة لغات. يبدأ خطابه باللغة الإنجليزية، ومن ثمّ ينتقل للكلام بثماني لغات أخرى، بواسطة الدبلجة. نعيش اليوم في عالم يتابع فيه ملايين الأشخاص الحقيقيين نوعين من المؤثرات المركبة اللذين يولدهما الكومبيوتر على مواقع التواصل الاجتماعي، ولكن دون أن يعوا ذلك، في الوقت الذي تعمل فيه الحكومات على تطوير مقدّمي أخبار متحرّكين أشبه بالبشر. تعتبر ليل ماكيلا، الفتاة الرقمية التي يتابعها 1.5 مليون شخص على «إنستغرام»، ويتفاعلون معها عبر الرسائل المباشرة، واحداً من أوضح الأمثلة على تعوّد البشر الحقيقيين على التعامل مع شخصيات مطوّرة يولدها الكومبيوتر. الحقيقة هي أنّ ليل ماكيلا ليست فتاة حالمة، ولا تحتفل في مهرجان «كوتشيلا» على الرغم من العبارات المرفقة بصورها؛ لأنّها مزيّفة. ولكنّ متابعيها لا يكترثون لزيفها؛ بل ويعجبون بصورها ويعلّقون عليها وكأنها شخص حقيقي. وكذلك أيضاً بدأ أشخاص تم تطويرهم عبر الذكاء الصناعي في الظهور على التلفزيون أيضاً. ففي عام 2018، شرعت وكالة الأنباء الصينية التابعة للحكومة، في اختبار مذيعي أخبار مدعومين بالذكاء الصناعي، في خطوة اعتبرت الأولى من نوعها في العالم.

للوهلة الأولى، يبدو مذيع الأخبار شخصاً عادياً بتعابير على وجهه، وحركات تتناسب مع صوته المتكلّم. ولكن بعد ثوانٍ من تشغيل مقطع الفيديو، ستعرفون أنه ليس حقيقياً. في مقدّمة مصوّرة، قال مذيع الأخبار الرقمي: «سأعمل دون كلل لإبقائكم على اطلاع بفضل النصوص التي ستتمّ طباعتها في نظامي دون توقف. إنّ التطوّر المستمرّ في عالم الإعلام يستدعي ابتكاراً متواصلاً واندماجاً عميقاً مع التقنيات العالمية المتقدّمة». وكانت الوكالة قد قدّمت مذيعتها المزيّفة الأولى في فبراير (شباط) الفائت، وبدت أكثر واقعية من المذيع الذي سبقها.

* خدمة «تريبيون ميديا»