هل تريد إجراء بحث أفضل عبر الإنترنت؟ استخدم الذكاء الاصطناعي بوصف أنه أمين مكتبة.

في الآونة الراهنة، أخذت مكتبات عامة عديدة وجامعات توظف «أمناء مكتبات للذكاء الاصطناعي»، لمعاونة الناس على استخدام أحدث التقنيات للبحث.

وبمشاهدة أمناء المكتبات وهم يعملون، فإن من الواضح أنهم يتعاملون مع الذكاء الاصطناعي بنفس الشك الصحي الذي قد يوجهه أي مشترٍ إلى حديث بائع سيارات مستعملة. وأمين المكتبة شخص يمكن الثقة به، والأهم أنه شخص يحقق، ويدقق. ويقول تريفور واتكنز، أمين مكتبة في جامعة جورج ميسون: «الإشباع الفوري للمعلومات، والذي أعرّفه بأنه الحاجة إلى قبول المعلومات من دون تدقيقها بصورة صارمة... أمر خطير».

ويقول جيفري أ. فاولر في «واشنطن بوست» إنه لجأ إلى مساعدة ثلاثة من أمناء المكتبات المحترفين في تقييم أدوات البحث بالذكاء الاصطناعي، من «تشات جي بي تي 5» ChatGPT 5 إلى برنامج «غوغل» للذكاء الاصطناعي Google’s AI، من خلال طرح مجموعة من الأسئلة الصعبة على الأدوات الذكية.

اختبارات لأفضل أنواع الذكاء الاصطناعي

وكان هدفنا العثور على نوع الذكاء الاصطناعي الذي يمكن أن يوفر علينا الوقت، وفي نفس الوقت لا يقدم إجابات خاطئة. وفيما يلي خمسة دروس عملية من اختباراتنا، ومحادثاتنا.

1. ابدأ بـ«نمط الذكاء الاصطناعي» في «غوغل» Google’s AI Mode -وليس «ملخصات الذكاء الاصطناعي» Google’s AI Overviews.

الفائز الذي اختاره أمناء المكتبات في اختبار البحث بالذكاء الاصطناعي ليس المحطة الأولى لمعظم الناس للبحث عبر الإنترنت. لكنه يجب أن يكون كذلك.

إن «نمط الذكاء الاصطناعي-AI Mode» هو نسخة هجينة من «غوغل» مع روبوت دردشة. يمكنك الوصول إليه بالنقر على الزر في الزاوية العلوية اليسرى من نتائج البحث.

تغلّب «نمط الذكاء الاصطناعي» على جميع أدوات الذكاء الاصطناعي التي اختبرناها (بما في ذلك «تشات جي بي تي 5») -وتفوق بصورة خاصة على «ملخصات (غوغل) بالذكاء الاصطناعي-Google’s AI Overviews»، التي تظهر افتراضياً في أعلى معظم نتائج البحث.

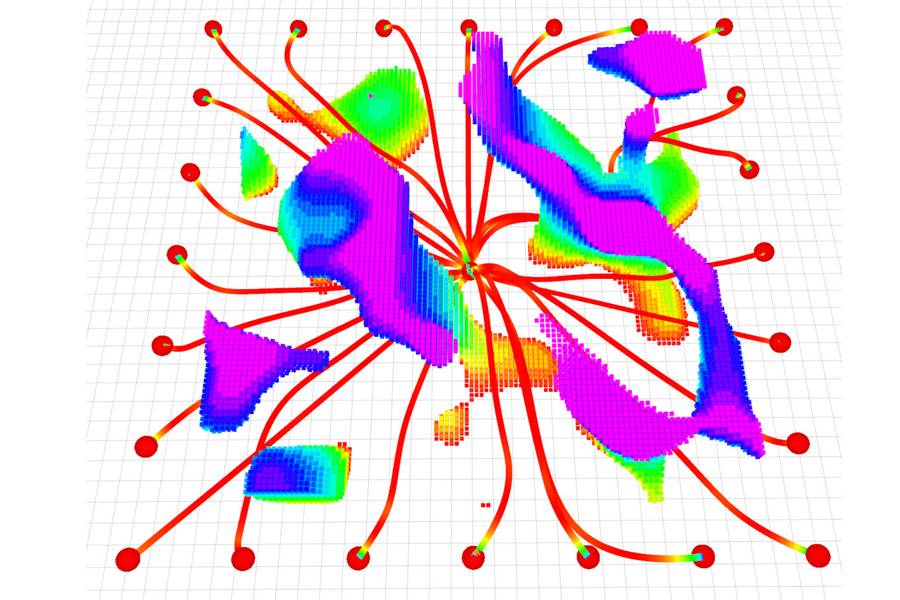

لماذا يُعد «نمط الذكاء الاصطناعي» أفضل؟ تقول «غوغل» إنها تستخدم «استدلال» الذكاء الاصطناعي لتحديد المواضيع الفرعية للبحث فيها، ثم تُجري عمليات بحث متعددة -ربما العشرات والعشرات- في نفس الوقت. وعلى عكس «ملخصات الذكاء الاصطناعي»، فإنه يمتلك أيضاً القدرة على الوصول إلى تحديثات تقنية أحدث لنموذج الذكاء الاصطناعي الخاص بـ«غوغل»، مما يساعده على تحليل وتلخيص ما يجده.

لا تزال هناك الكثير من الأسئلة التي تواجه «نمط الذكاء الاصطناعي» صعوبة في الإجابة عنها. ولكنه مفيد بصفة خاصة في البحث الذي يُشبه العثور على إبرة في كومة قش، حيث تكون قدرته على البحث السريع على نطاق واسع هي الأكثر فائدة.

2. كن محدداً جداً، وللغاية. أغلب أدوات الذكاء الاصطناعي ليست «ذكية» بما يكفي بعد لطرح أسئلة متابعة رئيسة. ويقول واتكنز إنها «واحدة من الأشياء الكثيرة التي تُميّز أمناء المكتبات عن جميع أدوات الذكاء الاصطناعي التوليدي». ولكن مع الذكاء الاصطناعي «الأمر متروك لك، بصفتك المستخدم، لإعادة صياغة سؤالك، وتوفير المزيد من السياق عند الحاجة».

يقول كريس ماركمان، أمين المكتبة لدى مكتبة مدينة بالو ألتو، إن قيام أمناء المكتبات بذلك يهدف إلى التعمق فيما تريد أن تسأله بالضبط، ولكن ربما لم تتمكن من صياغته بالكامل بعد. ويضيف: «في تسع حالات من أصل عشر، ما تبحث عنه يتجاوز السؤال الأولي بطبقتين، أو ربما ثلاث طبقات». ويستطرد قائلاً: «عندما أطرح أمراً، أحاول دمج عملية التفكير تلك في السؤال الأولي، مع الحفاظ على أكبر قدر ممكن من الإيجاز».

قد تُفيد إضافة أمثلة إلى سؤالك، وكذلك تحديد الفترة الزمنية للمصادر المحتملة. تقول شارزلي رودريغيز، أمينة مكتبة في جامعة ولاية سان خوسيه: «أحياناً نتكاسل للغاية عن تذكر منح نموذج الذكاء الاصطناعي دوراً، أو توفير سياق، أو قيود».

تقترح السيدة رودريغيز أنه يمكنك أيضاً أن تطلب من الذكاء الاصطناعي أن ينتقد نفسه، أو يعرض أمثلة متعددة، باستخدام عبارات مثل «ناقش وجهة النظر المعاكسة»، أو «حدد نقاط الضعف في تفكيرك»، أو «اذكر ما قد يكون مفقوداً»، أو «ما التحيزات التي قد تكون موجودة هنا».

محاذير ضعف الأدوات الذكية

3. احذر من نقاط الضعف في الذكاء الاصطناعي. في اختبارنا أظهرت جميع أدوات الذكاء الاصطناعي نقاط ضعف يجب أن تأخذها في اعتبارك. وشملت هذه النقاط الأسئلة المتعلقة بما يلي:

• الأحداث الأخيرة: عملية إنشاء نموذج ذكاء اصطناعي تستغرق وقتاً طويلاً، لذا فإن معرفته المضمنة داخله تكون مجمدة في وقت معين. على سبيل المثال، من دون البحث على الويب، لا يعرف «تشات جي بي تي 5» أي شيء بعد 30 سبتمبر (أيلول) 2024. إذا كنت بحاجة إلى السؤال عن شيء أكثر حداثة، تأكد من توجيه الذكاء الاصطناعي صراحة بالبحث عن معلومات محدثة.

• العناصر المرئية: لا يزال الذكاء الاصطناعي أفضل بكثير في التعامل مع النصوص عنه مع الصور، ويمكن أن يصاب بالارتباك الشديد عندما تطلب منه الإجابة عن أسئلة تتضمن تحليل الصور.

• المصادر المتخصصة: بسبب اتفاقيات النشر، قد يكون وصول الذكاء الاصطناعي إلى المحتوى الأكاديمي والإخباري وغيره من المحتوى الإعلامي محدوداً. تقول السيدة رودريغيز: «غالبية الأبحاث العلمية لا تزال غير (مفتوحة)، أو قابلة للعثور عليها، أو الوصول إليها، حتى على محركات البحث». وهذا يعني أنه بالنسبة لبعض الأسئلة قد يكون من الأفضل حقاً أن تسأل أمين مكتبة بشرياً لديه إمكانية الوصول إلى قواعد البيانات، والمصادر المدفوعة.

4. تحقق من مراجع (استشهادات) الإجابات (بجدية). في اختباراتنا كانت أدوات الذكاء الاصطناعي أحياناً تقدم إجابة كاملة مع روابط للمصادر. لكن قد يتضح أن الإجابة لا تزال خاطئة في النهاية. تقول السيدة رودريغيز: «من السهل للغاية الوقوع في هذا الفخ عندما تبدو الإجابات جازمة، وموثوقاً بها للغاية». لذا، سوف تظل بحاجة إلى النقر على المصادر للوقوف على ما تقوله. أو حتى إذا ما كانت حقيقية.

وإذا كان الرابط يؤكد الإجابة من الذكاء الاصطناعي، فهل يمكنك حقاً الوثوق بالمصدر الذي خرجت منه؟ تقول السيدة رودريغيز: «انقر للوصول إلى المصادر، وتحقق من المؤلف، وانظر إلى الجهة التي تقف وراءها، ودوّن تاريخ النشر». تواجه أدوات الذكاء الاصطناعي صعوبة في الحكم على موثوقية المصادر، لذا يمكنها أن تُظهر مدونات، أو أخباراً ذات جودة منخفضة، أو محتوى غير مهم لتحسين محركات البحث «SEO» بدلاً من المصادر الموثوقة التي خضعت لمراجعة الأقران.

إحدى علامات الخطر هي عندما يستمد الذكاء الاصطناعي إجابته من منصة الرسائل المجتمعية «ريديت-Reddit»، أو شبكة اجتماعية مثل «إكس» (تويتر سابقاً). ربما لا يوجد خطأ في آراء الناس، لكن هذه آراء، وليست حقائق.

5. اطرح نفس السؤال مرتين (أو ثلاث مرات). إذا كان لديك وقت إضافي، فافتح بضع علامات تبويب إضافية في المتصفح، واطرح نفس السؤال على أدوات ذكاء اصطناعي مختلفة. قد تفاجأ بمدى اختلاف الإجابات -أو يسعدك الأمر عندما لا تختلف.

يقول ماركمان إنك ستكون في وضع أفضل بكثير إذا كان لديك على الأقل بعض المعرفة بالموضوع الذي تستكشفه عندما تحاول معرفة ما إذا كان يمكنك الوثوق بإجابة الذكاء الاصطناعي من عدمه. ويضيف: «لا تحتاج إلى معرفة كل شيء عن موضوع ما، ولكن يجب أن تعرف ما يكفي لتكتشف الخطأ، وتتجاوزه، بدلاً من المضي في مطاردات مضيعة للوقت مع المعلومات الخاطئة».

وعندما يساورك الشك «اطلب المساعدة من أمناء المكتبات»، كما يقول واتكنز... «تقدم العديد من المكتبات العامة وبعض المكتبات الأكاديمية خدمة تسمى المرجع الافتراضي، حيث يمكن للمستخدمين طرح أسئلة على محترفي المكتبات (وليس روبوتات الدردشة) عبر الإنترنت».