بالتأكيد سمعت عن الروبوتات القاتلة، أو الإنسان الآلي القاتل في الروايات أو الأفلام، أو ما يطلق عليه رسمياً «الأسلحة الفتاكة ذاتية التشغيل».

فكرة وجود سلاح ذكي للغاية ويقتل بعشوائية ما زالت في عداد الخيال العلمي، لكن الأسلحة التي تعتمد على الذكاء الاصطناعي أصبحت معقدة للغاية، وتتسبب في نمو الشعور بالقلق والخوف لدى البعض من عدم القدرة على محاسبة المخطئين، وإمكانية وقوع أخطاء تقنية.

لقد شاهدنا بالفعل الذكاء الاصطناعي، الذي كان من المفترض أن يكون حيادياً، ينتج خوارزميات متحيزة ضد جنس بعينه، أو ينتج أنظمة مراقبة محتوى قليلة الكفاءة، وذلك وفقاً لما نشره موقع «ذا كونفرزيشن»، بسبب أن صناع أنظمة الذكاء الاصطناعي تلك لم يفهموا جيداً التكنولوجيا التي بين أيديهم. لكن في وقت الحروب، هذه الأخطاء قد تتسبب في مقتل مدنيين أو إفساد المفاوضات بين الجانبين.

على سبيل المثال، لو تم تدريب خوارزميات التعرف على الأهداف عن طريق صور من الأقمار الاصطناعية تظهر دبابات وحولها جنود، قد يخطئ الذكاء الاصطناعي، ويعد سيارة مدنية تمر عبر حاجز عسكري هدفاً مثل دبابة وحولها جنود.

ما هي الأسلحة الفتاكة الذاتية التشغيل؟

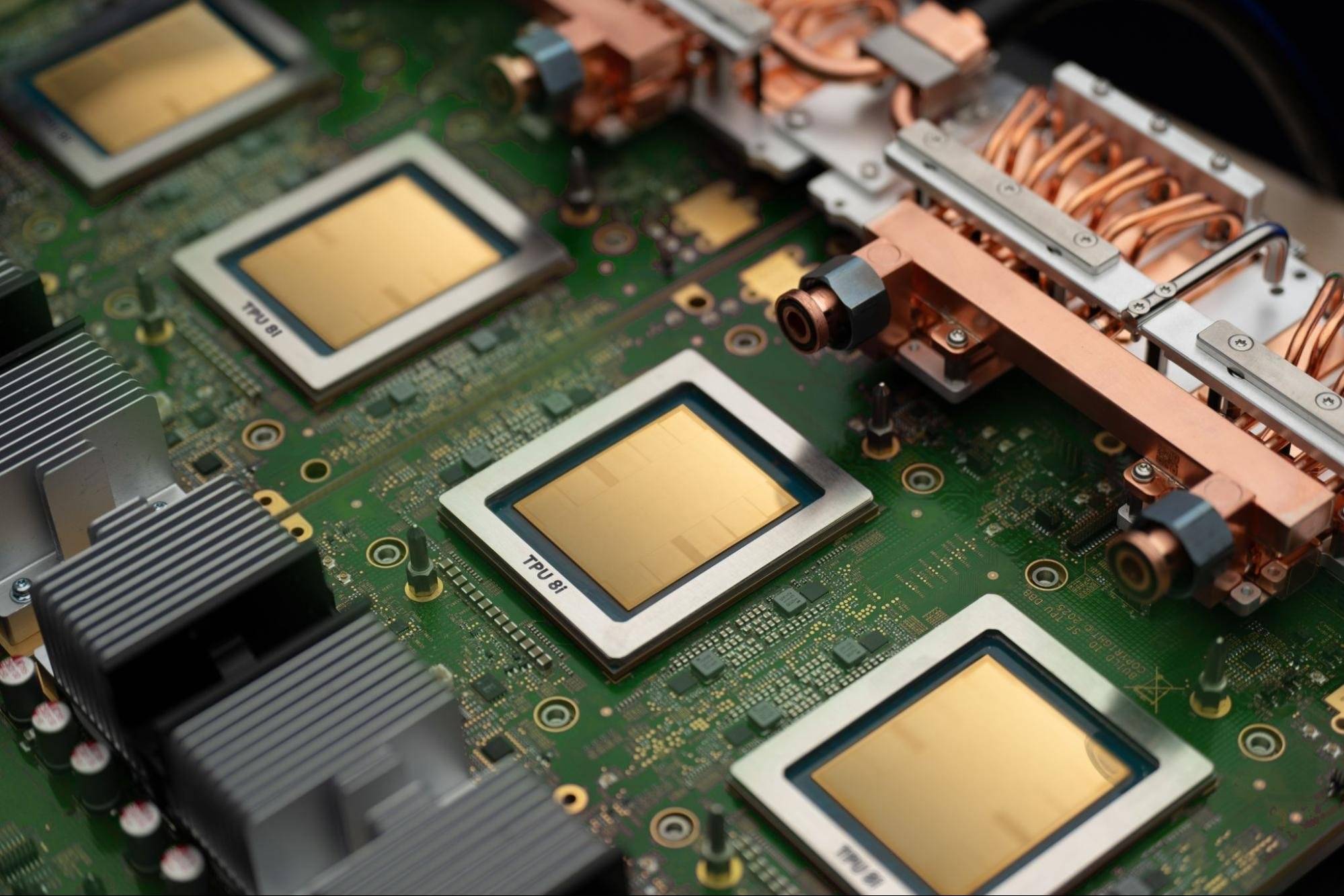

تعرف وزارة الدفاع الأميركية الأسلحة الفتاكة ذاتية التشغيل بأنها «نظم أسلحة بمجرد تشغيلها يمكنها تحديد الأهداف والاشتباك معها بدون تدخل إنسان أو مُشغل بشري».

وينطبق هذا التعريف على العديد من نظم القتال، فأنظمة الحاسب الآلي على متن الطائرات المسيرة، وبعض الصواريخ الحديثة لديها خوارزميات تمكنها من تحديد الأهداف وإطلاق النار عليها بدقة أكبر من مشغلها البشري.

ونظام القبة الحديدية الإسرائيلي هو واحد من تلك الأنظمة الذي يمكنه الاشتباك مع الأهداف دون إشراف بشري.

ورغم أنها مصممة للحماية من الصواريخ، فإن أنظمة القبة الحديدية يمكنها قتل أشخاص بالخطأ. لكن هذه المخاطرة مقبولة لدى المجتمع السياسي الدولي، لأن القبة الحديدية يعتمد عليها في إنقاذ أرواح المدنيين.

الأسلحة التي تعتمد على الذكاء الاصطناعي موجودة بالفعل، مثل روبوتات الحراسة، والمسيرات الانتحارية المستخدمة في حرب أوكرانيا. إذا كنا نسعى للسيطرة على استخدام الأسلحة الفتاكة ذاتية التشغيل فيجب أن نفهم تاريخ الأسلحة الحديثة.

قواعد الحرب

إبرام اتفاقات دولية، مثل معاهدة جنيف، لتنظيم التعامل مع أسرى الحرب أو المدنيين أثناء الصراع كان واحدة من الأدوات لمحاولة السيطرة على كيفية خوض الحروب.

لكن للأسف، استخدام الولايات المتحدة لأسلحة كيماوية في فيتنام، أو استخدام روسيا لها في أفغانستان، دليل على أن هذه الإجراءات غير كافية.

في عام 1997 تضمنت معاهدة أوتاوا منعاً لاستخدام الألغام الأرضية والقنابل العنقودية، ووقعت عليها 122 دولة، لكن الولايات المتحدة وروسيا والصين لم توقع.

وتتسبب الألغام الأرضية في جرح وقتل نحو 5 آلاف جندي ومدني سنوياً منذ عام 2015، وفي 2017 وصل العدد إلى 9440 شخصاً.

ويذكر تقرير الألغام الأرضية والقنابل العنقودية لعام 2022 أن «الخسائر في ارتفاع آخر 7 سنوات بعد عقد كامل من تراجع أعداد الضحايا، وهذا الارتفاع نتيجة زيادة الصراعات واستخدام الألغام المرتجلة منذ عام 2015، ويمثل المدنيون معظم الضحايا ونصفهم من الأطفال».

وهناك أدلة على أن روسيا وأوكرانيا (وهي موقعة على معاهدة أوتاوا) تستخدمان الألغام الأرضية، بالإضافة إلى أن أوكرانيا تعتمد على الطائرات المسيرة لتوجيه ضربات المدفعية وتستخدمها في الهجمات الانتحارية على البنية التحتية الروسية.

رغم الاعتراضات، يظل منع الأسلحة الفتاكة ذاتية التشغيل غير واقعي لسببين: الأول، أن هذه الأسلحة أصبحت واقعاً بالفعل مثل الألغام. الثاني أن الفرق بين الأسلحة الفتاكة ذاتية التشغيل والروبوتات القاتلة ضبابي ما يصعب عملية التفرقة بينهما. والقادة العسكريون سيجدون طرقاً للالتفاف حول المنع، وتصنيف الروبوتات القاتلة أسلحة دفاعية آلية وإدخالها إلى الخدمة.

في المستقبل سنرى استخدام المزيد من أنظمة الأسلحة المعتمدة على الذكاء الاصطناعي، لكن هذا لا يعني أننا يجب أن نغض الطرف عنها، فهناك قيود دقيقة ستساهم في محاسبة السياسيين وعلماء البيانات والمهندسين. على سبيل المثال يجب منع مفهوم الصندوق الأسود في الذكاء الاصطناعي، وهو يشير إلى نظام لا يستطيع المستخدم رؤية المدخلات والمخرجات فيه.

وأنظمة الذكاء الاصطناعي غير الموثوق بها، هي الأنظمة التي لم تختبر جيداً قبل تشغيلها.