سعت «غوغل كلاود» في مؤتمرها السنوي «Google Cloud Next 2026» الذي حضره أكثر من 30 ألف مشارك، الأربعاء، في مدينة لاس فيغاس الأميركية، إلى تقديم صورة أوسع من مجرد سلسلة إعلانات تقنية جديدة. فمنذ اليوم الأول، بدا أن الشركة تريد وضع الحدث في إطار تحول أكبر في الذكاء الاصطناعي المؤسسي، عنوانه الانتقال من مرحلة الاستخدام التجريبي إلى مرحلة التشغيل الواسع داخل المؤسسات. هذا التحول صاغته «غوغل» تحت مفهوم «المؤسسة الوكيلة»، أي مؤسسة لا يقتصر فيها الذكاء الاصطناعي على المساعدة أو التلخيص، بل يمتد إلى بناء الوكلاء وتشغيلهم وربطهم بالبيانات والأنظمة وسير العمل اليومي.

حاول توماس كوريان الرئيس التنفيذي لـ«غوغل كلاود» أن يضع هذا الاتجاه في صياغة واضحة، مقدماً الكلمة الافتتاحية بوصفها «خريطة طريق للمؤسسة الوكيلة». وفي المعنى الذي خرج به اليوم الأول، فإن الرسالة لم تكن أن الذكاء الاصطناعي يدخل الشركات بوصفه أداة إضافية، بل إنه يدفعها نحو نموذج تشغيلي جديد، تصبح فيه البنية التحتية والبيانات والحوكمة والأمن وتطبيقات العمل أجزاء مترابطة في طبقة واحدة أكثر اعتماداً على الوكلاء. كما سعى الحدث إلى دعم هذا الطرح بأرقام تعكس الزخم الذي تريد الشركة إبرازه، قائلة إن نحو 75 في المائة من عملاء «غوغل كلاود» يستخدمون منتجاتها للذكاء الاصطناعي، وإن نماذجها الأساسية تعالج أكثر من 16 مليار رمز في الدقيقة عبر الاستخدام المباشر من العملاء.

ركائز التحول المؤسسي

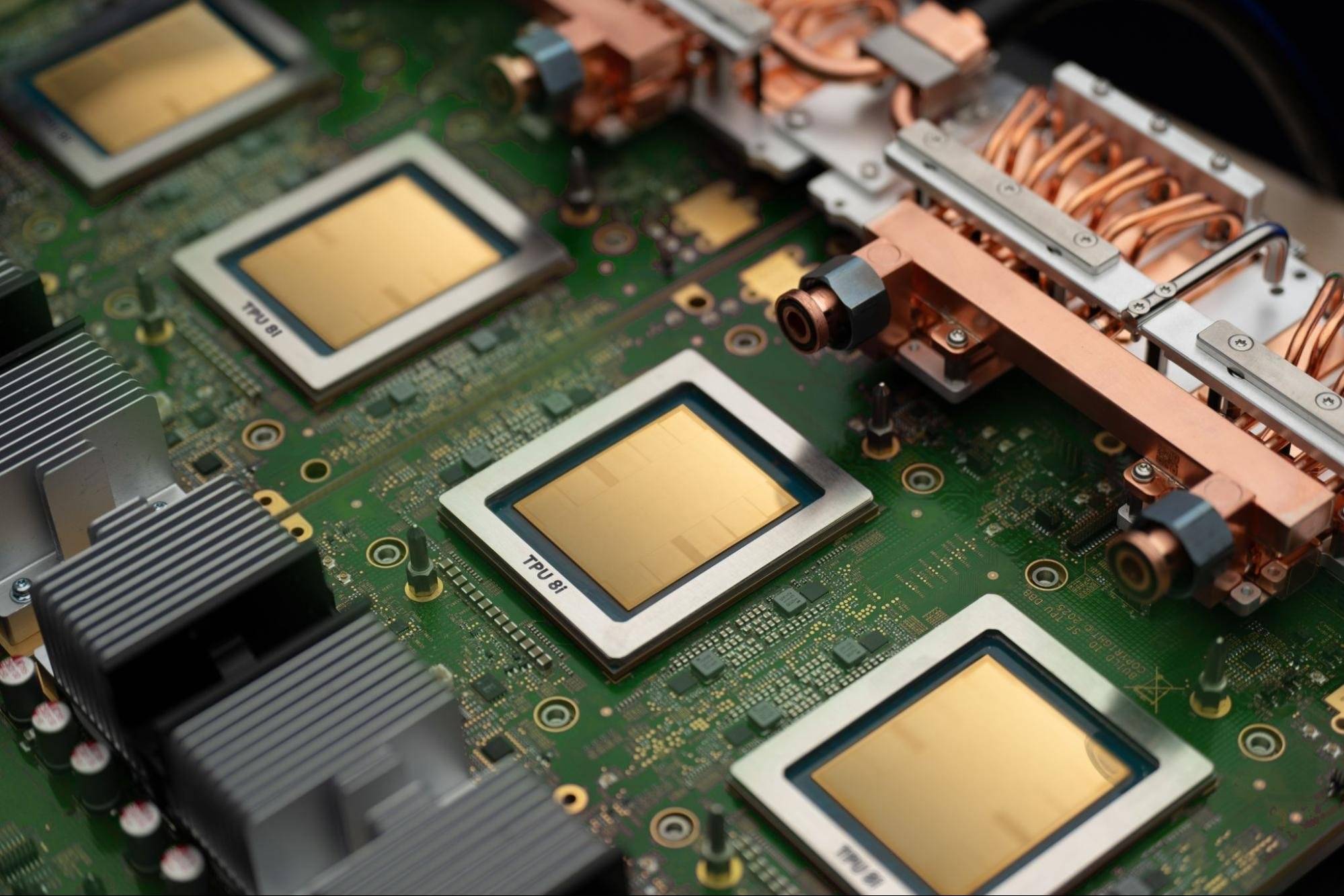

على مستوى الإعلانات نفسها، كان المشهد موزعاً على 4 ركائز رئيسية. الأولى كانت «Gemini Enterprise Agent Platform» التي قدمتها «غوغل» بوصفها منصة لبناء الوكلاء الذكيين وتوسيعهم وحوكمتهم ومراقبتهم داخل المؤسسات. والثانية كانت البنية التحتية، مع الإعلان عن الجيل الثامن من وحدات «TPU» إلى جانب ما تصفه الشركة بمعمارية «AI Hypercomputer». أمّا الركيزة الثالثة فكانت «Agentic Data Cloud» التي تعكس محاولة لإعادة صياغة علاقة الذكاء الاصطناعي ببيانات المؤسسات. وجاءت الرابعة عبر «Agentic Defense» الذي يربط بين الذكاء الاصطناعي والأمن السيبراني وحماية التطبيقات والبيئات السحابية. كما أضافت الشركة طبقة رابعة موازية على مستوى الاستخدام اليومي، عبر توسيع دور «Gemini Enterprise» داخل بيئات العمل، وتقديم «Workspace Intelligence» بوصفها طبقة دلالية تربط بين أدوات مثل «جيميل» و«دوكس» و«درايف» و«ميت» و«شات». وباختصار، فإن الحدث لم يُبنَ حول إعلان نموذج جديد فقط، بل حول حزمة تقول إن المرحلة التالية من الذكاء الاصطناعي ستكون معركة تشغيل مؤسسي متكامل.

جاهزية الخليج للذكاء المؤسسي

ما يمنح هذا الطرح وزناً أكبر بالنسبة إلى الخليج هو أن المنطقة نفسها باتت معنية بهذه المرحلة من تطور الذكاء الاصطناعي. فالنقاش هنا لم يعد يقتصر على أهمية الذكاء الاصطناعي أو الرغبة في استخدامه، بل يتجه بصورة متزايدة إلى كيفية تشغيله على نطاق أوسع داخل القطاعات الحساسة والمنظمة، مثل التمويل والاتصالات والرعاية الصحية والطاقة والخدمات اللوجستية والقطاع الحكومي. ومن هذه الزاوية، فإن ما قُدم في «نيكست 2026» لا يبدو مجرد إعلانات حدث سنوي، بل يعكس تحولاً أوسع في السوق من التركيز على الوصول إلى النماذج إلى التركيز على الجاهزية المؤسسية لتشغيلها.

وبالنسبة إلى السعودية تحديداً، فإن هذا يبرز اتجاهاً نحو نقاش أكثر ارتباطاً بالجوانب التشغيلية والتطبيقية. فالمسألة لم تعد مرتبطة فقط بالبنية الحاسوبية أو الشراكات أو إدخال أدوات الذكاء الاصطناعي إلى بعض الوظائف، بل أيضاً بكيفية دمج هذه التقنيات داخل الأنظمة والعمليات المؤسسية بصورة فعالة ومنظمة. ويشمل ذلك استخدام الذكاء الاصطناعي في بيئات خاضعة للامتثال، وتوظيفه في عمليات الشبكات والخدمات، والاستفادة من الوكلاء داخل المؤسسات مع الحفاظ على المتابعة والتدقيق والضبط المؤسسي.

حوكمة البنية الذكية

عندما تتحدث «غوغل» عن منصة لإدارة الوكلاء، أو عن هوية الوكيل، أو عن بوابة للتحكم في تفاعلاته، أو عن أدوات للمراقبة، فإن هذه ليست مجرد تفاصيل تقنية داخل منتج جديد، بل تعكس اتجاهاً أوسع في السوق نحو تشغيل الذكاء الاصطناعي داخل المؤسسات ضمن أطر واضحة وقابلة للمراجعة. وهذه نقطة مهمة لأن إحدى الرسائل الأكثر دلالة في الحدث الذي حضرته «الشرق الأوسط» كانت أن النقاش لم يعد يتمحور فقط حول القدرة على بناء وكيل ذكي، بل حول كيفية إدارة أعداد كبيرة منهم داخل المؤسسة الواحدة. وبالنسبة إلى السعودية والخليج، فإن هذا يبرز أهمية طبقات الحوكمة والمراقبة والهوية، خصوصاً مع توسع استخدام الذكاء الاصطناعي في القطاعات الحساسة.

والأمر نفسه ينطبق على البنية التحتية. فإعلانات مثل «TPU 8t» و«TPU 8i» و«AI Hypercomputer» لا تكتسب أهميتها فقط من سباق الرقائق أو من التنافس بين مزودي الحوسبة السحابية، بل أيضاً من دلالتها على أن المرحلة المقبلة من الذكاء الاصطناعي ستعتمد على بنية تحتية تدعم التدريب والاستدلال المستمر واسع النطاق. ومن هذه الزاوية، يبرز التركيز على كيفية توظيف هذه البنية في تطبيقات مؤسسية عملية عبر قطاعات متعددة.

البيانات في الصدارة

ثم تأتي البيانات، وهي من العناصر الأساسية في المرحلة المقبلة. فطرح «Agentic Data Cloud» يعكس اتجاهاً متزايداً نحو تعزيز جاهزية البيانات وربطها بشكل أفضل داخل المؤسسات. وبالنسبة إلى السعودية، فإن هذه النقطة تكتسب أهمية خاصة مع تسارع التحول الرقمي في ظل «رؤية 2030» واتساع الحاجة إلى بيئات بيانات أكثر ترابطاً، بما يتيح للذكاء الاصطناعي العمل بسياق أعمال أدق وأكثر فاعلية.

وفي هذا السياق، لا تبدو طبقة الاستخدام اليومي التي تحدثت عنها «غوغل» أقل أهمية من طبقات الرقائق أو المنصات. فعندما توسع الشركة دور «Gemini Enterprise» داخل بيئة العمل، وتقدم «Workspace Intelligence» كطبقة سياقية موحدة عبر البريد والمستندات والاجتماعات والمحادثات والملفات، فهي لا تضيف مزايا إنتاجية فقط، بل ترسم تصوراً لبيئة يصبح فيها الذكاء الاصطناعي أقرب إلى جزء من التدفق اليومي للعمل، لا أداة منفصلة على الهامش. وهذه النقطة تهم المنطقة أيضاً، لأن نجاح الذكاء الاصطناعي في المؤسسات لن يُقاس فقط بما إذا كانت الإدارات التقنية قادرة على بنائه، بل بما إذا كان يمكن دمجه في العمل الفعلي للموظفين والفرق من دون زيادة التعقيد أو خلق طبقات تشغيلية منفصلة.

الأمن في الصميم

أما الأمن، فكان واحداً من أكثر المحاور التي كشفت أن السوق دخلت مرحلة أكثر واقعية. فعبر «Agentic Defense»، سعت «غوغل» إلى ربط الذكاء الاصطناعي مباشرة بالأمن السيبراني، ليس باعتباره طبقة منفصلة، بل جزءاً من المعمارية نفسها. هذه النقطة لها أهمية واضحة في المنطقة، لأن توسع الذكاء الاصطناعي داخل المؤسسات في قطاعات مثل الطاقة والاتصالات والقطاع المالي لا يمكن فصله عن سؤال الثقة والاستمرارية والقدرة على احتواء المخاطر. وكلما توسعت المؤسسات في استخدام الوكلاء وربطتهم ببياناتها وأنظمتها، أصبح الأمن جزءاً من الذكاء الاصطناعي ذاته، لا مجرد إضافة لاحقة إليه.

ومن بين الرسائل المهمة أيضاً في الحدث أن «غوغل» حاولت الجمع بين فكرتين تبدوان متوازيتين. إحداهما تقديم حزمة متكاملة ومحسنة رأسياً من جهة، والأخرى التأكيد على الانفتاح وتعدد النماذج والتكامل مع الشركاء من جهة أخرى. وهذه ليست مجرد نقطة تنافسية بين الشركات الكبرى، بل مسألة عملية للمؤسسات نفسها، خصوصاً في الأسواق التي تسعى إلى الموازنة بين التكامل التقني والمرونة التشغيلية على المدى الطويل. وبالنسبة إلى الخليج، فإن هذا التوازن بين التكامل والانفتاح يبرز كأحد الأسئلة المهمة في المرحلة المقبلة من الذكاء الاصطناعي المؤسسي.

ربما يكون أهم ما كشفه اليوم الأول من «Google Cloud Next 2026» بالنسبة إلى السعودية والخليج ليس منتجاً واحداً بعينه، بل طبيعة التحول الذي يعكسه. فالموجة الأولى من الذكاء الاصطناعي كانت تدور حول إثبات الفائدة. أما الموجة التالية، كما بدت في لاس فيغاس، فتدور حول إثبات الجاهزية. وهذا يعني أن المعركة المقبلة لن تُحسم فقط بمن يملك النموذج الأذكى، بل بمن يملك المؤسسة الأقدر على تشغيله، وضبطه، وتأمينه، وربطه ببياناته وعملياته، وتحويله من تجربة لافتة إلى قدرة يومية يمكن الوثوق بها. ومن هذه الزاوية، فإن الرسالة الأهم القادمة من الحدث ليست تقنية فقط، بل مؤسسية أيضاً: المرحلة المقبلة في الذكاء الاصطناعي في المنطقة ستكون معركة تنفيذ بقدر ما هي معركة ابتكار.