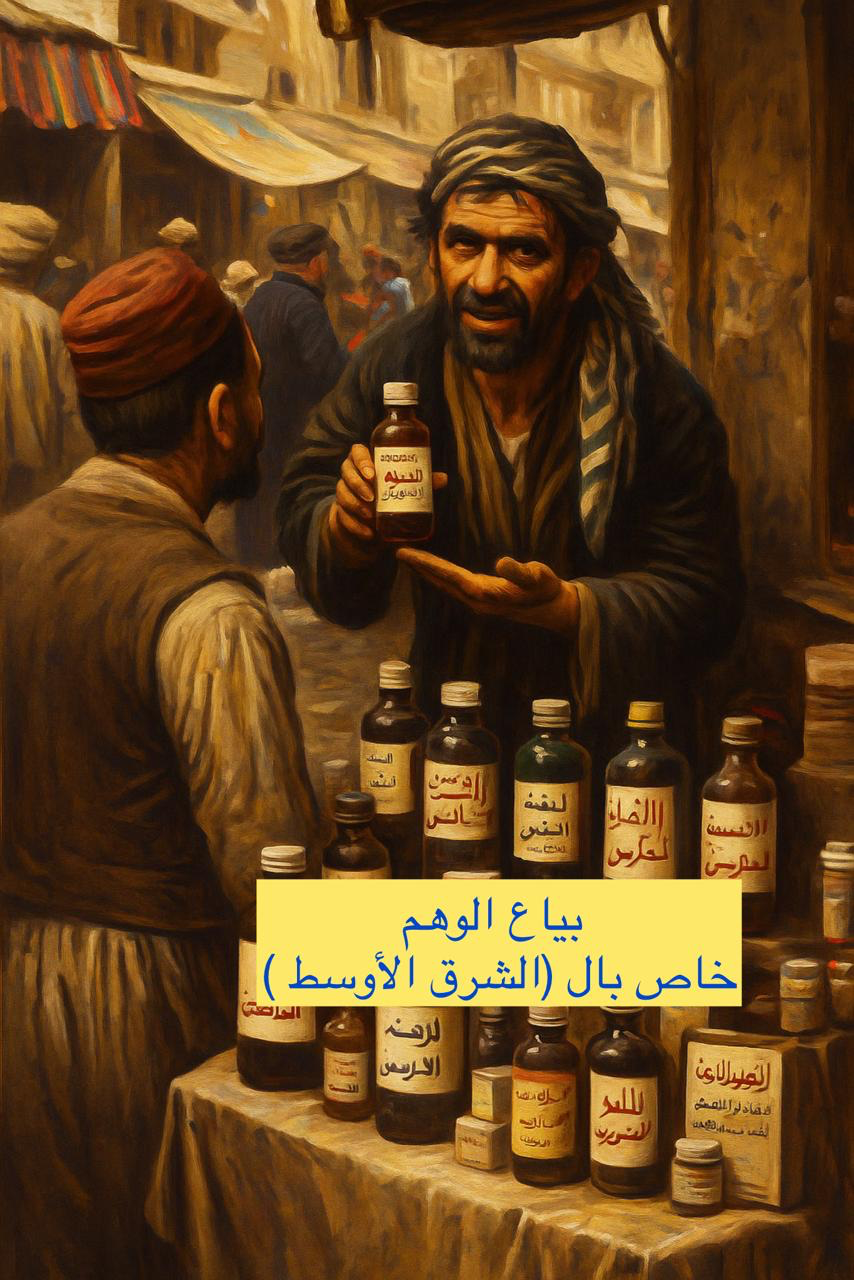

في سوقٍ شعبية قديمة، كنت ترى بائعاً جوَّالاً يرفع قارورة صغيرة ويصيح بثقة: «هذا الدواء يشفي كل داء!». ويتجمّع الناس حوله بدافع الأمل، يدفعون نقودهم، ويعودون إلى بيوتهم وهم يعلّقون رجاءهم على ماءٍ ملوّن ووعودٍ جوفاء.

حيلة قديمة... ترتدي ثوباً رقمياً

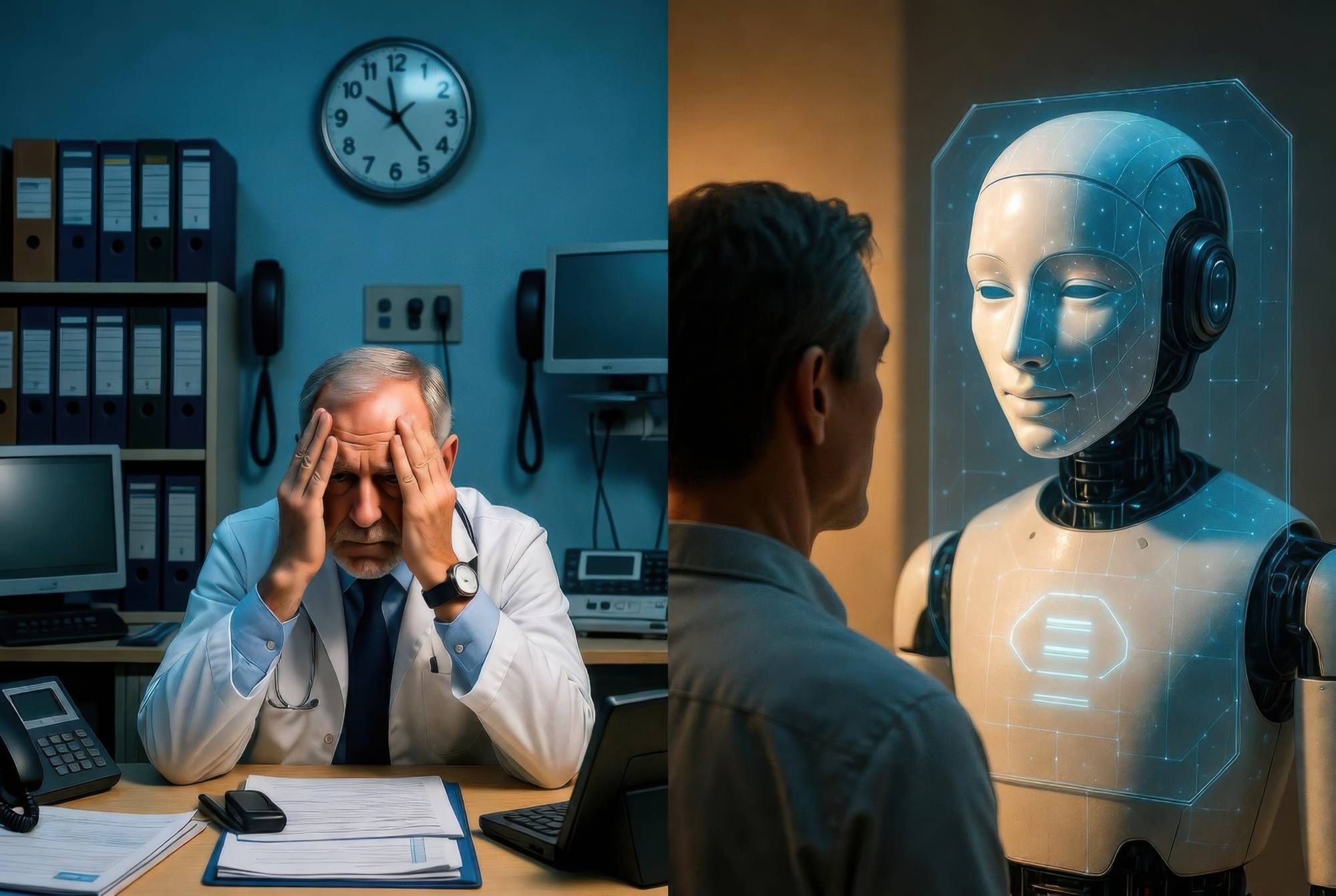

تلك الحيلة القديمة لم تَمُت، بل ارتدت ثوباً رقمياً جديداً. فاليوم، لا تحتاج إلى الوقوف في السوق لتُخدع؛ يكفي أن تفتح هاتفك لتجد بائعاً رقمياً يعرض «ذكاءً اصطناعياً خارقاً» في قنينة تطبيق... أسماء براقة مثل «الطبيب الذكي» و«الرفيق العاطفي» و«المستشار القانوني الآلي» تتنافس على كسب ثقتك، مستخدمة كلماتٍ تشبه السحر، لكنها تخفي وراء لمعانها خوارزميات سطحية تكرّر ما تعلّمته دون فهم، وأحياناً بنوايا خبيثة تسعى لسرقة بياناتك أو التلاعب بك نفسياً.

لماذا ينجح هذا الخداع؟

الذكاء الاصطناعي الحقيقي أشبه بمختبر ضخم يعمل فيه علماء بيانات ومهندسون على خوارزميات تتطلب سنوات من التطوير وكمّاً هائلاً من البيانات والتجارب. إنه مجال معقّد ومكلف لا يُبنى في ليلة. لكن باعة الوهم الجدد اكتشفوا طريقاً أسهل: يكفي أن يضيفوا حرفين لامعين - «AI» - إلى اسم أي تطبيق عادي، ليغمرهم المستخدمون بالاهتمام والتحميلات والثقة. (ـ«A» و«I» هما حرفان فقط من الأبجدية اللاتينية، اختصاراً لـArtificial Intelligence الذكاء الاصطناعي).

إنهم يستغلون نقطتين إنسانيتين فينا: الفضول والرغبة في الحل السريع. فمن منا لا يريد طبيباً يجيب فوراً عن ألمه؟ أو محامياً يحسم قضيته دون انتظار؟ أو مستشاراً مالياً يضاعف أرباحه دون جهد؟ لكن النتيجة كثيراً ما تكون خسارة مزدوجة: للمال وللخصوصية، وأحياناً للعقل الذي ينخدع بوهم الذكاء فيتّخذ قرارات خاطئة قد تضر بصحته أو استقراره المالي.

والمشكلة لا تقتصر على الطب أو القانون، بل تمتد إلى كل زاوية من حياتنا الرقمية. فهناك «المستشار التسويقي الذكي» الذي يعدك بحملة مثالية، و«المحاسب الافتراضي» الذي يدّعي إدارة ميزانيتك بلا أخطاء، بل حتى «الرفيق العاطفي» الذي يتظاهر بفهمك أكثر من البشر. غير أن أغلب هذه التطبيقات لا تقدّم سوى ردودٍ آلية أو تحليلاتٍ سطحية تُخفي خلفها غاية واحدة: جمع بياناتك، وتغذية خوارزمياتهم التجارية، لا تحسين حياتك.

طفرة الذكاء... وطفرة الادعاء

في عام 2024، شهد العالم انفجاراً غير مسبوق في عدد التطبيقات التي ترفع شعار «الذكاء الاصطناعي». ووفقاً لتقارير منصة تحليل السوق الرقمية «سنسور تاور» (Sensor Tower) ومنصة البيانات «ستارت دوت آي أو» (Start.io)، بلغ عدد مرات تحميل التطبيقات التي تتضمن كلمة «الذكاء الاصطناعي» (AI) في اسمها أو وصفها أكثر من 17 مليار تحميل خلال عام واحد فقط، بينما أضاف أكثر من 3 آلاف تطبيق جديد هذا المصطلح إلى أسمائها أو حملاتها التسويقية لأول مرة.

وتشير البيانات إلى أن عائدات هذه التطبيقات تجاوزت 3.3 مليار دولار، وهو رقم يعكس ليس فقط الإقبال على الذكاء الاصطناعي الحقيقي، بل أيضاً الإغراء التجاري لاستخدام المصطلح نفسه كأداة جذب وتسويق.

كما أظهرت دراسة أكاديمية نُشرت في موقع الأبحاث العلمية «أركايف» (arXiv) أنه خلال خمسة أشهر فقط من عام 2024، تم رصد أكثر من 786 ألف تطبيق يُصنَّف ضمن فئة «تطبيقات النماذج اللغوية الكبيرة» (LLM Apps)، مما يكشف حجم الزخم العالمي حول هذا المجال. لكن المقلق أن نسبة غير قليلة من هذه التطبيقات لا تعتمد على ذكاء حقيقي بقدر ما تستغل الاسم لتحقيق الانتشار أو جمع البيانات. إنها طفرة مزدوجة: ازدهار للابتكار... وازدهار للوهم.

كيف تميّز الزائف من الأصيل؟

لست بحاجة إلى أن تكون خبيراً في البرمجة لتكشف الخداع؛ فالتطبيقات الزائفة تترك دائماً آثاراً تدلّ عليها، كما يترك البائع المتجول آثار ألوانه على يديه.

وإليك أبرز العلامات التي ينبغي أن تثير شكّك قبل أن تضغط على «تحميل»:

* المطوّر المجهول: اسأل نفسك: من يقف وراء التطبيق؟ هل هو مشروع تابع لجامعة أو معهد بحثي أو شركة تقنية معروفة؟ أم حساب غامض بلا موقع رسمي أو معلومات تواصل؟ الشفافية أول اختبار للثقة.

* الوعود المطلقة والمبالغ بها: حين تقرأ عبارات مثل «تشخيص طبي دقيق 100 في المائة»، أو «نجاح مضمون»، أو «تحليل شخصيتك في دقيقة»، فاعلم أنك أمام بائع وهم لا مطوّر علم. الذكاء الاصطناعي الحقيقي متواضع بطبعه، يعترف بحدوده، ويقدّم نسب نجاح قابلة للقياس.

* غياب التفاصيل التقنية: التطبيقات الأصيلة تشرح، ولو بأسلوب مبسط، كيف تعمل خوارزمياتها أو من أين تتعلم بياناتها. أما الزائفة فتعتمد على العبارات الغامضة مثل «مدعوم بأحدث تقنيات الذكاء الاصطناعي»، دون أي توضيح.

* الخصوصية المفقودة: احذر من التطبيقات التي تطلب الوصول إلى الكاميرا أو الميكروفون أو الموقع أو ملفاتك المالية دون سبب واضح. فالنية الخفية غالباً ليست تقديم خدمة، بل جمع بيانات لتسويقها أو استغلالها.

* غياب التقييمات الحقيقية: افحص المراجعات في متاجر التطبيقات. هل التعليقات حقيقية ومتنوعة؟ أم متكررة ومكتوبة بنفس الأسلوب؟ التقييمات المزيفة تُصاغ أحياناً تلقائياً لإيهام المستخدمين بالمصداقية.

* الإعلانات المبالغ بها: إن رأيت وعوداً لامعة من مؤثرين أو حملات تسويقية تروّج «لذكاء خارق»، بينما لا تجد أثراً علمياً واحداً يثبت ذلك - فأنت أمام فخ تسويقي لا أكثر.

* غياب أي إشراف أو ترخيص: التطبيقات الأصيلة، خصوصاً الطبية أو القانونية، تخضع لمراجعات أو تراخيص من هيئات مختصة. أما «باعة الذكاء» فلا يذكرون جهة إشراف واحدة.

* علامة الكلفة المنخفضة: حين يُعرض تطبيق يدّعي قدرات خارقة بسعر زهيد أو اشتراك مجاني بالكامل، فاسأل نفسك: إذا لم تكن أنت الزبون... فربما تكون أنت المنتج.

تقييمات مشبوهة: تعليقات متكررة بنفس الأسلوب، أو تقييمات خمس نجوم من دون تفاصيل حقيقية، غالباً ما تكون مزيفة أو مدفوعة الأجر.

كيف تحمي نفسك وتختار الأدوات الموثوقة؟

الحماية الرقمية ليست معقدة إذا كنت واعياً. كل ما تحتاجه هو قليل من الحذر وكثير من الأسئلة قبل أن تضغط على «تحميل». إليك دليلاً عملياً لتجنّب الوقوع في فخ «باعة الذكاء» الجدد:

* ابحث عن المطوّر: تحقق من هوية الجهة المنتجة للتطبيق. هل لديها موقع رسمي، فريق معروف، أو شراكة مع جامعة أو مؤسسة بحثية موثوقة؟ كلما زادت الشفافية، زادت الموثوقية.

* اقرأ المراجعات بعناية: لا تكتفِ بعدد النجوم، بل اقرأ التعليقات الفعلية. ابحث عن تجارب مفصّلة توضّح المزايا والعيوب. المراجعات المتشابهة أو المبالغ فيها قد تكون آلية ومزيّفة.

* التحميل من المتاجر الرسمية فقط: التزم بـGoogle Play أو App Store، وابتعد عن الروابط العشوائية أو الإعلانات المغرية على وسائل التواصل. فالبرامج الوهمية كثيراً ما تختبئ وراء واجهات براقة ومواقع مزيفة.

* راقب الأذونات: افحص ما يطلبه التطبيق من صلاحيات. إذا طلب مثلاً الوصول إلى الميكروفون لتطبيق كتابة، أو إلى الصور لتطبيق حاسبة، فهذه إشارة خطر. لا تمنح إذناً بلا داعٍ.

* استخدم بريداً إلكترونياً ثانوياً: عند تجربة تطبيق جديد وغير موثوق، استعمل بريداً تجريبياً منفصلاً عن حساباتك الرسمية أو البنكية لحماية خصوصيتك من التسريب.

* احذف التطبيقات الراكدة: كل تطبيق مهجور على هاتفك قد يكون باباً خلفياً لجمع البيانات أو للاختراق. نظّف جهازك دورياً مما لا تحتاجه.

* ابحث عن التوثيق العلمي: التطبيق الجاد يذكر مصادره أو نتائج اختباراته. قد يشير إلى دراسة منشورة أو تعاون مع جهة أكاديمية. غياب هذه الأدلة يعني غالباً غياب المصداقية.

* احذر من «الذكاء المجاني»: إذا كان التطبيق يعدك بخدمات خارقة دون مقابل، فتذكّر القاعدة الذهبية: حين لا تدفع بالمال، فربما تدفع ببياناتك.

* استعن بالعقل لا بالعاطفة: لا تنخدع بالإبهار البصري أو اللغة التسويقية. اسأل دائماً: هل هذا التطبيق يحل مشكلة حقيقية... أم يخلقها ليبيعني الحل؟

الذكاء الاصطناعي: أداة أم خدعة؟

الذكاء الاصطناعي ليس خيراً أو شراً بذاته؛ إنه مرآة تعكس نوايا من يستخدمه. فإذا صُمم بمسؤولية، يمكن أن يكون أداة ثورية تُسهم في تحسين حياة الإنسان: من مساعدة الأطباء في تشخيص الأمراض بدقة أكبر، إلى تطوير التعليم، وإدارة الموارد بكفاءة، وتقليل الفاقد في قطاعات الطاقة والزراعة. لكن حين يُستخدم بلا ضمير أو يُسوّق بوهم، يتحول إلى قنينة رقمية جديدة تُباع على الشاشات، تعد بالكمال ولا تقدم سوى الخداع.

في منطقتنا العربية، حيث تنتشر التكنولوجيا بسرعة تفوق أحياناً قدرتنا على استيعابها، يتضاعف خطر الوقوع في هذه الفخاخ الرقمية، خصوصاً مع محدودية الوعي التقني لدى بعض المستخدمين.

هنا يبرز دورنا الجماعي: الإعلام العربي، والمدارس، والجامعات، ومراكز البحث، كلّها تتحمل مسؤولية بناء «المناعة الرقمية» للمجتمع. لقد أصبحت المعرفة التكنولوجية شكلاً جديداً من الحصانة ضد التضليل. علينا أن نُعلّم أبناءنا كيف يسألون قبل أن يصدقوا، وكيف يتحققون قبل أن يشاركوا، وكيف يميزون بين الأداة الحقيقية والخدعة المغلفة بشعار «الذكاء الاصطناعي». ويمكن أن تبدأ هذه الجهود بورش عمل في المدارس أو حملات توعية إعلامية تشرح للناس بلغة مبسطة كيفية قراءة سياسات الخصوصية، أو التحقق من موثوقية التطبيقات قبل استخدامها.

الذكاء الحقيقي في السؤال

الذكاء الاصطناعي يشبه نهراً جارفاً: لا يمكن إيقافه، لكن يمكن توجيهه. إما أن يروي عطشنا للمعرفة... أو أن يُغرقنا في طوفان من التضليل. الفرق لا يصنعه النهر، بل الوعي الذي يختار مجراه. وكما قال الفيلسوف ابن رشد: «من اتخذ التقليد عادة في فكره، أغلق على نفسه باب النظر». فلا تدع الـ«AI» يصبح تقليداً جديداً نمارسه دون تفكير.

إن الذكاء الحقيقي ليس في قدرة الخوارزميات على الإجابة، بل في قدرتنا نحن على طرح الأسئلة الصحيحة - الأسئلة التي تفتح باب الفهم لا باب التكرار، والتي تجعل التقنية خادمة للعقل لا بديلة عنه. فالخطر ليس في أن تُخدع بخوارزمية، بل في أن تتوقف عن السؤال أمامها.

شاركنا رأيك وتجربتك: هل واجهت تطبيقاً ادّعى أنه يعمل بالذكاء الاصطناعي وتبيّن أنه وهم؟ كيف اكتشفت الخداع؟ دعونا نبني معاً مجتمعاً رقمياً أكثر وعياً، يرى في التكنولوجيا وسيلة للارتقاء لا مرآة للوهم، ويجعل من السؤال أول أشكال الذكاء... لا آخرها.

حقائق

3.3

مليار دولار عائدات التطبيقات الذكية عام 2024

حقائق

786

ألف تطبيق يُصنَّف ضمن فئة “تطبيقات النماذج اللغوية الكبيرة” رصد خلال خمسة أشهر فقط من عام 2024