تصور مشهداً لغرفة فيها كنبة حمراء، ونبتة في حوض، ولمسة من الفنّ الخفيف الذي نراه عادة على جدران عيادات الطبّ النفسي. وفي الغرفة، كانت توجد ميشيل أوباما، أو امرأة تبدو مثلها تماماً، ترتدي قميصاً بقصة مفتوحة من الأمام وملابسها الداخلية السوداء ظاهرة أسفلها، تتمايل بإغراء أمام الكاميرا وعلى وجهها ابتسامة واضحة. بعدها، بدأت شبيهة السيّدة الأولى السابقة تنزع ملابسها.

لقد عُرف مقطع الفيديو هذا الذي ظهر على شبكة الإنترنت على منصة «ريديت» باسم «ديب فيك» (deepfake)، (أي الزيف العميق): مقطع شديد الزّيف والواقعية في آن معاً، تمّ إنتاجه ببرنامج ذكاء صناعي، اسمه «فيك آب» (FakeApp) وضعت من خلاله صورة السيدة الأميركية الأولى السابقة على جسم ممثلة أفلام إباحية. وبدت النسخة المزيّفة حقيقية جداً، إلى حدّ أن الناس كانوا ليظنون أن المقطع حقيقي لولا معرفتهم بميشيل أوباما.

حتى وقت قصير، كانت أفلام الفيديو المفبركة على الكومبيوتر متوفرة فقط في شركات الإنتاج الهوليوودي أو للباحثين الذين يعملون بالتقنيات عالية التطور، إلى جانب بعض التطبيقات كـ«سنابشات»، التي تتضمن تقنيات بدائية للتلاعب بشكل الوجه.

- برامج التزييف

ولكن خلال الأشهر الأخيرة، بدأت مجموعة من الهواة اختبار أدوات أكثر فعالية، من بينها «فيك آب» (FakeApp)، وهو برنامج صمّمه مطوّر مجهول يستخدم برمجيات مفتوحة المصدر من إعداد «غوغل». يتيح «فيك آب» للمستخدمين تبديل وجوه حقيقية مجاناً وبسهولة، تاركاً خلفه بعض الآثار الطفيفة على التلاعب. يقول مطوّر هذا البرنامج إنّه ومنذ ظهور النسخة الأولى من هذا التطبيق على منصة «ريديت» في يناير (كانون الثاني)، تمّ تحميله أكثر من 120 ألف مرّة.

«ديب فيكس» واحدة من أجدد أشكال التلاعب الإعلامي الرقمي، التي تفتح مجالاً كبيراً للتضليل والأذى. ومن السهل جداً أن نتخيّل استخدام هذه التقنية لتشويه سمعة السياسيين، عبر إنتاج فيلم إباحي انتقامي أو توريط البعض بالجرائم، حتى أنّ المشرعين بدأوا يشعرون بالقلق من احتمال استخدام هذه التقنية في عمليات التخريب السياسي والبروباغاندا.

وأثارت تقنية «ديب فيكس» القلق والاستهجان حتى على المواقع غير الملتزمة أخلاقياً مثل «ريديت». فقد أثارت هذه التقنية الذعر أخيراً بعد أن كشف موقع «ماذربورد» المتخصص بالتكنولوجيا، أن الناس يستخدمونها لصناعة أفلام مزيفة للمشاهير. وبادرت مواقع كـ«بورنهاب» و«تويتر» وغيرهما فوراً إلى منع عرض هذه الأفلام، وأقفلت منصة «ريديت» عدداً كبيراً من مجموعات «ديب فيكس»، من بينها مجموعة تضمّ 100 ألف عضو على الأقلّ.

قبل إقفالها، استضافت هذه المجموعات مزيجاً من المستخدمين الذين يروجون لنصائح تعديل مقاطع الفيديو ويعرضون بعضاً من آخر أعمالهم المزيفة. وظهر إلى جانب فيديوهات مختلفة منشور بعنوان «إعادة بناء ثلاثي الأبعاد للوجه من زوايا إضافية».

دافع بعض رواد مواقع التواصل الاجتماعي على «ريديت» عن «ديب فيكس» وألقوا باللوم على وسائل الإعلام التي تبالغ في ادعاءاتها حول الضرر المحتمل لهذه التقنية، في حين نقل آخرون فيديوهاتهم إلى منصات أخرى، قبل إخضاعها لقوانين المنصة المتعلّقة بالأفلام الإباحية غير المسموحة، مقابل القليلين فقط ممن عبّروا عن مخاوف أخلاقية من توفير هذه التقنية حول العالم.

ولا تزال فئة صانعي أفلام «ديب فيك» حتى اليوم تعمل في الظلّ، ولكن تأثيرها العلني ينبئ بمستقبل غير مطمئن. ويقول كيفين روز، الخبير التكنولوجي من نيويورك الذي جرب نظم الذكاء الجديدة، إن أحد مستخدمي «ريديت» كتب يقول: هذا الأمر يتحوّل إلى حلقة من سلسلة «بلاك ميرور». فأثار هذا المنشور أسئلة مهمّة جداً في عمق النقاش حول «ديب فيك»؛ هل يمكن لصورة عارية للشخص «أ» أن تصبح صورة عارية للشخص «ب»، إن تمّ الاستبدال بوجه «أ» وجه «ب» بطريقة مثالية ودون أي أثر؟ بمعنى أشمل، ما الفرق بين الحقيقة والعرض على الإنترنت؟

بعدها، سجّل المستخدم خروجه من المنصة وهو يستهجن، قائلاً: «بالتوفيق للمتمردين».

- أفلام «ديب فيكس»

بعد رصد مستخدمي «ديب فيك» في ريديت لعدة أسابيع، قرّر كيفين روز أن يجرّب صناعة فيلم «ديب فيك» (آمن للعمل وذا محتوى غير إباحي) باستخدام وجهه. وقد بدأ الخبير بتحميل «فيك آب» واستعان بخبيرين تقنيين لمساعدته: الأول خبير تقني، والآخر هو مصمّم «ديب فيك» الذي تعرّف إليه عبر «ريديت»، الملقّب بـ«ديرب فيكس» (Derpfakes).

لا شكّ في أنّ «ديرب فيكس» لن يبادر أبداً إلى إعطاء اسمه الحقيقي بسبب طبيعة برنامجه المثيرة للجدل. بدأ هذا المطوّر بنشر فيديوهات «ديب فيك» على «يوتيوب» منذ بضعة أسابيع، وركّز على العروض الكوميدية كتقديم نيكولاس كيدج في دور سوبرمان. كما نشر حسابه بعض الفيديوهات التي تتحدّث عن صناعة البرنامج.

يمكن القول إن ما تعلّمه روز خلال الاختبار أن تطوير هذا البرنامج لم يكن بسيطاً، ولكنه في الوقت نفسه، ليس علماً معقداً.

ترتكز الخطوة الأولى في تطويره على العثور على، أو استئجار، كومبيوتر بقدرات متفوقة. يستخدم برنامج «فيك آب» مجموعة من أدوات التعلّم الآلي تعرف باسم «تينسور فلو» (TensorFlow)، المطوّرة من قبل قسم «غوغل» الخاص بالذكاء الصناعي، التي أطلقت للاستهلاك عام 2015. يعمل البرنامج على تعليم نفسه كيف يؤدي مهام التعرّف إلى الصورة عن طريق التجربة والخطأ. وكلّما كانت السرعة التشغيلية المتوفّرة قوية، عمل البرنامج بسرعة أكثر.

للحصول على سرعة أكبر، استخدم روز كومبيوتر خادماً يعمل عن بعد مستأجراً عبر منصة «غوغل» السحابية، وفّر له القوة التشغيلية الكافية لإنهاء العمل في غضون ساعات، بدل أن يستغرق أياماً أو أسابيع على جهاز اللاب توب.

وفور ضبط الخادم وتحميله «فيك آب»، انتقل إلى الخطوة التالية: جمع البيانات.

إنّ اختيار مصدر البيانات الصحيح مهمّ جداً، لأن عملية التلاعب تكون أسهل في مقاطع الفيديو القصيرة منها في المقاطع الطويلة، فضلاً عن أن المشاهد الملتقطة من زاوية واحدة تفضي إلى نتائج أفضل من المشاهد متعددة الزوايا. الجينات أيضاً تلعب دوراً مهماً، إذ كلّما كان شبه الوجوه أكبر، كانت النتيجة أفضل.

بعدها، التقط مئات من الصور لوجهه، وجمع صوراً لوجه أحد مشاهير التلفزيون غوسلينج من إحدى إطلالاته المتلفزة الأخيرة. يستخدم برنامج «فيك آب» هذه الصور لتدريب نموذج التعلّم الآلي، وتعليمه كيف يحاكي تعابير وجهه.

وبالمجمل، استخدم كيفن روز 417 صورة له، و1113 للشهير التلفزيوني. وحين أصبحت الصور جاهزة، ضغط «انطلق» على «فيك آب»، وبدأ التدريب، فامتلأت شاشة الكومبيوتر بصوره وصور الشهير في الوقت الذي كان فيه البرنامج يعمل على تحديد الملامح وأوجه الشبه. بعد نحو 8 ساعات، وبعد تدريب نموذجنا بنجاح، استخدم «فيك آب» لإنهاء وضع وجهه على جسد الشهير. كان مقطع الفيديو غير واضح وغريب، وظهر وجه الشهير الأصلي بشكل متقطع في الفيديو...« لقد كان بإمكان أي مشاهد أن يتعرّف إلى الشخص الأصلي في الفيديو الذي وضعت وجهي عليه».

ولكن النتيجة كانت أفضل في مقطع للممثل كريس برات، نجم فيلم «جوراسيك وورلد» الذي يجمع بين وجهه ووجه روز شبه أكبر. «في هذا الاختبار، استخدمت مجموعة أكبر من البيانات، ضمّت 1861 صورة لي، و1023 صورة للمثل، وتركت النموذج يعمل لليلة كاملة».

كرّر «ديرب فيكس» العملية مع فيديوهات لجيمي كيمل وليف شريبر، وكانت النتائج جيّدة في كليهما. وكمنتج خبير في أفلام «ديب فيك»، يملك «ديرب فيكس» دراية أكبر بالفيديوهات المصدر التي تعطي نتائج جيّدة، ويتمتع بخبرة أكبر أيضاً في مجال المزج والتبديل اللذين يجب أن يحصلا في آخر مراحل عملية «ديب فيك».

بشكل عام، تطلّبت تجربة الخبير كيفن روز برنامج «ديب فيك» 3 أيام وكلّفت 85.96 دولار في حسابات «غوغل كلاود بلاتفورم»، أي أنّ المبلغ لم يكن كبيراً أبداً كي يصبح شخصاً مشهوراً.

- سلاح ذو حدين

ماذا يقول مطوّر البرنامج؟ بعد التجربة، تمكّنت من الوصول إلى مطوّر «فيك آب» المجهول عبر عنوان بريد إلكتروني موجود على موقعه الإلكتروني. أردت أن أعرف ماذا يعني له أنّه طوّر أداة ذكاء اصطناعي متقدّمة، يتشاركها اليوم مع منتجي أفلام إباحية يواجهون تحديات أخلاقية.

فأجابني رجلٌ عرّف نفسه على أنه مطوّر برمجيات من ماريلاند، ولأنه لن يعطيني اسمه الكامل طبعاً، استعان بالحرف الأول منه فقط. فقال إنه طوّر «فيك آب» كتجربة مبتكرة، ولكنّه شعر بالأسف لأن مجموعات «ديب فيك» على منصة «ريديت» استخدمته لغايات سيئة.

يمكن أن نقول إن «فيك آب» برنامج معقد بعض الشيء وصعب الاستخدام، ولكنه سيشهد تطوراً سريعاً. وقال مطوّر البرنامج المجهول إن جميع الفئات سيمكنها أن تستخدم «فيك آب» في المستقبل لصناعة تأثيرات مميزة ضخمة في مشاريعها الخاصة.

وأضاف أن خوارزميات التعلّم المتعمق ستحظى بأهمية كبيرة في المستقبل، ليس في التطبيقات المستقلة فحسب، بل أيضاً كمكوّن فعال في كثير من المنتجات التقنية.

تنتشر المعلومات المغلوطة عبر الإنترنت، مهما كانت بسيطة الصنع، عبر عملية سلسة فور دخولها إلى قنوات النشر الاجتماعية. تحصل المعلومة المزيفة على مشاركات أعلى بكثير من تكذيب هذا الزيف.

قال هاو لي، أستاذ مساعد في علوم الكومبيوتر في جامعة «ساوثرن كاليفورنيا»، ومؤسس «بينسكرين»، شركة تستخدم الذكاء الصناعي لتطوير نماذج شخصيات ثلاثية الأبعاد: «ليس لدينا خيار. إن تفادي استخدام الذكاء الاصطناعي كسلاح لم يكن ممكناً، وهذا الأمر يتطلّب تغييراً سريعاً في الوعي العام».

وأضاف: «أنا أرى أن هذا هو الشكل المقبل للتواصل. أشعر بالقلق من فكرة استخدام الناس هذه التقنية لابتزاز الآخرين، أو القيام بأمور مسيئة. تجب توعية الناس إلى أن هذه الأمور يمكن أن تحصل».

9:17 دقيقه

نظم ذكاء صناعي لإنتاج فيديوهات مزيفة

https://aawsat.com/home/article/1202511/%D9%86%D8%B8%D9%85-%D8%B0%D9%83%D8%A7%D8%A1-%D8%B5%D9%86%D8%A7%D8%B9%D9%8A-%D9%84%D8%A5%D9%86%D8%AA%D8%A7%D8%AC-%D9%81%D9%8A%D8%AF%D9%8A%D9%88%D9%87%D8%A7%D8%AA-%D9%85%D8%B2%D9%8A%D9%81%D8%A9

نظم ذكاء صناعي لإنتاج فيديوهات مزيفة

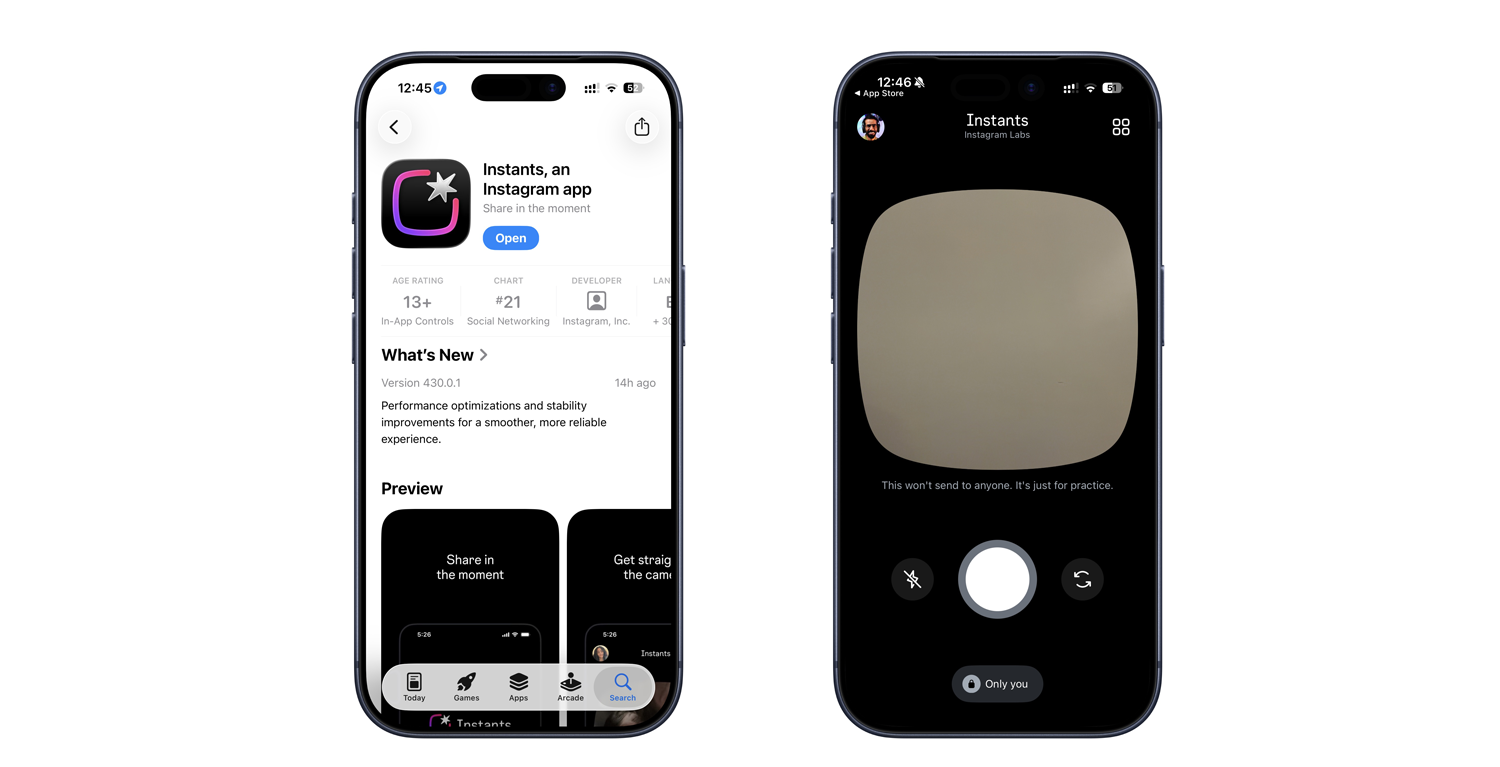

برامج «ديب فيك» تعرض مشاهد مفبركة

لقطة من تطبيق «فيك آب» لتغيير الوجوه في العروض الزائفة

نظم ذكاء صناعي لإنتاج فيديوهات مزيفة

لقطة من تطبيق «فيك آب» لتغيير الوجوه في العروض الزائفة

مقالات ذات صلة

لم تشترك بعد

انشئ حساباً خاصاً بك لتحصل على أخبار مخصصة لك ولتتمتع بخاصية حفظ المقالات وتتلقى نشراتنا البريدية المتنوعة