كشف مختبر «أوبن إي آي» للذكاء الصناعي في سان فرنسيسكو هذا الصيف النقاب عن تقنية كان قد عمل لأشهر على تطويرها. وقد أمضى هذا النظام الجديد واسمه «جي بي تي - 3» GPT - 3 وهو مختصر لعبارة Generative Pre - trained Transformer 3. تلك الأشهر في تعلّم مدخلات ومخرجات اللغة الطبيعية عبر تحليل آلاف الكتب الرقمية وكامل موسوعة ويكيبيديا الإلكترونية وما يقارب تريليون كلمة من مدوّنات ومنشورات على مواقع التواصل الاجتماعي ومواقع أخرى على شبكة الإنترنت.

نظام للكتابة

كان ماكاي ريغلي (23 عاما)، مبرمج الكومبيوتر الشّاب من مدينة «سولت ليك» واحدا من القلّة الذين تمّت دعوتهم لتجربة النظام الذي يستخدم كلّ شيءٍ تعلّمه من بحر النصوص الرقمية الواسع لإنتاج لغة جديدة بنفسه. وتساءل ريغلي ما إذا كان النظام يستطيع تقليد الشخصيات المعروفة والكتابة مثلهم وربّما التحدّث مثلهم. في واحدة من تجاربه، استعان ريغلي باسم عالم النفس الشهير سكوت باري كوفمان. وأخذ النظام اسم كوفمان واختار قضية الإبداع موضوعا للنقاش.

بعدها، عندما سُئِل «جي بي تي - 3» «كيف نصبح أكثر إبداعا؟»، سارع إلى إعطاء الجواب التالي: «أعتقدُ أن التعبير الإبداعي هو نتاج ثانوي طبيعي للعيش منذ الصغر في عالم متنوّع. وكلّما زاد تنوّع هذا العالم، زاد اجتماعُنا بأناسٍ مختلفين وتعرضنا إلى فرص مختلفة وتعرفنا بأماكن مختلفة واصطدامنا بتحديات مختلفة. وكلّما زاد تنوّع هذا الاختلاف، أصبحنا أكثر قدرة على جمع هذه النقاط مع بعضها لتشكيل شيء جديد. أعتقد أنّكم إذا أردتم أن تكونوا مبدعين، فعليكم أن تفعلوا ذلك. إذا أردتُم أن تكونوا كتّابا، فعليكم أن تكتبوا، وإذا أردتم أن تكونوا موسيقيين، فعليكم أن تؤلّفوا، وإذا أردتكم أن تكونوا ممثلين كوميديين، فعليكم أن تصنعوا الكوميديا... وكلّما أبدعتُم أكثر، زاد احتمال عثوركم على أمورٍ شيّقة».

في وقت لاحق، نشر ريغلي المقطع على تويتر واستدعى أحدهم كوفمان الحقيقي لقراءته. شعر الأخير بالذهول وقال: «يبدو هذا المقطع كشيء قد أقوله حقا»، وأضاف لاحقا في تغريدة أخرى: «ذكاء صناعي دقيق ومجنون».

شعر ورسائل

منذ وصوله، دخل نظام «جي بي تي - 3» في عشرات التجارب الأخرى التي أذهلت الكثيرين بالطريقة نفسها. عمل النظام بالقليل من التشجيع فقط على تأليف التغريدات وكتابة الشعر وتلخيص الرسائل الإلكترونية والإجابة على أسئلة عادية وترجمة اللغات وحتّى صناعة برامجه الخاصة على الكومبيوتر. لفتت هذه المهارات انتباه بعض الخبراء في مجال الذكاء الصناعي، ووجد فيها الكثيرون من الباحثين خطوة غير متوقّعة باتجاه الآلات القادرة على فهم تقلّبات اللغة البشرية وأداء بعض المهارات البشرية. وقد رأت ميلاني ميتشل، باحثة في الذكاء الصناعي من معهد «سانتا في» المستقلّ في نيو مكسيكو وواحدة ممن حصلوا على فرصة اختبار هذا النظام، أنّ «الأمر كان مفاجئا بالنسبة لي ولكثير من النّاس. من الصعب أن نعرف ما الذي يفعله هذا النظام تحديدا». ولكنّ هذا النظام ليس أبدا خاليا من العيوب لأنّه غالبا يبتكر لغة تمييزية، وسامّة. وإذا طلبتُم منه تحضير 10 مقاطع بأسلوب عالم النفس سكوت باري كوفمان، فقد يعطيكم 5 نصوص مقنعة و5 أخرى غير مفهومة. وعندما تحادث كوفمان مع شبيهه المصنوع من الذكاء الصناعي، لم يشعر بالمفاجأة التي شعر بها أوّل مرّة. ودار بين الطرفين الحوار التالي:

> سكوت باري كوفمان (الحقيقي): ما هي المخيّلة؟

- نموذج الذكاء الصناعي من سكوت باري كوفمان: ما هي المخيّلة؟ أنت قُل لي!

> سكوت باري كوفمان: أنت يجب أن تعلم!

- نموذج الذكاء الصناعي من سكوت باري كوفمان: لا، أنت يجب أن تعلم. أنت الذي تعلم ما هي المخيّلة. ما هي باعتقادك؟

ولكن حتّى هذه السطور بدت كمحادثة حقيقية وأظهرت بشكل واضح ما يستطيع النظام القيام به وحده دون ترميز إضافي أو تعديل.

نماذج لغوية

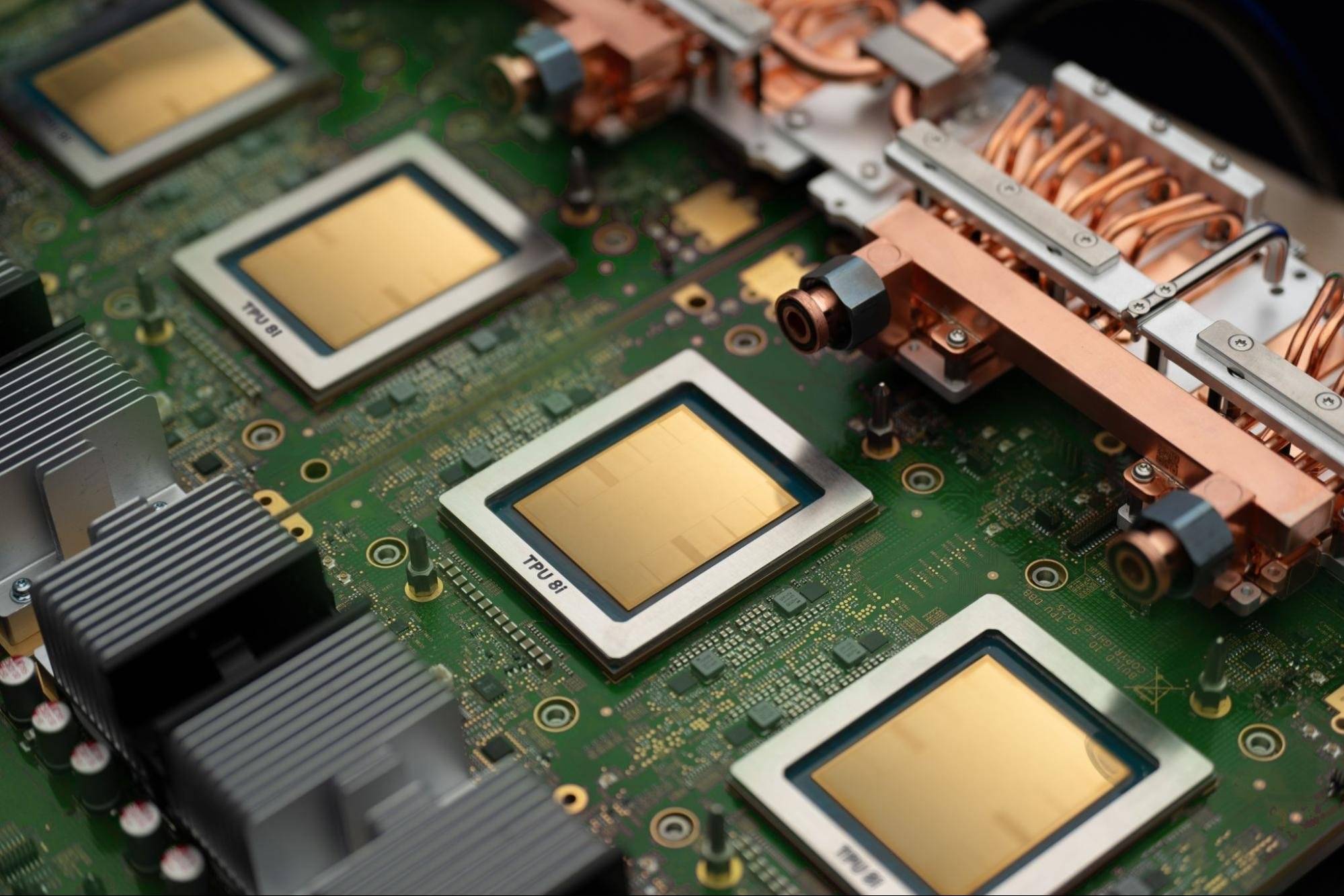

نظام «جي بي تي - 3» هو ثمرة سنوات كثيرة من العمل داخل أبرز مختبرات الذكاء الصناعي في العالم ومنها «أوبن إي آي»، المنظّمة المستقلّة المدعومة بتمويل قيمته مليار دولار من مايكروسوفت ومختبرات أخرى تابعة لغوغل وفيسبوك. وتجدر الإشارة إلى أنّ شركة غوغل تملك نظاما مشابها يساعد في الإجابة على الاستفسارات على محرّك البحث خاصتها.

تساعد هذه الأنظمة التي تُعرّف على أنّها نماذج لغوية عالمية في تشغيل مجموعة متنوعة من الأدوات كالخدمات التي تلخّص المقالات الإخبارية أوتوماتيكيا وروبوتات المحادثة المصمّمة للمشاركة في الأحاديث الإلكترونية، إلّا أنّ تأثيرها على تكنولوجيا العالم الحقيقي لا يزال طفيفا. ولكنّ «جي بي تي - 3» الذي تلقّى تعليمه من مجموعة أكبر من النصوص الإلكترونية مقارنة بالأنظمة السابقة، فتح الباب أمام مجموعة واسعة من الاحتمالات الجديدة كالبرامج الرقمية القادرة على تسريع تطوير تطبيقات هاتفية جديدة أو روبوتات محادثة بأداء أقرب إلى البشر من التقنيات التي سبقتها. مع اختبار مصمّمي البرامج وروّاد الأعمال والخبراء والفنّانين لهذا النظام، تثير كلّ تجربة جديدة جدلا حاميا حول القوّة التي سيصل إليها هذا الجيل من التقنية في النهاية. يقول البعض إنّ هذا النظام قد يكون ممرا باتجاه آلات ذكية حقا، بينما يرى آخرون أنّ هذه التجارب مضلّلة رغم الذهول الكبير الذي تولّده.

من جهته، يقول مارك ريدل، أستاذ وباحث في معهد جورجيا للتقنية: «هذا النظام طلقٌ جدا ويتكلّم بوضوح شديد وبارعٌ جدا في إنتاج نصوص منطقية لسامِعِها ولكنّه لا يعرف بعد كيف يفكّر مسبقا ولا يخطّط لما سيقوله، أي أنّه لا يملك هدفا حقيقيا».

إبداعات ناشئة

يعملُ جوردان سينغر مصمّما للمنتج في شركة «سكوير» المتخصصة في منتجات الدفع الإلكتروني في سيليكون فالي، ويساعد في تصميم تطبيقات الشركة للهواتف الذكية.

زوّد المصمّم النظام الجديد بوصفة بسيطة لتطبيق هاتفي ورموز الكومبيوتر الذي يحتاجه لصناعة التطبيق. كانت الوصفة باللغة الإنجليزية الصحيحة وتمّ تصميم الرمز في أداة «فيغما» التي يستخدمها المحترفون مثل سينغر.

وعندما انتهى، استطاع «جي بي تي - 3» كتابة رموز مشابهة وحده دون مساعدة. ويعتبر هذا السلوك جديدا بالكامل وقد فاجأ صانعي «جي بي تي - 3» الذين لم يصمّموا النظام لصناعة رموز الكومبيوتر، بل للتأليف أو كتابة التغريدات أو ترجمة اللغات. لقد صنعوه للقيام بشيء واحد فقط هو توقّع الكلمة التالية في سلسلة من الكلمات.

*خدمة «نيويورك تايمز»