لم تكن قاعات قصر الأمم بجنيف، هذا الأسبوع، كأي قاعات مؤتمر تقليدي. ففي قمة «الذكاء الاصطناعي من أجل الخير» لعام 2025، لم يكن السؤال الأبرز عن قدرات الآلة، بل عن قدرات الإنسان نفسه... وتحديداً عن دماغه. كيف يفكر؟ كيف يُشفر الرغبة في الحركة إلى إشارات عصبية؟ وهل يمكن لهذه الإشارات أن تتجاوز حدود الجسد لتُحرّك كرسياً، أو تكتب رسالةً، أو تنطق حلماً؟

واجهات «الدماغ - الكمبيوتر»

في ركنٍ من أركان المؤتمر، احتشد العلماء والخبراء لمتابعة ورشة علمية فريدة حول «واجهات الدماغ - الكمبيوتر» (Brain - Computer Interfaces)، وهي تقنية تقف على تقاطع العلم والتكنولوجيا والطب والأمل الإنساني... إنها ليست خيالاً علمياً كما كانت تُصوّرَ في أفلام التسعينات، بل أصبحت اليوم مجالاً نشطاً للأبحاث والتجارب السريرية، تُغيِّر حياة المرضى، وتعيد رسم العلاقة بين الدماغ والعالم الخارجي.

في تلك اللحظات، لم يكن الذكاء الاصطناعي مجرد أداة برمجية، بل كان ترجماناً لإرادة الإنسان، ووسيطاً بين صمته وقوّته... بين الإعاقة والتمكين.

أن تفكّر... فيتحرّك شيء خارجك

في زمنٍ كانت فيه الأوامر تصدر بالأيدي، والكلمات تُنطق بالشفاه، تأتي واجهات الدماغ - الكمبيوتر لتقلب المفاهيم: أن تُفكر فقط... فيتحرّك شيء.

تخيّل مريضاً بشلل رباعي، لا يستطيع رفع إصبعه، لكنه يرفع ذراعاً إلكترونيةً بقوة الإرادة وحدها. أو تَصوَّر عاملاً في مصنع، يرتدي خوذةً تقرأ نبض دماغه، فتعرف متى يوشك على الإرهاق، وتوقف الماكينة قبل أن يتعثر.

ما بين الفكرة والفعل، تسير إشارات عصبية خفية، لم تكن تُرى أو تُسمَع، لكنها اليوم تُلتقط وتُترجم وتُنفذ. و«واجهات الدماغ - الكمبيوتر (BCI)» لا تنتظر صوتاً أو حركةً، بل تترجم النشاط الكهربائي في الدماغ إلى أوامر رقمية تُحرِّك أجهزةً خارجيةً: أطراف صناعية، أنظمة تحكم، أدوات نُطق للأشخاص غير القادرين على الكلام.

إنها ثورة عصبية لا تُقرأ فيها الكلمات، بل تُقرأ النوايا.

حين تقود الصين... ويتناغم العالم

في قلب قمة «الذكاء الاصطناعي من أجل الخير»، انعقدت ورشة عمل لم تكن اعتيادية، بل أقرب إلى حجر أساس لعصرٍ جديد من التواصل بين العقل والتقنية. وقاد الورشة «معهد الصين لأبحاث الاتصالات والمعلومات (CAICT)»، برعاية الاتحاد الدولي للاتصالات (ITU)، وجاء عنوانها واضحاً وطموحاً: «واجهات الدماغ – الكمبيوتر: معايير للسلامة التقنية وتطبيقات متعددة».

في التاسع من يوليو (تموز) 2025، لم يكن النقاش في جنيف مجرّد استعراضٍ للأفكار، بل خريطة طريق عالمية تُرسَم على الطاولة: كيف نطوّر هذه التقنية؟ كيف نُحصّنها أخلاقياً وتقنياً؟ كيف نمنع أن تتحول من أداة للتمكين إلى وسيلة للهيمنة؟

لقد بدت الورشة كأنها دعوة مفتوحة لكل العقول من الشرق والغرب... لنتفق، قبل أن تُصبح هذه الواجهات جزءاً من الحياة اليومية، على قواعد اللعب.

من غرف الإنعاش إلى مصانع الطيران... التقنية تتكلم نيابةً عن العقل

ليست واجهات الدماغ – الحاسوب حكراً على المختبرات العصبية، بل أصبحت ضيفاً جديداً في غرف التأهيل، ومراكز الصناعة، وحتى فصول التعليم.

في الطب العصبي، تمنح هذه التقنية لمرضى السكتات الدماغية وأمراض الأعصاب فرصة ثانية: أن يحركوا ما ظنّوا أنه شُلّ إلى الأبد، أن يتعلم الدماغ أن يعيد رسم مساراته المقطوعة، عبر تفاعل مباشر بين الفكر والجهاز.

أما في القطاعات الصناعية الحساسة، مثل الطيران والطاقة النووية، فإنها تُستخدم لرصد التعب العقلي والذهني لدى العاملين، فتُرسل إنذارات دقيقة قبل أن يتحول الإرهاق إلى خطأ كارثي.

وفي عالم التعليم المندمج، تفتح التقنية نوافذ جديدة للأطفال ذوي الاحتياجات الخاصة، فتُقدّم لهم أدوات تواصل تعتمد على الإشارات الدماغية بدل النطق أو الكتابة، فتُحرّر طاقاتهم، وتدمجهم في بيئات تعليمية تليق بإمكاناتهم الكامنة.

من الشفاء... إلى السلامة... إلى التعلّم: واجهات الدماغ - الكمبيوتر تنسج خيوطاً خفية بين ما في الداخل وما هو خارج الجسد، لتُعيد تشكيل مفهوم «القدرة».

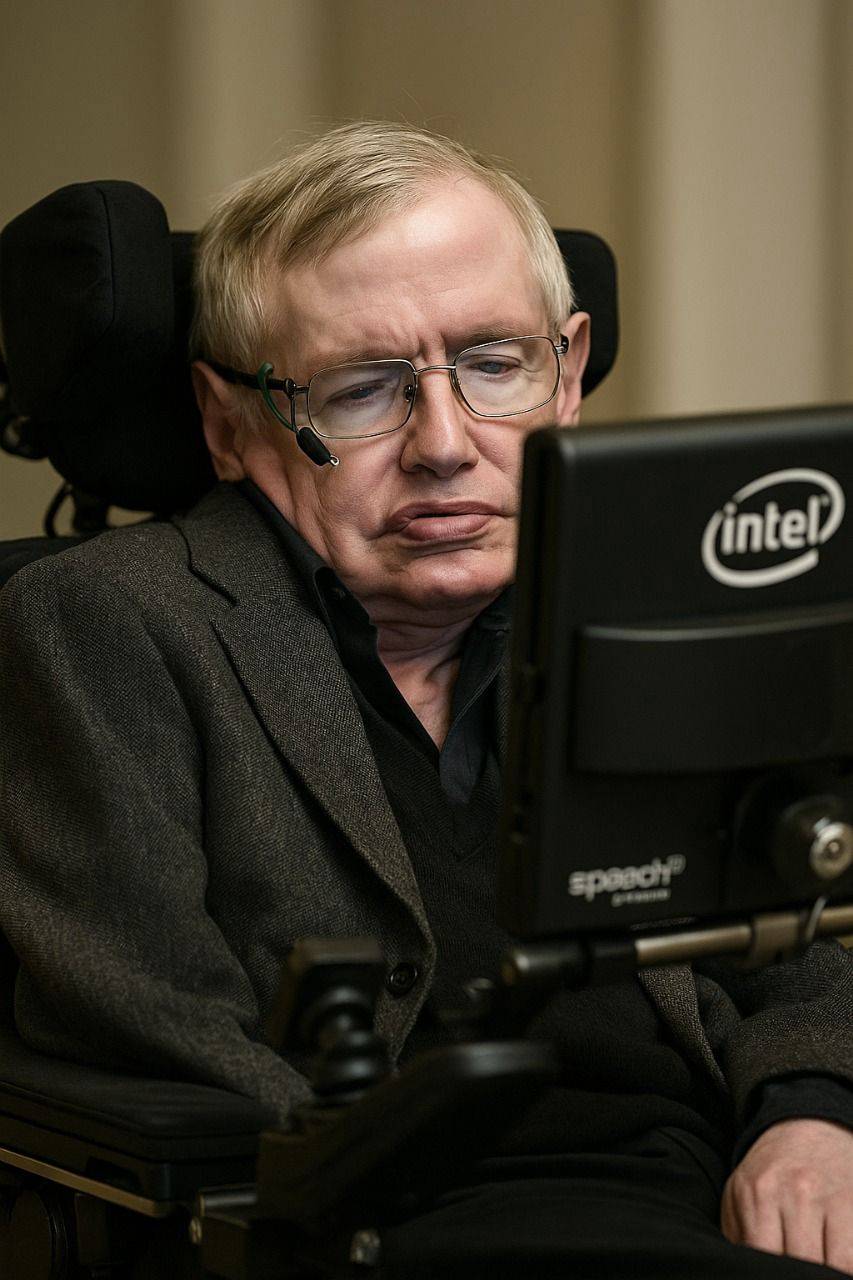

حين تحدَّث هوكنغ بصمتٍ أعمق من الصوت

في لحظةٍ بدا فيها العقل مسجوناً داخل جسدٍ صامت، نهض العلم ليمنح النية شكلاً، والكلمة طريقاً.

الفيزيائي البريطاني الأسطوري ستيفن هوكنغ، الذي قيدَهُ التصلّب العضلي الضموري، لم يتوقف عن التفكير... ولم يصمت. عبر جهاز دقيق يلتقط حركة عينيه واهتزاز عضلات وجهه، كان يحاور العالم، يحاضر، ويكتب، ويضحك أحياناً.

صحيح أن الجهاز لم يكن واجهة دماغ -كمبيوتر كاملة بالمعنى العصبي، إلا أنه كان تمهيداً نفسياً وتكنولوجياً لفكرةٍ ثورية: الإرادة الذهنية وحدها يمكن أن تكون لغة، وأن تفكير الإنسان قادر على تجاوز الجسد.

قصة هوكنغ لم تكن فقط عن المرض والعلم، بل عن الإصرار على أن العقل، حين يُفتح له مخرج، قد يُدهش العالم بأسره.

«مخاطر» التنصّت على النوايا

لكن... مَن يحمي الدماغ حين يُصبح مكشوفاً؟ إذا كان بالإمكان قراءة إشارات العقل، فهل يمكن أيضاً التنصّت على النوايا؟

هنا بالضبط، تَحوّل الحماس في ورشة جنيف إلى قلقٍ مدروس. فالتقنية التي تفتح الباب أمام الشفاء والتمكين، قد تفتح أيضاً نافذة على أخطر أنواع التطفل: «الوصول إلى أفكار الإنسان قبل أن ينطق بها».

كيف نضمن أن واجهات الدماغ – الكمبيوتر ستبقى أداةً للحرية، لا أداة للمراقبة؟ هل يحق لمؤسسة أو حكومة أن تجمع بيانات من دماغ فرد ما، دون علمه أو إرادته؟ كيف نحمي «الخصوصية العصبية» في عالم باتت فيه الخصوصية الرقمية نفسها مهددة؟

لذلك، دعت الورشة إلى ضرورة صياغة إطار معياري عالمي، يضبط هذه الأسئلة الأخلاقية والقانونية والتقنية، قبل أن تسبقنا التكنولوجيا نحو مساحات لا عودة منها.

كان الإجماع واضحاً: لا مستقبل آمناً لهذه التقنية... دون أخلاقيات متينة تُرافقها منذ البداية.

رؤية نحو المستقبل: حين يصبح العقل منصّةً للعالم

لم تعد واجهات الدماغ - الكمبيوتر مجرد مشهد سينمائي من أفلام الخيال العلمي، بل تحوّلت إلى بوابة حقيقية لثورة عصبية رقمية. ثورة تُعيد تعريف حدود الجسد والعقل، وتبني جسراً خفياً بين الفكرة والتنفيذ، بين الإنسان والآلة، بين ما لم نكن نجرؤ حتى على تخيّله... وما أصبح ممكناً الآن.

لكن، كما في كل ثورة تقنية، تكمن العظمة في الاستخدام، والخطر في الانزلاق. فهل سنجعل هذه التقنية امتداداً لكرامة الإنسان وشفائه وتمكينه؟

أم نتركها تنزلق إلى أداة للمراقبة، وجمع البيانات، والتلاعب بالإرادة من الداخل؟

ربما لم تُكتب الإجابة بعد... لكن في قاعات مثل قمة جنيف، حيث يلتقي العلم بالأخلاق، تُزرع بذور المستقبل.

فإذا كانت هذه الواجهات هي لغة الغد، فعلينا أن نختار الآن: بأي ضمير سنتحدث بها؟