تبشّر شركات «آبل» و«مايكروسوفت» و«غوغل» بعصر جديد لما تصفه بالهواتف الذكية وأجهزة الكمبيوتر ذات الذكاء الاصطناعي، وتقول إن الأجهزة ستقوم بأتمتة المهام، مثل تحرير الصور، والتهنئة بعيد ميلاد سعيد لصديق، ولكن لنجاح ذلك تحتاج هذه الشركات إلى شيء منك، وهو المزيد من البيانات.

نماذج لجمع المعلومات الشخصية

في هذا النموذج الجديد سيقوم جهاز الكمبيوتر الخاص بك، الذي يعمل بنظام «ويندوز» بالتقاط لقطة شاشة لكل ما تفعله كل بضع ثوانٍ، بينما سيقوم جهاز آيفون بتجميع المعلومات عبر العديد من التطبيقات التي تستخدمها، ويمكن لهاتف آندرويد الاستماع إلى مكالمة في الوقت الفعلي لتنبيهك بوجود عملية احتيال.

هل أنت على استعداد لمشاركة هذه المعلومات؟ هذا التغيير له آثار كبيرة على خصوصيتنا.

ولتوفير الخدمات الجديدة المخصّصة تحتاج الشركات وأجهزتها إلى وصول أكثر ثباتاً وحميمية لبياناتنا من ذي قبل.

في الماضي، كانت الطريقة التي نستخدم بها التطبيقات، ونسحب الملفات والصور على الهواتف وأجهزة الكمبيوتر منعزلة نسبياً، إلا أن خبراء الأمن يقولون إن الذكاء الاصطناعي يحتاج إلى نظرة عامة لربط النقاط بين ما نقوم به عبر التطبيقات ومواقع الويب والاتصالات.

«هل أشعر بالأمان عند إعطاء هذه المعلومات لهذه الشركة؟»، يتساءل كليف شتاينهاور، مدير التحالف الوطني للأمن السيبراني، وهي منظمة غير ربحية تركّز على الأمن السيبراني، عن استراتيجيات الذكاء الاصطناعي للشركات.

واجهات الحوسبة الذكية

يحدث كل هذا لأن «تشات جي بي تي» المطوّر من شركة «أوبن إيه آي» قلب صناعة التكنولوجيا رأساً على عقب منذ ما يقرب من عامين، ومنذ ذلك الحين قامت شركات «آبل» و«غوغل» و«مايكروسوفت» وغيرها، بإصلاح استراتيجيات منتجاتها، واستثمرت المليارات في خدمات جديدة تحت مظلّة الذكاء الاصطناعي.

إنها مقتنعة بأن هذا النوع الجديد من واجهات الحوسبة - التي تدرس باستمرار ما تفعله لتقديم المساعدة - سيصبح لا غنى عنه.

أكبر خطر أمني على البيانات

يقول الخبراء إن أكبر خطر أمني محتمَل مع هذا التغيير ينبع من التحول الدقيق الذي يحدث في طريقة عمل أجهزتنا الجديدة؛ نظراً لأن الذكاء الاصطناعي يمكنه أتمتة الإجراءات المعقّدة، مثل مسح الأشياء غير المرغوب فيها من الصورة، فإنه يتطلّب أحياناً قوة حسابية أكبر مما تستطيع هواتفنا التعامل معه، وهذا يعني أن المزيد من بياناتنا الشخصية قد تضطر إلى ترك هواتفنا ليتم التعامل معها في مكان آخر.

يتم نقل المعلومات إلى ما يسمى بالسحابة، وهي شبكة من الخوادم التي تعالج الطلبات، وبمجرد وصول المعلومات إلى السحابة يمكن للآخرين رؤيتها، بما في ذلك موظفو الشركة، والجهات الفاعلة السيئة، والوكالات الحكومية.

وبينما تُخزّن دائماً بعض بياناتنا في السحابة، فإن بياناتنا الشخصية والحميمة الأكثر عمقاً، التي كانت في السابق لأعيننا فقط، مثل الصور والرسائل ورسائل البريد الإلكتروني، قد يتم الآن ربطها وتحليلها بواسطة شركة على خوادمها.

تقول شركات التكنولوجيا إنها بذلت جهوداً كبيرة لتأمين بيانات الأشخاص.

تعرّفوا على الحقائق

في الوقت الحالي، من المهم أن نفهم ما سيحدث لمعلوماتنا عندما نستخدم أدوات الذكاء الاصطناعي، لذلك حصلتُ على مزيد من المعلومات من الشركات حول ممارساتها المتعلقة بالبيانات، وأجرَيت مقابلات مع خبراء أمنيين، وأخطِّط للانتظار لأرى ما إذا كانت التقنيات تعمل بشكل جيد بما فيه الكفاية قبل أن أقرّر ما إذا كان الأمر يستحق مشاركة بياناتي أم لا.

وإليكم ما يجب معرفته.

«أبل إنتلجنس»

أعلنت شركة «أبل» مؤخراً عن «أبل إنتلجنس» (Apple Intelligence)، وهي مجموعة من الخدمات تمثّل أول دخول رئيسي لها في سباق الذكاء الاصطناعي.

* دمج الذكاء في الأجهزة، سيتم دمج خدمات الذكاء الاصطناعي الجديدة في أسرع أجهزة «آيفون» و«آيباد» و«يماك» بدءاً من هذا الخريف، وسيتمكن الأشخاص من استخدامه لإزالة الأشياء غير المرغوب فيها تلقائياً من الصور، وإنشاء ملخّصات لمقالات الويب، وكتابة الردود على الرسائل النصية، ورسائل البريد الإلكتروني.

وتعمل «أبل» أيضاً على إصلاح مساعدها الصوتي «سيري» (Siri)، لجعله أكثر تحادُثاً، ومنحه إمكانية الوصول إلى البيانات عبر التطبيقات.

وخلال مؤتمر الشركة هذا الشهر عندما قدّمت «ذكاء أبل» شارك نائب الرئيس الأول لهندسة البرمجيات في الشركة، كريغ فيديريغي، الحضور بكيفية عمل النظام؛ سحب فيديريغي بريداً إلكترونياً من أحد زملائه يطلب منه تأجيل اجتماع، ولكنه كان من المفترض أن يذهب لمشاهدة مسرحية في تلك الليلة من بطولة ابنته. ثم قام هاتفه بسحب التقويم الخاص به، وهو مستنَد يحتوي على تفاصيل حول المسرحية، وتطبيق خرائط للتنبؤ بما إذا كان سيتأخر عن المسرحية إذا وافق على الاجتماع في وقت لاحق.

* تعهّد بمعالجة البيانات ضمن الأجهزة، قالت شركة «أبل» إنها تسعى جاهدة لمعالجة معظم بيانات الذكاء الاصطناعي مباشرة على هواتفها وأجهزة الكمبيوتر الخاصة بها، الأمر الذي من شأنه أن يمنع الآخرين، بما في ذلك «أبل» من الوصول إلى المعلومات.

* تشفير البيانات الموجّهة إلى السحابة، أما بالنسبة للمهام التي يجب دفعها إلى الخوادم، فقالت «أبل» إنها طوّرت ضمانات، بما في ذلك تشفير البيانات من خلال التشفير وحذفها على الفور، وأضافت أنها اتخذت أيضاً إجراءات حتى لا يتمكن موظفوها من الوصول إلى البيانات، وقالت أيضاً إنها ستسمح للباحثين الأمنيّين بمراجعة التكنولوجيا الخاصة بها؛ للتأكد من أنها تَفِي بوعودها.

إن التزام «أبل» بمسح بيانات المستخدم من خوادمها يميّزها عن الشركات الأخرى التي تحتفظ بالبيانات، وقال ماثيو غرين، الباحث الأمني والأستاذ المشارك في علوم الكمبيوتر بجامعة جونز هوبكنز، الذي أطلعَته شركة «أبل» على تقنيتها الجديدة، إن شركة «أبل» لم تكن واضحة بشأن طلبات «سيري» الجديدة التي يمكن إرسالها إلى خوادم الشركة. وقال إن أي شيء يترك جهازك هو بطبيعته أقل أماناً.

وقالت «أبل» إنه عندما يتم إصدار «Apple Intelligence» سيتمكن المستخدمون من رؤية تقرير بالطلبات التي تترك الجهاز لتتم معالجتها في السحابة.

ذكاء «مايكروسوفت» للكمبيوترات المحمولة

تعمل «مايكروسوفت» على جلب الذكاء الاصطناعي إلى أجهزة الكمبيوتر المحمول ذات الطراز القديم، وفي الأسبوع الماضي، بدأت في طرح أجهزة كمبيوتر تعمل بنظام «ويندوز» سُمّي «Copilot+ PC»، التي تبدأ أسعارها من 1000 دولار.

* رقائق تحمي الخصوصية، تحتوي أجهزة الكمبيوتر على نوع جديد من الرقائق، وغيرها من المعدّات، التي تقول «مايكروسوفت» إنها ستحافظ على خصوصية بياناتك وأمانها، يمكن لأجهزة الكمبيوتر إنشاء صور وإعادة كتابة المستندات، من بين ميزات أخرى جديدة مدعومة بالذكاء الاصطناعي.

* ميزة «التذكّر»، قدّمت الشركة أيضاً نظام «Recall»، وهو نظام جديد لمساعدة المستخدمين في العثور بسرعة على المستندات والملفات التي عملوا عليها، أو رسائل البريد الإلكتروني التي قرأوها، أو مواقع الويب التي تصفّحوها.

تقارن الشركة ميزة «Recall» بوجود ذاكرة فوتوغرافية مدمجة في جهاز الكمبيوتر الخاص بك، وباستخدامها يمكنك كتابة عبارات غير رسمية، مثل «أفكّر في مكالمة فيديو أجريتها مع جو مؤخراً عندما كان يحمل كوب قهوة مكتوب عليه (أنا أحب نيويورك)».

سيقوم الكمبيوتر بعد ذلك باسترداد تسجيل مكالمة الفيديو التي تحتوي على تلك التفاصيل، ولتحقيق ذلك تقوم هذه الميزة بوظيفة أخذ لقطات شاشة كل خمس ثوانٍ لما يفعله المستخدم على الجهاز، ويقوم بتجميع تلك الصور في قاعدة بيانات قابلة للبحث.

وقالت الشركة إنه يتم تخزين اللقطات وتحليلها مباشرة على جهاز الكمبيوتر، لذلك لا تقوم «مايكروسوفت» بمراجعة البيانات أو استخدامها لتحسين الذكاء الاصطناعي الخاص بها.

* مخاطر محتملة، ومع ذلك حذّر الباحثون الأمنيون من المخاطر المحتملة، موضّحين أن البيانات يمكن أن تكشف بسهولة كل ما كتبته أو شاهدته في حالات التسلل والاختراق. ورداً على ذلك قامت شركة «مايكروسوفت»، التي كانت تنوي طرح برنامج «Recall»، الأسبوع الماضي، بتأجيل إصداره إلى أجل غير مسمى.

وتأتي أجهزة الكمبيوتر الشخصية الحالية مزوّدة بنظام التشغيل «Windows 11» الجديد من «مايكروسوفت»، وقال ديفيد ويستون، المدير التنفيذي للشركة المشرف على الأمن إن الشركة تتمتع بطبقات متعددة من الأمان.

الذكاء الاصطناعي من «غوغل»

أعلنت «غوغل» الشهر الماضي أيضاً عن مجموعة من خدمات الذكاء الاصطناعي «Google AI».

* كاشف الاحتيال الهاتفي، كان أحد أكبر ما تم عرضه هو كاشف الاحتيال الجديد الذي يعمل بالذكاء الاصطناعي للمكالمات الهاتفية (AI-powered scam detector for phone calls)؛ إذ تستمع الأداة إلى المكالمات الهاتفية في الوقت الفعلي، وإذا بدا المتصل وكأنه محتال محتمَل (على سبيل المثال، إذا طلب المتصل رقم التعريف الشخصي المصرفي)، تقوم الشركة بإعلامك.

وقالت «غوغل» إنه سيتعيَّن على الأشخاص تنشيط كاشف الاحتيال، الذي يتم تشغيله بالكامل بواسطة الهاتف، وهذا يعني أن الشركة لن تستمع إلى المكالمات.

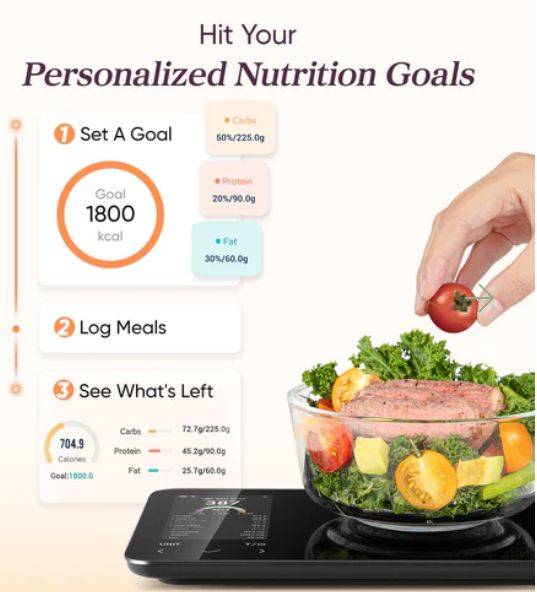

* «طلب الصور»، أعلنت «غوغل» عن ميزة أخرى، وهي «Ask Photos»، التي تتطلب إرسال المعلومات إلى خوادم الشركة، يمكن للمستخدمين طرح أسئلة مثل: «متى تعلمت ابنتي السباحة؟»، لظهور الصور الأولى لطفلتهم وهي تسبح، وقالت الشركة إن موظّفيها يمكنهم، في حالات نادرة، مراجعة محادثات «Ask Photos» وبيانات الصور لمعالجة الإساءة أو الأذى، ويمكن أيضاً استخدام المعلومات للمساعدة في تحسين تطبيق الصور الخاص بها.

وبعبارة أخرى: يمكن استخدام سؤالك وصورة طفلك أثناء السباحة؛ لمساعدة الآباء الآخرين في العثور على صور لأطفالهم وهم يسبحون.

* أمن السحابة، وأضافت «غوغل» أن سحابتها مغلقة بتقنيات أمنية، بما في ذلك التشفير والبروتوكولات للحد من وصول الموظفين إلى البيانات، وقالت سوزان فراي، المديرة التنفيذية في «غوغل» التي تشرف على الثقة والخصوصية، في بيان: «ينطبق نهجنا في حماية الخصوصية على ميزات الذكاء الاصطناعي لدينا، بغض النظر عما إذا كانت مدعومة على الجهاز أو في السحابة».

لكن غرين، الباحث الأمني، قال إن نهج «غوغل» فيما يتعلق بخصوصية الذكاء الاصطناعي يبدو غامضاً نسبياً. وقال: «لا أحب فكرة أن صوري الشخصية للغاية وعمليات البحث الشخصية للغاية تذهب إلى سحابة ليست تحت سيطرتي».

* خدمة «نيويورك تايمز».