في أبريل (نيسان) الماضي، تلقى صحافي في «الغارديان» رسالة بريد إلكتروني من باحث يطلب منه رابطاً لمقال كتبه قبل سنوات، بعدما اقترحه عليه روبوت الدردشة «تشات جي بي تي» أثناء إعداده بحثاً في مجال تخصصه، لكن الصحافي كريس موران، وهو رئيس قسم الابتكار التحريري في الصحيفة البريطانية، نفى صلته بهذا المقال.

وتثير هذه الحالة مخاوف بشأن إمكان تعرُّض قطاعات كبيرة من المستخدمين، ممن لا يدققون فيما يطرحه عليهم روبوت الدردشة القائم على الذكاء الاصطناعي، الذي ابتكرته شركة «أوبن إيه آي» الناشئة الأميركية، للتضليل والتعامل مع أخبار ونتائج «زائفة». وقبل أيام ضبطت الشرطة في الصين رجلاً استخدم التطبيق لضخّ «أخبار كاذبة» حول حادث قطار، وهي المرة الأولى التي يُحتجز فيها شخص بسبب «تشات جي بي تي»، وذلك بعد نحو 5 أشهر على انتشار روبوت الدردشة القادر على إنشاء نص مكتوب بأسلوب يشبه البشر.

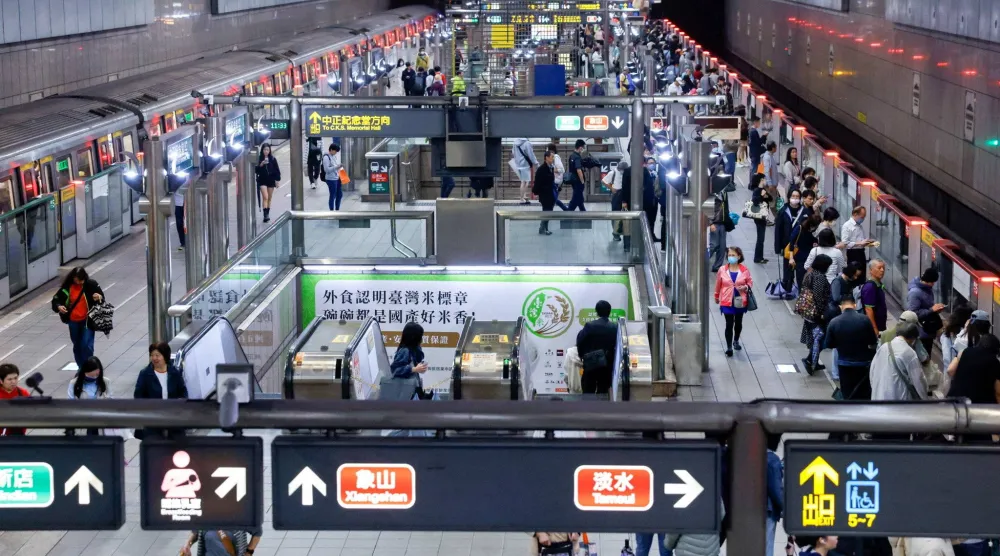

وعلى الرغم من أن الصين تحظر التطبيق، فإن توقيف الشخص كان بموجب قانون «التكنولوجيا المزيفة العميقة»، الذي دخل حيّز التنفيذ في يناير (كانون الثاني) الماضي، ويهدف إلى «منع إساءة استخدام التكنولوجيا». وذكر بيان للشرطة في منطقة هونغ كونغ، حيث أُشيع وقوع حادث قطار فيها، أن «وحدة شرطة الأمن السيبراني المحلية تلقّت إشارة بالخبر، وبدأت بموجبه تحقيقاً في الأمر، لتقودها إلى استخدام شخص لـ(تشات جي بي تي) لكتابة الخبر، الذي تناقله 21 حساباً على موقع (بايدو) المكافئ الصيني لـ(غوغل)».

وتمارس الصين «رقابة صارمة» على استخدام الإنترنت، وربما ساعدها ذلك في الوصول للشخص الذي استخدم التطبيق لإنتاج «الخبر الزائف».

وقال أستاذ الهندسة الميكانيكية ومدير برنامج الدراسات العليا في الروبوتات والتحكم والنظم الذكية بالجامعة الأميركية بالقاهرة، مكي حبيب، إنه «يمكن لهذه التقنية أن تُغرق مواقع التواصل الاجتماعي بمعلومات مضللة، وسيصبح من الصعب بشكل متزايد فصْل منشورات البشر عن تلك التي تم إنشاؤها بواسطة الذكاء الاصطناعي». وشدد مكي في تصريحات لـ«الشرق الأوسط» على «ضرورة وجود قوانين خاصة بكل دولة، تحدد مسؤولية الشخص الذي استخدم التطبيق لإنتاج الخبر، وأيضاً مسؤولية الشركة صاحبة التطبيق، باعتبار أنها مسؤولة عن تنقية المصادر التي تم تدريب التطبيق عليها، بحيث تكون مصادر موثوقاً فيها». وأضاف أن «هذا الجدل يظهر أيضاً في شكل آخر من تطبيقات الذكاء الاصطناعي، فلا تزال هناك حاجة لحسم المسؤولية عن وقوع حوادث عند استخدام السيارات ذاتية القيادة، فهل ستكون المسؤولية حينها على الشركة منتجة السيارة أم صاحب السيارة؟».

من جهته، قال الباحث في مجال الذكاء الصناعي في «جامعة النيل» الأهلية بمصر، مصطفى العطار، إن «كل هذه المشكلات التي يثيرها (تشات جي بي تي) سيتم حلها عبر تطبيق (زيرو جي بي تي) الذي يتم تطويره حالياً، وستكون مهمته الكشف عن مدى مصداقية المواد التي يتم إنتاجها». وأضاف العطار، في تصريحات لـ«الشرق الأوسط»، أن «التطبيق يعتمد على ما يعرف بـ(الشبكات التوليدية المتناقضة)، وهي باختصار تعني أن الذكاء الاصطناعي ينافس نفسه، ويتكون من شبكة توليدية للبيانات وأخرى تمييزية، حيث تتولى الأولى إنشاء بيانات جديدة، بينما تقوم الأخرى بالتمييز بين البيانات الحقيقية والمفبركة». ويشرح العطار آلية العمل، قائلاً إنه «تم تدريب الشبكة التوليدية على إنشاء حزمة من البيانات المفبركة، وبعدها تضاف إلى عدد مماثل من البيانات الحقيقية، ثم تُعرض على الشبكة التمييزية للتدريب، بهدف تقوية قدراتها على التفريق بين البيانات الحقيقية والمفبركة، وتتكرر هذه الخطوات حتى تتحسن قدرة الشبكة التوليدية». وأشار إلى أنه «بعد سنوات يمكن لكل المواقع الإخبارية استخدام الخوارزميات التي تعمل بالشبكات التوليدية المتناقضة، بحيث يظهر في نهاية كل خبر تقييم لمدى دقته باستخدام تلك الشبكات، وقد نحتاج وقتها إلى تشريع يلزم المواقع الصحافية باستخدام هذه الخوارزميات». ونوَّه بأن «الأمر نفسه ينطبق على مواقع التواصل الاجتماعي التي لديها خوارزميات حالية للتفريق بين الأخبار الدقيقة والكاذبة، باستخدام معايير مثل معدل انتشار الخبر ومدى انتشاره الجغرافي، ومن خلال تطبيق هذه المعايير تكون هناك (بصمة للخبر الصحيح) تُميّزه عن الكاذب، ولكنها قد تحتاج مع التطور في تقنيات الذكاء الاصطناعي أن تطوّر هي الأخرى من خوارزميات كشف البيانات الكاذبة».

وحول مسؤولية الشركة المنتجة للتطبيق عن المصادر التي تم تدريب الخوارزميات عليها، لضمان أن تكون مصادر موثوقاً بها، يعتقد العطار أن «النماذج الأحدث من التطبيق ستتجاوز كل تلك الأخطاء، وهذه هي الفكرة من تحديث التطبيقات».