في خطوة جديدة تشير إلى تحول عميق في مشهد الذكاء الاصطناعي، كشفت «أوبن إيه آي (OpenAI)»، اليوم الجمعة، عن نسخة رائدة من نموذجها «تشات جي بي تي (ChatGPT)»، مزودة الآن بقدرات وكيلية متطورة. الأمر لا يقتصر على المحادثات الأكثر ذكاءً؛ بل يتعلق بذكاء اصطناعي يمكنه اتخاذ المبادرة، وتنفيذ المهام المعقدة من البداية إلى النهاية، والتفاعل مع العالم الرقمي باستخدام حاسوبه الافتراضي الخاص به. تمثل هذه التطورات خطوةً مهمةً نحو أنظمة الذكاء الاصطناعي المستقلة، والتخطيط الاستراتيجي داخل صناعة التكنولوجيا.

يُدمج النظام الجديد بسلاسة قدرات «المشغل (Operator)»، وهي أداة معروفة بالتفاعل الآلي مع صفحات الويب، مع مهارات «البحث العميق» المُصمَّمة لتحليل البيانات وتلخيصها بشكل متعمق. والأهم من ذلك، أنه يدمج هذه الإمكانات مع الذكاء التفاعلي لجوهر «ChatGPT» في المحادثة.

والنتيجة هي نظام وكيل متكامل قادر على تنفيذ مهام متعددة ومتصلة بشكل مستقل، والتنقل بمرونة بين التفكير والعمل بناءً على تعليمات المستخدم فقط. وصف سام ألتمان، الرئيس التنفيذي لشركة «OpenAI» الإعلان بأنه لحظة «تشبه الذكاء الاصطناعي العام (AGI)»، في تلميح إلى مستقبل؛ حيث يقوم الذكاء الاصطناعي «بأشياء في العالم الحقيقي من أجلك».

كيف يعمل الوكيل الجديد؟

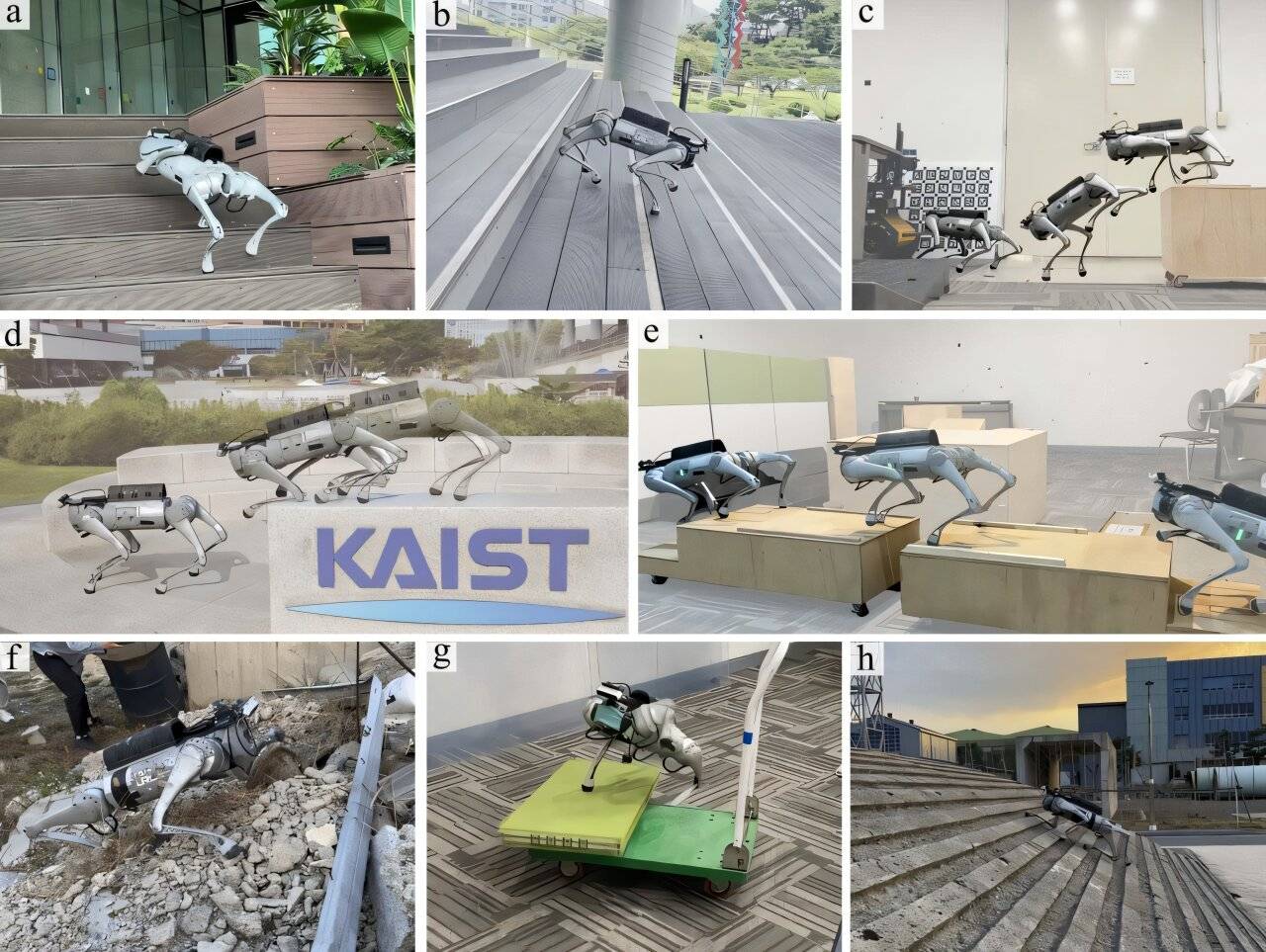

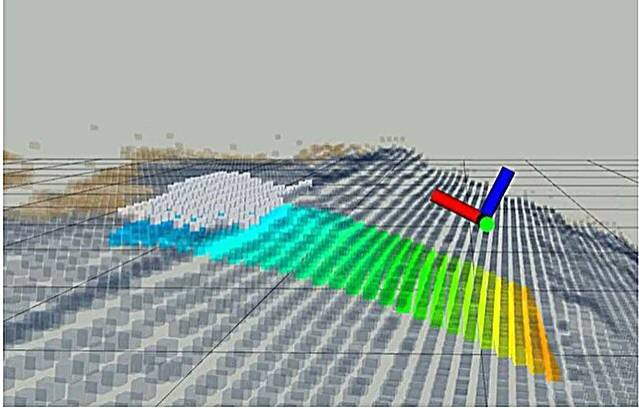

في قلب هذا الابتكار يوجد نموذج جديد وقوي مدرب خصيصاً على المهام متعددة الأدوات. وهذا يسمح لوكيل «ChatGPT» باختيار مجموعة من الأدوات واستخدامها بذكاء، بما في ذلك متصفح بصري للواجهات الرسومية، ومتصفح قائم على النصوص لاستعلامات الويب التي تتطلب تفكيراً عميقاً، وطرفية لتنفيذ التعليمات البرمجية، ووصول مباشر إلى واجهة برمجة التطبيقات (API). من خلال دمج هذه الوظائف التي كانت متميزة سابقاً، أطلقت «OpenAI» العنان لقدرات جديدة تماماً. على سبيل المثال، يمكن للوكيل الآن التفاعل بنشاط مع مواقع الويب كالنقر والتصفية وجمع معلومات دقيقة، وحتى التعامل الآمن مع عمليات تسجيل الدخول تحت إشراف المستخدم.

يتميز هذا الوكيل بقدرته على العمل داخل بيئته الحاسوبية الافتراضية الخاصة به. وهذا يعني أنه يمكنه الحفاظ على السياق عبر أدوات مختلفة، وفتح صفحات في متصفحات متنوعة، وتنزيل الملفات ومعالجتها عبر أوامر الطرفية، ثم عرض النتائج بتنسيق سهل القراءة والتعديل، مثل جداول البيانات أو العروض التقديمية.

التأثير في العالم الحقيقي

الآثار المترتبة على الإنتاجية الشخصية والمهنية هائلة. تم تصميم وكيل «تشات جي بي تي» لأتمتة مجموعة واسعة من الأنشطة التي تتطلب عادةً التبديل بين تطبيقات متعددة وعلامات تبويب المتصفح والعمليات اليدوية. تتضمن الأمثلة على ما يمكنه التعامل معه الآن بسهولة:

- إدارة التقويم: قراءته،وإطلاعك على اجتماعات العملاء المقبلة، والربط بالاستخبارات الحديثة أو المستندات ذات الصلة.

- التخطيط والمشتريات: تخطيط وجبة، وتصميم حفل عشاء وحتى شراء المكونات الضرورية عبر الإنترنت.

- تحليل الأعمال: تحليل المنافسين المتعددين وتجميع عرض تقديمي شامل، أو تعديل جداول البيانات ببيانات مأخوذة مباشرة من الويب.

- تجميع المعلومات: تلخيص صناديق البريد الوارد، وإيجاد أوقات فراغ للاجتماعات، وتوليد تقارير من مصادر بيانات متباينة.

التوفر والتحكم للمستخدم

تطرح «OpenAI» وكيل «ChatGPT» تدريجياً، بدءاً بمستخدمي الخطط «برو (Pro)»، و«بلس (Plus)»، و«تيم (Team)» عالمياً. ومن المقرر أن يحصل عملاء «إنتربرايس (Enterprise)»، و«إديوكايشون (Education)» على الوصول في الأسابيع المقبلة. والأهم من ذلك أن «OpenAI» شدَّدت على تحكم المستخدم والسلامة. يمكن للمستخدمين تفعيل «وضع الوكيل» مباشرة داخل أي محادثة في «ChatGPT». يقوم الوكيل بسرد أنشطته على الشاشة، مما يوفر رؤيةً كاملةً لأفعاله. يمكن للمستخدمين مقاطعة الوكيل في أي وقت لتوضيح التعليمات، أو تقديم تفاصيل إضافية، أو حتى التحكم المباشر في المتصفح الافتراضي، مما يضمن بقاءهم مسيطرين.

معالجة المخاطر الجديدة والضمانات

إن إطلاق ذكاء اصطناعي قادر على اتخاذ إجراءات في العالم الحقيقي يثير بشكل طبيعي اعتبارات أمان جديدة ومعقدة. تقر «أوبن إيه آي» بهذه «المخاطر الجديدة»، خصوصاً فيما يتعلق بمعالجة المعلومات الحساسة على الويب المباشر والنطاق الأوسع للوكيل. وتذكر الشركة أنها عزَّزت بشكل كبير الضوابط الحالية، ونفَّذت ضمانات جديدة تشمل:

- تأكيد المستخدم الصريح للإجراءات ذات العواقب الحقيقية (مثل إجراء عملية شراء).

- متطلبات الإشراف النشط للمهام الحرجة مثل إرسال رسائل البريد الإلكتروني.

- تدريب رفض استباقي للأنشطة عالية المخاطر، مثل التحويلات المصرفية، والتي تم تصميم الوكيل لرفضها تماماً.

-حماية قوية ضد هجمات «حقن الأوامر (prompt injection)»، حيث يمكن لتعليمات ضارة مخبأة داخل صفحات الويب أن تخدع الوكيل لارتكاب أفعال غير مقصودة أو مشاركة بيانات خاصة.

- ضوابط خصوصية تسمح للمستخدمين بحذف جميع بيانات التصفح وتسجيل الخروج من جلسات مواقع الويب النشطة بنقرة واحدة.

نقلة نوعية... ومخاوف أمنية

وقد صنفت «أوبن إيه آي» وكيل «تشات جي بي تي» على أنه يمتلك «قدرات بيولوجية وكيميائية عالية» بموجب إطار عمل الجاهزية الخاص بها، وقامت بتفعيل الضمانات المرتبطة به والعمل مع خبراء الأمن البيولوجي، مما يدل على نهج حذر للتخفيف من مخاطر الاستخدام المزدوج المحتملة، حتى في غياب دليل قاطع على احتمالية وقوع أضرار جسيمة.

يرى البعض أن هذا الإطلاق هو أكثر من مجرد تحديث لميزة؛ إنه لحظة محورية في تطور الذكاء الاصطناعي. إنه يمثل انتقالاً من الذكاء الاصطناعي بوصفه أداةً تفاعليةً إلى كيان مستقل وفعال. ويقول كيفن ويل، كبير مسؤولي المنتجات في «OpenAI»، سابقاً، إن عام 2025 هو العام الذي ننتقل فيه من «ChatGPT» بوصفه شيئاً ذكياً للغاية يمكنه الإجابة عن أي سؤال تطرحه إلى «ChatGPT» الذي يقوم بأشياء في العالم الحقيقي من أجلك.