* تشمل دورات الأكاديمية الأمن السيبراني والمعلوماتية الحيوية وعلوم المواد وتحليلات الأعمال والاستدامة وإنترنت الأشياء والروبوتات.

------------

تبذل أكاديمية جامعة الملك عبد الله للعلوم والتقنية (كاوست) جهودا مضنية في سبيل تعزيز ونقل التقنية في المملكة العربية السعودية، إذ تقوم بتدريب الطلبة الجامعيين والرؤساء التنفيذيين لرفع مستوى المعرفة العلمية والتقنية، بهدف دفع عجلة التنمية الاقتصادية والتقنية للمملكة.

الذكاء الاصطناعي يغيّر العالم

تؤرخ فترة الخمسينات والستينات من القرن الماضي لميلاد الذكاء الاصطناعي (AI)، حيث ظهر كأنه مجال تخصصي لأول مرة في عام 1950. في تلك السنة اقترح عالم الرياضيات وعالم الكمبيوتر البريطاني آلان تورينغ فكرة «آلة عالمية» قادرة على تقليد سلوك أي آلة أخرى، والتي عرفت لاحقا باسم «آلة تورينغ». كان وضع هذا المفهوم هو الأساس لتطوير الذكاء الاصطناعي.

اليوم تضج وسائل الإعلام بكثير من النقاشات والجدل حول الذكاء الاصطناعي ومدى تأثيره على حياتنا، وكيف سيغير عالمنا بشكل كبير والتي ستطال عددا كبيرا من المجالات منها على سبيل المثال:

- في سوق الوظائف يمكن لتقنيات الذكاء الاصطناعي أتمتة المهام المتكررة مما سيتطلب تحولا في سوق العمل.

- أما في مجال الرعاية الصحية والطب فيمكن أن تساعد هذه التقنيات في تشخيص الأمراض بشكل أكثر دقة وسرعة، والمساعدة في تطوير العلاجات الشخصية، وتحليل كميات هائلة من البيانات الطبية لتحديد الأنماط وتحسين نتائج المرضى.

- وفي مجال النقل سوف نشهد تزايد عدد السيارات ذاتية القيادة وأيضا تحسين شبكات النقل والتنبؤ بأنماط الطلب وتمكين الخدمات اللوجيستية وإدارة سلسلة التوريد بكفاءة.

- وفي مجال التعليم يمكن للذكاء الاصطناعي تخصيص تجربة التعلم وتعزيزها من خلال تكييف المواد والأساليب التعليمية مع احتياجات وقدرات الطلاب الفردية.

- كما يمكن للذكاء الاصطناعي أن يساهم في جهود الاستدامة من خلال تحسين استهلاك الطاقة وتحسين إدارة الموارد والمساعدة في مراقبة البيئة والحفاظ عليها. ويمكنه تحليل مجموعات البيانات الكبيرة لتحديد الأنماط والتنبؤ بالتغيرات البيئية، والمساعدة في نمذجة المناخ وإدارة الكوارث الطبيعية.

- ومع تقدم التقنية، تزداد التهديدات التي يتعرض لها الأمن السيبراني، وهنا يمكن للذكاء الاصطناعي تعزيز الدفاعات عن طريق تحديد التهديدات المحتملة والتخفيف من حدتها بسرعة. كما يمكن لخوارزميات التعلم الآلي اكتشاف أنماط النشاط الضار وتحديد نقاط الضعف وتقوية أنظمة الأمان.

نقل التقنية

يعد الذكاء الاصطناعي والتعلم الآلي من الموضوعات ذات الأهمية بالنسبة للمملكة العربية السعودية لكونه يؤدي دوراً مركزياً في تحقيق «رؤية السعودية 2030» فيما يتعلق بإنشاء اقتصاد المعرفة وتطوير مجتمع قائم على المهارات.

لدعم هذا التوجه أطلقت «كاوست» أكاديميتها في مايو (أيار) 2022 والتي صممت للارتقاء المستمر بالمهارات التقنية في سوق العمل وإعداد قوى عاملة سعودية ماهرة في عالم متسارع تحركه التقنية، ولتكون عاملاً مساعداً للابتكارات من أجل التعلم.

يقول مدير الأكاديمية، الدكتور سلطان البركاتي: «تُعزز الأكاديمية حضور (كاوست) في المجتمع السعودي، وتيسر من وصول التعليم إلى المشاركين، وتساعدهم على اكتساب مهارات تقنية جديدة». ويضيف «نستهدف الإسهام في نمو اقتصاد البلاد - سريع التحوّل - ومساعدة القوى العاملة على تلبية متطلبات كل من: (رؤية السعودية 2030)، و(رؤية 2050) المقدمة من مجلس الأعمال العالمي للتنمية المستدامة».

ومنذ أن أطلقت الأكاديمية نشاطها، دربت على مدار عام أكثر من 2000 شخص؛ حيث شهدت برامج التدريب تنوعاً كبيراً، بداية من معسكرات تدريب قصيرة مدتها خمسة أيام، وصولاً إلى برامج دراسة ماجستير، مُصممة خصيصاً بدعم من كبار أعضاء هيئة التدريس، فضلاً عن شركاء من جهات حكومية ومجالات الصناعة والأعمال. وتُقام المعسكرات خلال العطلات الجامعية في جدة والرياض والظهران في المنطقة الشرقية من المملكة العربية السعودية.

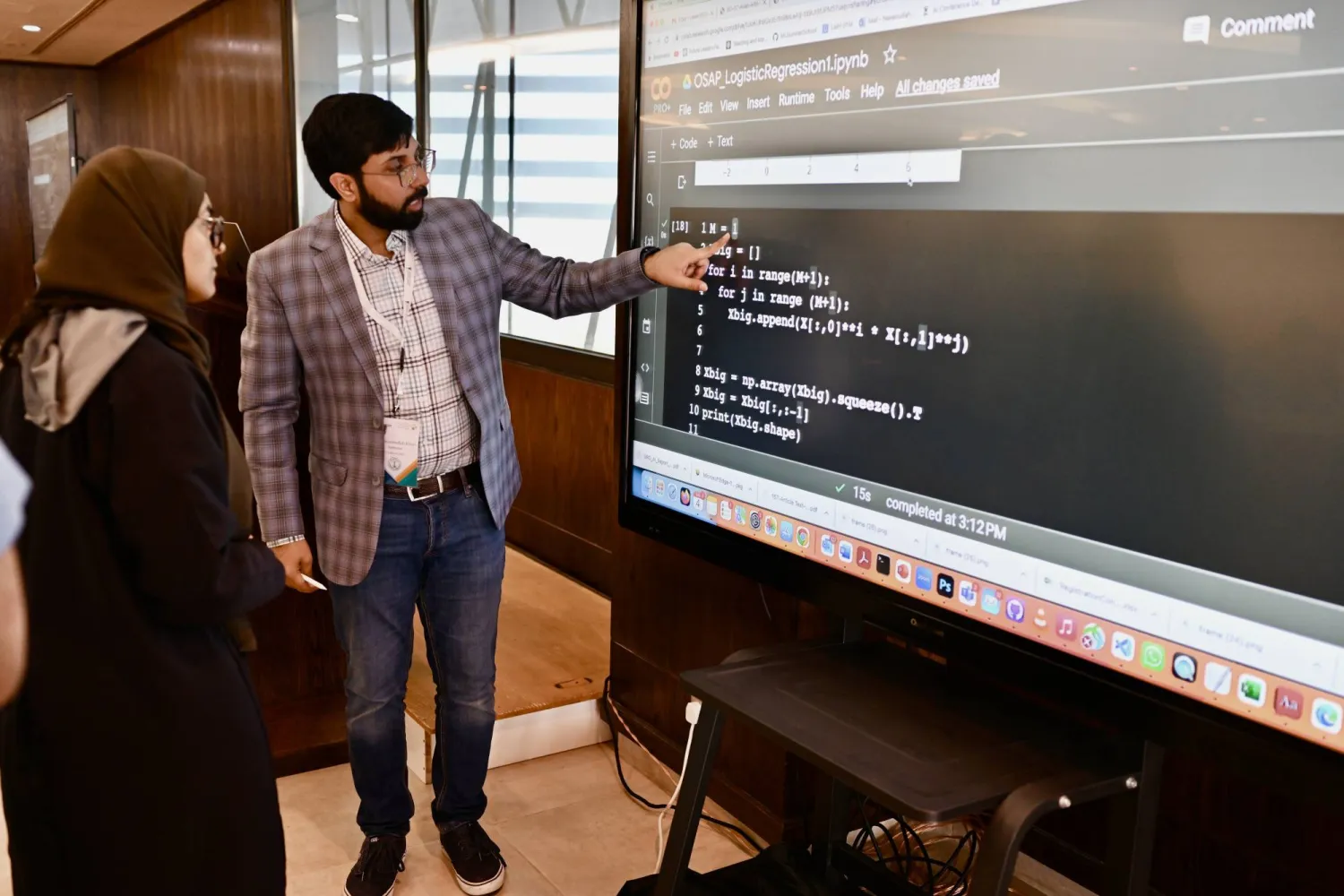

وانتهت الأكاديمية أخيراً من معسكر تدريب الذكاء الاصطناعي، المُصمم لـ 1000 طالب جامعي. توضح الدكتورة ألكسندرا غوميز، المحاضرة في قسم العلوم والهندسة الحاسوبية والكهربائية بالجامعة: «يمنح المعسكر التدريبي الفرصة للطلاب؛ لاكتساب المهارات الأساسية التي يحتاجون إليها، لتطبيق تقنيات التعلُّم الآلي، والتعلُّم العميق لحل المشكلات».

ماذا يقول المتدربون؟

عبر مزيج من الجلسات التدريبية النظرية والعملية، أنهى أحمد محمد، الطالب في جامعة الملك فهد للبترول والمعادن، المعسكرات التمهيدية والمتقدمة في برنامج الذكاء الاصطناعي، واصفاً التدريب بأنه «لا يقدر بثمن».

يقول محمد: «تأثرت للغاية بإجمالي الدورات التدريبية، إذ أمضينا ساعات معاً في التعلُّم النظري، ثم تنفيذ ما تعلمناه في ورش عمل عملية مع بقية الطلاب، مما سمح بتبادل المعارف فيما بيننا».

من جانبه، أعرب الطالب حسين الصيحة أيضاً من جامعة الملك فهد للبترول والمعادن، عن تقديره لروح التعاون، إذ يقول: «قُدمت الدورة بطريقة ساعدتنا على فهم المادة، مع السماح لنا بالتواصل الاجتماعي وتوسيع علاقاتنا».

طلال الخراشي، وهو حديث العهد بملكية أحد منتجات الذكاء الاصطناعي، يقول: «كانت التجربة رائعة. في كل يوم كنت أشعر أنني تعلمت شيئاً جديداً، أو عززت معرفتي في المجالات التي أعرفها بالفعل. لقد ساعدني اكتساب هذا الفهم العميق لأساسيات الذكاء الاصطناعي في تشكيل المنتج الذي أبيعه وتحسينه بعدة طرق».

ومشيداً بنمط الدورة المكثف، يقول الخراشي: «لقد كان يوماً كاملاً من التعلُّم، والممارسة العملية الخالصة، تجربة جديدة بالنسبة لي، وساعدتني على فهم الدورة التدريبية والانغماس فيها».

ابتعاث خارجي

بعد انتهاء المعسكر التدريبي التمهيدي، يتم اختيار الطلاب المتفوقين لحضور دورة متقدمة في الذكاء الاصطناعي، بعد ذلك، يُعرض على حوالي 15 طالباً منهم، الحصول على مقعد في معسكر تدريبي صيفي في جامعة أكسفورد البريطانية، أو تدريب داخلي في «كاوست»، وذلك بفضل رعاية اثنين من شركاء الأكاديمية.

بموازاة ذلك، تُقدم الأكاديمية أيضاً درجة الماجستير المهنية في الذكاء الاصطناعي للعاملين في القوى العاملة، حيث تم قبول أول دفعة من موظفي وزارة الداخلية في وقت سابق من هذا الشهر. وفي الوقت نفسه، تجرب حالياً درجة الماجستير المهنية في علوم البيانات والتحليلات مع «أرامكو»، ومن المقرر أن تكمل المجموعة الأولى الدورة التدريبية التي تستغرق 18 شهراً في الرياض في يوليو (تموز)2023.

بإمكان الأكاديمية تصميم دورات بعينها للعملاء والمؤسسات، بناءً على احتياجاتهم، على سبيل المثال؛ في دورة الذكاء الاصطناعي للكيميائيين، التي صممت لشركة «أرامكو»، ركزت الدورة على تطبيقات الذكاء الاصطناعي في الكيمياء، وتضمنت أمثلة ومجموعات بيانات من تطبيقات الكيمياء الواقعية.

تنظم الأكاديمية حالياً دورات في الأمن السيبراني، والمعلوماتية الحيوية، وعلوم المواد، والرياضيات التطبيقية والحاسوبية وتحليلات الأعمال، إلى جانب دورتين إضافيتين من المقرر إطلاقهما في عام 2023. تغطي هاتان الدورتان الاستدامة، وإنترنت الأشياء (IoT) والروبوتات.

كما تتضمن قائمة شركاء أكاديمية «كاوست»: الهيئة السعودية للبيانات والذكاء الاصطناعي (سدايا)، والهيئة الوطنية السعودية للأمن السيبراني (NCA)، وصندوق التنمية الصناعية السعودي (SIDF)، ومستشفى الملك فيصل التخصصي (KFSH)، والشركة السعودية للصناعات الأساسية (سابك)، و«أرامكو»، فضلاً عن مشاركة بعض الوزارات السعودية.