بعد يومين من انتخاب دونالد ترامب، وجد مارك زوكربيرغ نفسه على صفيح ساخن.

هاجم صحافي خلال مؤتمر تقني الرئيس التنفيذي لـ«فيسبوك» على خلفية الأخبار المكذوبة التي نشرها الموقع، مشيرًا إلى أن ذلك قد رجح كفة ترامب في الانتخابات. ومن تلك الأخبار على سبيل المثال دعم البابا فرنسيس لمرشح الحزب الجمهوري.

على الجانب سخر زوكربيرغ من هذا الأمر قائلا: «أنا شخصيًا أعتقد أن فكرة تأثير الأخبار المكذوبة على موقع (فيسبوك)، والتي لا تمثل سوى جزء صغير من المحتوى الموجود على الموقع، على نتيجة الانتخابات بأي شكل من الأشكال فكرة مجنونة جدًا. لقد اتخذ الناخبون قرارهم بناء على تجاربهم الحياتية المعيشة». مع ذلك منذ ذلك الحين بدأ موقع فيسبوك، الذي واجه نيران الانتقادات، التي تشمل هجومًا من الرئيس أوباما الذي انتقد وباء الأخبار المغلوطة الأسبوع الماضي، في اتخاذ بعض الخطوات الإيجابية.

وخلال مناقشة مباشرة على موقع «فيسبوك»، أوضحت الصحافية كاتلين ديوي كيف تستخدم مواقع الأخبار الزائفة «فيسبوك» كوسيلة لتحقيق مكاسب. ونشر زوكربيرغ يوم الجمعة الماضي رسالة توضح إدراكه لمدى جدية وخطورة المشكلة، وشرح كيف سيتعامل موقع «فيسبوك» مع الأمر. وذكر خدمات التحقق من خلال طرف ثالث، وطرق أفضل تتيح للمستخدمين الإبلاغ عن عمليات الخداع، ومحاولات منع مواقع الأخبار الزائفة من تحقيق أرباح من الإعلانات. ويعد هذا تقدمًا مشكورًا.

حان الآن وقت القيام بخطوة أكثر جرأة، وهي تعيين مسؤول تحرير تنفيذي، ومنحه كافة الصلاحيات، والموارد، وفريق عمل، يمكّنه من اتخاذ قرارات تحريرية سليمة. قد لا يريد زوكربيرغ إطلاق صفة «محرر» على هذا الشخص، نظرًا لإصراره على أن «فيسبوك» ليس شركة إعلامية، بل يراه شركة تختص بالتكنولوجيا ومنصة للاتصال. صحيح أن موقع «فيسبوك» ذاته لا يقدم محتوى خبري، لكنه يسمح لأعضائه بمشاركة أخبار خاصة بهم سواء كان ذلك صورًا لأطفال أو أكاذيب عن مرشحين سياسيين. لا بأس إذًا، يمكن إطلاق مسمى كبير مسؤولي المشاركات على ذلك الشخص. وأي كان المسمى الوظيفي لهذا الشخص، يحتاج موقع «فيسبوك» إلى شخص قادر على التمييز بين صورة حاصلة على جائزة بوليتزر للصحافة وبين صور إباحية، وكذلك قادر على التمييز بين أكاذيب لا أساس لها من الصحة، وقصة استقصائية محققة تقوم على أسانيد. ما يحكم سير الأمور على «فيسبوك» هو المشاركة، بمعنى أنه كلما زادت مشاركة الأعضاء لمحتوى ما، زاد احتمال رؤيتك له. من الواضح أن هذا ليس كافيًا، فالإجراء الضروري من أجل القضاء على الأخبار المكذوبة هو التحقق منها بدقة باستخدام المنطق السليم. وتعد الشركة العملاقة في وادي السيليكون، والذي يربو عدد مستخدميها على المليار، مصدرًا كبيرًا للأخبار، بل والمصدر الأهم بالنسبة إلى بعض الفئات الديموغرافية. ويسير تأثير الموقع دائمًا في اتجاه واحد مستمر هو الأعلى. من المفهوم ألا ترغب شركة «فيسبوك» في التحول إلى جهة رقابة، ولا ينبغي لها ذلك.

عندما قال زوكربيرغ مؤخرًا إن اكتشاف الحقيقة أمر صعب، كان جواب بين سميث، رئيس تحرير «باز فيد»: «قد يصدق ذلك على اللوغاريتمات وعلم الجمال، لكن هذا أمر مطلوب من الصحافيين المحترفين عمله يوميًا، وهو ليس بهذا القدر من التعقيد».

أهم ما في الأمر هو الحكم خاصة الذي لا يمكن الوصول إليه من خلال شفرة معقدة أو من خلال الاعتماد على «معايير مجتمعية» مقصدها طيب، لكنها مبهمة. لم تظهر الحاجة إلى حكم تحريري على موقع «فيسبوك» مع حملة الانتقادات التي تعرض لها الموقع بعد الانتخابات؛ بل هي حاجة تتجلى منذ أشهر طويلة. على سبيل المثال، خلال الصيف الماضي استخدمت سيدة من ولاية مينيسوتا، تدعى دياموند رينولدذ، هاتفها الذكي في بثّ مشهد مروع على موقع «فيسبوك». وظهر صديقها فيلاندو كاستيل في ذلك المشهد بعد إطلاق النار عليه من قبل ضابط شرطة. وتم حذف مشاركتها بعد ساعة تقريبًا من نشرها، وصرح موقع «فيسبوك» أن ذلك كان بسبب خطأ فني، ثم تم إعادة نشر الصورة مرة أخرى. وفي سبتمبر (أيلول)، حذف موقع «فيسبوك» صورة حاصلة على جائزة بوليتزر لفتاة فيتنامية تهرب من هجوم بالنابالم بسبب مخالفتها لمعايير الموقع الخاصة بتعرية الجسد، والمحتوى الإباحي الخاص بالأطفال. وعندما أثار ذلك الفعل موجة عالمية من الغضب، تم إعادة نشر الصورة.

ودعت إميلي بيل، مديرة مركز «تو» للصحافة الرقمية في جامعة كولومبيا، زوكربيرغ إلى تغيير رأيه بشأن دور موقع «فيسبوك» في البيئة الإعلامية. وكتبت في دورية الصحافة بالجامعة: «من خلال الاعتراف بأن موقع فيسبوك قادر على لعب دور أكثر فعالية في التحرير بل ومطالب بذلك، وتعيين أشخاص حقيقيين للقيام بهذه المهمة، سوف يحدث زوكربيرغ تأثيرًا على المصادر المدنية، وكذلك سيتمكن من معالجة مشكلة متنامية تتمثل في كيفية إدراك الناس لموقع فيسبوك».

وخلال الأسبوع الماضي اقترح كل من المؤلف جيف جارفيز، وجون بورثويك، صاحب المشروعات التكنولوجية الرائدة، 15 طريقة لمكافحة وباء الأخبار المكذوبة، ومن بينها الاستعانة ببعض المحررين: «لا تأليف محتوى، ولا القيام بعملية تحرير، بل الاضطلاع بمسؤولية اجتماعية عامة تجاه شركتهم ومنتجهم».

* خدمة «نيويورك تايمز»

9:39 دقيقه

هل «فيسبوك» بحاجة إلى محرر تنفيذي لوقف الأخبار الكاذبة؟

https://aawsat.com/home/article/794231/%D9%87%D9%84-%C2%AB%D9%81%D9%8A%D8%B3%D8%A8%D9%88%D9%83%C2%BB-%D8%A8%D8%AD%D8%A7%D8%AC%D8%A9-%D8%A5%D9%84%D9%89-%D9%85%D8%AD%D8%B1%D8%B1-%D8%AA%D9%86%D9%81%D9%8A%D8%B0%D9%8A-%D9%84%D9%88%D9%82%D9%81-%D8%A7%D9%84%D8%A3%D8%AE%D8%A8%D8%A7%D8%B1-%D8%A7%D9%84%D9%83%D8%A7%D8%B0%D8%A8%D8%A9%D8%9F

هل «فيسبوك» بحاجة إلى محرر تنفيذي لوقف الأخبار الكاذبة؟

رئيسه مارك زوكربيرغ على سطح صفيح ساخن

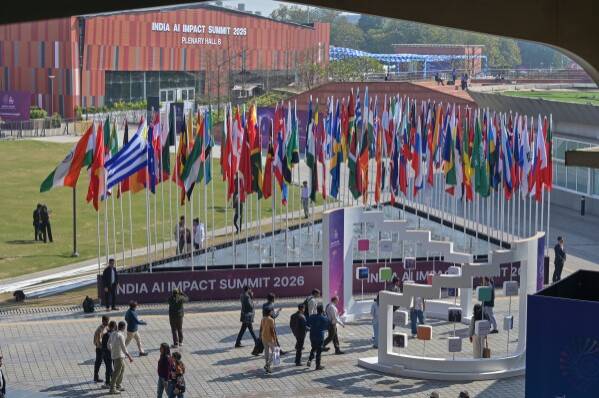

ضغوط على مارك زوكربيرغ مؤسس «فيسبوك» بعد الانتخابات الأميركية (واشنطن بوست)

- واشنطن: مارغريت سوليفان

- واشنطن: مارغريت سوليفان

هل «فيسبوك» بحاجة إلى محرر تنفيذي لوقف الأخبار الكاذبة؟

ضغوط على مارك زوكربيرغ مؤسس «فيسبوك» بعد الانتخابات الأميركية (واشنطن بوست)

لم تشترك بعد

انشئ حساباً خاصاً بك لتحصل على أخبار مخصصة لك ولتتمتع بخاصية حفظ المقالات وتتلقى نشراتنا البريدية المتنوعة