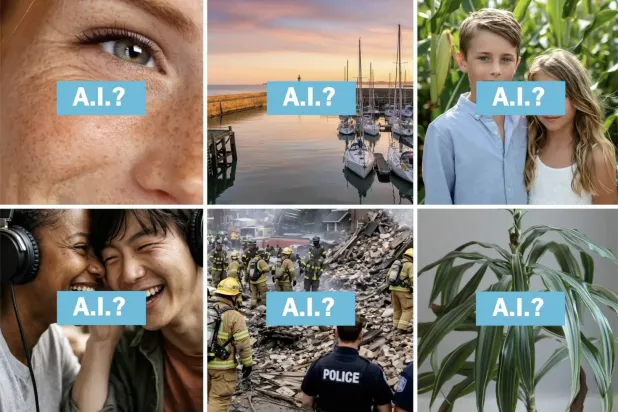

عندما صنعت شركات التقنية نظم التعرف على الوجه التي تعيد اليوم بسرعة رسم شكل المراقبة الحكومية، وتشوه خصوصية الناس، تلقت المساعدة من مصدر غير متوقع... هو وجوهكم.

كشف إلكتروني

استخدمت الشركات والجامعات والمختبرات الحكومية ملايين الصور التي جمعتها من عدة مصادر إلكترونية لتطوير هذه التقنية. أما اليوم، فيعمل الباحثون على تطوير أداة إلكترونية جديدة، اسمها «إكسبوزينغ إيه آي» (Exposing.AI) (نظام الذكاء الصناعي: «الفضح»)، تتيح للناس البحث عن مجموعات الصور التي تشكلت من صورهم القديمة.

وتفتح هذه الأداة التي تطابق الصور مع محتوى خدمة «فليكر» نافذة على كم البيانات الهائل الذي يتطلبه بناء مجموعة متنوعة من تقنيات الذكاء الصناعي، من نظم التعرف على الوجه إلى روبوتات المحادثة أو ما يعرف بــ«التشات بوت».

تقول ليز أوسوليفان، أحد معدي هذه الأداة مديرة التقنية في مجموعة «مشروع مراقبة تقنيات المراقبة» المدافعة عن الحقوق المدنية والخصوصية: «على الناس أن يدركوا أن لحظاتهم الحميمة باتت تستخدم سلاحاً».

شاركت أوسوليفان في تطوير «إكسبوزينغ إيه آي» مع باحث فنان من برلين يُدعى آدم هارفي.

ولا تصبح النظم التي تستخدم الذكاء الصناعي ذكية بشكلٍ سحري، بل تتعلم من خلال التحديد الدقيق للأنماط المطلوبة في البيانات الصادرة عن البشر، كالصور والتسجيلات الصوتية والكتب ومقالات موسوعة «ويكيبيديا» الإلكترونية وجميع أنواع المواد. وتزداد هذه التقنية تحسناً مع الوقت، ولكنها تتعلم أيضاً التمييز ضد النساء والأقليات.

قد لا يعي الناس أنهم يساهمون في تعليم الذكاء الصناعي. يشكل هذا الأمر نوعاً من الفضول لبعضهم، بينما يشعر آخرون بالريبة منه، لا سيما أنه قد يكون أحياناً منافياً للقانون. وكانت ولاية إلينوي الأميركية قد أقرت عام 2008 قانون خصوصية المعلومات البيومترية (القياسات البيولوجية) الذي يفرض غرامات مالية على من يستخدم مسوحات وجوه سكانها دون الحصول على موافقتهم.

وفي 2006، حمل بريت غايلور، صانع أفلام وثائقية من فيكتوريا (كولومبيا البريطانية)، صور شهر عسله على منصة «فليكر» التي كانت شعبية في ذلك الوقت. وبعد مرور 15 عاماً تقريباً، وباستخدامه لنسخة أولية من أداة «إكسبوزينغ إيه آي»، اكتشف هارفي أن مئات من هذه الصور قد وجدت طريقها إلى عدد من القواعد البيانية التي تُستخدم لتدريب نظم التعرف على الوجه حول العالم.

لقد سمحت منصة «فليكر» التي باعتها واشترتها شركات كثيرة خلال السنوات الماضية، آخرها خدمة «سماغ ماغ» لمشاركة الصور، لمستخدميها بمشاركة صورهم، بموجب ما يُعرف برخصة «كرييتف كومونز» الشائعة على المواقع الإلكترونية التي تسمح للآخرين باستخدام الصور بضوابط محددة، غالباً ما يتم تجاهلها. وفي عام 2014، استغل موقع «ياهو» الذي كانت تملكه «فليكر» في ذلك الوقت كثيراً من هذه الصور في قواعد بيانات مصممة للمساعدة في مشاريع الرؤية الكومبيوترية.

وتساءل غايلور (43 عاماً): كيف انتقلت هذه الصور من مكانٍ إلى آخر، فقيل له إنها استخدمت ربما في نظم المراقبة في الولايات المتحدة ودولٍ أخرى، وإن أحد هذه النظم صُمم لتعقب بعض الأقليات في دول أخرى، مثل الصين.

نظم مراقبة

كيف يمكن لصور التقطت في شهر عسل أن تساعد في بناء نظم مراقبة في الصين، وتتحول بطريقة ما إلى قصة ذات عواقب غير مقصودة أو محمودة.

قبل سنوات، بدأ باحثون في مجال الذكاء الصناعي في جامعات وشركات تقنية بارزة بجمع صور رقمية من مجموعة واسعة متنوعة من المصادر، بينها خدمات مشاركة الصور وشبكات اجتماعية ومواقع مواعدة كـ«أوك كيوبيد»، وحتى كاميرات منتشرة في باحات الجامعات، وشاركوا هذه الصور مع منظمات أخرى.

كان هذا الأمر يعد طبيعياً جداً بالنسبة للباحثين لأنهم يحتاجون إلى بيانات يغذون بها نظم الذكاء الصناعي الجديدة التي صمموها، فشاركوا كل ما بحوزتهم من بيانات، لا سيما أن الأمر كان قانونياً.

وتعد قاعدة بيانات «ميغا فيس» (MegaFace) التي طورها باحثون من جامعة واشنطن عام 2015 واحداً من هذه الأمثلة؛ حصل هذا التطوير دون علم أو موافقة الأشخاص الذين غذت صورهم هذه القاعدة التي نشرها الباحثون عبر الإنترنت ليتمكن الآخرون من تحميلها.

وكشفت صحيفة «نيويورك تايمز» أن «ميغا سيف» حُملت 6 آلاف مرة من قبل شركات ووكالات حكومية حول العالم، أبرزها تكتل «نورثروب غرومان» للصناعات الدفاعية في الولايات المتحدة، والذراع الاستثمارية لوكالة الاستخبارات الأميركية «إن كيو تيل»، والشركة الأم لتطبيق «تيك توك» الصيني «بايت دانس»، وشركة المراقبة الصينية «ميغفي».

صمم الباحثون «ميغا فيس» لاستخدامها في مسابقة أكاديمية تهدف إلى تحفيز تطوير نظم الذكاء الصناعي، ولم تكن مخصصة للاستخدام التجاري، إلا أن عدداً قليلاً فقط من الجهات التي حملت القاعدة شاركت في المسابقة.

قال فيكتور بالتا، المتحدث باسم جامعة واشنطن، إن «الجامعة ليست في موقع مناقشة مشاريع طرف ثالث، وإن (ميغا فيس) أصبحت خارج الخدمة، وبياناتها لم تعد تُوزع».

عملت بعض الجهات التي حملت القاعدة على تطوير نظم تعرف على الوجه، ووضعت شركة «ميغفي» الصينية على اللائحة السوداء العام الماضي من قبل وزارة التجارة الأميركية، بعد أن استخدمت الحكومة الصينية تقنيتها لمراقبة أقلية الإيغور في البلاد.

وأخرجت جامعة واشنطن «ميغا فيس» من الخدمة في مايو (أيار)، وأزالت منظمات أخرى قاعدة البيانات، ولكن نسخاً من هذه الملفات قد تكون محفوظة في أي مكان، وستستخدم على الأرجح في تغذية أبحاث أخرى.

أداة ذات حدين

أمضى سوليفان وهارفي سنوات وهما يحاولان تطوير الأداة لفضح كيفية استخدام البيانات، ولكن الأمر كان أصعب مما توقعا.

لقد أرادا أن تستطيع الأداة فور قبول صورة الشخص أن تُعلم صاحبها كم مرة تم تضمين وجهه في هذه القواعد البيانية باستخدام تقنية التعرف على الوجه، ولكنهما في الوقت نفسه شعرا بالقلق من استغلال هذه الأداة بشكل سلبي من قبل المتلصصين والشركات والحكومات.

وقد كشفت أوسوليفان التي تشغل أيضاً منصب نائب رئيس قسم الذكاء الصناعي المسؤول في شركة «آرثر» المتخصصة في استشارة إدارة سلوكيات تقنيات الذكاء الصناعي في نيويورك، أن «احتمال الضرر الذي قد تسببه هذه الأداة كبير جداً».

وفي النهاية، أُجبر الباحثان أنفسهما على الحد من حرية الناس في استخدام الأداة والبحث فيها وفي النتائج التي تقدمها؛ أي أن الأداة المتوفرة اليوم لم تصل إلى مستوى الفاعلية الذي أراداه منذ البداية، ولكن فقط لأنهما أرادا أن يسلطا الضوء على المشكلة دون أن يزيداها سوءاً.

ولا تستخدم أداة «إكسبوزينغ إيه آي» الذكاء الصناعي، ولكنها ترصد الصور فقط في حال كان الشخص يملك وسيلة إلكترونية تتيح رصدها، كعنوان موقع إلكتروني أو صفحة على الإنترنت. يستطيع الناس البحث عن صور نُشرت على خدمة «فليكر» فقط، ويحتاجون إلى اسم مستخدم أو وسم أو عنوان إنترنت على منصتها (يضمن هذا الأمر حصول المستخدم على الحماية الأمنية والخصوصية اللازمين، بحسب الباحثين).

صحيح أن هذا الأمر يحد من فاعلية الأداة، ولكنه لا يزال يعد وسيلة للتوعية، لا سيما أن صور «فليكر» تشكل نسبة كبيرة من مجموعات بيانات التعرف على الوجه التي تم نشرها عبر الإنترنت، كما حصل في تصميم «ميغا فيس».

* خدمة «نيويورك تايمز»