عند تصفح أجندة جلسات منتدى الإعلام العربي لهذا العام، لفت انتباهي، وانتباه غيري جلسة تحت عنوان «ثورة الروبوتات ومستقبل الصحافة». الموضوع مقلق لأهل المهنة. فهناك مخاوف باستبدالهم بـ«روبوتات» تنجز عملهم بسعر أقل وسرعة أعلى. وشحة المعلومات المتوفرة حول هذه الثورة، ومدى تأثيرها على غرف التحرير زادت من الإرباك. لذلك، لم يفاجئني إقبال حضور المنتدى من نخبة الإعلاميين على هذه الجلسة. وبعد ظهر اليوم الأول للمنتدى، طلت علينا ليسا غيبس مسؤولة استراتيجية الذكاء الاصطناعي لدى وكالة «أسوشييتد برس» (أ.ب) لتحدثنا عن هذه الظاهرة التي يتخيلها البعض بفنتازية أفلام الخيال العلمي. إلا أن الغموض تبدد شيئا فشيئا خلال الجلسة خصوصا عندما كشفت لنا غيبس أن الذكاء الاصطناعي بإمكانه أن يكون السلاح الأمثل لمحاربة ظاهرة الأخبار الكاذبة التي تهدد اليوم كبريات المؤسسات الإعلامية. انتهزت فرصة وجود غيبس في دبي علما أن مقر عملها في نيويورك لإجراء حديث معها عن أسئلة خطرت في بالي خلال الجلسة، فرحبت بذلك. فحدثتني عن توظيف الذكاء الاصطناعي في عالم الصحافة، وكشفت لي عن أداة «أ.ب فيريفاي» التي تطورها الوكالة لكشف الأخبار الكاذبة على مواقع التواصل الاجتماعي. ولم أستطع إلا أن أسألها سؤالا يراود جميع الصحافيين اليوم.. «هل ستطردنا التكنولوجيا من مكاتبنا وتعفينا من مهامنا؟» وفيما يلي نص الحوار:

> تلقت جلستك «ثورة الروبوتات ومستقبل الصحافة» خلال فعاليات منتدى الإعلام العربي الكثير من التغطية الصحافية. وعنونت معظم التقارير تصريحك بأن «الذكاء الاصطناعي أداة لصناعة ومحاربة الاخبار الكاذبة». فكيف ذلك؟

- هناك أدوات قد تستخدم لكتابة نماذج قصص. هذه النماذج قد توظف لتوليد كم كبير من الأخبار استنادا على بيانات يتم تجميعها. هذا النوع من التكنولوجيا بالإمكان أن توظفه المؤسسات الإعلامية المرموقة لضخ الكثير من القصص البسيطة مثل تغطيات المباريات الرياضية أو أخبار عن حالة الطقس أو حتى التقارير المالية. ولكن، قد يوظفها البعض الآخر أيضا لضخ الأخبار الكاذبة (Fake News). هذه الأخبار قد تكون بروباغندا سياسية، أو مجرد وسيلة لزيادة زيارات ومتابعات مواقع معينة لكي تستفيد من أرباح الإعلانات.

هناك أيضا تكنولوجيا أخرى أبدى المعظم قلقهم منها. هذه التكنولوجيا بإمكانها تجميع سلسلة من الصور لإنتاج صورة واحدة مزيفة بجودة صورة حقيقية يصعب التحقق منها. لكن، هنالك جانب مشرق لهذا التطور التكنولوجي، فإمكاننا اليوم كصحافيين توظيف الأدوات ذاتها للتحقق من صحة البيانات والمعلومات والصور بوتيرة أسرع من قبل.

نحن في وكالة أسوشييتد برس نعمل حاليا على تطوير أداة تتحقق من المعلومات المنشورة على مواقع التواصل الاجتماعي. الطريقة اليدوية للتحقق اليوم من قبل الصحافي تتضمن بحثه عن مصدر المعلومات وتاريخ نشرها ومكان النشر أيضا، خصوصاً عند التأكد من صحة الصور. لكن، أصبح من الممكن اليوم من خلال التكنولوجيا المتوفرة بناء أداة تختصر العملية الشاقة على الصحافي وتنجز المهمة بوقت أقل.

> ظاهرة الأخبار الكاذبة أو المزيفة ليست وليدة هذا العصر. لكن التطور التكنولوجي أسهم بتفاقمها. هل تتفقين؟

- هذا بالفعل صحيح. السبب يعود إلى تضاعف سرعة نشر الأخبار الكاذبة عن طريق منابر التواصل الاجتماعي. كما أصبحت أدوات تسلح المهتمين بصناعة الأخبار الكاذبة متاحة اليوم بفضل التطور التكنولوجي. لكن، يجب ألا نهمل الحوار عن كيف بإمكان الأتمتة مساعدتنا بالتحقق من المعلومات المنشورة في القصص. أصبح من المقدور اليوم أن ينشر موقع إلكتروني خبرا ويتيح خاصية الضغط على المعلومات للقارئ للاطلاع على مصدرها ومصداقيتها. وينشط حوار مؤخرا حول المعايير التي تجعل من المنابر الإعلامية مصادرا موثوقة، والدور الإيجابي الذي قد يلعبه الذكاء الاصطناعي في مساعدة القراء والمستخدمين للتمييز بين المصادر والمنابر الموثوقة والكاذبة بسرعة أكبر.

> تقوم وكالتكم بتطوير أداة للتحقق من صحة البيانات «أ.ب فيريفاي» (AP Verify). ما هي أهداف المشروع؟ وهل اعتمدتم على شراكة مع «غوغل» لتطوير الأداة؟

- «أ.ب فيريفاي» أداة نقوم بتطويرها لمساعدتنا في التحقق من المواد المنشورة على مواقع التواصل الاجتماعي بشكل أسرع. المشروع ينفذ في مكاتبنا بلندن، وتمول شركة «غوغل» جزءا من تكاليفه تحت «مبادرة غوغل للأخبار» في أوروبا. نستعين بعملاقة التكنولوجيا (غوغل) لمساعدتنا في الاستثمار بتقنية ذات جودة عالية لتأكيد نجاح الأداة المطورة. القطاع الإعلامي لا يمتلك دوما الموارد الكافية للإبداع.

تمتلك الكثير من المنابر الإعلامية مختبرات بحث وتطوير، لكن ليس بمقدورها تحقيق رؤيتها. لذلك، نحن بحاجة إلى دعم من «غوغل» ومؤسسات وشركات أخرى في حربنا على الأخبار الكاذبة والمعلومات المزيفة. قد نعتبر تجهيز أنفسنا بالتكنولوجيا معركة تسليح بين قوى الخير الصحافية وطاقات الأخبار الكاذبة.

لطالما كانت التكنولوجيا متغيرة. فقبل قرن، تمثلت في مهنة الصحافة بتدوين الأنباء على ورقة ومن ثم الاستعانة بالهاتف للاتصال بالمكتب الرئيسي ونقل الخبر، ومن ثم تطورت الصناعة. تشهد كل حقبة إعلامية زمنية تغيرات تكنولوجية تربكها أو تعطلها، لكن المعايير التحريرية والمهنية يجب أن تظل ثابتة بغض النظر. يجب أن نبقى أوفياء لمعايير الصحافة بمصداقيتنا ومهنيتنا وموضوعيتنا. لذلك، يتوجب علينا أن نعمل معا لنحرص على تطوير طرق تبرز عملنا وتمنحنا القدرة على الكشف عن المعلومات المغلوطة بسرعة، وبإمكان تقنيات الذكاء الاصطناعي مساعدتنا على ذلك.

> ذكرت أن المشروع ممول جزئيا من قبل «غوغل». ماذا ستستفيد شركة عملاقة من هذا المشروع الصحافي؟

- قامت «غوغل» باتخاذ قرار بأنها ستقوم بدعم الصحافة ذات الجودة العالية. الشركة تريد مساندة الابتكار في مجال الإعلام. ولذلك، قامت بتخصيص صناديق للمساعدة في هذا النوع من المشاريع. أعتقد أن شركات مثل «غوغل» و«تويتر» و«فيسبوك» بدأت بملاحظة الدور التي تلعبه منابرها في مجال مشاركة وتبادل الأخبار، ذات الجودة العالية والمتدنية. كما تعي الشركات ذاتها أن المجال الإعلامي يعاني من الإرباك خصوصا في مجال التنمية المالية المستدامة. ولذلك، فهي تبحث عن طرق جديدة لدعم المؤسسات الإعلامية المرموقة ومساعدتها في زيادة الأرباح المالية من خلال منابرها الإلكترونية، وهذا التوجه أعظم من السابق.

> عندما تنتهون من تطوير أداة التحقق، هل تعتزمون مشاركتها مع المؤسسات الإعلامية الأخرى؟ أم أنكم ستكتفون بمشاركة الأخبار الصادقة التي ستتحقق منها «أ.ب فيريفاي»؟

- أعتقد أننا سنقوم بعمل الشيئين. لدينا حاليا الكثير من الصحافيين في الوكالة مسؤوليتهم التحقق من الأخبار والمعلومات المنشورة على وسائل التواصل الاجتماعي. يقومون بالتواصل مع شهود العيان في مقر الحدث وتأكيد المعلومات. هذه الأمور تصب في تحسين سرج الخبر وتعميمه. ونقوم بتوفير هذه الأخبار الموثوقة للمنابر الإعلامية ليستخدموها. مشروع تطوير الأداة هو مشروع وليد لعام 2018 الحالي، وما زلنا في المراحل الأولية. لذلك، ليس بإمكاننا تقييم فعالية الأداة بعد. وهناك كثير من التساؤلات التي لا نملك لها الإجابات إلى الآن. ولكن أعتقد أنه من أهم أهدافنا دعم ومساندة الإعلام ليتبنى الأدوات والخطوات اللازمة في ظل التقنيات المتاحة.

> هل ستكون أداة «أ.ب فيريفاي» متاحة للتحقق من المعلومات بلغات أخرى، كالعربية؟

- نقوم الآن بالتركيز على اللغة الإنجليزية في بناء الأداة، ولكن اعتقد انه سيكون بمقدورنا مواءمتها لقراءة لغات أخرى سرعان التأكد من فاعليتها. معلومات الصور الذاتية (مثل التاريخ والوقت مثلا) تسجل في الأجهزة الإلكترونية بالإنجليزية، ما سيسهل علينا الأمر، وما سيجعل الأداة مفيدة للخدمات غير الإنجليزية حتى لو لم نغير اللغة. اللغة العربية مهمة جدا لوكالة «اسوشييتد برس». لدينا اليوم قسمان لترجمة اللغات الأجنبية، وهما اللغة الإسبانية، واللغة العربية، لأهميتهما في عالم الأخبار.

> هنالك مخاوف يعبر عنها الصحافيون اليوم وهي أن الذكاء الاصطناعي سيقوم باستبدالهم، وجعلهم عاطلين عن العمل. هل تتفقين؟

- هذا السؤال عادة أول ما يطرح علي في المقابلات. نحن (في الوكالة) لم نقم بإلغاء أية وظيفة منذ أن بدأنا بتوظيف تقنيات الذكاء الاصطناعي. إذ نوظف هذه التكنولوجيا لمساعدة صحافيينا. نعفيهم من المهام الشاقة والرتيبة لزيادة إنتاجيتهم وجودة عملهم. نريد أن يركز صحافيونا المؤهلون الذين يتمتعون بقدرات عالية أن يركزوا على جوانب المهنة المهمة مثل سرد قصص هامة ومحورية للقراء، والتركيز على التحقيقات الاستقصائية، والمواد المبدعة. لا نريد أن يجلس صحافيونا خلف أجهزتهم ك«الروبوتات» ينتجون قصصا بسيطة عن الطقس أو نتائج المباريات الرياضية أو عن البيانات في قطاع المال. هذه القصص تخسر قيمتها بسرعة فائقة في عالم الإنترنت. نرى أن الصحافيين يجب أن تتوفر لديهم الفرصة والوقت للعمل على القصص التي لديها تأثير وصدى في العالم. قمنا بشرح رؤيتنا لكادرنا، وجميع الموظفين يتفقون معنا.

> ماذا عن أولئك الصحافيين الذين تعودوا على تغطية هذه الأنباء وإنتاج القصص البسيطة إذن؟

- الوظائف التي تعتمد على العمل الروتيني المذكور أعلاه من الأرجح أن تلغى. ومن ثم يترتب على الصحافيين الذين كانوا يشغلونها تلقي التدريب اللازم للقيام بمهمات أخرى. وأعيد الذكر أننا لم نقم بإلغاء أية وظائف في وكالتنا، بل قمنا بتوظيف وقت الفراغ الذي أصبح متاحا بفضل الذكاء الاصطناعي ليستثمره الصحافيون بمهام أكثر أهمية. كما نظرنا إلى توفير تدريب لكادرنا لتمكينهم بالمهارات لتواكب التطور التقني الطارئ.

وعندما حولنا تغطية القصص عن الإيرادات الآلية عن طريق التقنية الجديدة، تفرغ كادرنا لتغطية المزيد من الأخبار التقنية والاقتصادية، وركز صحافيونا على العمل الاستقصائي. وفي بعض الحالات، وفرت لنا تقنية الذكاء الاصطناعي إمكانية تغطية قصص لم نكن نغطيها من قبل لعدم توفر الكوادر الكافية. فأصبح بإمكاننا اليوم تغطية مباريات كرة القدم الجامعية في الولايات المتحدة على سبيل المثال. لم يكن لدينا كادر كاف من قبل بمقدوره تغطية المباريات التي تحدث في الوقت ذاته. ومن خلال التقنية أصبح ذلك متاحا، ولهذه الأخبار جمهور يقدرها.

> يوفر الذكاء الاصطناعي اليوم إمكانية جمع الأخبار من مختلف أنحاء العالم، هل سيهدد ذلك دور المراسل، وهل سيقوم بإلغاء عمله؟

- نعي كليا حاجتنا للصحافيين. خصوصاً الملمين بمناطقهم، ولغتهم، ولديهم تجربة واسعة في تغطية مجالات معينة من ساحات القتال إلى الصحة والعلوم. هذه الاختصاصات مهمة جدا على الأرض. فحتى لو استطعنا إرسال «روبوت» للتغطية ولالتقاط صور، في أماكن يصعب للمراسل الوصول لها، تحت الماء مثلا، إذ استعنا بالروبوتات في الأولمبياد وفي مباريات كأس العالم وغيرها. لكن، ما زلنا بحاجة إلى الصحافي الذي يشغل هذه التقنيات، وآخر لشرح الموقف. فحتى لو أرسلنا «روبوت» إلى مكان الحدث، وغاب المراسل، فلن يكون بمقدورنا الفهم والتأكد مما يحدث، وما دلالات الحدث. وأعتقد أننا سنواجه مثل هذا المواقف في المستقبل، ويجب علينا أن نكون مستعدين للتعامل معها وكيف سنقوم بنقل المعلومات التي تجمعها الروبوتات إلى المستخدمين. فقد تدخل سياستنا التحريرية فقرة جديدة على الخبر تشرح أننا حصلنا الصورة أو الأنباء عن طريق «روبوت» في مكان الحدث، ومن ثم على المستخدمين أخذ ذلك في عين الاعتبار عند تحليلهم للخبر.

مسؤولة الذكاء الاصطناعي لدى «أسوشييتد برس»: الوظائف الصحافية الروتينية ستلغى

ليسا غيبس تكشف لـ «الشرق الأوسط» عن أداة تطورها الوكالة لكشف الأخبار الكاذبة على مواقع التواصل الاجتماعي

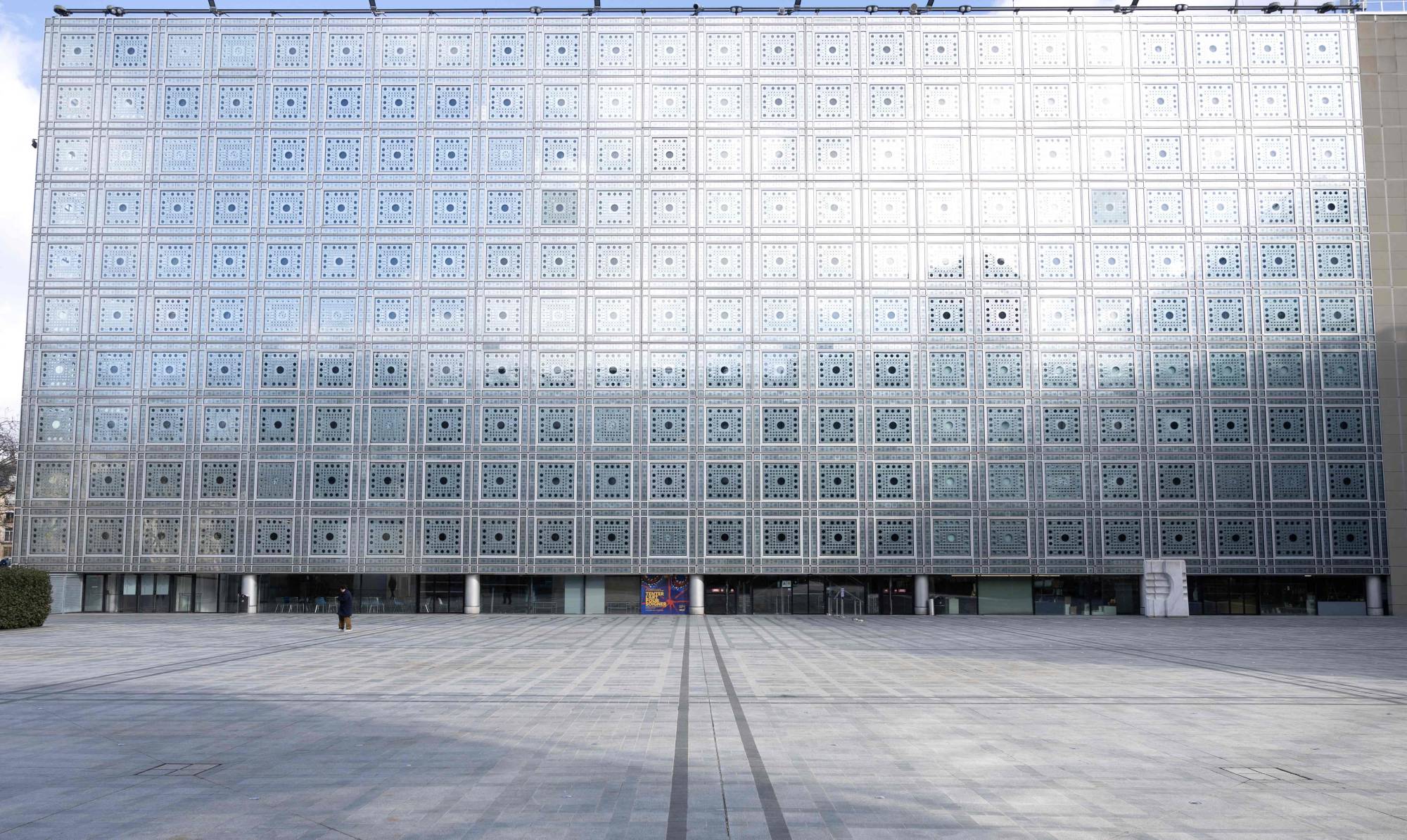

من جلسة ليسا غيبس ضمن فعاليات منتدى الإعلام العربي الأسبوع الماضي (نادي دبي للصحافة)

مسؤولة الذكاء الاصطناعي لدى «أسوشييتد برس»: الوظائف الصحافية الروتينية ستلغى

من جلسة ليسا غيبس ضمن فعاليات منتدى الإعلام العربي الأسبوع الماضي (نادي دبي للصحافة)

لم تشترك بعد

انشئ حساباً خاصاً بك لتحصل على أخبار مخصصة لك ولتتمتع بخاصية حفظ المقالات وتتلقى نشراتنا البريدية المتنوعة