التكنولوجيا الصوتية مذهلة فعلاً، إذ تتيح للمستهلك أن يطرح سؤالاً على هاتفه، وأن يخاطب نظام مكبر الصوت، وحتى أن يحجز تاكسي من خدمة «أوبر».

- تكنولوجيا صوتية

ومع ضبط هذه التكنولوجيا بشكل صحيح، يمكن للمستهلك أيضاً أن يقفل أبواب منزله، ويشعل الأضواء، ويغير درجة حرارة الغرفة، من خلال الأوامر الصوتية. وقد ازداد إعجاب الجمهور بميزة التحكم الصوتي التي ينعمون بها.

صحيح أن أجهزة المساعدة الصوتية تمثل وسيلة عملية وسهلة الاستخدام، ولكنها تستمع إلى أصحابها دائماً. ومع ازدياد أعداد المصنعين والمطورين الذين ينتجون الأجهزة العاملة بالصوت، لا بد للناس أن تتساءل عن وظيفة التسجيل في هذه الأجهزة، ومصير الملفات التي تسجلها.

والأسوأ من هذا كله هي التطبيقات التي تستعين بالبيانات ما فوق الصوتية (ultrasonic data) لتنظم ملفاً شخصياً عن المستهلك. وهناك المزيد، حيث إن بعض التطبيقات الشائعة كثيرة الاستخدام مصممة للتجسس والتبليغ عن التسجيلات.

هل شعرتم بالخوف؟ كثير من الناس يشعرون به اليوم، كما تقول «يو إس إيه توداي»، حيث إن الكثيرين لا يثقون بميزة المساعد الشخصي، ويتساءلون عن كيفية إطفائها. وفي حال كان المستهلكون قلقين من مخاطر خرق الخصوصية على هواتفهم الذكية التي تعمل دائماً بالميكروفون، فهذه بعض النصائح التي ستساعد على إطفائه:

- تنصّت تطبيق «فيسبوك»

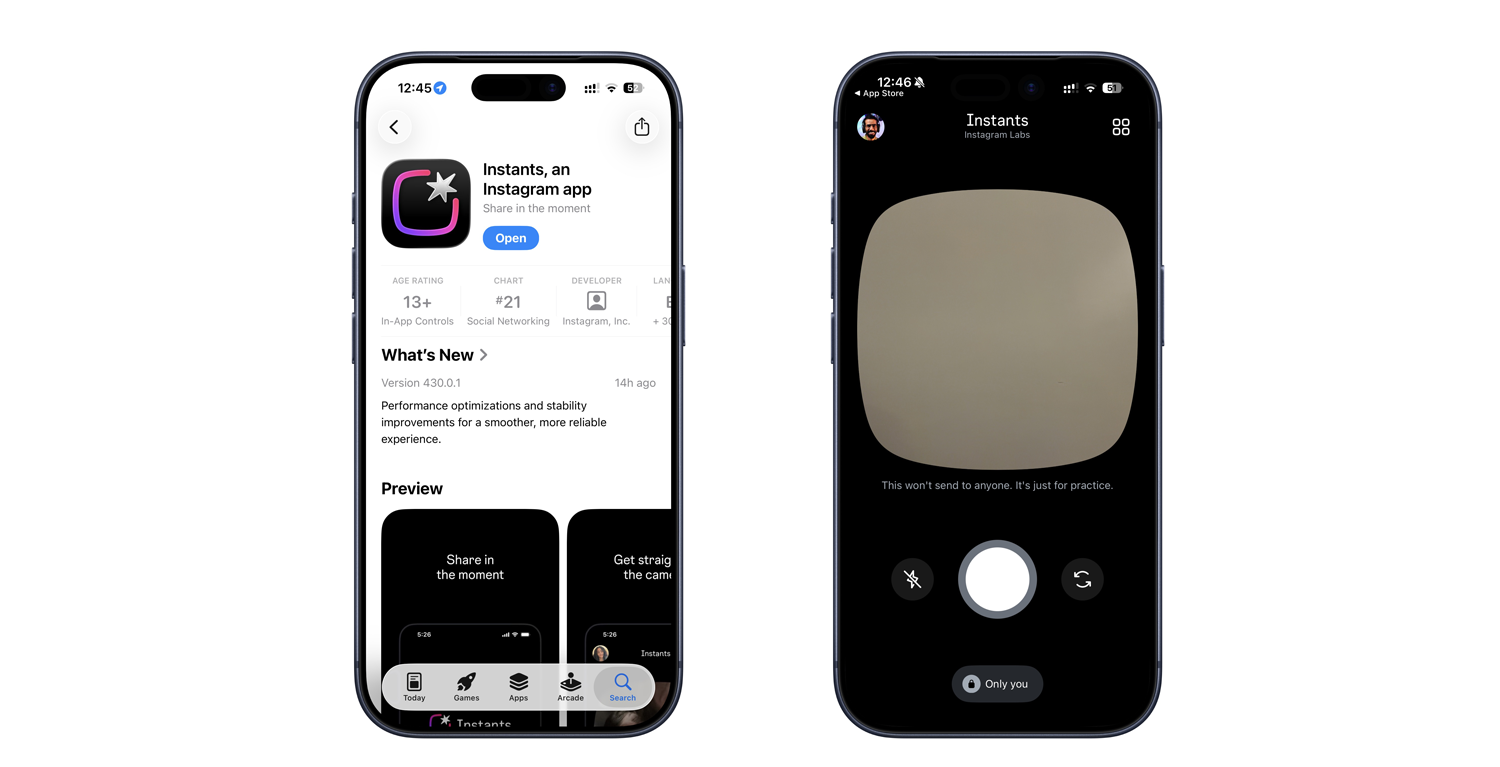

> «فيسبوك». حين يحمل المستهلك تطبيق «فيسبوك» على هاتفه، يطلب منه التطبيق الاتصال بالميكروفون الموجود في الجهاز. لماذا؟ يحتاج «فيسبوك» إلى تسجيل صوت المستهلك حين يصور مقاطع فيديو مباشرة، ولكن بعض الأشخاص يخافون من هذا الاتصال بعض الشيء؛ فهل يسجل التطبيق الصوت حين يستخدمون الكاميرا فحسب، أم أن «فيسبوك» ينصت إليهم في كل مرة عبر الميكروفون؟

ينفي «فيسبوك» هذه الادعاءات، ولا يوجد دليل قوي يدعم مشاعر الخوف هذه. ولكن لا ضير من أن يتفادى المستهلكون الخطر الناتج عن الاتصال بين التطبيق والميكروفون، وبما أن كثيرين لا يحتاجون هذا الاتصال، لن يخسروا شيئاً إن أبطلوه.

- في حال كان المستهلك يستخدم هاتف «آيفون»، عليه أن يذهب إلى إعدادات - فيسبوك - إعدادات - إيقاف تشغيل الميكروفون (تحويله إلى الجهة اليسرى حتى يتحول لون الزر من أخضر إلى أبيض)، وعندها يكون قد أطفئ. ويمكنه أيضاً، بطريقة أخرى، أن يذهب إلى إعدادات - خصوصية - ميكروفون - البحث عن فيسبوك وإطفاء الاتصال. وتجدر الإشارة إلى أن الخطوات نفسها تصلح للتحكم بالميكروفون في تطبيقات أخرى.

- لمستخدم «آندرويد»: إعدادات - تطبيقات - إدارة التطبيقات - البحث عن فيسبوك - أذونات - إطفاء الميكروفون.

وفي حال قرر صاحب الهاتف لاحقاً أن يصور مقطع فيديو، يمكنه أن يعود إلى هذه الإعدادات، وأن يعيد الاتصال بالميكروفون، ومن ثم أن يعيد إطفاءه فور انتهائه من التصوير.

تسجيلات المساعدات الصوتية

> «أمازون إيكو». هل يستمع «أمازون إيكو» دوماً إلى مستخدميه؟ تعمل «أليكسا» الشخصية المرتبطة بهذا الجهاز، حين تضبط أي واحدة من كلمات إيقاظها، التي هي: أليكسا، أمازون، كومبيوتر، أو إيكو. ويعلم المستهلك أن «أليكسا» جاهزة لتلقي الأوامر، عندما يرى الدائرة الخارجية قد أضيئت بالأزرق. ولكن أذني «أليكسا» مفتوحتان دوماً، وتنتظران التوجيه، حتى قبل أن يظهر هذا الضوء.

حين تنطلق، تسمح «أليكسا» لمستخدمها بتصفح الإنترنت، وتشغيل الموسيقى، وحتى بالتحكم بأجهزة ذكية أخرى في المنزل كان قد أضافها إلى شبكة الاتصال المنزلية. مثلاً، في حال استخدام الأجهزة الذكية الصحيحة، يمكن إطفاء الأضواء في غرفة أخرى، وإقفال باب المنزل، وتشغيل جهاز ضبط الحرارة، إلخ.

ولكن الجانب السيئ في «أمازون» هو أن أجهزتها تحتفظ بتسجيل صوتي لكل أمر صوتي أصدره المستهلك لـ«أليكسا». فحين يصدر هذا الأخير أمراً ما للمساعد، يتم تخزين تسجيل لهذا الأمر في خوادم «أمازون».

ووفقاً لـ«أمازون»، فإن التسجيل يبدأ قبل عشر من الثانية من النطق بكلمة إيقاظ «أليكسا»، وتتم إضافة هذا العشر مع التسجيل. كما يتم حفظ هذا العشر من الثانية إلى جانب الأمر الصوتي، لينتهي التسجيل بعد تنفيذ الأمر.

وعندما يتفقد المرء تسجيلات «أمازون إيكو»، فإنه قد يتفاجأ. في أحد التسجيلات، كنت أشرح لماذا لم أوقع اتفاق يخص مبنى تجاري كنت قد عرضته للبيع؛ من الضروري جداً للمستهلك أن يتفقد تسجيلاته.

> «سيري». تماماً كجهاز إيكو، يحافظ «سيري» على يقظته دائماً، حتى عندما ينسى المستهلك أن جهاز الآيفون الخاص به يمكن أن يسمعه. وقد قدمت «آبل» في نظام «آي أو إس 8» جملة «مرحباً سيري» لإيقاظ المساعد، حتى يتمكن المستهلك من استخدامه دون حتى أن يلمس الهاتف. وفي حال شغل صاحب الجهاز هذه الميزة، فهذا يعني أن ميكروفون الآيفون يستمع دائماً، ينتظر جملة «مرحباً سيري».

وتقول «آبل» إن هذه الميزة التي تعمل على أنظمة «آي أو إس» لا تبدأ بالتسجيل حتى تسمع عبارة «مرحباً سيري». وفور تسجيل الأمر، يتم تحميل الملف الصوتي على خوادم «آبل».

ولكن هذا الأمر يغضب المستهلكين، ولحسن الحظ أنه يمكنهم أن يعطلوا ميزة «مرحباً سيري».

- ما أبسط وسيلة لإطفائها؟ إعدادات آي أو إس • عام • سيري، ومن ثم يجب الضغط على تعطيل «مرحباً سيري».

> «غوغل». تسعى «غوغل» إلى تطوير المزيد من الأجهزة التي تعمل بالخدمات الصوتية، وتستخدم عبارة «أوكي غوغل» (حسناً غوغل) كجملة إيقاظ جديدة لـ«غوغل»، تماماً كما في «أليكسا» و«مرحباً سيري»، لاستدعاء انتباه مساعد «غوغل» في مكبرات «غوغل هوم» وهواتف «آندرويد» الذكية ومتصفح الكروم.

وفي كل مرة يستخدم فيها المستهلك عبارة «حسناً غوغل»، أو يستخدم أي وظيفة أخرى تعمل بالأوامر الصوتية، سيتم تسجيل الطلب وحفظه في حساب «غوغل» الخاص به.

ولحسن الحظ، قدمت الشركة أداة جديدة في ميزة «حسابي» (ماي أكاونت) تسمح للمستهلك بالوصول إلى التسجيلات ليمحوها، إن رغب بذلك. كما يمكنه أن يطلب من «غوغل» أن تتوقف عن تسجيل الصوت. ولكن كيف يمكن إيقاف تشغيل «حسناً غوغل» على «آندرويد»؟ إعدادات - غوغل - ابحث والآن - صوت وإطفاء «حسناً غوغل».

> «كورتانا». وأخيراً، حان دور «كورتانا»، نظام التشغيل الصوتي من «مايكروسوفت». وهو يشبه ما سبقه من أجهزة، إذ إن «كورتانا» تجيب عن الأسئلة، وتقوم بالأبحاث، وتحدد المواعيد، وتفتح التطبيقات. وجملة الإيقاظ الخاصة بها هي «مرحباً كورتانا». وكما المساعدين الآخرين، أثارت «كورتانا» بعض التساؤلات.

- كيف تطفأ «كورتانا»؟ يجب على المستهلك أن يفتح برنامج «كورتانا» في ويندوز الموجود في الكومبيوتر، ثم يجب أن ينقر على رمز المفكرة في العامود الأيمن، وأن يضغط على «إعدادات» وإيقاف تشغيل «كورتانا».

تكنولوجيا فوق صوتية

> موجات فوق صوتية لجمع الأصوات. تفرض هذه التكنولوجيا على المستهلك أن يكون ذكياً وعالماً بها لأنها صعبة الفهم. ويطور بعض المبرمجين البارعين تطبيقات تستطيع تعقب الأصوات عالية التردد، التي لا يمكن للبشر سماعها، إلا أن بعض المتلقين يمكنهم ذلك. ويمكن للهاتف الذكي أو الجهاز اللوحي أن يتجسسا على المستهلك في أثناء استخدامه لموجات صوتية لا يعرف هو بوجودها.

ولكن لماذا قد يرغب أحدهم بجمع أصوات بموجات فوق صوتية؟ لأن المسوقين يمكنهم أن يستخدموا المعلومات التي يتم جمعها لتصميم إعلاناتهم بشكل يجذب المستهلك. وتبحث هذه التطبيقات عن أدلة صوتية صغيرة ترجح الأماكن التي يتبضع منها المستهلك، وما قد يحب شراؤه. ثم يعمل المسوقون على جمع ملفات تعريف الارتباط (كوكيز) لتعقب سلوك المستهلك عن طريق أكثر من جهاز.

وفي الحقيقة، تستخدم مئات تطبيقات الآندرويد الموجات فوق الصوتية لتعقب سلوك المستهلك. وتتضمن هذه السلوكيات مواقع وجود الشخص، وعادات مشاهدته التلفاز.

ولكن استجابة منها لمخاوف الناس، أعلنت «غوغل» أن تطبيقات آندرويد التي تستخدم الموجات فوق الصوتية لتتبع المستهلكين سيتم إيقافها أو حظرها، وسيكون على المطورين أن يتقدموا بدليل يثبت التزامهم بالتعديلات الجديدة في سياسة «غوغل بلاي ستور» للخصوصية. وتلزم السياسة الجديدة المطورين بالإفصاح عن ميزات التطبيقات فوق الصوتية، وتطلب إذن المستهلك قبل الاتصال بأذونات الجهاز. لذا، في حال كان المستهلك يشعر بالقلق من التعقب الـ«ما فوق الصوتي»، يجب عليه التحقق قبل تنزيل تطبيقات آندرويد.

> إيقاف عمل الميكروفون. يمكن لإيقاف تشغيل الميكروفون في الأجهزة أن يمنح المستهلك راحة البال، ولكن يجب أن يتذكر أن تعطيلها يقلل من فعالية مكبرات الصوت وأجهزة المساعدة الافتراضية، لأن اعتماد هذه الميزات على الاستماع الدائم هي التي تجعل أجهزة المساعدة خاضعة للأوامر التي تتلقاها. وكلنا أمل في أن يتوصل المطورون قريباً إلى تسوية مناسبة تنجح في الموازنة بين الأمن وسهولة الاستخدام.

9:17 دقيقه

كيف تمنع هاتفك الذكي من التنصت على كلماتك وحفظها؟

https://aawsat.com/home/article/1054301/%D9%83%D9%8A%D9%81-%D8%AA%D9%85%D9%86%D8%B9-%D9%87%D8%A7%D8%AA%D9%81%D9%83-%D8%A7%D9%84%D8%B0%D9%83%D9%8A-%D9%85%D9%86-%D8%A7%D9%84%D8%AA%D9%86%D8%B5%D8%AA-%D8%B9%D9%84%D9%89-%D9%83%D9%84%D9%85%D8%A7%D8%AA%D9%83-%D9%88%D8%AD%D9%81%D8%B8%D9%87%D8%A7%D8%9F

كيف تمنع هاتفك الذكي من التنصت على كلماتك وحفظها؟

«فيسبوك» وأجهزة المساعدة الصوتية الذكية قد تتجسس عليك

كيف تمنع هاتفك الذكي من التنصت على كلماتك وحفظها؟

مواضيع

مقالات ذات صلة

لم تشترك بعد

انشئ حساباً خاصاً بك لتحصل على أخبار مخصصة لك ولتتمتع بخاصية حفظ المقالات وتتلقى نشراتنا البريدية المتنوعة