إذا كنت تستخدم بحث الذكاء الاصطناعي في العمل، فكن حذراً. جاء هذا في دراسة جديدة تكشف عن معلوماتها «المختلقة».

قد تعرض أدوات الذكاء الاصطناعي للبحث، معلومات خاطئة تماماً. وقد سجَّلت أداة غروك Grok التابعة لإيلون ماسك أسوأ النتائج.

الذكاء الاصطناعي– محرك البحث المستقبلي

مع توجه «غوغل» بشكل أكبر نحو الاستثمار في ضخ نتائج البحث المُولَّدة بالذكاء الاصطناعي، وذلك بعد بداية متعثرة لها العام الماضي، وتجربة شركات مماثلة مثل «أوبن إيه آي» هذه التقنية المبتكرة، يبدو أن الذكاء الاصطناعي سيشكل مستقبل البحث عبر الإنترنت.

وستكون لذلك تداعيات على العاملين في أي شركة تقريباً، بغض النظر عن مجال عملها؛ لأن البحث عن المعلومات جزء أساسي من استخدامات الإنترنت.

دراسة جديدة لمشكلات الدقة

لكن دراسة جديدة من مركز «تاو» للصحافة الرقمية بجامعة كولومبيا، نُشرت في مجلة «Columbia Journalism Review»، تُسلِّط الضوء على ضرورة توخي موظفي المؤسسات والشركات الحذر الشديد، على الأقل في الوقت الحالي؛ لأن أدوات بحث الذكاء الاصطناعي من كثير من الشركات الكبرى تعاني مشكلات خطيرة في الدقة.

اختبار 8 أدوات ذكية

دققت الدراسة في عمل 8 أدوات بحث مختلفة للذكاء الاصطناعي، بما في ذلك «تشات جي بي تي» ChatGPT، و«بربليكسيتي» Perplexity، و«جيمناي» Gemini من «غوغل»، و«كوبايلوت» Copilot من «مايكروسوفت»، والأداة الصينية الرائدة «ديب سيك» DeepSeek.

وقد ركَّزت الدراسة على دقة الإجابات عندما تم اختبار كل أداة ذكاء اصطناعي حول قصة إخبارية، حسبما أفاد موقع أخبار التكنولوجيا «آرس تكنيكا».

60 % من الإجابات غير صحيحة

وكانت النتيجة الأبرز في الدراسة أن جميع أدوات الذكاء الاصطناعي أظهرت دقة سيئة بشكل مذهل، حيث أخطأت في 60 من الإجابات. ومع ذلك، لم يكن مستوى الخطأ متساوياً بين جميع الأدوات.

أظهرت أداة Perplexity معدل خطأ بلغ نحو 37 في المائة، في حين ارتفعت نسبة الأخطاء لدى ChatGPT إلى 67 في المائة. أما نموذج Grok 3، الذي طوَّره إيلون ماسك، فقد سجل أسوأ أداء، إذ كانت إجاباته خاطئة بنسبة 94 في المائة. وربما لم يكن ذلك مفاجئًا، خاصة أن ماسك روَّج للنموذج على أنه أقل تقيُّدًا بالقيود الأمنية مقارنة بمنافسيه في الذكاء الاصطناعي. (فضلًا عن أن الملياردير معروف بتوجهاته المتحررة نسبيًا فيما يتعلق بالدقة والحقائق وحرية التعبير).

والأسوأ من ذلك، لاحظ الباحثون أن الإصدارات المدفوعة من أدوات البحث هذه كانت أحياناً أسوأ من بدائلها المجانية.

أداة البحث تختلف عن أداة الدردشة

تجدر الإشارة إلى أن البحث بالذكاء الاصطناعي يختلف قليلًا عن استخدام روبوتات الدردشة التي تحاكي المحادثات البشرية. فعادةً ما يقوم البحث بالذكاء الاصطناعي بمحاكاة دور محرك البحث، حيث يجري البحث نيابة عنك بعد إدخال استعلامك، ثم يقدم ملخصًا لأهم المعلومات التي وجدها على الإنترنت، مما يغنيك عن الحاجة إلى قراءة المقال الأصلي الذي استُخلصت منه البيانات.

لكن المشكلة هنا تكمن في أن هذه النماذج، تمامًا مثل ذلك الزميل الواثق بنفسه إلى حد الإفراط، والذي يبدو دائمًا وكأنه يمتلك الحقيقة بغض النظر عن الموضوع المطروح، لا تميل إلى الاعتراف بعدم معرفتها بالإجابة على أي استعلام.

إجابات «معقولة» غير صحيحة

لاحظ مؤلفو الدراسة أنه بدلاً من قول «لا» عند عدم تمكنه من العثور على معلومات موثوقة، رداً على استفسار حول قصة إخبارية، غالباً ما قدَّم الذكاء الاصطناعي إجابات مُختلقة تبدو معقولة، ولكنها في الواقع غير صحيحة. ومن العيوب الأخرى التي اكتشفتها هذه الدراسة أنه حتى عندما قدمت أدوات بحث الذكاء الاصطناعي هذه استشهادات إلى جانب نتائج البحث (ظاهرياً حتى يتمكن المستخدمون من زيارة مواقع المصادر هذه للتحقق من أي تفاصيل، أو للتحقق من صحة البيانات)، غالباً ما أدت روابط الاستشهادات هذه إلى نسخ مُجمَّعة من المحتوى، بدلاً من نسخ الناشرين الأصليين. وفي بعض الأحيان، أدت هذه الروابط إلى عناوين ويب غير موجودة؛ فعل ذلك Gemini وGrok 3 في أكثر من نصف استشهاداتهم.

تجربة اختبارية متخصصة

كانت التجربة متخصصة بعض الشيء؛ لأنها استندت إلى مقالات إخبارية، ولم يبحث الباحثون بعمق في دقة نتائج بحث الذكاء الاصطناعي عن محتوى آخر موجود على الإنترنت. وبدلاً من ذلك، قاموا بتغذية أدوات الذكاء الاصطناعي بمقتطفات من أخبار حقيقية ثم طلبوا منها تلخيص المعلومات، بما في ذلك العنوان وتفاصيل أخرى.

يجب أن تهتم بنتائج الدراسة لسبب بسيط واحد. فنحن نعلم أن الذكاء الاصطناعي قادر على تسريع بعض مهام المكتب المملة وتعزيز كفاءة الموظفين. ويبدو أن البحث باستخدام الذكاء الاصطناعي قد يصبح هو القاعدة، ليحل محل البحث التقليدي على الإنترنت الذي قد يكون مهمة شاقة في بعض الأحيان.

محدودية الثقة بالذكاء الاصطناعي

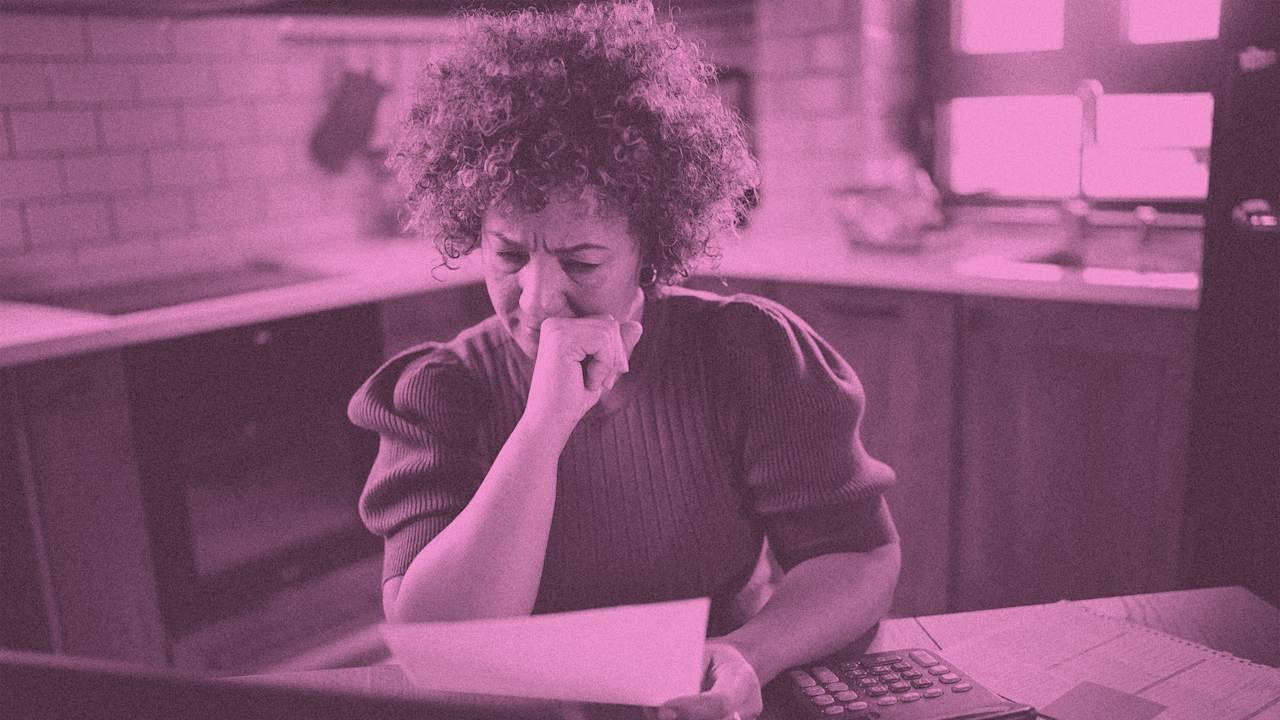

ولكن إذا كان فريقك -على سبيل المثال- يبحث عن معلومات أساسية لإدراجها في محتوى ستنشره، أو حتى يبحث عن موارد على الإنترنت قبل بدء مشروع جديد، فعلى العاملين فيه توخي الحذر الشديد بشأن الثقة في نتائج أدوات بحث الذكاء الاصطناعي.

ويبدو بعض الإجابات وكأنه نسخة أخرى من مشكلة هلوسة الذكاء الاصطناعي المعروفة، وهي دليل إضافي على أنه إذا كنت تستخدم أدوات الذكاء الاصطناعي لتعزيز جهود شركتك، فأنت بالتأكيد بحاجة إلى أشخاص أذكياء على دراية تامة بنتائج الذكاء الاصطناعي للتحقق منها.

* «إنك»، خدمات «تريبيون ميديا».