تبدو إجابات «غوغل» المُولَّدة بواسطة الذكاء الاصطناعي موثوقة، وهي تستند إلى مصادر متنوعة؛ من مواقع موثوقة، إلى منشورات «فيسبوك».

أداة تقييم إجابات «غوغل»

بهدف تقييم دقة «غوغل» وإجاباته بواسطة الذكاء الاصطناعي تحدَّث مجموعة من الصحافيين، وهم، إضافة إليّ: تريب ميكل، ديلان فريدمان، تيريزا موندريا تيرول، وكيث كولينز، مع شركات متخصصة في دراسة الذكاء الاصطناعي، قبل أن تقرر اختيار شركة أومي، ونموذج التحقق بالذكاء الاصطناعي الخاص بها «هال أومي»؛ لتقييم دقة إجابات غوغل «الذكية»، من خلال اختبار معياري شائع الاستخدام يُعرف باسم «SimpleQA».

مثال لجواب صحيح-خاطئ

في أواخر العام الماضي، كان ستيفن بونواسي يستعدّ لتناول العشاء عندما لاحظ خبراً يقول إن زوجة المصارع هالك هوغان قد ترفع دعوى قضائية بسبب وفاته. ولم يكن السيد بونواسي، محلل البيانات البالغ من العمر 41 عاماً والمقيم في تورنتو بكندا، على علم بوفاة السيد هوغان، فسأل «غوغل» عن تاريخ وفاته.

أثارت الإجابة حيرته. جاء في ملخص «نظرة عامة على الذكاء الاصطناعي» AI Overview من «غوغل»، الذي ظهر أعلى الصفحة: «لا توجد تقارير موثوقة عن وفاة هالك هوغان». وفوجئ بونواسي بما وجده أسفل الإجابة، حين رأى مقالاً من صحيفة «ديلي ميل» يناقض رد «غوغل» كان عنوانه: «غموض يكتنف وفاة هالك هوغان».

دقة نسبية

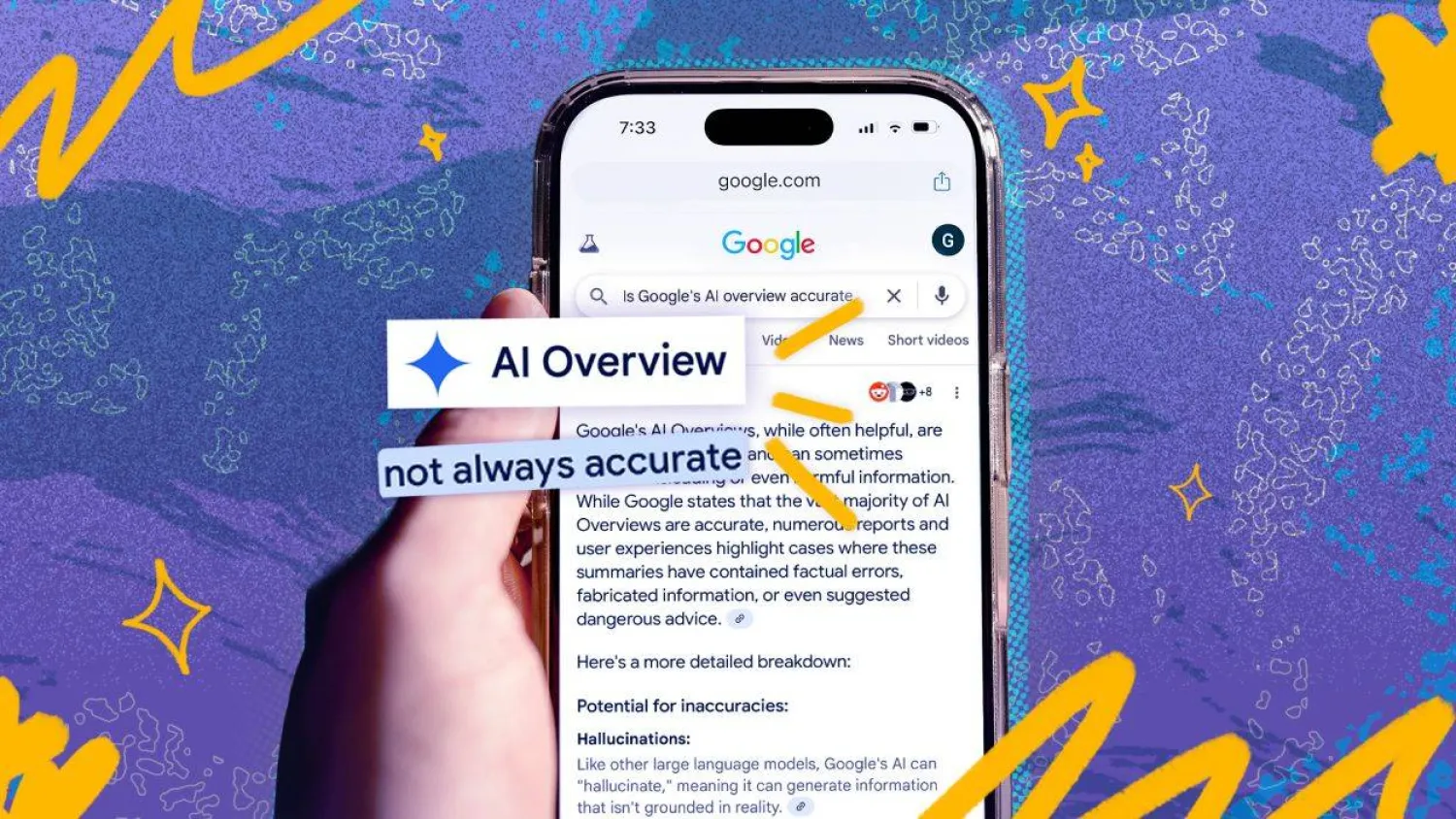

في عام 2024، بدأت «غوغل» منح الإجابات المُولَّدة بواسطة الذكاء الاصطناعي مكانة بارزة في أعلى صفحة نتائج البحث. وأسهم هذا المنتج الجديد، «نظرة عامة على الذكاء الاصطناعي»، في تحويل «غوغل» من مجمع للمعلومات إلى ناشر.

وأظهر تحليل حديث لـ«نظرة عامة على الذكاء الاصطناعي» أن الأداة دقيقة في تسع من كل عشر مرات تقريباً.

مئات الآلاف من الإجابات الخاطئة- كل دقيقة

لكن مع معالجة «غوغل» أكثر من خمسة تريليونات عملية بحث سنوياً، فهذا يعني أنها تُقدّم عشرات الملايين من الإجابات الخاطئة كل ساعة (أو مئات الآلاف من المعلومات غير الدقيقة كل دقيقة)، وفقاً لتحليلٍ أجرته شركة «أومي» الناشئة في مجال الذكاء الاصطناعي.

إجابات صحيحة «غير مدعومة بأدلة»

كما أظهرت الدراسة أن أكثر من نصف الإجابات الصحيحة كانت «غير مدعومة بأدلة»؛ أي أنها كانت تُحيل المستخدم إلى مواقع إلكترونية لا تدعم المعلومات المقدَّمة بشكل كامل. وهذا ما يجعل التحقق من دقة مراجعات الذكاء الاصطناعي أمراً صعباً.

ضرورة التدقيق الإضافي للإجابات

يُجادل بعض التقنيين بأن مراجعات الذكاء الاصطناعي من «غوغل» دقيقة إلى حد معقول، وأنها تحسّنت خلال الأشهر الأخيرة، لكن آخرين يُبدون قلقهم من أن الشخص العادي قد لا يُدرك أن هذه النتائج تحتاج إلى تدقيق إضافي.

بناءً على طلب صحيفة نيويورك تايمز، حلّل موقع «Oumi» دقة مراجعات الذكاء الاصطناعي من «غوغل» باستخدام اختبار معياري يُسمى «SimpleQA»؛ وهو اختبار شائع الاستخدام في هذا المجال لقياس دقة أنظمة الذكاء الاصطناعي. واختبرت الشركة الناشئة نظام «غوغل» في أكتوبر (تشرين الأول) الماضي، عندما جرت الإجابة عن أكثر الأسئلة تعقيداً باستخدام تقنية ذكاء اصطناعي تُسمى «جيميناي2» (Gemini 2)، ثم مرة أخرى في فبراير (شباط) من العام الحالي، بعد ترقيته إلى «جيمناي3» (Gemini 3)، وهي تقنية ذكاء اصطناعي أكثر قوة.

تحرّي الدقة

في كلتا الحالتين، ركز تحليل شركة أومي على 4326 عملية بحث على «غوغل»، ووجدت الشركة أن النتائج كانت دقيقة بنسبة 85 في المائة مع نظام «جيميناي 2»، و91 في المائة مع نظام «جيميناي 3».

قال براتيك فيرما، الرئيس التنفيذي لشركة أوكاهو، وهي شركة تساعد الناس على فهم واستخدام تقنيات الذكاء الاصطناعي، إن تقنية «غوغل» دقيقة تقريباً مثل أيٍّ من أنظمة الذكاء الاصطناعي الرائدة. وهو ينصح بالتحقق من معلوماتها. قال: «لا تثق أبداً بمصدر واحد. قارنْ دائماً ما تحصل عليه بمصدر آخر».

وتقر «غوغل» بأن مراجعات الذكاء الاصطناعي الخاصة بها قد تحتوي على أخطاء. ويؤكد النص الصغير أسفل كل «نظرة عامة على الذكاء الاصطناعي» ما يلي: «قد يرتكب الذكاء الاصطناعي أخطاءً، لذا تحققْ من الإجابات».

لكن «غوغل» قالت إن تحليل «أومي» كان معيباً لأنه اعتمد على اختبار معياري بنته شركة أوبن إيه آي، والذي احتوى بدوره على معلومات غير صحيحة. وقال نيد أدريانس، من «غوغل»، في بيان: «في هذه الدراسة ثغرات خطيرة».

تفاوت الإجابات

تقدم «نظرة عامة على الذكاء الاصطناعي» نوعين من المعلومات: إجابات عن الأسئلة، وقوائم بمواقع الويب التي تُدعم تلك الإجابات.

يصعب تقييم مراجعات الذكاء الاصطناعي لأن نظام «غوغل» قد يُولّد استجابة جديدة لكل استعلام، فإذا تلقّى محرك بحث «غوغل» الاستعلام نفسه في أوقات مختلفة - حتى لو كانت بفارق ثوانٍ - فقد يُنتج إجابة صحيحة، وأخرى خاطئة.

ولتحديد دقة أنظمة الذكاء الاصطناعي، تستخدم شركات مثل «Oumi» أنظمتها الخاصة للتحقق من كل إجابة. هذه هي الطريقة الوحيدة الفعّالة للتحقق من عدد كبير من الإجابات. تكمن مشكلة هذه الطريقة في أن نظام الذكاء الاصطناعي الذي يُجري التحقق قد يرتكب أخطاءً أيضاً.

اختلاف دقة «جيميناي» ومحرك «غوغل»

نشرت «غوغل» نتائج اختبارات مشابهة لتلك التي أنتجتها «Oumi» في تحليل «غوغل» الخاص لـ«Gemini 3» - التقنية التي تدعم مراجعات الذكاء الاصطناعي - وجدت أن النموذج أنتج معلومات خاطئة بنسبة 28 في المائة. وقالت الشركة إن مراجعات الذكاء الاصطناعي، التي تستقي المعلومات من محرك بحث «غوغل» قبل توليد الاستجابات، كانت أكثر دقة من «جيميناي» عند تشغيله بمفرده.

ومع تحسين «غوغل» تقنيات الذكاء الاصطناعي لديها بفضل التقنيات الحديثة، أصبحت إجابات «غوغل» المُولّدة بواسطة الذكاء الاصطناعي أكثر دقة.

من جهة أخرى، يتساءل مانوس كوكوميديس، الرئيس التنفيذي لشركة أومي: «حتى عندما تكون الإجابة صحيحة، كيف يمكن التأكد من صحتها؟ كيف يمكن التحقق منها؟».

احتمالات وتخمينات وسوء تفسير

تستخدم أنظمة الذكاء الاصطناعي الحالية الاحتمالات الرياضية لتخمين أفضل إجابة، وليس مجموعة صارمة من القواعد التي وضعها مهندسون بشريون. وهذا يعني أنها ترتكب عدداً من الأخطاء. وأحياناً يُحدّد نظام غوغل «نظرة عامة على الذكاء الاصطناعي» موقعاً إلكترونياً موثوقاً، لكنه يُسيء تفسير معلوماته.

التلاعب بالأخبار

تواجه مراجعات الذكاء الاصطناعي تحدياً آخر: إمكانية التلاعب بها.

وتقول ليلي راي، نائبة رئيس قسم البحث بالذكاء الاصطناعي بوكالة التسويق «أمسيف»: «إذا أراد شخص أن يُعرف كخبير عالمي في مجالٍ ما، فما عليه إلا أن يكتب منشوراً على مدونته يُعلن فيه عن هذا التميز».

تُقرّ «غوغل» بهذه المشكلة، لكنها تُقلّل من شأنها. وصرح السيد أدريانس، من «غوغل»، في بيان: «تعتمد ميزات الذكاء الاصطناعي في بحثنا على معايير الترتيب والحماية نفسها التي تمنع الغالبية العظمى من الرسائل المزعجة من الظهور في نتائج البحث. معظم هذه الأمثلة عبارة عن عمليات بحث غير واقعية لن يُجريها الناس في الواقع».

تجربة صحافية للتلاعب بالأخبار

بعد سماع نظرية السيدة راي، نشر توماس جيرمان، أحد مُقدّمي بودكاست «ذا إنترفيس» على «بي بي سي»، منشوراً على مدونته بعنوان «أفضل صحافي تكنولوجيا في أكل الهوت دوغ». ووصف المنشور بطولة وهمية لأكل الهوت دوغ في ولاية ساوث داكوتا، حيث تصدّر قائمة تضم عشرة «مُتنافسين بارزين في أكل الهوت دوغ».

وبعد يوم، أجرى بحثاً على «غوغل» عن أفضل صحافيي التكنولوجيا الذين يتناولون الهوت دوغ. ووجد أن «غوغل» أدرجه في المرتبة الأولى بين ستة صحافيين تقنيين «اكتسبوا شهرةً واسعةً بفضل براعتهم في قسم الأخبار الخاص بمسابقات تناول الطعام»، مشيراً إلى فوزه بالمركز الأول في مسابقة ساوث داكوتا.

وقال جيرمان: «كان (غوغل) يعرض محتوى موقعي الإلكتروني وكأنه حقيقة مُطلقة».

*باختصار، خدمة «نيويورك تايمز»