عند النظر إلى تاريخ روبوتات المحادثة الحديثة، نلاحظ أنّه ينقسم إلى مرحلتين. بدأت الأولى العام الماضي مع إطلاق «تشات جي بي تي»، ولا تزال مستمرّة حتّى يومنا هذا، وترتكز بشكلٍ أساسي على روبوتات محادثة قادرة على الحديث عن كلّ شيء.

هذه القدرة مبهرة ومفيدة جداً ولكنّها في الواقع ليست إلّا مقدّمة للمرحلة التالية: الذكاء الاصطناعي القادر حقاً على القيام بأشياء مطلوبة منه.

مهمات وكلاء الذكاء الاصطناعي

تزعم شركات التقنية أنّ ما يُسمّى «وكلاء» الذكاء الاصطناعي «AI agents» سيكونون قريباً قادرين على إرسال الرسائل الإلكترونية، وجدولة المواعيد، وتثبيت حجوزات المطاعم وبطاقات الطائرة، والقيام بمهام معقّدة كـ«التفاوض على علاوة مالية مع ربّ العمل» أو «شراء هدايا عيد الميلاد لجميع أفراد العائلة».

بدت هذه المرحلة، التي لا تزال بعيدة، أقرب قليلاً منّا في السادس من نوفمبر (تشرين الثاني) الحالي عندما أعلنت «أوبن إي آي.»، الشركة المطوّرة لروبوت «تشات جي بي تي»، أنّ المستخدمين يستطيعون اليوم ابتكار روبوتات المحادثة الخاصّة بهم.

أدوات شخصية مبرمجة

بعد لمحة مبكرة على هذه الروبوتات، التي أسمتها الشركة GPTs، التي ستصبح متوفرة لزبائنها ومشتركي خدمة «تشات جي بي تي بلاس»، وجدنا أنّها تختلف عن «تشات جي بي تي» التقليدي بأمور قليلة ولكن مهمّة.

أولاً - برمجة لمهمات محددة

برمجت الروبوتات الشخصية الجديدة للقيام بمهام محدّدة - مثلاً، تشمل ابتكارات «أوبن إي آي» روبوت «مدرّب الكتابة الإبداعية» «Creative Writing Coach» وروبوت «خالط الموكتيل» «Mocktail Mixologist» الذي يقترح على مستخدمه مشروبات غير كحولية.

ثانياً - سحب ودمج البيانات

تستطيع هذه الروبوتات سحب ما تريد من البيانات الخاصّة كمستندات الموارد البشرية في أيّ شركة، أو قاعدة بيانات للوائح العقارية، وأن تدمج هذه البيانات في استجاباتها. ثالثاً، إذا سمحتم لها، تستطيع هذه الروبوتات الاتصال بأجزاء أخرى من حياتكم الإلكترونية كالرزنامة، ولائحة المهام، وحساب «سلاك»، ومن ثمّ التحرّك باستخدام بياناتكم الثبوتية.

* عناصر خبيثة قد تبتكر عمداً ذكاءً اصطناعياً فاسداً لخدمة أهداف خطرة *

مزايا عظيمة ومخاوف من الكوارث

هل يبدو لكم الأمر مخيفاً؟ لأنّه كذلك فعلاً. فإذا سألتم بعض باحثي سلامة الذكاء الاصطناعي، سيقولون لكم إنّهم يخشون منح روبوتات المحادثة المزيد من الاستقلالية؛ لأنّ خطوة كهذه قد تؤدّي إلى كارثة. وكانت منظّمة «مركز سلامة الذكاء الاصطناعي» البحثية غير الربحية، قد وضعت هذا العام الوكلاء المستقلّين على لائحة «مخاطر الذكاء الاصطناعي» الكارثية؛ عازيةً الأمر إلى «العناصر الخبيثة التي قد تبتكر عمداً ذكاءً اصطناعياً فاسداً لخدمة أهداف خطرة».

ولكنّ المساعدين المدعومين بالذكاء الاصطناعي قادرون فعلاً على أداء مهام مفيدة للنّاس، حتّى أنّ الزبائن التجاريين (الشركات) يتوقون لتدريب روبوتات المحادثة باستخدام بياناتهم الخاصّة. وهناك من يحاجج أيضاً بأنّ الذكاء الاصطناعي لن يصبح مفيداً حقاً قبل أن يستطيع فعلاً فهم مستخدميه – أساليبهم في التواصل، وما يحبّون وما لا يحبّون، وما يبحثون عنه ويشترونه عبر الإنترنت.

إذن، ها نحن اليوم، نسارع إلى عصر وكلاء الذكاء الاصطناعي المستقلّين - ولا عزاء للمعترضين!

عروض لأعمال آمنة

لنكن منصفين، لا بدّ من الاعتراف بأنّ روبوتات «أوبن إي آي» ليست خطرة. فقد شاهدتُ عرضاً لأكثر من نموذج GPT خلال مؤتمر المطوّرين الذي أقامته الشركة أخيراً في سان فرنسيسكو، ظهرت خلاله وهي تؤدّي مهام غير مؤذية كتلوين رسومات الأطفال وشرح قواعد لعب الورق.

لا تستطيع هذه الروبوتات الشخصية القيام بالكثير بعد، حيث إنّ أداءها لا يتعدّى البحث في المستندات والاتصال مع التطبيقات الشائعة. شاهدتُ في واحدٍ من العروض أحد موظّفي «أوبن إي آي» يطلب من روبوت GPT البحث عن اجتماعات متضاربة المواعيد في رزنامته في «غوغل» وإرسال رسالة عبر تطبيق «سلاك» لربّ عمله. وشاهدتُ عرضاً آخر على المسرح، عمد فيه سام ألتمان، الرئيس التنفيذي (السابق) لـ«أوبن إي آي» إلى ابتكار روبوت محادثة أسماه «مرشد الشركة الناشئة»، ومهمّته تقديم النصائح للمؤسسين الطامحين باستخدام ملف خطاب كان قد ألقاه العام الماضي.

قد تبدو هذه المهام كحيَل لجذب الاهتمام، إلّا أنّ فكرة تخصيص روبوتات المحادثة والسماح لها بالتحرّك نيابة عنّا تمثّل خطوة مهمّة في ما يسمّيه ألتمان استراتيجية «أوبن إي آي» «للتوظيف التدريجي المكرّر»، أي إدخال تحسينات طفيفة على الذكاء الاصطناعي بمسار سريع بدل إحداث قفزات كبيرة بفوارق زمنية طويلة.

اختبارات مساعد ذكي شخصي

بعدما منحتني «أوبن إي آي» وصولاً مبكراً لمبتكر روبوت GPT الشخصي، أمضيت أيّاماً عدّة ألهو به.

كان «مساعد في الحضانة» «Day Care Helper» أوّل روبوت محادثة مخصّص ابتكرته لنا شخصياً، وهو عبارة عن أداة للإجابة عن أسئلة بخصوص حضانة ابني. فكأبٍ يعاني قلّة النوم ويجد صعوبة في تصفّح دليل الأهل في كلّ مرّة، دائماً ما أنسى بعض التفاصيل، كما إذا كان يمكننا إرسال وجبة خفيفة مع الفول السوداني (وهو أحد مسببات الحساسية لدى بعض الأطفال) أم لا، وما إذا كانت الحضانة مقفلة أو مفتوحة في بعض الأعياد.

لهذا السببّ؛ حمّلت دليل الأهل على أداة ابتكار الروبوت GPT، وفي غضون ثوانٍ، أصبح لديّ روبوت محادثة يمكنني استخدامه بسهولة للبحث عن إجابات على أسئلتي. كان أداؤه مبهراً لا سيّما بعد تغيير التعليمات لإفهامه أنّه من المفترض أن يعطي إجابات مستخدِماً المعلومات المتوفر في الدليل، لا أن يبتكر إجابات لأسئلة لم يعالجها الدليل.

أسميتُ الروبوت الثاني «نصيحة الجدّ رووز المالية» الذي اعتمد على مستند آخر: كتيّب من 23 صفحة يضمّ نصائح كتبها جدّي، الخبير الاقتصادي الشغوف في دراسة الأسهم وصاحب الخبرة الطويلة في التخطيط المالي. أستخدم هذا الكتيّب عند الحاجة، ولكنّني تساءلتُ ما إذا كان سيلهمني أكثر إذا ما وضعته في روبوت محادثة.

حمّلتُ نصّ الكتيّب، وفي أقلّ من خمس دقائق، أصبح لديّ روبوت محادثة يردّد لي نصيحة جدّي المالية ويجيب على أسئلتي. (ولو أنّه في بعض الأماكن انزلق من كلام جدّي وعاد إلى أسلوب «تشات جي بي تي» في الحديث عن الأمور المالية).

لم يكن أداء أيّ من روبوتات المحادثة خاصتي مثالياً وعجزت جميعها عن أداء الكثير من المهام. ولكن إذا دقّقنا في الفكرة وطريقة عمل هذه الأدوات، سيتبيّن لنا نوع الأعمال التي قد يقوم بها وكيل الذكاء الاصطناعي إذا ما أصبح متقناً.

عواقب الذكاء الاصطناعي

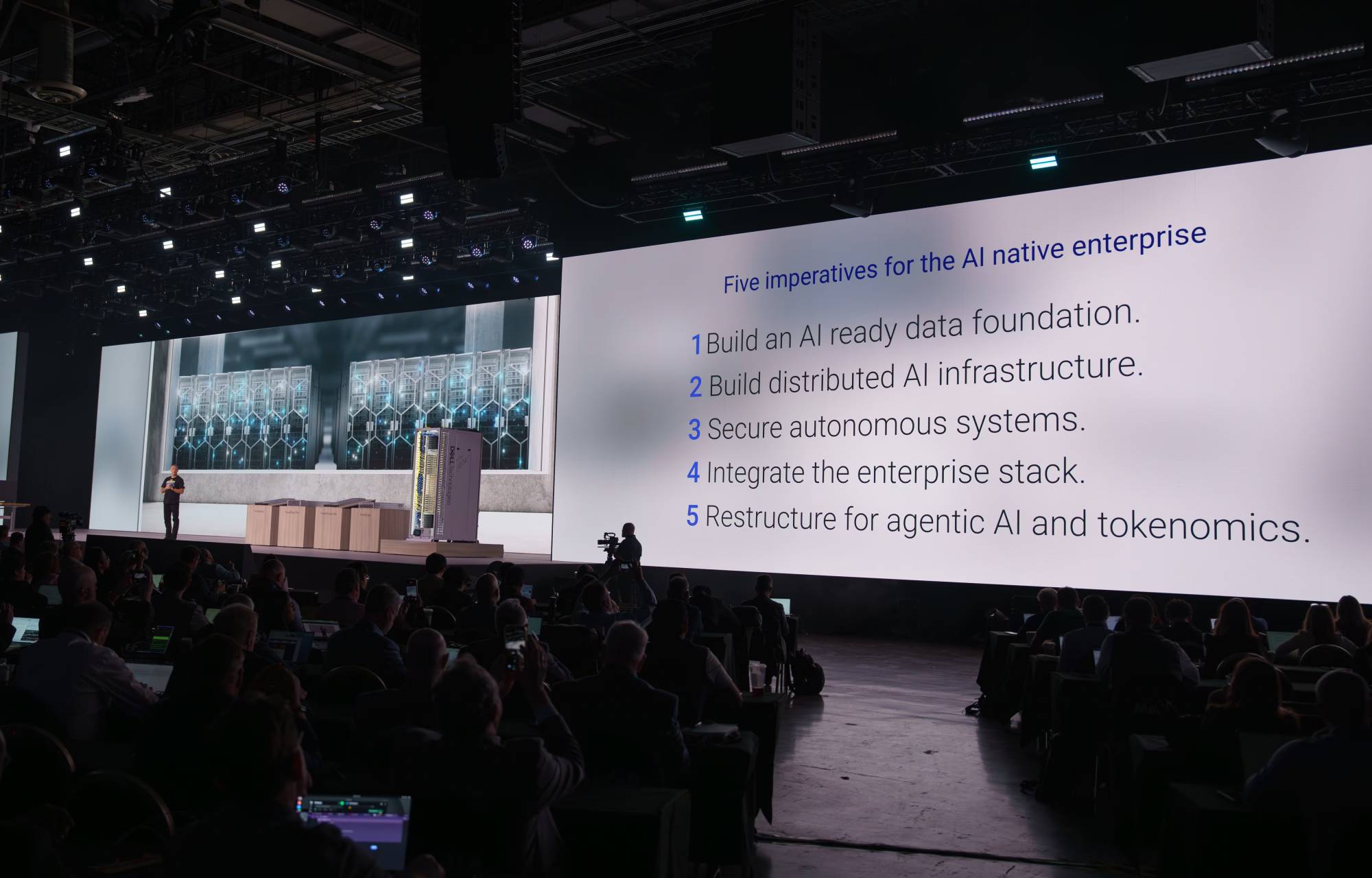

في المقابل، ينطوي تعزيز استقلالية وكلاء الذكاء الاصطناعي، ومنحهم الوصول إلى بياناتنا الشخصية، ووضعهم في قلب كلّ تطبيق نستخدمه، على تبعات وعواقب مقلقة جداً. وإذا صحّت التوقعات، سيتمكّن الذكاء الاصطناعي قريباً جداً من معرفتنا بعمق أكثر، وفي بعض الحالات، سيعرفنا أكثر ممّا نعرف أنفسنا وسيكون قادراً على القيام بأفعال معقّدة مع أو من دون إشرافنا.

وإذا صحّت مزاعم «أوبن إي آي»، قد نكون على مشارف الانتقال إلى عالمٍ يكون فيه الذكاء الاصطناعي شريكاً أقلّ إبداعاً، بل يصبح توسعاً سيليكونياً لنا نحن البشر، يأتي على شكل أدمغة صناعية قادرة على التنقّل حول العالم لجمع المعلومات والتصرّف نيابة عنّا. إذا كنتم غير جاهزين تماماً لهذا العالم بعد، ننصحكم بأن تبدؤوا بتهيئة أنفسكم له.

* خدمة «نيويورك تايمز»