كيف يجمع الذكاء الاصطناعي بياناتك، وكيف تكون حذراً؟ لقد اندمج الذكاء الاصطناعي بسلاسة في حياتنا اليومية، وأخذ يؤثر على كيفية تفاعلنا مع التكنولوجيا، وهو يراقب صحتنا، بل وحتى يؤدي مهام أساسية.

من شفرات الحلاقة وفرش الأسنان الكهربائية المزودة بالذكاء الاصطناعي إلى أدوات الذكاء الاصطناعي المستخدمة في التوليد والتنبؤ، أصبحت تلك الأنظمة لا غنى عنها. مع ذلك يثير الاستخدام واسع الانتشار للذكاء الاصطناعي أيضاً مخاوف بشأن خصوصية البيانات، حيث كثيراً ما تجمع تلك التكنولوجيا قدراً هائلاً من المعلومات الشخصية.

الذكاء الاصطناعي في الحياة اليومية

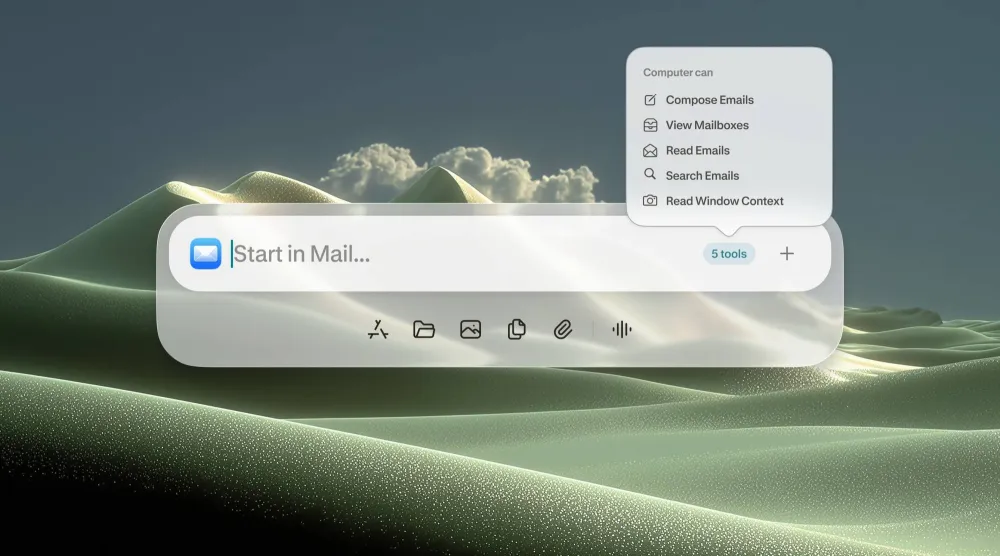

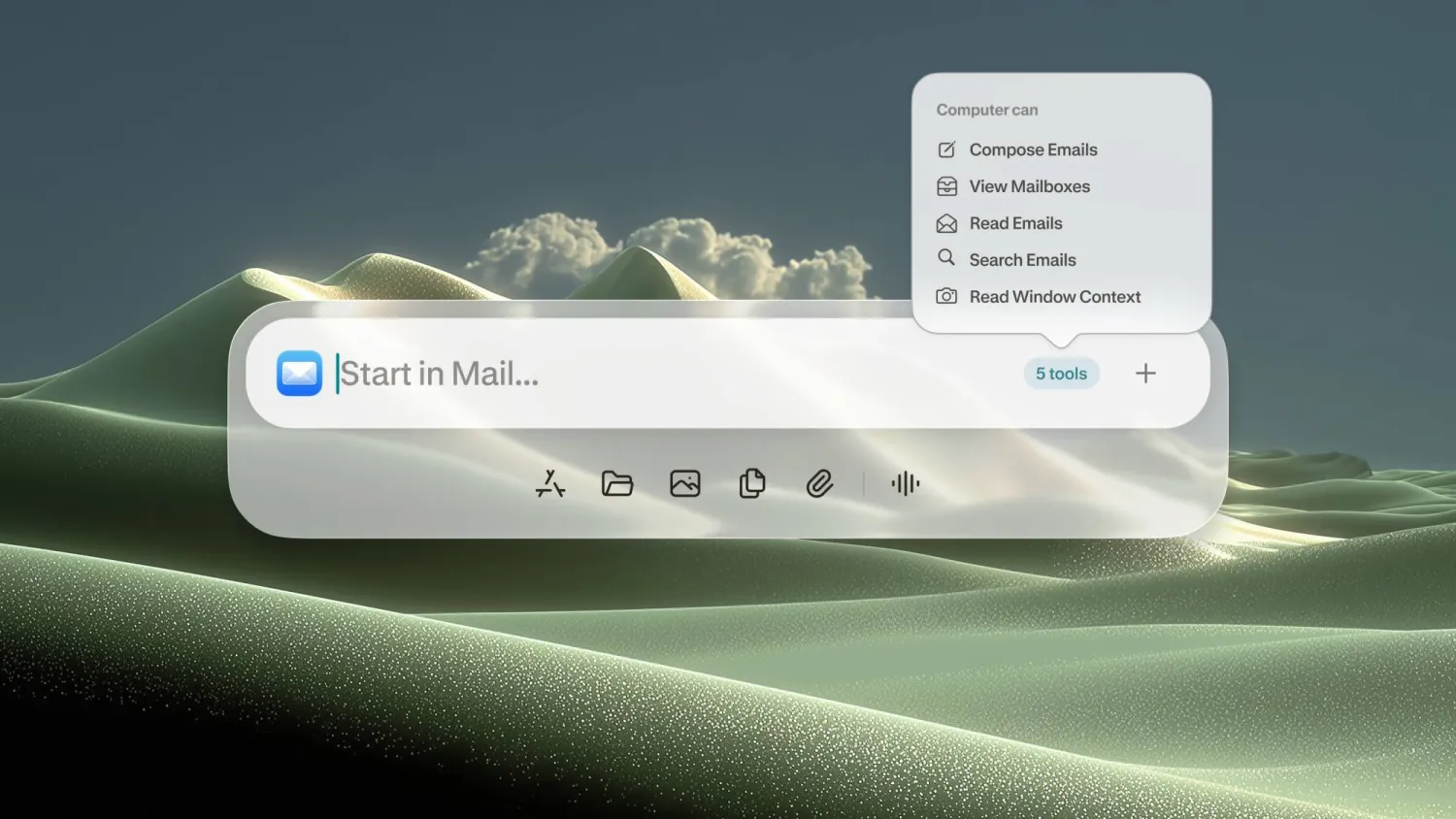

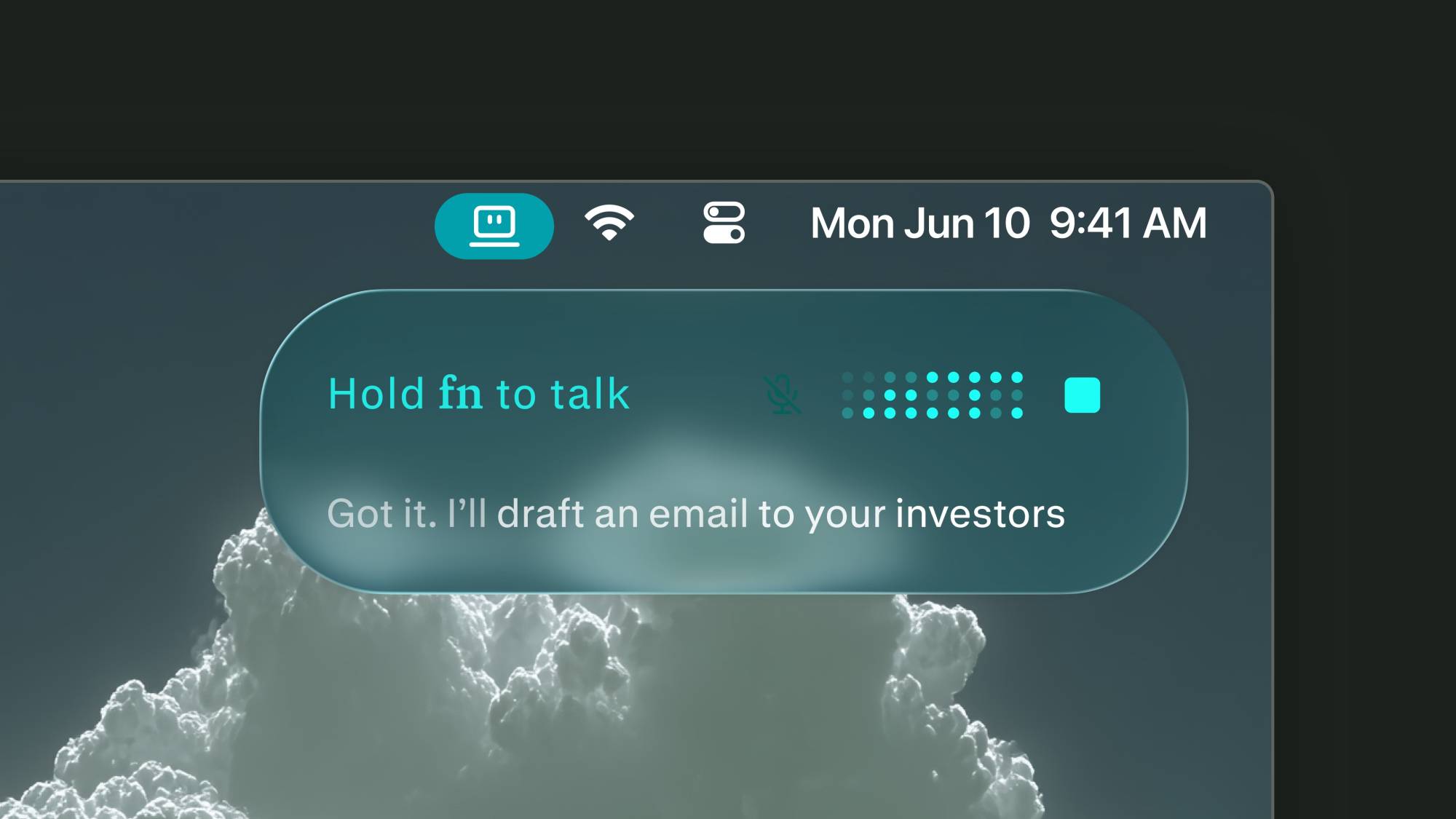

وجد الذكاء الاصطناعي طريقه إلى العديد من الأجهزة سواء كانت أساسية أو غير أساسية، ومن بينها أجهزة تتبع اللياقة البدنية والساعات الذكية التي تراقب الأنشطة الروتينية اليومية، أو مساعدات الذكاء الاصطناعي، مثل «تشات جي بي تي» و«مايكروسوفت كوبايلوت»، التي تجيب عن الاستفسارات وتساعد في إنشاء أي محتوى. وتعتمد تلك الأدوات على جمع البيانات للوصول إلى أفضل أداء وتزويد المستخدمين بتجارب ذات طابع شخصي. كذلك تستخدم أجهزة بسيطة مثل الفرش الكهربائية حالياً خوارزميات التعلم الآلي لتتبع أنماط الاستخدام وتقديم تغذية راجعة في الوقت الفعلي.

في الوقت الذي يقدّر فيه الكثيرون ما يقدمه الذكاء الاصطناعي من راحة ونفع، تثير عملية جمع البيانات التي تغذي هذه الأنظمة مخاوف كبيرة بشأن الخصوصية، إذ كثيراً ما يكون المستخدمون غير واعين تماماً بمدى وطبيعة البيانات التي يتم جمعها.

ويمكن لتلك البيانات الكشف عن العادات والأمور المفضلة، بل وحتى توقع السلوكيات المستقبلية، مما يمثل فرصاً ومخاطر في آن واحد.

كيف يجمع الذكاء الاصطناعي البيانات؟

أنظمة الذكاء الاصطناعي مصممة لجمع البيانات بطرق متنوعة بحسب وظيفتها. وتُعرف أدوات الذكاء الاصطناعي المستخدمة في التوليد والتنبؤ، بوجه خاص، بطرقها في جمع المعلومات.

* أدوات الذكاء الاصطناعي التوليدي. تعتمد أنظمة الذكاء الاصطناعي التوليدي، مثل «تشات جي بي تي» و«غوغل جيميناي»، في عملها على كميات كبيرة من البيانات. وعندما يتفاعل المستخدمون مع هذه الأدوات، يتم تسجيل أو تخزين أو تحليل كل مُدخل أو معطى، سواء كان سؤالاً أو أمرأً أو رداً، لتعزيز أداء نموذج الذكاء الاصطناعي.

وتنص سياسة الخصوصية لمؤسسة «أوبن إيه أي» المنتجة لـ «جي بي تي» صراحةً على احتمال استخدام المحتوى، الذي يقدمه المستخدمون، من أجل تحسين خدماتها وتدريب النماذج التي يعتمد عليها «تشات جي بي تي». وبينما يمكن للمستخدمين الانسحاب من الإسهام ببياناتهم في تدريب النموذج، تجمع مؤسسة «أوبن إيه آي» البيانات الشخصية وتحتفظ بها.

كذلك ورغم زعم الشركات استخدام هذه البيانات دون تحديد هوية أو تعريف، حيث تحذف كل ما يصلها بأفراد بعينهم، تظل هناك مخاطرة بإعادة الهوية إلى تلك البيانات. وقد يكشف ذلك عادات شخصية، أو أموراً مفضلة، أو معلومات حسّاسّة في حال إساءة استخدام البيانات أو انتهاكها.

* أدوات الذكاء الاصطناعي التنبؤي. إضافة إلى الذكاء الاصطناعي التوليدي، تضطلع أنظمة الذكاء الاصطناعي التنبؤي بدور كبير في جمع البيانات. وتعدّ مواقع التواصل الاجتماعي مثل الـ«فيسبوك» و«إنستغرام» و«تيك توك» من الأمثلة البارزة، حيث تجمع تلك المواقع باستمرار بيانات عن المستخدمين، وتلتقط وتسجل كل تفاعل سواء كان إعجاب بمنشور، أو تعليق على مقطع مصور، أو الوقت الذي يقضيه المستخدم في مشاهدة محتوى محدد. ويُستخدم كل فعل كنقطة بيانات داخل الصفحة الشخصية الرقمية للفرد.

لا تستخدم تلك الصفحات الشخصية في تنقيح أنظمة توصية الذكاء الاصطناعي، التي تقترح محتوى متوافقاً مع تفضيلات المستخدم فحسب، بل يتم بيعها إلى وسطاء البيانات، الذين يبيعون بدورهم هذه المعلومات إلى شركات تستخدمها لأغراض مثل الإعلانات الموجهة. ينشيء ذلك بيئة يتم تحويل فيها البيانات الشخصية إلى سلعة.

تبعات جمع البيانات

يمكن أن تتمتع البيانات، التي تجمعها أنظمة الذكاء الاصطناعي، بقوة هائلة، حيث تمكّن النماذج التنبؤية من تقديم توقعات دقيقة بشأن سلوك المستخدمين، ويستخدم الذكاء الاصطناعي التوليدي البيانات من أجل إنشاء محتوى جديد، مثل الاستجابات المعدّلة حسب الطلب أو الأعمال الإبداعية، في حين يستعين الذكاء الاصطناعي التنبؤي ببيانات تاريخية لتوقع أفعال مستقبلية مثل تحديد كيفية تحقيق شخص ما هدف من أهداف اللياقة البدنية، أو توقع ما يفضله من أفلام.

على الجانب الآخر، يؤدي الاعتماد المتزايد على البيانات إلى نقاط ضعف، حيث يمكن أن يتسبب جمع البيانات الشخصية في عملية توسعية في جمع المعلومات تطلّع فيها شركات أو أطراف غير مصرح لها على جوانب شخصية لحياة الأفراد. كذلك تزيد خطر انتهاك البيانات، حيث يمكن أن تتعرض معلومات حسّاسّة إلى الكشف أو الاستغلال.توصيات الحفاظ على خصوصية البيانات

في ظل استمرار تطور الذكاء الاصطناعي، من المهم بالنسبة إلى المستخدمين توخي الحذر بشأن خصوصية بياناتهم. فيما يلي بعض الإجراءات التي ينبغي النظر فيها:

* فهم سياسات الخصوصية: خذ الوقت الكافي لقراءة وفهم سياسات الخصوصية الخاصة بأدوات الذكاء الاصطناعي والمواقع. ربما تمكنك معرفة كيفية جمع وتخزين واستخدام بياناتك من اتخاذ قرارات واعية.

* خيارات الانسحاب: حاول الانسحاب من عملية المساهمة ببياناتك لأغراض مثل تدريب النماذج، حين يكون ذلك متاحاً. في الوقت الذي قد لا يمنع ذلك عملية جمع البيانات بشكل كامل، يمكنه أن يحدّ ويقيد كيفية استخدام بياناتك.

* الحد من مشاركة البيانات قدر الإمكان: كنّ انتقائياً فيما يتعلق بالمعلومات التي تشاركها مع أدوات الذكاء الاصطناعي. والتزم بالمدخلات الأساسية، واحرص على تفادي تقديم تفاصيل شخصية حسّاسّة.

* أستاذ مساعد للأمن السيبراني في جامعة ويست فرجينيا، مجلة «فاست كومباني»، خدمات «تريبيون ميديا».

* تعديل إعدادات الخصوصية: احرص على تعديل إعدادات الخصوصية الموجودة في مواقع التواصل الاجتماعي وغيرها من المنصات من أجل تقييد قدر البيانات التي تكون مرئية أو معلنة.

* استخدام أدوات للمحافظة على الخصوصية: تركز الوسائل التكنولوجية الناشئة على إنشاء أنظمة آمنة تمنح خصوصية المستخدمين الأولوية. اسع وراء الأدوات التي تتماشى مع تلك المبادئ.

بناء مستقبل ذكاء اصطناعي آمن

بوصفي متخصصاً في الأمن السيبراني أؤكد أن هناك حاجة ملّحة إلى أنظمة قوية تحافظ على الخصوصية. كما أن البحث في هذا المجال ضروري وحيوي لتطوير وسائل تكنولوجية تحقق التوازن بين الابتكار وحماية الحقوق الشخصية.

لا يكمن التحدي في تصميم أنظمة آمنة فقط، لكن أيضاً في تعزيز ودعم الشفافية والمساءلة بين الشركات التي تطور تكنولوجيا الذكاء الاصطناعي. كما أن ضمان أخلاقية ممارسات جمع البيانات واحترامها لخصوصية المستخدمين سيكون ضرورياً للحفاظ على ثقة الناس في الذكاء الاصطناعي.

وأخيراً، فإن الذكاء الاصطناعي يتمتع بإمكانية تحويل حياة البشر إلى الأفضل من خلال تحسين الفعالية والكفاءة والراحة واليسر وإضفاء الطابع الشخصي. مع ذلك يتطلب جمع واستخدام البيانات الشخصية على نطاق واسع من جانب أدوات الذكاء الاصطناعي اليقظة والحذر. ويمكن للأفراد اتخاذ قرارات واعية بدرجة أكبر بشأن ما يستخدمونه من وسائل تكنولوجية من خلال فهم كيفية عمل تلك الأنظمة واتخاذ خطوات لحماية الخصوصية.

يكمن مستقبل الذكاء الاصطناعي في تحقيق توازن بين تسخير واستغلال قدراته واحترام الحق الأساسي في الخصوصية. ومن الممكن تشكيل أنظمة ذكاء اصطناعي قوية وأخلاقية وآمنة في الوقت ذاته من خلال الجهود الفعالة والابتكار المتواصل.

* أستاذ مساعد للأمن السيبراني في جامعة ويست فرجينيا، مجلة «فاست كومباني»، خدمات «تريبيون ميديا».