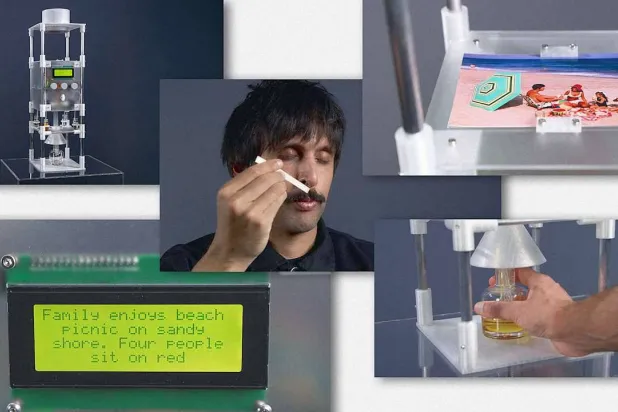

تُستخدم تقنية «ديب فيك» (برنامج إلكتروني يتيح للنّاس تبديل الوجوه، والأصوات، وغيرها من السمات لابتكار محتوى رقمي مزوّر) منذ بضع سنوات لصناعة بديلٍ لإيلون ماسك وهو يروّج لعملية احتيال بواسطة العملات المشفّرة، أو «لتعرية» أكثر من 100 ألف امرأة رقمياً على منصّة تليغرام، أو لسرقة ملايين الدولارات من شركات عبر تقليد أصوات تنفيذيّيها على الهاتف.

تقنية منفلتة

تعجز السلطات في معظم أنحاء العالم عن التعامل مع هذه التقنية، حتّى إنّ القوانين التي تضبط انتشارها لا تزال قليلة جداً، على الرغم من نموّ هذا البرنامج وزيادة تطوّره ووصوله للمستخدمين.

وتأمل الصين أن تكون استثناءً في هذا المجال بعد أن أقرّت الشهر الماضي قوانين جديدة تفرض الحصول على موافقة الشخص أو صاحب موضوع المادّة التي أخضعت للتلاعب، وأن تحمل دمغات بتواقيع رقمية أو علامات مائية، وإجبار مزوّدي خدمات «ديب فيك» على توفير وسائل لـ«دحض الشائعات».

لكنّ الصين تواجه العقبات نفسها التي أدت إلى إحباط جهود سابقة لتنظيم المواد المزيّفة التي تنتجها هذه التقنية. ذلك لأنّ أسوأ مستخدميها يكونون غالباً الأصعب ضبطاً لأنّهم يعملون دون هوية، ويتأقلمون بسرعة، ويتشاركون بابتكاراتهم الصناعية من خلال منصّات إلكترونية مفتوحة. سلّطت خطوة الصين الضوء أيضاً على سببٍ آخر لتبنّي عددٍ قليلٍ من الدول قوانين ضابطة في هذا المجال، وهو شعور كثيرين بالقلق من استخدام الحكومات هذه القوانين لخنق حريّة التعبير.

ويرى خبراء التقنية أنّ مجرّد مضيّ الصين بتطبيقها لقوانينها الجديدة سيؤثّر على كيفية تعاطي حكومات أخرى مع التعلّم الآلي والذكاء الصناعي اللذين يشغّلان تقنية «ديب فيك». وبسبب السوابق القليلة في هذا المجال، يبحث المشرّعون اليوم حول العالم عن حالات اختبار للّحاق بالصين أو رفض خطوتها.

يعتبر رافيت دوتان، باحثٌ في مرحلة ما بعد الدكتوراه ومدير مختبر «كولابوريتف إي آي ريسبونسبليتي» في جامعة بيتسبرغ، أنّ «مشهد الذكاء الصناعي مثير لاهتمام السياسات العالمية، لأنّ الدول تتنافس لفرض طريقة التعامل مع هذه المسألة. نعلم أنّ القوانين آتية، لكنّنا لا نعرف ما هي بعد، إذ يوجد كثير من الاحتمالات».

تطبيقات واعدة ومخيفة

تحمل تقنيات «ديب فيك» آمالاً واعدة في قطاعات كثيرة. فقد أحيت الشرطة الهولندية العام الفائت قضية مجمّدة من عام 2003 بابتكار شخصية رقمية لضحية جريمة قتل (13 عاماً) ونشرت صوراً له يسير بين مجموعة من أصدقائه وأفراد عائلته في الزمن الحاضر. تُستخدم التقنية أيضاً للسخرية والتهكّم، وتخدم المتبضّعين الإلكترونيين في تجربة الملابس في غرف تبديل افتراضية، وفي محاكاة المتاحف، ومن قبل الممثلين الذين يأملون التحدّث بلغات عدّة في إطلاقات الأفلام الدولية. علاوةً على ذلك، استخدم باحثون من مختبر الإعلام في معهد ماساتشوستس للتقنية، وفي منظّمة اليونيسف، تقنيات مشابهة لدراسة حالات التعاطف، من خلال وضع مشاهد الحرب والدمار، التي سبّبتها الحرب السورية، على صور مدن في أميركا الشمالية وأوروبا.

في المقابل، يساهم برنامج «ديب فيك» في تطبيقاتٍ مخيفة كثيرة أيضاً، إذ يتخوّف خبراء القانون من أن سوء استخدام تقنيات «ديب فيك» يهشم ثقة الناس بشرائط المراقبة الأمنية، والكاميرات الجسدية، وغيرها من الأدلّة، «ففي قضية حضانة في إحدى المحاكم البريطانية عام 2019، قدّم وكيل أحد الأبوين مقطعاً معدّلاً يظهر الطرف الآخر وهو يهدّد الطفل بعنف».

قد يساهم المحتوى الرقمي المزوّر أيضاً بتشويه سمعة رجال الشرطة والتحريض عليهم، أو في إرسالهم في مهام كاذبة. وكانت وزارة الأمن الداخلي في الولايات المتحدة قد حذّرت من مخاطر أخرى للـ«ديب فيك»، أبرزها التنمّر الإلكتروني، والابتزاز، والتلاعب بالبورصة، والاضطرابات السياسية.

ويتوقّع بعض الخبراء أن يصبح 90 في المائة من المحتوى الإلكتروني مفبركاً خلال سنواتٍ قليلة.

وأشار تقرير لليوروبول (وكالة تطبيق القانون الأوروبية) العام الماضي إلى أنّ العدد المتزايد لمواد «ديب فيك» يمكن أن يؤدّي إلى وضعٍ يفتقر فيه النّاس إلى واقعٍ مشترك، أو يؤسس لارتباك اجتماعي حول أيّ من مصادر المعلومات يتمتّع بالموثوقية، أي ما يُعرف بـ«نهاية عالم المعلومات» أو «لا مبالاة الواقع».

فشل قانوني

تحدّث مسؤولون بريطانيون العام الفائت أيضاً عن تهديدات عدّة، أبرزها موقع إلكتروني «يعرّي النساء افتراضياً» حصد 38 مليون زيارة في الأشهر الثمانية الأولى من 2021. لكنّ الاقتراحات القاضية بوضع ضوابط لهذه التقنية في المملكة المتحدة ودول الاتحاد الأوروبي لا تزال بانتظار تحويلها إلى قوانين.

وفي الولايات المتّحدة، باءت محاولات تشكيل قوّة خاصّة لمعاينة تقنية «ديب فيك» بالفشل. ففي عامي 2019 و2021 تقدّمت عضو الكونغرس إيفيت د. كلارك، بمشروع قانون، عنوانه «الدفاع عن كلّ شخص من الإطلالات المزيفة من خلال شمل فعل الاستغلال بقانون المحاسبة»، لكنّه لا يزال بانتظار التصويت عليه. وتحدّثت كلارك عن نيّتها تقديم مشروع القانون نفسه هذا العام أيضاً.

واعتبرت كلارك أنّ قانونها، الذي سيفرض على محتوى «ديب فيك» عرض علامات مائية أو أسماء تعريفية، كان «إجراءً للحماية» على عكس القوانين الصينية التي وصفتها بأنّها «تميل إلى آليات للسيطرة».

وتستهدف القوانين المطبّقة في الولايات المتّحدة بمعظمها المقاطع المزيّفة السياسية والإباحية. من جهته، قال مارك بيرمن، عضو الحزب الديمقراطي في جمعية ولاية كاليفورنيا، الذي يمثّل أجزاء من وادي سيليكون، ويرعى هذا النوع من التشريعات، إنّه ليس على علمٍ بأيّ جهود تُبذل لإنفاذ قوانينه عبر الدعاوى القانونية أو الغرامات.

وتحظر ولايات قليلة أخرى، كنيويورك، المحتوى المزيّف الإباحي. وخلال ترشّحه لدورة أخرى في انتخابات عام 2019، قال حاكم ولاية هيوستن إنّ إعلاناً حساساً تابعاً لمرشّح آخر خرق أحد قوانين تكساس التي تحظر المحتوى السياسي المضلّل المصمّم بتقنيات «ديب فيك».

لكنّ القوانين وقرارات الحظر قد تواجه صعوبة في احتواء تقنية صُمّمت للتأقلم والتحسّن المستمر. فقد أثبت باحثون من مؤسسة راند للأبحاث والتطوير مدى صعوبة تحديد محتوى «ديب فيك»، بعرض مجموعة مقاطع فيديو على أكثر من 3 آلاف شخص، طلبوا منهم تحديد المقاطع المزوّرة (كمقطع «ديب فيك» الذي أظهر الناشطة في مجال المناخ غريتا تونبرغ وهي تتنصّل من نظرية وجود التغير المناخي).

أخطأت المجموعة المشاركة في ثلث الحالات، حتّى إنّ عشرات الطلّاب الذين يدرسون التعلّم الآلي في جامعة كارنيغي ميلون أخطأوا في أكثر من 20 في المائة من المرّات.

وتحاول مبادرات من شركات كـ«مايكروسوفت» و«أدوبي» اليوم إثبات أصالة المواد الإعلامية وتدريب تقنيات الاعتدال للتعرّف على التناقضات التي تكشف المحتوى المفبرك. لكنّ المعاناة في التفوق على صانعي محتوى «ديب فيك» حقيقية ومتواصلة، لأنّهم يكتشفون غالباً وسائل جديدة لتصحيح العيوب، وإزالة العلامات المائية المعرّفة، وتعديل البيانات الوصفية لتغطية آثارهم.

وأخيراً، يقول جاريد موندشين، عالم في مؤسسة راند: «يوجد سباق تسلّح تقني بين صانعي مقاطع (ديب فيك) وراصديها، وحتّى يحين وقت البدء بابتكار وسائل تحسّن رصد المحتوى المزوّر، سيكون من الصعب على أيّ تشريعات، مهما كثرت، أن تضع حداً لهذا الموضوع».