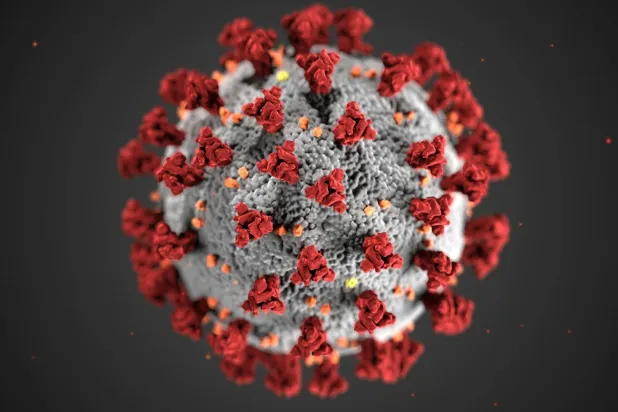

يعتزم الرئيس الروسي فلاديمير بوتين، الحصول على لقاح فيروس كورونا الجديد، الذي تم تطويره مؤخراً في البلاد.

وقال المتحدث باسم الكرملين دميتري بيسكوف، في تصريحات نقلتها وكالة الأنباء الرسمية (تاس)، إن بوتين يعتزم الحصول على حقنة من اللقاح، قبل أن يقوم بزيارة نظيره في كوريا الجنوبية.

ويقول بيسكوف إن «بوتين حصل على الدعوة ذات الصلة التي تمسك بها نظيره الكوري الجنوبي أمس. وأكد بوتين أنه سيستفيد بالتأكيد من هذه الدعوة اللطيفة، بعد فترة من الوقت، وذلك بعد أن قرر الحصول على لقاح فيروس كورونا». ولم يذكر موعد الزيارة.

من ناحية أخرى، ذكرت وكالة الأنباء الكورية الجنوبية الرسمية (يونهاب) أمس الاثنين، بعد إجراء مكالمة هاتفية بين الزعيمين، أن بوتين سوف يقوم بزيارة البلاد بعد استقرار وضع فيروس كورونا بصورة أكبر.

9:48 دقيقه

الكرملين: بوتين يعتزم الحصول على لقاح «كورونا»

https://aawsat.com/home/article/2536271/%D8%A7%D9%84%D9%83%D8%B1%D9%85%D9%84%D9%8A%D9%86-%D8%A8%D9%88%D8%AA%D9%8A%D9%86-%D9%8A%D8%B9%D8%AA%D8%B2%D9%85-%D8%A7%D9%84%D8%AD%D8%B5%D9%88%D9%84-%D8%B9%D9%84%D9%89-%D9%84%D9%82%D8%A7%D8%AD-%C2%AB%D9%83%D9%88%D8%B1%D9%88%D9%86%D8%A7%C2%BB

الكرملين: بوتين يعتزم الحصول على لقاح «كورونا»

الرئيس الروسي فلاديمير بوتين يعقد اجتماعًا اليوم عبر الفيديو مع أعضاء الحكومة (د.ب.أ)

الكرملين: بوتين يعتزم الحصول على لقاح «كورونا»

الرئيس الروسي فلاديمير بوتين يعقد اجتماعًا اليوم عبر الفيديو مع أعضاء الحكومة (د.ب.أ)

مواضيع

مقالات ذات صلة

لم تشترك بعد

انشئ حساباً خاصاً بك لتحصل على أخبار مخصصة لك ولتتمتع بخاصية حفظ المقالات وتتلقى نشراتنا البريدية المتنوعة