لم يكن الاجتماع الذي عقدته «منظمة الصحة العالمية» في الأول من أبريل (نيسان) 2026، مجرد لقاء تقني لمناقشة مستقبل الصحة الرقمية، بل بدا أقرب إلى لحظة مراجعة عالمية لسؤال يتجاوز التكنولوجيا نفسها: مَن يملك القرار عندما تدخل الخوارزميات إلى قلب الطب؟

مشهد عالمي... وسؤال واحد

في تلك المشاورات التي جمعت حكومات، وشركات، وخبراء، وممثلين عن المجتمع المدني، لم يكن النقاش حول أدوات أو منصات، بل حول شيء أعمق بكثير: كيف يمكن تحويل الأخلاق من مبادئ تُكتب إلى شروط تُبرمج داخل الأنظمة؟

وللمرة الأولى، لم تعد الأخلاقيات هامشاً مكمّلاً للتقنية، بل أصبحت في صلبها.

لكن خلف هذا المشهد التوافقي الهادئ، يظل سؤال أكثر إرباكاً يفرض نفسه: هل يمكن فعلاً الاتفاق على أخلاقيات عالمية... في عالم لا يتفق حتى على معنى القرار الطبي نفسه؟

من التقنية إلى الأخلاق: تحوّل في مركز الثقل

ما يلفت الانتباه في هذه الاستراتيجية ليس ما تقوله عن التكنولوجيا، بل ما تكشفه من تحوّل في طريقة التفكير؛ فبعد سنوات كان التركيز فيها منصبّاً على توسيع استخدام الأنظمة الرقمية، تتحول البوصلة اليوم نحو مفاهيم أكثر عمقاً: العدالة، والثقة، والشمول، وحوكمة البيانات. لم يعد السؤال كيف نستخدم التقنية؟ بل: كيف نضبطها؟

الوثيقة تدعو إلى نموذج «متعدد الأطراف»، لا يقتصر فيه القرار على الحكومات، بل يمتد ليشمل القطاع الخاص، والمجتمع المدني، والمؤسسات الأكاديمية، في محاولة لبناء نظام صحي رقمي يعكس تعقيد الواقع العالمي، لا في صورته النظرية المبسطة. لكن هذا الطموح، رغم وجاهته، يكشف مفارقة دقيقة: فإذا شارك الجميع في القرار... فمن يتحمل نتيجته؟

وهم الإجماع: عندما يصبح الجميع مسؤولاً... ولا أحد مسؤول

في الظاهر، يبدو النموذج التشاركي مثالياً؛ فهو يعزز الشفافية، ويحدّ من الانحياز، ويمنح القرار طابعاً جماعياً مطمئناً. لكن في العمق، يحمل هذا النموذج مفارقة دقيقة؛ حين تتوزع المسؤولية على الجميع... قد تختفي. فالقرار الطبي، بطبيعته، لا يحتمل الغموض. في لحظة التشخيص أو التدخل العلاجي، لا يمكن للطبيب أن يستند إلى «إجماع خوارزمي»، ولا إلى رأي موزّع بين أنظمة متعددة. هناك دائماً لحظة حاسمة يتحمل فيها إنسان واحد مسؤولية الاختيار.

وهنا يظهر التوتر بين عالمين لا يلتقيان بسهولة: عالم الخوارزميات الذي يميل إلى توزيع القرار، وعالم الطب الذي يقوم (في جوهره) على تحمّل مسؤوليته.

حين تتقدم القدرة... ويتأخر الفهم

أصبح الذكاء الاصطناعي قادراً على تحليل البيانات الطبية بدقة غير مسبوقة، واقتراح قرارات قد تتفوق في بعض الحالات على التقدير البشري، خصوصاً في قراءة الصور الطبية أو ربط المؤشرات المعقدة في السجلات الصحية.

لكن هذه القدرة التقنية، رغم أهميتها، لا تعني بالضرورة فهماً كاملاً لما يحدث في الواقع السريري. فالأنظمة الذكية لا تعيش نتائج قراراتها، ولا تتعامل مع المريض بوصفه تجربة إنسانية متكاملة، بل كبيانات قابلة للتحليل. إنها قادرة على الحساب، لكنها لا تدرك السياق. وتستطيع التنبؤ، لكنها لا تتحمل تبعات الخطأ.

وهنا يكمن التحدي الحقيقي في الطب الحديث: أن نمتلك أدوات قادرة على دعم القرار بدرجة عالية من الدقة، دون أن نخلط بين القدرة الحسابية... والفهم السريري الكامل لنتائج هذا القرار.

القرار... وما الذي لا تقوله الوثيقة؟

رغم شمول هذه الاستراتيجية، فإنها تترك عدداً من الأسئلة الجوهرية دون إجابة واضحة، وهي أسئلة تمسّ جوهر القرار الطبي نفسه.

- من يتحمل المسؤولية عند الخطأ؟

- ومن يملك صلاحية إيقاف النظام عندما تنحرف الخوارزمية عن المسار الصحيح؟

- ومتى يجب أن يمتنع الذكاء الاصطناعي عن تقديم التوصية، بدلاً من الاستمرار في إعطاء إجابة قد تكون مضللة؟

هذه الأسئلة لا تتعلق بالتقنية بقدر ما تتعلق بحدودها.

وفي هذا السياق، يبرز مفهوم «الصمت الخوارزمي» بوصفه أحد أهم التحديات المقبلة، وهو اللحظة التي يجب فيها على النظام الذكي أن يتراجع، لأن القرار يتجاوز نطاق البيانات التي بُني عليها، أو لأن درجة عدم اليقين أصبحت أعلى من أن تُترجم إلى توصية موثوقة.

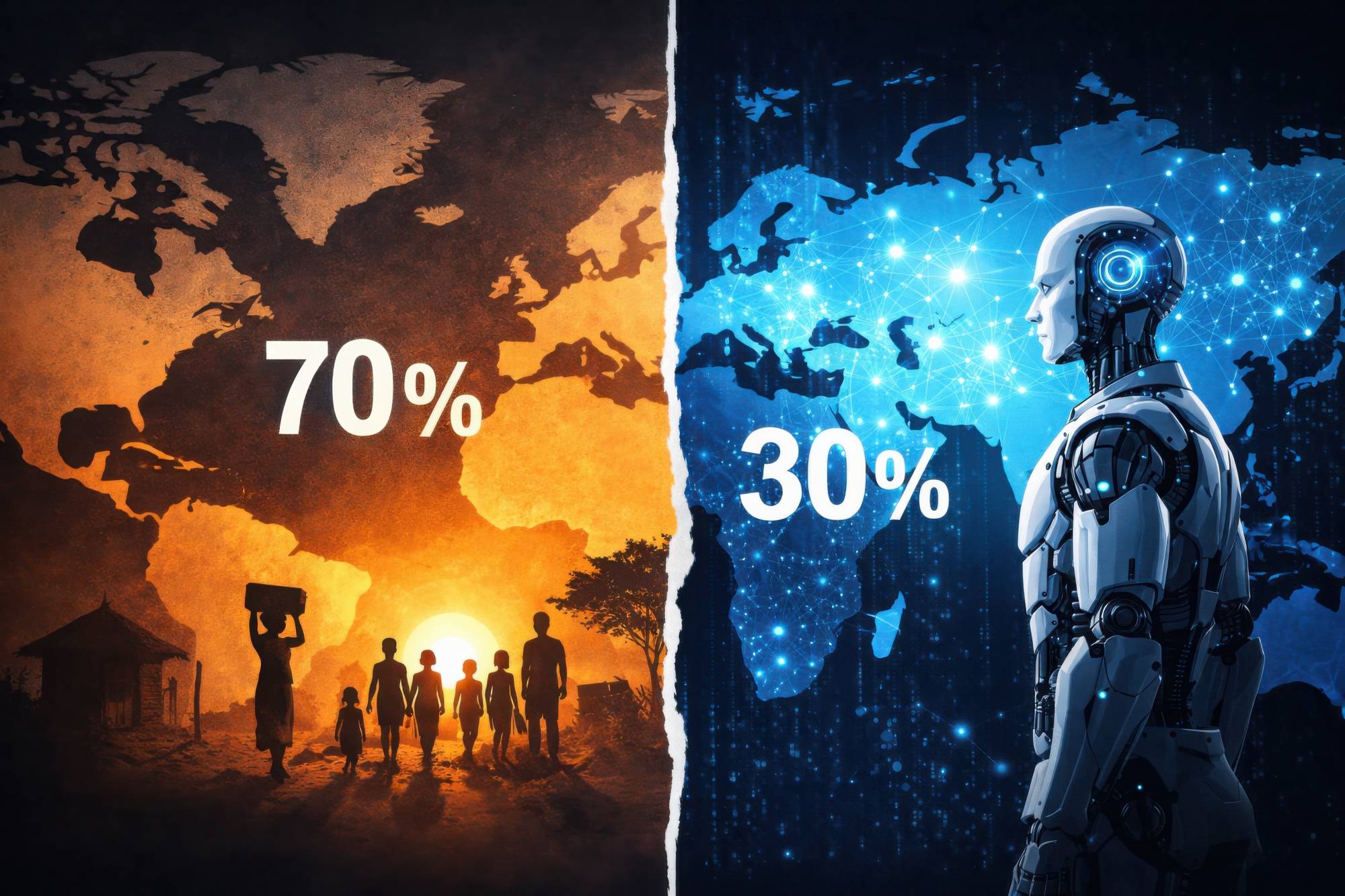

* نحو 30 في المائة من سكان العالم فقط يمتلكون البنية التحتية الرقمية والقدرات

التقنية التي تسمح بتطبيق التقنيات الذكية في الممارسة الطبية بشكل فعلي

وهم الشمول: هل العالم متساوٍ رقمياً؟

رغم أن هذه الاستراتيجية تدعو إلى شمول عالمي في تبني الصحة الرقمية والذكاء الاصطناعي، فإن الواقع يكشف مفارقة واضحة؛ فالتقديرات تشير إلى أن نحو 30 في المائة فقط من سكان العالم يمتلكون البنية التحتية الرقمية والقدرات التقنية التي تسمح بتطبيق هذه التقنيات في الممارسة الطبية بشكل فعلي.

وهنا يبرز سؤال لا يقل أهمية عن الأخلاقيات نفسها: كيف يمكن تحقيق «عدالة رقمية» في عالم غير متكافئ رقمياً من الأساس؟ فالدعوة إلى الشمول، رغم عدالتها النظرية، قد تحمل نتيجة معاكسة؛ إذ قد تؤدي عملياً إلى توسيع الفجوة بين أنظمة صحية متقدمة قادرة على توظيف الذكاء الاصطناعي لتحسين جودة الرعاية، وأخرى لا تزال تكافح لتوفير الحد الأدنى من الخدمات الطبية.

وفي هذا السياق، لا يعود الذكاء الاصطناعي مجرد أداة للتطوير، بل قد يتحول (من حيث لا يُقصد) إلى عامل جديد يعيد رسم خريطة العدالة الصحية على مستوى العالم.

بين العدالة... والحياة

من أكثر التحديات تعقيداً في الطب أن القرار «الأخلاقي» لا يكون دائماً «عادلاً» بالمعنى النظري أو الإحصائي؛ ففي الممارسة السريرية، قد يضطر الطبيب إلى اتخاذ قرار لا يحقق التوازن بين جميع الخيارات، بل يركّز على إنقاذ حالة محددة في لحظة حرجة، حتى لو جاء ذلك على حساب اعتبارات أخرى. وهذا النوع من القرارات يعتمد على السياق، وعلى تقدير المخاطر، وعلى فهم الحالة الفردية للمريض.

في المقابل، تميل الخوارزميات بطبيعتها إلى البحث عن التوازن، وإلى تقديم توصيات تستند إلى الأنماط العامة والنتائج الأكثر ترجيحاً على مستوى المجموعات. وهنا يظهر التحدي الحقيقي: الفارق بين قرار يُبنى على حساب الاحتمالات... وقرار يُتخذ في مواجهة حالة إنسانية فردية.

الخاتمة: من يعرّف الأخلاق؟

قد تضع الاجتماعات العالمية أطراً عامة، وقد ترسم الاستراتيجيات مسارات للتطوير، لكن القرار الطبي سيبقى (في جوهره) لحظة إنسانية لا يمكن اختزالها بالكامل في نموذج حسابي. فالذكاء الاصطناعي قادر على دعم القرار وتحسين دقته، لكنه لا يستطيع أن يحدد بمفرده ما هو القرار الصحيح في كل سياق سريري.

وفي الوقت الذي تدخل فيه الأخلاقيات إلى تصميم الخوارزميات، لا يعود التحدي تقنياً فقط، بل يصبح سؤالاً أعمق يتعلق بالمرجعية ذاتها: من يملك حق تعريف الأخلاق... عندما تتحول إلى جزء من الرموز الكومبيوترية؟