في لحظةٍ فارقة من التاريخ، يقف الإنسان أمام مرآة جديدة ليست من زجاجٍ ولا معدن، بل من خوارزمياتٍ باردة لا تعرف النوم. ينظر إلى انعكاسه فيها فيرى ملامح مهنته، هويته، ومستقبله... تتغيّر بسرعة تكاد تُربكه. ويسأل نفسه سؤالاً لم يعد مجرّد ترفٍ فلسفي: هل سأبقى أنا، الطبيب، أو المهندس، أو الصحافي، أو المعلّم، حاضراً في عالمٍ تُديره الآلة وتعيد صياغة قواعد اللعبة؟

لقد خرج الذكاء الاصطناعي من دائرة التكهّنات وأصبح جاراً يومياً يطرق أبوابنا بلا استئذان. فهو في هواتفنا يراقب ساعات النوم، وفي المستشفيات يقرأ صور الأشعة بدقة تفوق خبرة عقود، وفي المحاكم يراجع العقود أسرع من أي محامٍ، وفي المتاجر يُدير عمليات البيع بلا بائع.

ومع اقتراب عام 2030، تُعيد هذه الثورة ترتيب أوراق المهن: بعضها يُزهر ويُزاحم بقوة، وبعضها يتوارى بصمت، بينما تبقى مهن أخرى عصيّة على التغيير؛ لأنها مشبعة بإنسانية لا تُستنسخ بسهولة.

ماذا قال «أبو الذكاء الاصطناعي»؟

في زمنٍ تركض فيه الخوارزميات بسرعة تفوق خطوات البشر، خرج جيفري هينتون، الملقّب بـ«أب الذكاء الاصطناعي»، ليضع العالم أمام مرآة 2030. ففي مقابلة نُشرت في مجلة «فورتشن» بتاريخ 6 سبتمبر (أيلول) 2025، لم يقدّم هينتون نبوءة براقة، بل إنذاراً مدوياً: أرباحٌ هائلة ستتكدّس بين يدي قلة من الشركات العملاقة، بينما ملايين البشر يواجهون شبح البطالة الجماعية. ليست الآلة هي العدو – فهي لا تعرف الجشع ولا الاحتكار – بل النظام الاقتصادي الذي يحوّل هذه الثورة التقنية سيفاً على رقاب الناس.

بهذا التحذير، تنفتح صفحة جديدة من الصراع بين الإنسان والخوارزمية: من الصحافة التي كانت مرآة المجتمع، إلى الطب الذي أنقذ أرواحاً، وحتى المحاماة التي شكّلت حصن العدالة، جميعها تدخل مسرح اختبار عسير.

ولم يعد السؤال: هل تستطيع الآلة أن تنافس الإنسان؟ بل: هل يستطيع الإنسان أن يقدّم ما تعجز الخوارزمية عن نسخه؟ هنا تتحدد ملامح مصير المهن في العقد المقبل، بين من يثبت تفرده الإنساني، ومن يُكتَب اسمه في سجل المهن التي اندثرت تحت عجلة الذكاء الاصطناعي.

المهن التي ستودّعنا بهدوء

ليست كل المهن ترحل بصخب، فبعضها يغادر بهدوء، وكأنها كانت تعلم أن لحظة النهاية آتية لا محالة. ومع تسارع موجة الذكاء الاصطناعي، نجد أنفسنا نراقب مهناً مألوفة تختفي تدريجياً من المشهد:

* موظفو الاستقبال ومشغلو الهاتف: لم تعد تلك الابتسامة خلف المكتب أو الصوت الدافئ عبر السماعة ضرورة، بعدما حلت محلها أنظمة الرد الذكية وروبوتات المحادثة (Chatbots)، التي تُجيب عن أسئلتك في ثوانٍ، ليلاً ونهاراً، دون أن تُخطئ أو تتذمر.

* الصرافون والبائعون: المتاجر الذاتية الدفع، وأنظمة الشراء عبر الهاتف، جعلت «الكاشير» جزءاً من مشهد الماضي. يدخل الزبون، يختار، يدفع، ويغادر دون أن يتبادل كلمة مع أحد.

* سائقو التوصيل والشاحنات: بينما ننظر إلى الطريق، نجد سياراتٍ تسير بلا سائق، تختبرها اليوم كبرى الشركات في الولايات المتحدة والصين. ومع كل كيلومتر تقطعه هذه المركبات بأمان، تقترب مهنة السائق من أن تصبح ذكرى.

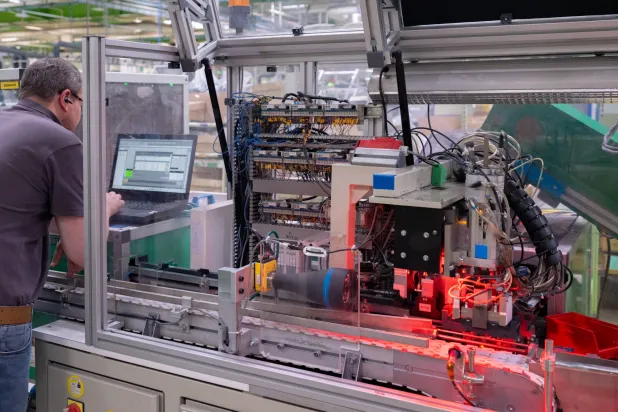

* عمال الإنتاج وخطوط التجميع: المصانع التي كانت تضج بأصوات البشر، باتت تضج اليوم بصمتٍ ميكانيكي منظم. روبوتات صناعية لا تعرف الكلل، تُنتج بدقة أعلى وسرعة أكبر، لتضع العامل البشري في موقف صعب.

* مُدخلو البيانات: وظيفة كانت يوماً العمود الفقري للمؤسسات، لكنها تذوب أمام خوارزميات تحوّل النصوص والصور إلى بيانات لحظياً. لم يعد إدخال البيانات عملاً بشرياً، بل عملية آلية لا تحتاج إلا إلى مراقبة.

* المسوّقون عبر الهاتف: من منا لا يتذكر المكالمات المزعجة التي تأتي في أوقات غير مناسبة؟ اليوم، لم تعد الشركات في حاجة إليها، بعدما صارت الإعلانات الموجهة والروبوتات الصوتية أكثر فاعلية وأقل كلفة.

مهن في مرحلة التحوّل

هناك مهن لن تُمحى بالكامل من الوجود، لكنها ستفقد جزءاً كبيراً من بريقها وحضورها. فالخوارزميات تقتطع شيئاً فشيئاً من مهامها، لتجعل الحاجة إلى أصحابها أقل عدداً مما اعتدنا. إنها مهن ستبقى، لكن بأعداد محدودة وأدوار مختلفة:

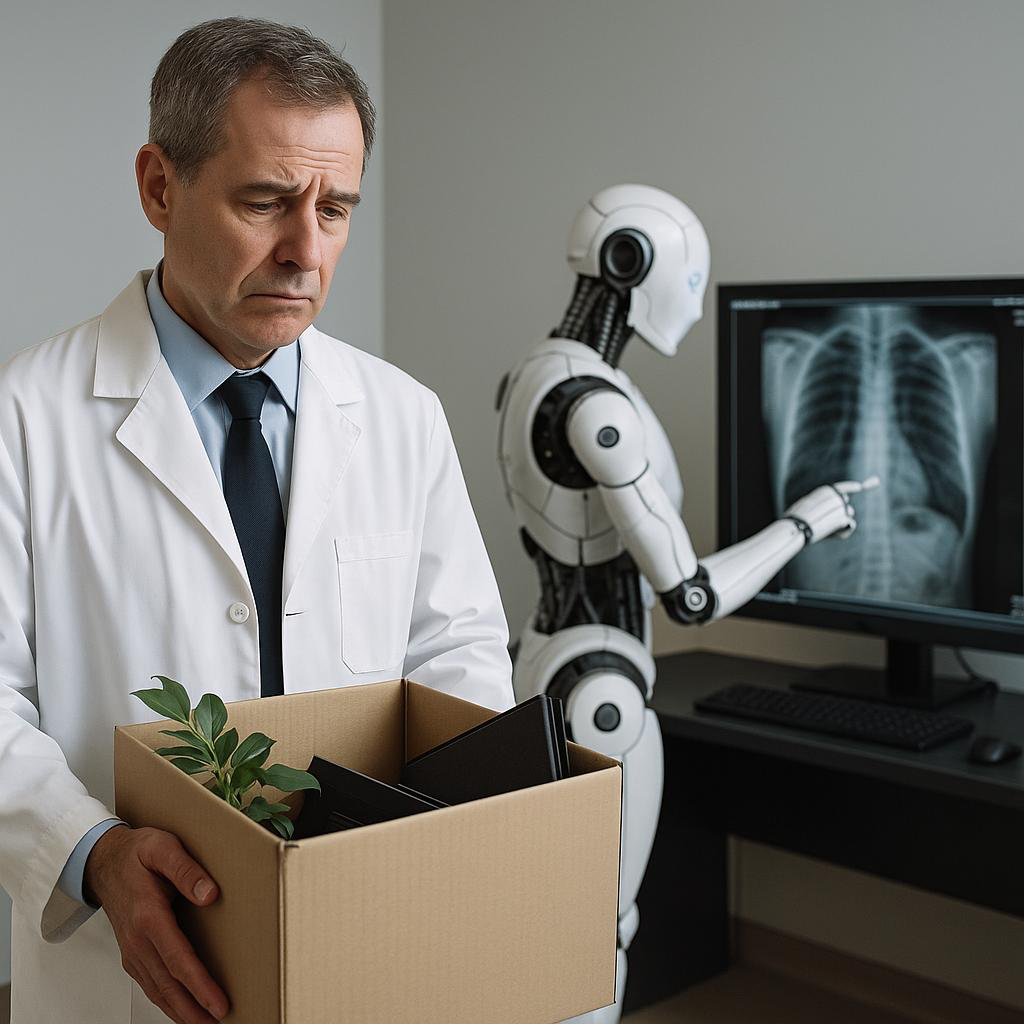

* أطباء الأشعة: في عام 2023 نشرت مجلة Lancet Digital Health دراسات تؤكد أن الذكاء الاصطناعي أصبح قادراً على قراءة صور الأشعة بدقة قد تفوق الطبيب. ومع ذلك، يبقى القرار النهائي والتكامل مع الحالة السريرية في يد الإنسان.

* أطباء الباثولوجي (علم الأمراض): الخوارزميات تستطيع تحليل الشرائح المجهرية في ثوانٍ معدودة، لكن ربط النتائج بالصورة الإكلينيكية للمريض لا يزال مهمة الطبيب، الذي يُفسّر ما وراء الأرقام والصور.

* المحاسبون والمراجعون الماليون: لم يعد التدقيق في الفواتير أو الحسابات عملاً بشرياً بالكامل؛ إذ تقوم البرامج الذكية بالمراجعة الروتينية بسرعة ودقة. لكن المحاسب الذي ينجو هو من يطوّر نفسه ليصبح مستشاراً استراتيجياً، لا مدققاً للأرقام فقط.

* المحررون الصحافيون: صحيح أن خوارزميات الذكاء الاصطناعي تستطيع توليد نصوص إخبارية آلية خلال ثوانٍ، لكنّها تظل عاجزة عن صياغة تحقيق صحافي استقصائي أو تقرير يلتقط نبض الشارع. والصحافي الذي يتقن استخدام أدوات الذكاء الاصطناعي سيصبح أكثر قوة، لا أقل.

* المحامون في القضايا الروتينية: العقود والنزاعات البسيطة يمكن أتمتتها، أما المعقدة فتظل بيد العقل القانون.

مهن لا يُلغيها الذكاء الاصطناعي... بل يعززها

في خضم هذا الطوفان الرقمي، تظل هناك جزر محمية، لا تصلها يد الأتمتة بسهولة. مهنٌ تقف صامدة لأن جوهرها يرتبط بالوجدان والإنسانية، لا بالحسابات الباردة:

* الأطباء والممرضون في الرعاية المباشرة: صحيح أن الذكاء الاصطناعي يقرأ الأشعة ويقترح بروتوكولات العلاج، لكن لا خوارزمية تستطيع أن تضع يدها على كتف مريضٍ خائف لتطمئنه، اذ إن اللمسة الإنسانية ليست وظيفة، بل رسالة.

* الفنانون والمصممون: قد يرسم الذكاء الاصطناعي لوحة تبهر العيون، لكنه يعجز عن أن يسكب في الألوان دمعة عاشق أو وجع وطن. فالإبداع الحقيقي يظل مُرتبطاً بالوجدان البشري، لا بالشيفرات.

* المعلمون والمربون: تستطيع الآلة أن تُلقي درساً، وتعيد شرح المعادلات بلا ملل، لكنها لا تستطيع أن تُلهم طفلاً أو تُغرس في قلبه قيمة. فالتعليم ليس معلومات فقط، بل قدوة وحضور إنساني.

* علماء الأخلاق والسياسة: الخوارزميات ذكية، لكنها بلا بوصلة. تحتاج إلى من يضع لها المعايير ويُرشدها نحو ما هو عادل وما هو إنساني. ولهذا يبقى صوت الفلاسفة والمفكرين والسياسيين حاجةً لا بديل لها.

الدبلوماسيون والعاملون في العلاقات الإنسانية: التفاوض ليس أرقاماً، بل قراءة لملامح الوجه، وفهم للثقافات، وإحساس بلحظة الصمت التي قد تُغيّر مجرى التاريخ. هذه مهارة لا تُستنسخ في مختبر برمجي

* الصحافيون المتخصصون والمشرفون على الصفحات العلمية والثقافية: قد يكتب الذكاء الاصطناعي خبراً عاجلاً في ثوانٍ، لكنه يعجز عن تبسيط دراسة علمية معقدة أو ربطها بالسياق الثقافي والاجتماعي الذي يفهمه القارئ. فهذه مهمة تحتاج إلى خبرة إنسانية تراكمية، وإلى عين صحافي يعرف كيف يحوّل الأرقام الجامدة قصة نابضة بالحياة.

كيف نتهيأ لهذا المستقبل؟

التحوّل القادم ليس تهديداً داهماً، بل فرصة تاريخية لإعادة تعريف أدوارنا. فالحكومات مدعوة اليوم إلى إعادة النظر في مناهجها التعليمية، لتغرس في الأجيال القادمة مهارات المستقبل: التفكير التحليلي، البرمجة، الذكاء العاطفي، وأخلاقيات التقنية. أما الأفراد، فالمطلوب منهم عقلية جديدة، عقلية التعلّم المستمر، والاستعداد لتغيير المسار المهني أكثر من مرة خلال حياتهم العملية.

ولعلّنا هنا نستعيد مقولة سقراط الشهيرة: «أنا لا أعلم شيئاً، ولكني أعلم أنني لا أعلم».

إن الاعتراف بحدود معرفتنا ليس ضعفاً، بل هو أول خطوة في رحلة التعلّم. والوعي بالجهل هو السلاح الأقوى لمواجهة عالمٍ سريع التحوّل، حيث لا مكان فيه لمن يتوقف عن النمو.

العالم العربي: بين الفرصة والتحدي

في منطقتنا، لا يقف الذكاء الاصطناعي عند حدود الخوف من فقدان الوظائف، بل يفتح باباً واسعاً لفرص تاريخية. فمع «رؤية السعودية 2030»، والمبادرات الطموحة في الإمارات، الأردن، المغرب، قطر ومصر، يتضح أن العالم العربي قادر على أن يكون فاعلاً لا متلقياً.

إن استثمرنا بجدية في التعليم الحديث، والبحث العلمي المتقدم، ودعم ريادة الأعمال التقنية، يمكن للذكاء الاصطناعي أن يتحول من تهديد صامت إلى رافعة قوية للتنمية، تصنع فرص عمل جديدة وتعيد تشكيل اقتصاداتنا بما يتماشى مع طموحات شبابنا.

مهن لم تكن موجودة من قبل

الذكاء الاصطناعي لا يقتصر على إلغاء وظائف، بل يخلق أخرى لم نكن نتصورها قبل سنوات قليلة: مدربو الخوارزميات، مصممو التوائم الرقمية، خبراء أخلاقيات التقنية، ومهندسو البيانات الصحية. هذه المهن وليدة عصر جديد.

الشجاعة والتكيّف

الذكاء الاصطناعي لن يسرق وظائفنا، بل سيعيد تعريفها. من يملك الشجاعة للتكيف سيجد نفسه في قلب المستقبل، ومن يصرّ على الجمود سيجد نفسه على الهامش. فالمستقبل لا ينتظر أحداً، لكنه يفتح ذراعيه فقط لمن يتقن فن التعلّم، ويعرف كيف يطرح السؤال قبل أن يبحث عن الجواب.