فجأة، ظهرت في السوق أدوات ذكاء اصطناعي جديدة للمستهلكين يمكنها أخذ أي جزء من النص أو الصوت أو الفيديو وتوفير ملخصات مبسطة.

في هذه الأيام، كما كتب جيفري آر. يونغ (*) يمكن للطلاب استخدام أدوات مثل «نوتبوك إل إم» NotebookLM من «غوغل» لتحويل ملاحظات محاضراتهم «بودكاست»، حيث تتبادل روبوتات الذكاء الاصطناعي الرائقة المزاح والتعليق على النقاط الرئيسية. وأغلب الأدوات مجانية، وتقوم بعملها في ثوانٍ بنقرة زر.

أدوات ذكية شائعة

من الطبيعي أن كل هذا يسبب القلق بين بعض المدرسين، الذين يرون الطلاب يوجهون العمل الشاق المتمثل في تجميع المعلومات، إلى أداة الذكاء الاصطناعي بسرعة لم تكن ممكنة من قبل.

لكن الصورة العامة أكثر تعقيداً، خصوصاً وأن هذه الأدوات أصبحت أكثر شيوعاً وبدأ استخدامها يصبح معياراً في مجال الأعمال وغيرها من السياقات خارج الفصل الدراسي.

تعمل الأدوات بمثابة شريان حياة خاص للطلاب الذين يمتازون باختلافات في نشاطهم الذهني، الذين أصبح لديهم فجأة إمكانية الوصول إلى الخدمات التي يمكن أن تساعدهم على التنظيم ودعم فهمهم للقراءة، كما يقول خبراء التدريس.

لا توجد إجابة شاملة

تقول أليكسيس بيرس كوديل، المحاضرة في علوم المعلومات بجامعة إنديانا في بلومنغتون، التي قامت أخيراً بمهمة شارك فيها الكثير من الطلاب بخبراتهم ومخاوفهم بشأن أدوات الذكاء الاصطناعي: «لا توجد إجابة شاملة... إذ سيستخدمها الطلاب في علم الأحياء بطريقة ما، وسيستخدمها طلاب الكيمياء بطريقة أخرى. ويستخدمها طلابي جميعاً بطرق مختلفة».

وتؤكد المدرسة أن الأمر ليس بهذه البساطة، ولا يجب أن نفترض أن الطلاب جميعاً غشاشون. وتضيف: «كان بعض الطلاب قلقين بشأن الضغوط التي يتعرضون لها للانخراط في استخدام الأدوات - فإذا كان جميع أقرانهم يفعلون ذلك، فعليهم أن يفعلوا ذلك حتى لو شعروا أنه يعيق تعلمهم الحقيقي». وهم يسألون أنفسهم أسئلة مثل، «هل يساعدني هذا في اجتياز هذه المهمة المحددة أو هذا الاختبار المحدد - لكن هل سيكون هذا على حساب التعلم؟».

وكل هذا يضيف تحديات جديدة إلى المدارس والكليات في محاولتها وضع حدود وسياسات لاستخدام الذكاء الاصطناعي في الفصول الدراسية.

مخاوف من قلة الاستيعاب

يبدو أن شركات التكنولوجيا تعلن كل أسبوع تقريباً - أو حتى كل يوم - عن ميزات جديدة يتبناها الطلاب في دراساتهم.

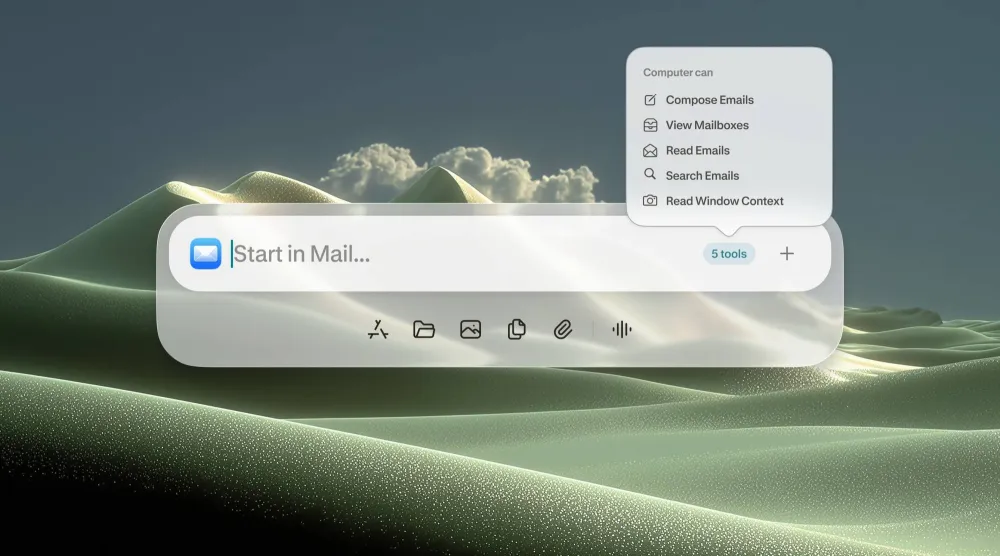

على سبيل المثال، في الأسبوع الماضي فقط، أصدرت شركة «أبل» ميزات «أبل إنتليجنس» لأجهزة «آيفون»، ويمكن لإحدى الميزات إعادة صياغة أي جزء من النص بنغمات مختلفة، مثل غير الرسمية أو المهنية. وفي الشهر الماضي، أصدرت شركة «أوبن إيه آي»، وهي الشركة المصنعة لـ«تشات جي بي تي» ميزة تسمى «كانفاس» Canvas تتضمن أشرطة تمرير للمستخدمين لتغيير مستوى قراءة النص على الفور.

يقول مارك واتكينز، وهو محاضر في الكتابة والبلاغة في جامعة ميسيسيبي، إنه قلق من أن الطلاب ينجذبون إلى وعود توفير الوقت التي تقدمها هذه الأدوات، وقد لا يدركون أن استخدامها قد يعني التخلي العمل الفعلي اللازم لاستيعاب المادة وتذكرها.

ويضيف: «من وجهة نظر التدريس والتعلم، هذا أمر مقلق للغاية بالنسبة لي؛ لأننا نريد لطلابنا أن يكافحوا قليلاً، وأن يكون لديهم القليل من الاحتكاك، لأن هذا مهم لتعلمهم».

ويقول إن الميزات الجديدة تجعل من الصعب على المعلمين تشجيع الطلاب على استخدام الذكاء الاصطناعي بطرق مفيدة - مثل تعليمهم كيفية صياغة المطالبات لتغيير مستوى كتابة شيء ما.

ذلك أن هذه الأدوات «تزيل ذلك المستوى الأخير من الصعوبة المطلوب التغلب عليها في عملهم - وذلك عندما يمكنهم فقط الضغط على الأزرار والحصول (من الأداة) على مسودة نهائية، والحصول على تعليقات على المسودة النهائية أيضاً».

سياسات جديدة للتعليم بالذكاء الاصطناعي... تقادمت

وحتى الأساتذة والكليات التي تبنت سياسات الذكاء الاصطناعي قد تحتاج إلى إعادة النظر فيها في ضوء هذه الأنواع الجديدة من القدرات. كما قال أستاذان في مقال رأي نُشر مؤخراً بعنوان «سياسة الذكاء الاصطناعي الخاصة بك أصبحت قديمة بالفعل».

ويتساءل مؤلفا المقال، زاك جوستوس، مدير تطوير أعضاء هيئة التدريس في جامعة ولاية كاليفورنيافي تشيكو، ونيك جانوس، أستاذ علم الاجتماع هناك، عن مثل هذه الحالة: «طالب يقرأ مقالاً حمّله س، لكن الطالب لا يستطيع تذكر نقطة رئيسية في المقال؛ لذا يستخدم مساعد الذكاء الاصطناعي لتلخيص أو تذكيره بالمكان الذي قرأ فيه شيئاً ما.

هل استخدم هذا الشخص الذكاء الاصطناعي عندما كان هناك حظر على الاستخدام في الفصل الدراسي؟».

ويشيران إلى أن الأدوات الشائعة مثل «أدوبي أكروبات» Adobe Acrobat تحتوي الآن على ميزات «مساعد الذكاء الاصطناعي» التي يمكنها تلخيص المستندات بضغطة زر.

وبدلاً من صياغة وإعادة صياغة سياسات الذكاء الاصطناعي، يزعم الأستاذان أن المعلمين يجب أن يعملوا على وضع أطر عامة لما هو مقبول من المساعدة من برامج المحادثة الآلية.

لكن مارك واتكينز يدعو صناع أدوات الذكاء الاصطناعي إلى بذل المزيد من الجهود للتخفيف من سوء استخدام أنظمتهم في البيئات الأكاديمية، أو كما قال : «للتأكد من أن هذه الأداة التي يستخدمها الطلاب بشكل بارز، فعالة بالفعل في تعليمهم وليس فقط بصفتها أداةً لتخفيف العبء».

تجارب ميدانية: دقة غير متساوية

تثير أدوات الذكاء الاصطناعي الجديدة هذه مجموعة من التحديات الجديدة تتجاوز تلك التي كانت موجودة سابقاً.

أحد التحديات هو أن أدوات تلخيص الذكاء الاصطناعي لا تقدم دائماً معلومات دقيقة؛ بسبب ظاهرة نماذج اللغة الكبيرة المعروفة باسم «الهلوسة»، عندما تخمن برامج المحادثة الآلية الحقائق، ولكنها تقدمها للمستخدمين بصفتها أشياء مؤكدة.

التسطيح والعمق لدى الذكاء الاصطناعي

على سبيل المثال، عندما جرَّبت بوني ستاشوياك لأول مرة ميزة البث الصوتي على برنامج «نوتبوك إل إم» من «غوغل»، قالت إنها انبهرت بمدى واقعية أصوات الروبوتات ومدى قدرتها على تلخيص المستندات التي تغذيها بها. وستاشوياك هي مضيفة برنامج البث الصوتي الطويل الأمد، Teaching in Higher Ed، وعميدة التدريس والتعلم في جامعة فانغارد بجنوب كاليفورنيا، وهي تجرّب بانتظام أدوات الذكاء الاصطناعي الجديدة في تدريسها.

لكن مع تجربتها للأداة أكثر، وإضافة مستندات حول مواضيع معقدة تعرفها جيداً، لاحظت أخطاء أو سوء فهم عرضياً. وتقول: «إنها تسطح المواضيع فقط - إنها تفتقد معرفة كل هذه الفروق الدقيقة... ويبدو الأمر حميمياً للغاية؛ لأنه صوت والصوت هو وسيلة حميمة للغاية. ولكن بمجرد أن يكون شيئاً تعرف عنه الكثير، فإن الأداة سوف تفشل».

ومع ذلك، تقول إنها وجدت ميزة البث الصوتي في البرنامج مفيدة في مساعدتها على فهم القضايا البيروقراطية والتواصل بشأنها في جامعتها - مثل تحويل جزء من دليل أعضاء هيئة التدريس إلى ملخص للبث الصوتي. وعندما راجعت الأمر مع زملائها الذين يعرفون السياسات جيداً، قالت إنهم شعروا أنه قام «بعمل جيد تماماً». وتقول: «إنه جيد جداً في جعل البيروقراطية ثنائية الأبعاد (غير العميقة) أكثر سهولة في التعامل معها».

إشكالات أخلاقية

وتقول بيرس كوديل، من جامعة إنديانا، إن طلابها أثاروا أيضاً قضايا أخلاقية تتعلق باستخدام أدوات الذكاء الاصطناعي. وتضيف: «يقول البعض إنهم قلقون حقاً بشأن التكاليف البيئية للذكاء الاصطناعي التوليدي واستخدامه»، مشيرة إلى أن «تشات جي بي تي» ونماذج الذكاء الاصطناعي الأخرى تتطلب كميات كبيرة من قوة الحوسبة والكهرباء.

وتضيف أن آخرين قلقون بشأن مقدار البيانات التي ينتهي بها الأمر بالمستخدمين إلى تقديمها لشركات الذكاء الاصطناعي، خصوصاً عندما يستخدم الطلاب إصدارات مجانية من الأدوات.

وتتابع: «نحن لا نجري هذا النوع من المناقشات. نحن لا نجري مناقشات حول ما تعنيه مقاومة استخدام الذكاء الاصطناعي التوليدي بنشاط؟».

ومع ذلك، ترى الدراسة تأثيرات إيجابية على الطلاب، مثل عندما يستخدمون أداة للمساعدة في صنع بطاقات تعليمية للدراسة.

أدوات ممتازة للمصابين بالاضطرابات

وقالت إنها سمعت عن طالب مصاب باضطراب نقص الانتباه وفرط الحركة الذي كان يجد دائماً قراءة نص كبير أمراً «مربكاً»، لكنه كان يستخدم «تشات جي بي تي» «للتغلب على عقبة الانخراط الأولي في القراءة، ثم كان يتحقق من فهمه باستخدام (تشات جي بي تي)».

وتقول إنها سمعت عن أدوات الذكاء الاصطناعي الأخرى التي يستخدمها الطلاب ذوو الإعاقات الذهنية، مثل الأداة التي تساعد المستخدمين على تقسيم المهام الكبيرة إلى مهام فرعية أصغر وأكثر قابلية للإدارة. وتؤكد: «هذا ليس غشاً. إنه تقسيم الأشياء وتقدير المدة التي سيستغرقها شيء ما. هذا ليس شيئاً يأتي بشكل طبيعي لكثير من الناس».

* مجلة «فاست كومباني» - خدمات «تريبيون ميديا»