إذا تم اختراق أنظمة الفضاء مثل نظام تحديد المواقع العالمي (GPS) وإيقافها عن العمل، فسوف يعود جزء كبير من العالم على الفور إلى تقنيات الاتصالات والملاحة في الخمسينات.

الأمن السيبراني الفضائي

ومع ذلك، فإن الأمن السيبراني في الفضاء غير مرئي إلى حد كبير للجمهور في وقت من التوترات الجيوسياسية المتزايدة. لقد حدثت هجمات إلكترونية على الأقمار الاصطناعية منذ الثمانينات، لكن الإنذار الذي أيقظ العالم انطلق قبل عامين فقط. إذ وقبل ساعة من غزو روسيا لأوكرانيا في 24 فبراير (شباط) 2022، اخترق عملاء حكومتها خدمات الإنترنت عبر الأقمار الاصطناعية لشركة «فياسات» Viasat لقطع الاتصالات وخلق حالة من الارتباك في أوكرانيا.

أنا أدرس الأخلاقيات والتقنيات الناشئة وأعمل مستشاراً للمجلس الوطني للفضاء في الولايات المتحدة. في السابع عشر من يونيو (حزيران) 2024، أصدرت مع زملائي في مجموعة الأخلاقيات والعلوم الناشئة في جامعة ولاية كاليفورنيا بوليتكنيك تقريراً ممولاً من مؤسسة العلوم الوطنية الأميركية، لشرح مشكلة الهجمات الإلكترونية في الفضاء والمساعدة في توقع سيناريوهات جديدة ومفاجئة.

الفضاء والبشر

معظم الناس لا يدركون الدور الحاسم الذي تلعبه أنظمة الفضاء في حياتهم اليومية، ناهيك عن الصراعات العسكرية. على سبيل المثال، يستخدم نظام تحديد المواقع العالمي إشارات من الأقمار الاصطناعية. ويعد التوقيت الدقيق الذي يدعمه نظام تحديد المواقع العالمي ضرورياً في الخدمات المالية، حيث يجب التقاط كل التفاصيل - مثل وقت الدفع أو السحب - وتنسيقها بدقة. حتى إجراء مكالمة هاتفية يعتمد على التنسيق الدقيق للوقت في الشبكة.

إلى جانب ذلك، هناك الملاحة للطائرات والقوارب والسيارات والأشخاص، يعد نظام تحديد المواقع العالمي مهماً أيضاً لتنسيق أساطيل الشاحنات التي تنقل البضائع إلى المتاجر المحلية كل يوم.

إن الأقمار الاصطناعية المخصصة لمراقبة الأرض هي بمثابة «عيون في السماء» تتمتع بنقطة مراقبة فريدة تساعد في التنبؤ بالطقس، ومراقبة التغيرات البيئية، وتتبع الكوارث الطبيعية والاستجابة لها، وتعزيز غلة المحاصيل الزراعية، وإدارة استخدام الأراضي والمياه، ومراقبة تحركات القوات، وأكثر من ذلك بكثير.

إن فقدان هذه الخدمات الفضائية وغيرها قد يكون قاتلاً للأشخاص المعرّضين للكوارث الطبيعية، وتضرر المحاصيل الزراعية. كما يمكن أن يعرّض الاقتصاد العالمي والأمن لخطر جسيم.

عوامل مؤثرة

حددنا العديد من العوامل التي تساهم في التهديد المتزايد للهجمات السيبرانية الفضائية. على سبيل المثال، من المهم أن ندرك أن العالم في بداية سباق فضائي جديد. وبكل المقاييس، أصبح الفضاء أكثر ازدحاماً وأكثر تنافساً. تستعد كل من الدول القومية والشركات الخاصة، التي لا تخضع للتنظيم الكافي والتي تمتلك الآن معظم الأقمار الاصطناعية في المدار، للتنافس على الموارد ومواقع البحث.

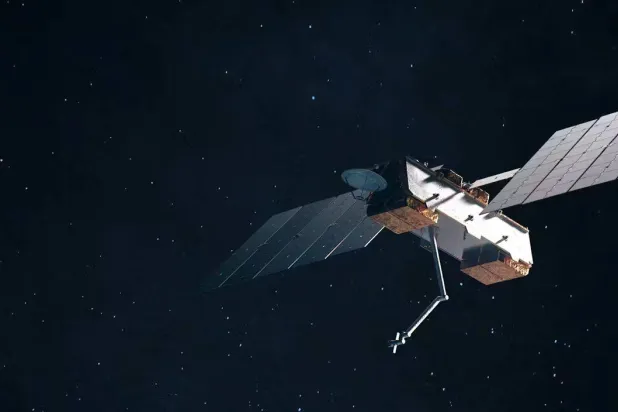

نظراً لأن الفضاء بعيد جداً ويصعب الوصول إليه، فإذا أراد شخص ما مهاجمة نظام فضائي، فمن المرجح أن يحتاج إلى القيام بذلك من خلال هجوم سيبراني.

إن الأنظمة الفضائية تشكل أهدافاً جذابة بشكل خاص؛ لأن أجهزتها لا يمكن ترقيتها بسهولة بمجرد إطلاقها، ويتفاقم هنا انعدام الأمن بمرور الوقت. وباعتبارها أنظمة معقدة؛ فقد يكون لها سلاسل توريد طويلة، كما أن زيادة الروابط في السلسلة تزيد من فرصة التعرض للثغرات الأمنية.

كما تواجه المشروعات الفضائية الكبرى تحدياً يتمثل في مواكبة أفضل الممارسات على مدى العقد أو أكثر اللازم لبنائها.

الأرض في شرنقة من الحطام الفضائي

والمخاطر عالية بشكل غير عادي في الفضاء. فالنفايات المدارية تطير بسرعة تتراوح بين 6 و9 أميال في الثانية، ويمكنها بسهولة تدمير مركبة فضائية عند الاصطدام. ويمكنها أيضاً إنهاء برامج الفضاء في جميع أنحاء العالم بالنظر إلى «»متلازمة كيسلر» المفترضة التي يتم وفقها سجن الأرض في النهاية في شرنقة من الحطام. وترجّح هذه العواقب لصالح الهجمات السيبرانية الفضائية على الهجمات المادية لأن مشكلة الحطام من المرجح أيضاً أن تؤثر على المهاجم.

وعلاوة على ذلك، ونظراً للبنية التحتية والخدمات الفضائية الحرجة، مثل نظام تحديد المواقع العالمي؛ فإن الصراعات في الفضاء يمكن أن تشعل أو تضيف المزيد من الوقود إلى صراع على الأرض، حتى تلك التي تحدث في الفضاء الإلكتروني.

على سبيل المثال، حذّرت روسيا في عام 2022 من أن اختراق أحد أقمارها الاصطناعية سيُعدّ بمثابة إعلان حرب، وهو ما كان تصعيداً دراماتيكياً عن المعايير السابقة حول الحرب.

سيناريوهات أمن الفضاء الإلكتروني

إن خبراء الأمن الذين يدركون خطورة هذا التهديد الذي يشكّله أمن الفضاء الإلكتروني يواجهون تحدياً كبيراً. ففي المنتديات غير السرية على الأقل، لا يتم النظر إلا في سيناريوهين غير محددين بشكل كافٍ: شيء غامض حول اختراق الأقمار الاصطناعية وشيء غامض حول تشويش الإشارات أو التلاعب بها.

ولكن الفشل في تصور مجموعة كاملة من الاحتمالات يمكن أن يكون مدمراً للتخطيط الأمني، وخاصة ضد المتسللين الذين يشكّلون مجموعة متنوعة من الكيانات ذات الدوافع والأهداف المتنوعة.

وهذه المتغيرات حيوية لتحديدها لأنها تكشف عن أدلة حول الاستراتيجيات التي قد يجدها المدافعون الأكثر فاعلية في الاستجابة. وعلى سبيل المثال، قد يتطلب الهجوم الذي يشنّه متسلل برعاية الدولة نهجاً مختلفاً عن الهجوم الذي يشنّه متسلل إجرامي سعياً وراء المال أو من قِبل عميل فوضوي. وللمساعدة في حل هذه القطعة من لغز الأمن؛ يقدم تقريرنا تصنيفاً،- وهو: مصفوفة إيكاروس ICARUS التي تلتقط - هذه المتغيرات ويمكنها إنشاء أكثر من أربعة ملايين تركيبة فريدة من المتغيرات، والتي نسميها مطالبات السيناريو.

إن مصطلح ICARUS هو اختصار لـتعبير «تخيل الهجمات الإلكترونية لتوقع المخاطر الفريدة في الفضاء».

سيناريوهات تسلل رئيسية

فيما يلي 3 من السيناريوهات الـ42 التي أدرجناها في التقرير.

الطابعة ثلاثية الأبعاد يمكن أن تكون أو الطابعة الإضافية مورداً لا يقدر بثمن لإنشاء أجزاء بسرعة عند الطلب في المهام الفضائية.

يمكن للمتسلل الوصول إلى طابعة في محطة فضائية وإعادة برمجتها لعمل عيوب صغيرة داخل الأجزاء التي تطبعها. يمكن أن تكون بعض هذه المكونات المصممة، معدة لإفشال عمل أجزاء من أنظمة بالغة الأهمية.

إفساد بيانات مسبارات فضائية. يمكن للمتسلل إفساد البيانات من مسبار كوكبي لإظهار قراءات غير دقيقة للغلاف الجوي أو درجة الحرارة أو الماء. على سبيل المثال، يمكن للبيانات الفاسدة من مركبة المريخ أن تظهر بشكل خاطئ أن المنطقة بها جليد مائي كبير تحت السطح. سيتم إهدار أي مهمة لاحقة يتم إطلاقها لاستكشاف الموقع بشكل أكبر.

تسريب تسجيلات فضائية. في عام 1938، أثارت دراما إذاعية حول هجوم فضائي حالة من الذعر عندما لم يدرك العديد من المستمعين أنها كانت خيالية. وعلى نحو مماثل، قد يتمكن أحد القراصنة من الوصول إلى مصادر الاستماع لمشروع Messaging Extraterrestrial Intelligence (METI) وإدراج شيء يشبه لغة الكائنات الفضائية في نص المشروع. ومن الممكن أن يسرّبها بعد ذلك إلى وسائل الإعلام؛ ما قد يؤدي إلى إثارة الذعر في جميع أنحاء العالم وتحريك الأسواق المالية.

سيناريوهات متعددة. وتتضمن السيناريوهات الأخرى في تقريرنا أشياء مثل التهديدات الداخلية، وثغرات الذكاء الاصطناعي، والهجمات التي تتم تحت راية كاذبة، والإرهاب البيئي، وبرامج الفدية أثناء الإطلاق، فضلاً عن سيناريوهات أكثر بعداً حول تعدين الكويكبات، والمستعمرات خارج العالم، وقراصنة الفضاء.

كما أن صياغة سيناريوهات جديدة ومفاجئة يمكن أن تساعد في إحياء التهديد غير المرئي للهجمات الإلكترونية الفضائية، فضلاً عن تسليط الضوء على الفروق الدقيقة عبر سيناريوهات مختلفة قد تتطلب من خبراء متعددي التخصصات معالجتها معاً.

* أستاذ الفلسفة في جامعة ولاية كاليفورنيا بوليتكنيك. مجلة «فاست كومباني» - خدمات «تريبيون ميديا»

النظم الفضائية مهدَّدة بالاختراق والتسلل