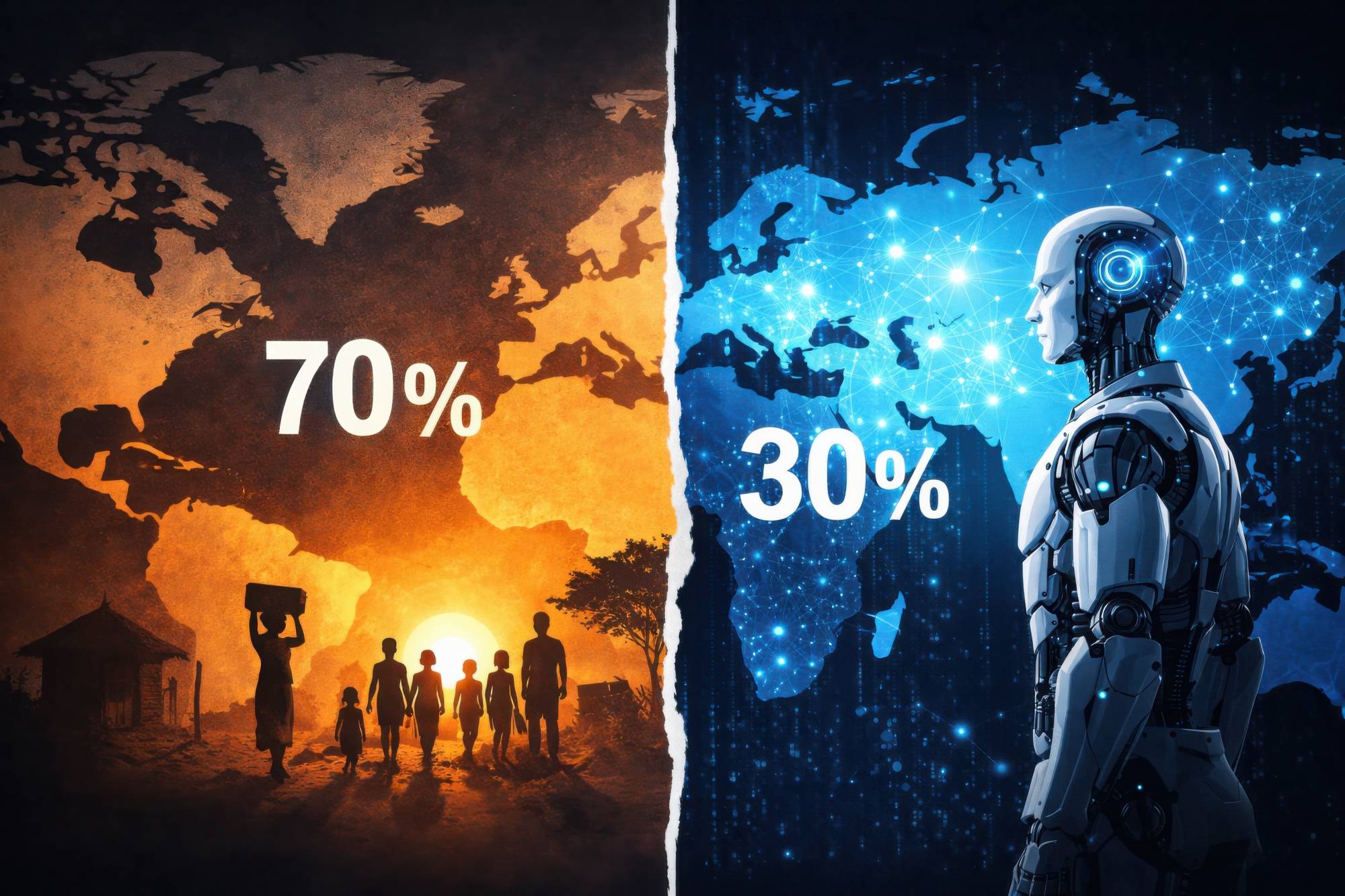

لقد حان الوقت لنكون واقعيين بشأن ما يمكن للذكاء الاصطناعي فعله وما لا يمكنه فعله، كما كتبت شيرا أوفيدي، المحللة التكنولوجية في واشنطن.

روعة التكنولوجيا

إنه شعور مبهج عندما تساعدك التكنولوجيا على القيام بشيء مفيد أو رائع. من الرائع توجيه كاميرا هاتفك نحو شجرة غير مألوفة، ورؤية أن لها براعم حمراء. وربما تتذكر المرة الأولى التي قمت فيها باستخدام خرائط «غوغل» لمعرفة الاتجاهات، أو عند استدعائك سيارة أوبر... وبدا الأمر كأنه سحر.

التكنولوجيا الأكثر سخونة الآن، وهي نوع من الذكاء الاصطناعي الذي يولِّد نصوصاً أو صوراً تُشبه البشر، يمكن أن تمنحك في بعض الأحيان هزة فورية، ولكن في كثير من الأحيان لا يحدث ذلك.

تجارب مُخيّبة للذكاء الاصطناعي

ولعلك مررت بتجربة الذكاء الاصطناعي، وربما تولّد لديك أيضاً شعور بالإحباط عندما طلبت المساعدة من «تشات جي بي تي» في التخطيط للعطلة، أو في توليد وصفة لنوع من المعجنات.

إلا أن خيبات الأمل مثل تلك لا تعني أن الذكاء الاصطناعي عديم الفائدة. ولكن غالباً ما يكون هناك عدم تطابق بين واقع الذكاء الاصطناعي وكيف تشجعك الشركات على التفكير في الذكاء الاصطناعي الخاص بها، بصفته أدمغة سحرية تعرف وتفعل كل شيء.

أخطاء الذكاء الاصطناعي

الحقيقة أن الذكاء الاصطناعي سيئ بشكل أساسي في كثير من المهام، إذ يتطلب الأمر منك أن تتعلّم الكلمات الصحيحة فقط لتحصل منه على أفضل النتائج. ومثل جميع أجهزة الكومبيوتر، سوف يرتكب الذكاء الاصطناعي أخطاء مختلفة عن تلك التي يرتكبها البشر، لكنه سوف يرتكب الأخطاء.

تراجع الشركات عن تطويراتها

ومن المفيد أن نرى نمط تراجع الشركات عندما لا يعمل الذكاء الاصطناعي بالقدر الذي وعدت به. إنها تعلم أن الذكاء الاصطناعي ليس سحراً، ويجب عليك أن تعلم ذلك أيضاً.

وهنا بعض الأمثلة:

* «أليكسا» من «أمازون». قبل 9 أشهر، قالت «أمازون» إنها قامت بإصلاح مساعدها الصوتي «أليكسا» باستخدام الذكاء الاصطناعي الجديد. لكن «Alexa» أخطأ بشكل متكرر في طرح الأسئلة في العروض التوضيحية، ولا يزال غير متوافر على أجهزة «أليكسا» المنزلية.

يشعر بعض الخبراء في «أمازون» بالقلق من أن «أليكسا» الجديد لن يكون جاهزاً للإطلاق المخطط له في سبتمبر (أيلول)، لأن المساعد الصوتي لا يزال يقدم استجابات غير متوقعة. وقالت «أمازون» إنها اختبرت «أليكسا» الجديد مع مجموعات صغيرة من العملاء، وتعمل جاهدة لتوسيع نطاقه ليشمل مزيداً من الأشخاص.

* «سيري» من «أبل». قالت شركة «أبل» هذا الشهر إن نظام «سيري» المُعزز بالذكاء الاصطناعي سيبدأ الظهور على بعض موديلات «آيفون» الأحدث هذا العام، وسنرى كيف ستسير الأمور.

تراجعات «مايكروسوفت» و«غوغل»

* «مايكروسوفت». أبرمت صفقة كبيرة الشهر الماضي بشأن خط جديد من أجهزة الكومبيوتر الشخصية التي تعمل بتقنية الذكاء الاصطناعي، بما في ذلك ميزة الزمن «time machine feature» لكل ما يقوم به المستخدم على جهاز الكومبيوتر الخاص به. ثم قامت الشركة بإيقاف تشغيل الميزة افتراضياً بعد أن قال بعض الباحثين إنها تمثل كابوساً أمنياً.

كما قامت «مايكروسوفت» أيضاً بتقليص زر لوحة المفاتيح الذكي «AI keyboard button»، الذي جرى الترويج له كثيراً. وتوقفت عن دمج برنامج الدردشة الآلي الخاص بها في أجهزة الكومبيوتر التي تعمل بنظام «ويندوز» للقيام بالأعمال المنزلية، مثل تغيير سطوع الشاشة.

وقالت «مايكروسوفت» إنها استجابت للتعليقات التي تفيد بأن الأشخاص لا يحبون الخلط بين برنامج الدردشة الآلي ومهام أخرى مثل الإعدادات.

* «غوغل». قامت في الشهر الماضي بتقليص الإجابات التي جرى إنشاؤها بواسطة الذكاء الاصطناعي في أعلى نتائج بحث الويب، بعد أن كانت بعض استجابات الذكاء الاصطناعي غير منطقية أو خطيرة. وكانت هذه هي المرة الثالثة على الأقل التي تعترف فيها «غوغل» بأن الذكاء الاصطناعي الخاص بها لا يعمل بشكل جيد، بما في ذلك ميزة الذكاء الاصطناعي المعلقة الآن، التي تولد صوراً تتحدى التاريخ، مثل صورة امرأة لبابا الفاتيكان.

المكاشفة والصراحة حول صدق المعلومات

إن نمط تراجعات الذكاء الاصطناعي وخيبات الأمل يستدعي إعادة النظر في كيفية عرض الشركات تقنياتها عليك، وفي توقعاتك.

* أولاً، يجب على الشركات أن تكون صريحة بأن الذكاء الاصطناعي يمكن أن يكون مفيداً لبعض الأشياء، ولكن ليس لكل شيء، خاصة فيما يتعلق بالمعلومات الواقعية.

على سبيل المثال، ينبغي عدم استخدام الذكاء الاصطناعي للبحث عن ارتفاع برج «إيفل»، أو من فاز في الانتخابات الرئاسية الأمريكية لعام 2020.

* ثانياً، عندما تعرض الشركات الذكاء الاصطناعي الخاص بها علناً، يجب عليها أن تخبرك بمعدلات الخطأ، أو تدعم التأكيدات التي تبدو مذهلة.

شكك باحثون مستقلون حديثاً في ادعاء شركة «أوبن إيه آي» بأن «ChatGPT» الخاص بها يمكنه اجتياز اختبار المحاماة القانوني بدرجة أعلى من جميع المتقدمين للاختبار تقريباً. كما تحدوا فكرة أن روبوتات الدردشة يمكنها كتابة تعليمات برمجية مثل الخبراء من البشر.

* وأخيراً، من المهم أن تدرك أن خيالك قد يفوق قدرات الذكاء الاصطناعي. إننا نعرف من خلال تجربتنا الحياتية أن التكنولوجيا يمكن أن تكون مذهلة، لكنها نادراً ما تكون حلاً سحرياً. والذكاء الاصطناعي ليس كذلك أيضاً.