تجددت المخاوف بشأن تأثير الذكاء الاصطناعي على «خصوصية» بيانات المستخدمين، مع اعتراف شركة «ميتا» باستغلال صور المستخدمين المنشورة على المنصات التابعة لها في تدريب أنظمة الذكاء الاصطناعي الخاصة بها. وتزامن هذا الاعتراف مع تحذيرات أطلقتها منصة «سيغنال» بشأن اعتماد تقنية الذكاء الاصطناعي على ما سمّته «المراقبة الجماعية». ولكن في حين رأى خبراء «خطورة» ذلك على الخصوصية، فإنهم عدّوا أن لا سبيل لحماية البيانات إلا الامتناع عن نشرها رقمياً.

جاء «اعتراف» كريس كوكس، مدير قطاع المنتجات بشركة «ميتا»، على هامش مؤتمر «بلومبرغ تك» الشهر الماضي، عندما قال إن «شركة ميتا تستخدم جميع البيانات التي يشاركها المستخدمون مع الجمهور public، لا سيما الصور في تدريب أنظمة الذكاء الاصطناعي التابعة لها... وتلك البيانات المتنوعة تُسهم في رفع مستوى أداء وكفاءة نتائج تقنيات الذكاء الاصطناعي». وأضاف كوكس أن «ميتا لا تستخدم في هذا المجال الصور والبيانات الجارية تشاركها بشكل خاص (Private) مع الأصدقاء والعائلة عبر الحسابات الشخصية للمستخدمين».

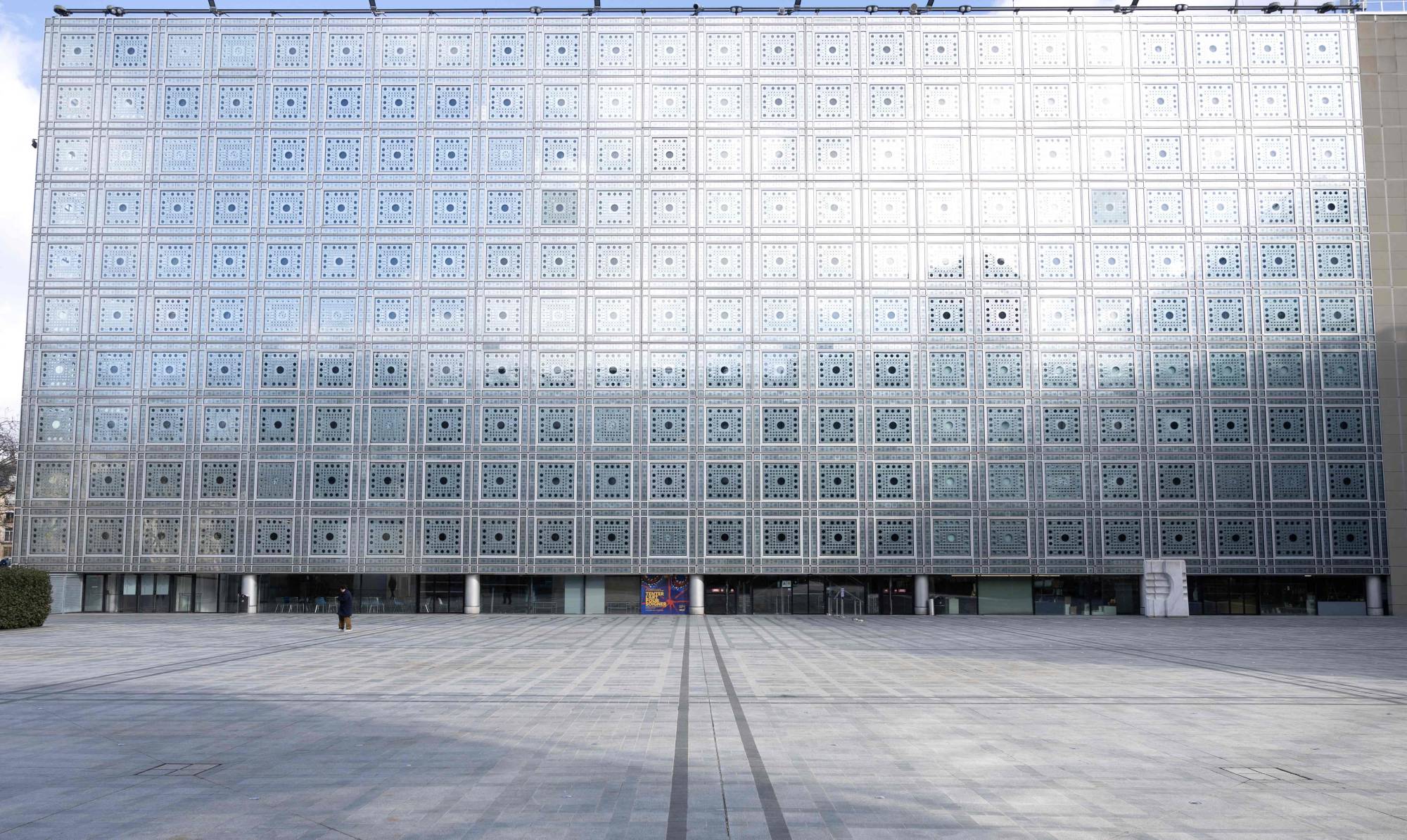

تصريحات المسؤول في شركة «ميتا» تزامنت مع تحذيرات أطلقتها ميريديث ويتاكر، رئيسة منصة «سيغنال»، خلال معرض «فيفاتك» للتكنولوجيا الحديثة، الذي نظم أخيراً في باريس. إذ نقلت وكالة «الصحافة الفرنسية» عن ويتاكر قولها إن «تقنيات الذكاء الاصطناعي الراهنة تعتمد على المراقبة الجماعية، التي باتت المحرك الاقتصادي للقطاع التكنولوجي». وأضافت ويتاكر، التي عملت لأكثر من 10 سنوات على مسألة الأخلاقيات المرتبطة بالذكاء الاصطناعي لدى «غوغل» قبل تركها الشركة، أنّ «الذكاء الاصطناعي يتطلب كمية هائلة من البيانات ويستخدمها في كل مرة ينشئ محتوى... وهذه البيانات التي قد تكون خاطئة بشكل كامل، لديها القدرة على توجيه حياتنا بطريقة ينبغي أن تثير القلق». وبينما ذكرت ويتاكر أن «إتاحة الوصول إلى مجموعات من البيانات والسماح باعتماد مزيد من الشفافية في النماذج أمر مفيد»، فإنها دعت إلى «مراجعة تعريف المقصود بالمصدر المفتوح».

وتعليقاً على هذا الأمر، قالت الدكتورة مي عبد الغني، أستاذة الإعلام بجامعة بنغازي والباحثة في الإعلام الرقمي، في لقاء مع «الشرق الأوسط»، إن «الذكاء الاصطناعي يتمتّع بإمكانات هائلة للوصول إلى بيانات المستخدمين، إذ بإمكانه تتبع أغلب جوانب حياتهم الشخصية... وفي هذا قضاء مبرم على الخصوصية بشكل تام». وأردفت أن «مواقع التواصل الاجتماعي تكفّلت بجمع بيانات المستخدمين، كونها تعدّ تلك البيانات رأسمالها الحقيقي والمحرك لعجلة اقتصادها، وهي تعتمد عليها في العمليات التسويقية والأبحاث الاجتماعية المرتبطة بمشاعر المستخدمين واتجاهاتهم الفكرية وسلوكهم... ومن ثم؛ هناك تأثير لهذه البيانات على المستويين السياسي والأمني لجهة الوصول إلى الناخبين وغير ذلك من الاستخدامات المتنوعة والمتعددة».

وشددت عبد الغني على التأثير الكبير والخطير لإتاحة البيانات بهذا الشكل، مرجحة أن «تزداد وتيرته وتتعاظم مع التطور المتسارع في تطبيقات الذكاء الاصطناعي الذي شهد تطورات متسارعة في السنة الماضية». وفي حين تطرّقت إلى «عمل كثير من مطوّري برمجيات الذكاء الاصطناعي على تطوير برمجيات تحمي بيانات المستخدمين»، لفتت إلى «صعوبة ذلك، لا سيما مع ما يحتمه استخدام تطبيقات مواقع التواصل الاجتماعي من التخلي عن البيانات، وقدر من الخصوصية بشكل أو بآخر».

ثم أوضحت: «هناك تجارب تحاول أن تحمي بيانات المستخدمين، كتجربة الاتحاد الأوروبي الذي أصدر أخيراً لائحة لحماية البيانات، وإقدام بعض المؤسسات الأميركية على استخدام الذكاء الاصطناعي لترميز (تشفير) بيانات المستخدمين، وإجراء التحديثات الأمنية بشكل دوري وآلي. ولكن حماية بيانات المستخدمين تنبع من الوعي الذاتي بأهمية تلك البيانات... ومن الضروري جداً تعزيز المعرفة بإجراءات الأمن الرقمي للحد من التأثيرات السلبية لاختراق الخصوصية». وهنا تلفت إلى أن عدداً من الشركات العاملة على تطوير تقنيات الذكاء الاصطناعي يسعى إلى عقد صفقات مع صُناع المحتوى، ومنصات التواصل والمؤسسات الإعلامية وغيرها، بهدف الحصول على إذن باستخدام المحتوى المنشور رقمياً في تدريب وتشغيل برامج الذكاء الاصطناعي.

من جهته، أشار خالد البرماوي، الباحث المصري في مجال الإعلام الرقمي، في حوار مع «الشرق الأوسط»، إلى أن «قضية الخصوصية وحمايتها في عصر الذكاء الاصطناعي مُثارة، وتتجدد إثارتها بين الحين والآخر، سواءً كان ذلك متعلقاً بالبيانات المنظمة التي تنتجها مؤسسات، أو البيانات العشوائية المنشورة على مواقع التواصل الاجتماعي».

ومع تأكيد البرماوي على «التأثير الكبير» لتقنيات الذكاء الاصطناعي على خصوصية البيانات، فإنه لفت إلى صعوبة ضبط أداء هذه التقنية، قائلاً إن «برامج الذكاء الاصطناعي تستخدم مليارات البيانات، ما يجعل من الصعب التيقن من استخدامها صورة أو معلومة محددة أنتجتها جهة معروفة».