عندما تواجه شركات التواصل الاجتماعي هجمات نارية بسبب مشاكل متعلّقة بسلامة الأطفال، فإنها غالباً ما تستجيب باعتماد إعداد أو إعدادين جديدين للسلامة.

ينتقد المدافعون عن سلامة الأطفال الإلكترونية غالباً هذه المزايا التي تشبه استخدام الضمادات لعلاج المشاكل الكبرى، فقد أشارت بيانات شاركتها منصّة «إنستغرام» إلى أن 10 في المائة فقط من المراهقين فعّلوا الضوابط الأبوية في حساباتهم منذ عام 2022، وأن أقلّ من 10 في المائة من آباء وأمّهات هؤلاء عمدوا فعلاً إلى تعديل الإعدادات.

سلامة الأطفال على الإنترنت

يعتبر الخبراء أن غياب التشريعات، التي تفرض على شركات التواصل الاجتماعي تصميم تطبيقاتها بما يحمي سلامة الأطفال، يُلقي مسؤولية حمايتهم على الأبوين بالكامل. صحيح أن إعدادات السلامة المتوفرة في التطبيقات لن تحلّ المشاكل المُمَنهجة، كسلوك المطاردة الإلكترونية، أو الخوارزميات التي تُروّج للمحتوى المؤذي، إلّا أن هذه الإعدادات تستحقّ التحقّق منها.

على سبيل المثال، كما يقول تاتوم هانتر، من واشنطن، فإن مفتاحاً واحداً على منصّة «تيك توك» يمنع الغرباء من استغلال الفيديوهات الخاصة بأولادكم، هذه الميزة التي غالباً ما تعرض الفيديوهات لجماهير غير مقصودة. وفي «إنستغرام»، يستطيع المراهقون حجب جميع الوسوم، والإشارات، والرسائل المباشرة من الأشخاص الذين لا يتابعونهم.

هذه الإعدادات لا تؤثر على نوع البيانات التي يجمعها تطبيقٌ معيّن عن أولادكم، ولكنّها تؤثر على مدى ظهور نشاطهم الإلكتروني للغرباء والأشخاص الذين يستطيعون التواصل معهم.

طبعاً، يبقى الانتظار حتّى بلوغهم مرحلة المراهقة للسماح لهم بتأسيس حسابات، واحدة من أفضل الطرائق لحمايتهم من الديناميات المؤذية على التواصل الاجتماعي.

وعند مراجعتكم إعدادات التطبيقات، احرصوا على أن تكون المحادثة بين طرفين. اسألوا أولادكم عن الأمور التي يستمتعون بها في تطبيقات محدّدة وعمّا يصادفونه على الشبكة؛ اسمحوا لهم بأن يخبروكم بكلّ شيء دون خوف من العقاب. يعطي التدخّل في أمور التواصل الاجتماعي أفضل النتائج عندما يُسمح للمراهقين بالمشاركة؛ باختصار، حاوِلوا أن تكونوا المدرّب وليس الحَكَم.

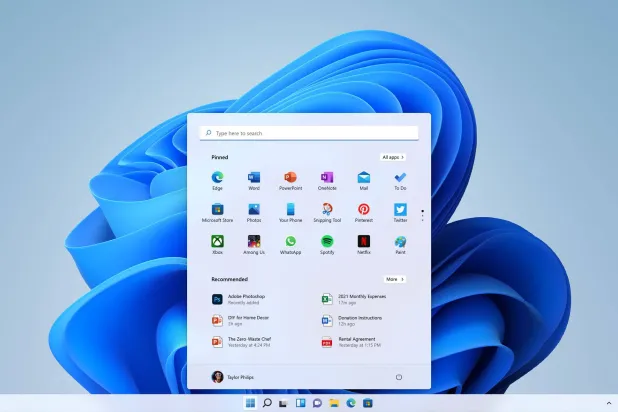

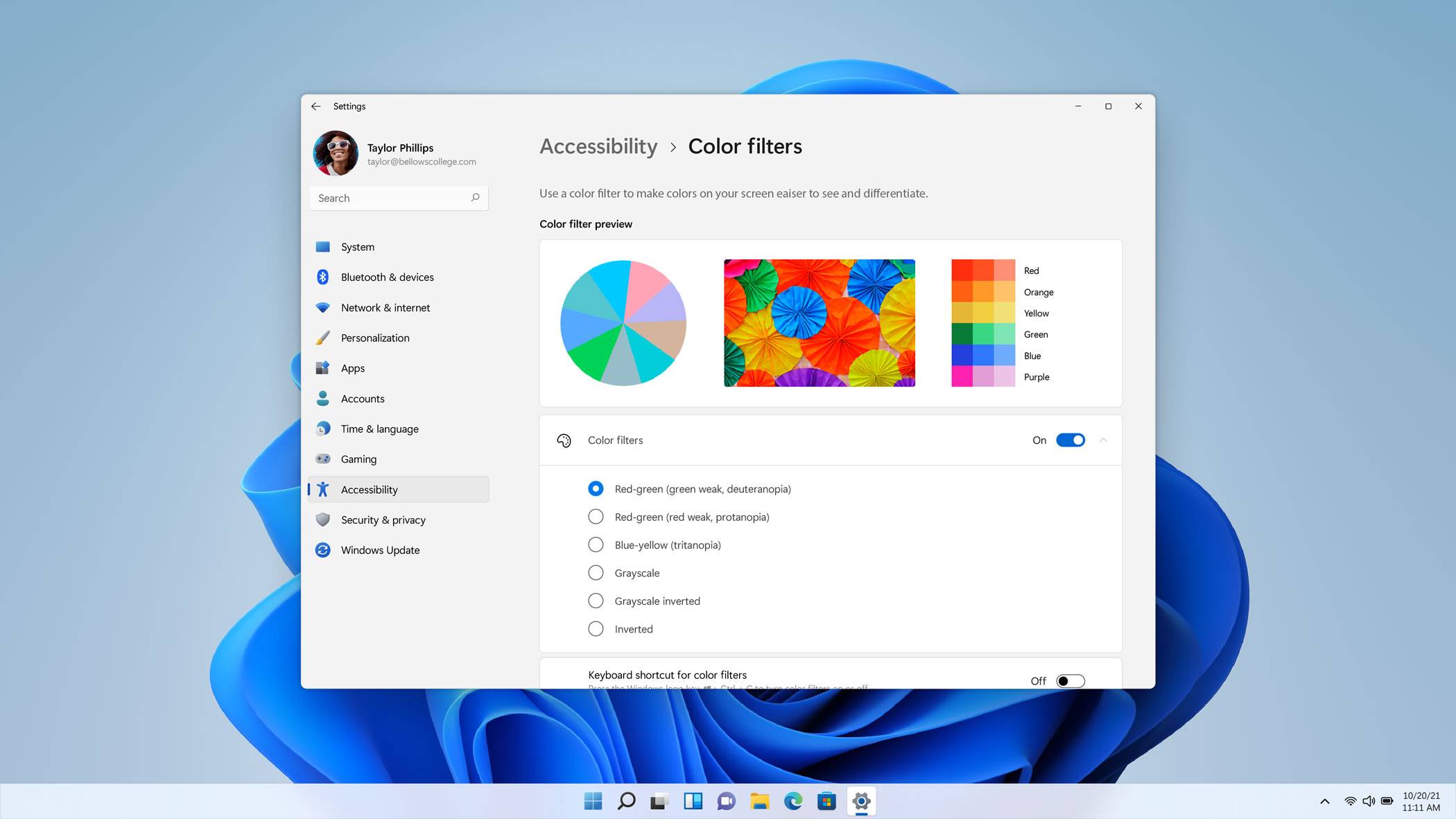

إعدادات آمنة

نستعرض لكم، فيما يلي، بعض الإعدادات التي يجب أن تراجعوها اليوم:

• تحويل الحساب إلى وضع الخاص. عندما يشارك أولادكم المراهقون صوراً وفيديوهات ونصوصاً من حساب عام، يستطيع الجميع رؤيتها - أي الهيئات المعنية في الجامعة، والجد والجدّة، وشركات الذكاء الصناعي التي تتفحّص الإنترنت بحثاً عن بيانات للتدريب.

في المقابل، تُظهر الحسابات الخاصة المحتوى للأشخاص الذين قبِلهم أولادكم أصدقاء أو متابعين، وهذا ما يمنح الأولاد مزيداً من السيطرة على من يستطيع رؤية محتواهم، ويخفّف الضغط الذي يشعرون به عند النشر.

تحدّثوا مع المراهقين عن «البصمة الرقمية» التي تخلّفها منشوراتهم. كيف يمكنهم تقييم ما ينشرونه لتقليل فرص شعورهم بالإحراج بسببه لاحقاً؟ وإذا تلقّوا طلب صداقة من شخصٍ لم يلتقوه وجهاً لوجه، فكيف يمكنهم معرفة ما إذا كانت مشاركة منشوراتهم مع هذا الشخص آمنة؟ تساعد الحسابات الخاصة في حجب بعض العيون غير المرغوبة، لكن يجب ألّا ننسى أن الصور الملتقَطة للمنشورات لا تزال موجودة.

في معظم الأحيان، تُفعّل إعدادات الخصوصية وغيرها من ضوابط الحساب غيابياً إذا صرّح أولادكم بسنّهم الحقيقي عند تسجيل الدخول. لكن لا تسلّموا بهذا الأمر؛ لأن كثيراً من المستخدمين اليافعين يكذبون بشأن سنّهم لتجنّب الضوابط التي قد يفرضها التطبيق. ومن هنا، يجب أن تخصصوا بضع دقائق لمراجعة تاريخ ميلاد أولادكم في حساباتهم.

• ضبط التواصل مع الغرباء. تضمّ معظم تطبيقات التواصل الاجتماعي، مثل «تيك توك»، و«إنستغرام»، و«سناب تشات»، و«تويتش»، و«ديسكورد»، ضوابط تحدّد من يستطيع إرسال رسائل مباشرة؛ ومن هنا فإنّ حصر الرسائل المباشرة «بالأصدقاء فقط»، مِن شأنه أن يحمي المراهقين من المضايقات، والمطاردين، والمتنمّرين.

تحدّثوا مع المراهقين عن الرسائل التي يتلقّونها. في البداية، اسألوهم عن الرسائل المباشرة التي يتلقّاها رفاقهم، وراجعوا معاً الأمور السيئة التي قد تحصل إذا استطاع الغرباء اختراق صندوق الواردات. وكانت دراسة أجرتها «يونيفرسيتي كوليدج - لندن» عام 2021 قد وجدت أن 75 في المائة من المراهقات تلقّين صوراً غير محتشمة عبر الرسائل المباشرة.

يشير معظم تطبيقات التواصل الاجتماعي إلى هذه الملاحظات على أنّها «رسائل»، أمّا في «تويتش» فيجب النقر على «حجب همسات الغرباء»، وفي «ديسكورد» يمكنكم تشغيل ميزة «الرسائل المباشرة الآمنة»، ليعمد التطبيق إلى مسح الرسائل المباشرة لرصد الصور غير الملائمة.

فيديوهات كاذبة ممزوجة

• تعطيل استباحة الفيديوهات. على منصات المقاطع القصيرة؛ مثل «تيك توك»، و«إنستغرام»، و«يوتيوب»، تتيح ميزة «إعادة المزج» للمستخدمين استخدام مقتطفات من فيديوهات لأشخاص آخرين في محتواهم الخاص. على سبيل المثال، يستطيع صانع المحتوى استعراض بضع ثوانٍ من مقطع شهير على «تيك توك»، وإضافته على مقطع فيديو خاص به.

تعتمد إعادة المزج على نقاش الجمهور للفيديو - هل تكون للأفضل أم الأسوأ؛ لأنّه ببساطة قد يعني أن فيديو «تيك توك» الذي نشره أولادكم المراهقون سيراه بضع عشرات من الأصدقاء أو بضعة ملايين من مستخدمي التطبيق غير اللطفاء.

اطلبوا من المراهقين أن يُطلعوكم على بضع الأمثلة من الفيديوهات المُعاد مزجها، وقيِّموا معاً عدد المرات التي يكون فيها المزج إيجابياً، وسلبياً، أو محايداً، ثمّ قرِّروا معاً ما إذا كان أولادكم يريدون الانفتاح على هذا النوع من الانكشاف.

لتغيير هذا الإعداد في «تيك توك»، اذهبوا إلى «إعدادات وخصوصية»، ثم «خصوصية»، ثم «إعادة مزج». وفي «إنستغرام» اذهبوا إلى «مشاركة وإعادة مزج»؛ لضبط انتشار محتوى أولادكم. أمّا في حالة يوتيوب فلا تسمح المنصة لصانعي الفيديوهات القصيرة بتعطيل جميع أنواع المزج إلّا إذا كانوا يملكون الوصول إلى ميزة «مدير محتوى استديو يوتيوب»، ومع ذلك يستطيع أولادكم منع عمليات إعادة المزج في الفيديوهات القصيرة الشخصية خلال عملية التحميل.