خلال حدثٍ تقني استضافته سان فرانسيسكو في نوفمبر (تشرين الثاني) الماضي، سُئل سام ألتمان، الرئيس التنفيذي لشركة الذكاء الاصطناعي «أوبن إيه آي» عن المفاجآت التي سيشهدها المجال في عام 2024.

جاء ردّه سريعاً على الشكل التّالي: «روبوتات المحادثة كـ(تشات جي بي تي) ستحقّق قفزة نوعية لم يكن أحدٌ يتوقعها». وإلى جانبه، كان يجلس جايمس مانييكا المدير التنفيذي من شركة «غوغل»، الذي هزّ رأسه وقال: «وأنّا أؤيّد هذا الكلام».

تحسينات سريعة

ميزة واحدة تُعرّف صناعة الذكاء الاصطناعي هذا العام: تحسّنٌ سريعٌ ولافت في التقنية وتراكم في التطوّرات التي تسمح للذكاء الاصطناعي بتوليد أنواعٍ جديدة من الوسائط، وتقليد المنطق البشري بأشكالٍ جديدة، والتسرّب إلى العالم الحقيقي عبر فصيلٍ جديدٍ من الروبوتات.

وسنرى في الأشهر القليلة المقبلة مولّدات الصورة المدعومة بالذكاء الاصطناعي، كـ«دال - إي» و«ميدجورني»، وهي تنتج فيديوهات وصوراً بشكلٍ آنيّ، وتندمج بشكلٍ تدريجي مع روبوتات المحادثة، مثل «تشات جي بي تي».

وهذا الأمر يعني أنّ روبوتات المحادثة ستذهب أبعد من النص الرقمي؛ إلى التعامل مع الصور، والفيديوهات، والرسوم البيانية وغيرها من الوسائط، وستُظهر سلوكاً أقرب إلى المنطق البشري، من خلال أداء المزيد من المهام المعقّدة في مجالات كالرياضيات والعلوم. ومع تحرّك التقنية أكثر باتجاه الروبوتات، ستصبح هذه الأخيرة قادرة على حلّ مشكلات خارج العالم الرقمي.

بدأ كثير من هذه التطورات بالتبلور داخل أهمّ مختبرات البحث وفي عالم المنتجات التقنية منذ العام الماضي، إلّا أنّ قوّة هذه المنتجات ستكبر أكثر، وسيستخدمها عددٌ أكبر من الناس في 2024.

يرى ديفيد لوان، الرئيس التنفيذي لشركة الذكاء الاصطناعي الناشئة «أديبت» أنّ «التقدّم السريع للذكاء الاصطناعي مستمرّ ولا مفرّ منه».

تعكف شركاتٌ كثيرة كـ«أوبن إيه آي»، و«غوغل»، على تطوير الذكاء الاصطناعي أكثر من غيره من التقنيات بسبب الطريقة التي صُممت بها الأنظمة التي يقوم عليها.

يتولّى مهندسون تصميم معظم التطبيقات البرمجية التي تتطلّب ابتكار كلّ رمز كومبيوتر على حدة في عمليّة بطيئة ومملّة. في المقابل، تعمل الشركات اليوم على تحسين الذكاء الاصطناعي بمزيد من السرعة لأنّ تقنيته ترتكز على شبكات عصبية، وأنظمة حسابية قابلة لتعلّم مهارات من خلال تحليل البيانات الرقمية. تستطيع الشبكة العصبية تعلّم توليد نصّ بمفردها من خلال رصد الأنماط في بيانات متنوعة، كمقالات «ويكيبيديا»، والكتب، والنصوص الرقمية المسحوبة من شبكة الإنترنت.

تغيرات عام 2024

نستعرض لكم في الدليل التالي التغييرات التي سيشهدها الذكاء الاصطناعي هذا العام، بدءاً من التطورات المتوقَّعة في المدى القريب، التي ستدفع قدرات التقنية نحو المزيد من التقدّم.

* الفيديوهات الفورية: ولّدت التطبيقات المدعومة بالذكاء الاصطناعي حتّى اليوم نصوصاً وصوراً جامدة على شكل استجابات لأوامر الحثّ. يستطيع «دال - إي» مثلاً ابتكار صور أشبه بصورٍ فوتوغرافية حقيقية في غضون ثوانٍ بناء على طلبات، مثل: «وحيد قرن يغوص مقابل جسر غولدن غيت».

ولكنّ هذا العام سيشهد على الأرجح طرح العديد من الشركات، كـ«أوبن إيه آي»، و«غوغل» و«ميتا» و«رانوي»، لمولّدات صورة تتيح للمستخدمين فبركة فيديوهات أيضاً، حتّى إنّ بعض هذه الشركات أتمّ تطوير نماذج تجريبية لأدوات تبتكر فيديوهات فورية وفقاً لأوامر حثٍّ نصية قصيرة.

ومن المرجّح أيضاً أن تسعى هذه الشركات إلى دمج قوى مولّدات الصورة والفيديو في روبوتات المحادثة لتعزيز قدرات هذه الأخيرة.

* روبوتات محادثة «متعدّدة الأوضاع»: تشهد روبوتات المحادثة ومولّدات الصور، التي طُوّرت في الأساس بوصفها أدوات منفصلة، اندماجاً تدريجياً؛ فقد أطلقت «أوبن إيه آي»، العام الماضي، ولأوّل مرّة نسخة جديدة من «تشات جي بي تي» قادرة على توليد صورٍ ونصوص.

تعمل شركات الذكاء الاصطناعي على تصميم أنظمة «متعدّدة الأوضاع»؛ ما يعني أنّ ذكاءها الاصطناعي يستطيع التعامل مع عدّة أنواع من الوسائط. تتعلّم هذه الأنظمة مهاراتها من خلال تحليل الصور، والنصوص، وربّما أنواع أخرى من الوسائط كالرسوم البيانية، والأصوات، والفيديوهات، حتّى تستطيع إنتاج نصوصها وصورها وأصواتها الخاصّة. وهذا ليس كلّ شيء! لأنّ هذه الأنظمة تتعلّم أيضاً العلاقات بين مختلف أنواع الوسائط، ستصبح يوماً قادرة على فهم نوعٍ من الوسائط والردّ عليه بنوعٍ مختلف. بمعنى آخر، قد يغذّي أحدهم روبوت المحادثة بصورة ما، ليردّ عليه الأخير بنص.منطق أفضل ووكلاء الذكاء

* «منطق» أفضل. عندما يتحدّث ألتمان عن القفزة النوعية التي سيحققها الذكاء الاصطناعي، يقصد روبوتات المحادثة التي تتمتّع «بتفكير منطقي» أفضل يساعدها في القيام بمهام أكثر تعقيداً، كحلّ مسائل حسابية شائكة وتوليد برامج كومبيوتر مفصّلة.

الهدف هو بناء أنظمة تستطيع حلّ مسألة ما بعناية ومنطقية من خلال سلسلة من الخطوات السرية التي تعتمد كلّ واحدة منها على الأخرى، لأنّ هذه هي طريقة عمل المنطق البشري، في بعض الحالات على الأقلّ.

يختلف علماء بارزون فيما بينهم على ما إذا كانت روبوتات المحادثة قادرة فعلاً على التفكير بهذا القدر من المنطق. يحاجج بعضهم بأنّ هذه الأنظمة بالكاد تُظهر بعض المنطق، مع تكرارها للسلوك التي رصدته في بيانات الإنترنت. ولكنّ «أوبن إيه آي» وغيرها تبني أنظمة قادرة على الردّ على أسئلة صعبة حول مواضيع، كالرياضيات، وبرمجة الكومبيوتر، والفيزياء، وغيرها من العلوم.

من جهته، عدّ نيك فروست، باحثٌ سابقٌ في «غوغل» ومدير مساعد في شركة الذكاء الاصطناعي الناشئة «كوهير»، أنّ «ارتفاع مستوى الثقة بهذه الأنظمة سيزيد من شعبيتها». وإذا أصبحت روبوتات المحادثة فعلاً أكثر منطقية، يمكنها أن تتحوّل بسهولة إلى «وكلاء ذكاء اصطناعي».

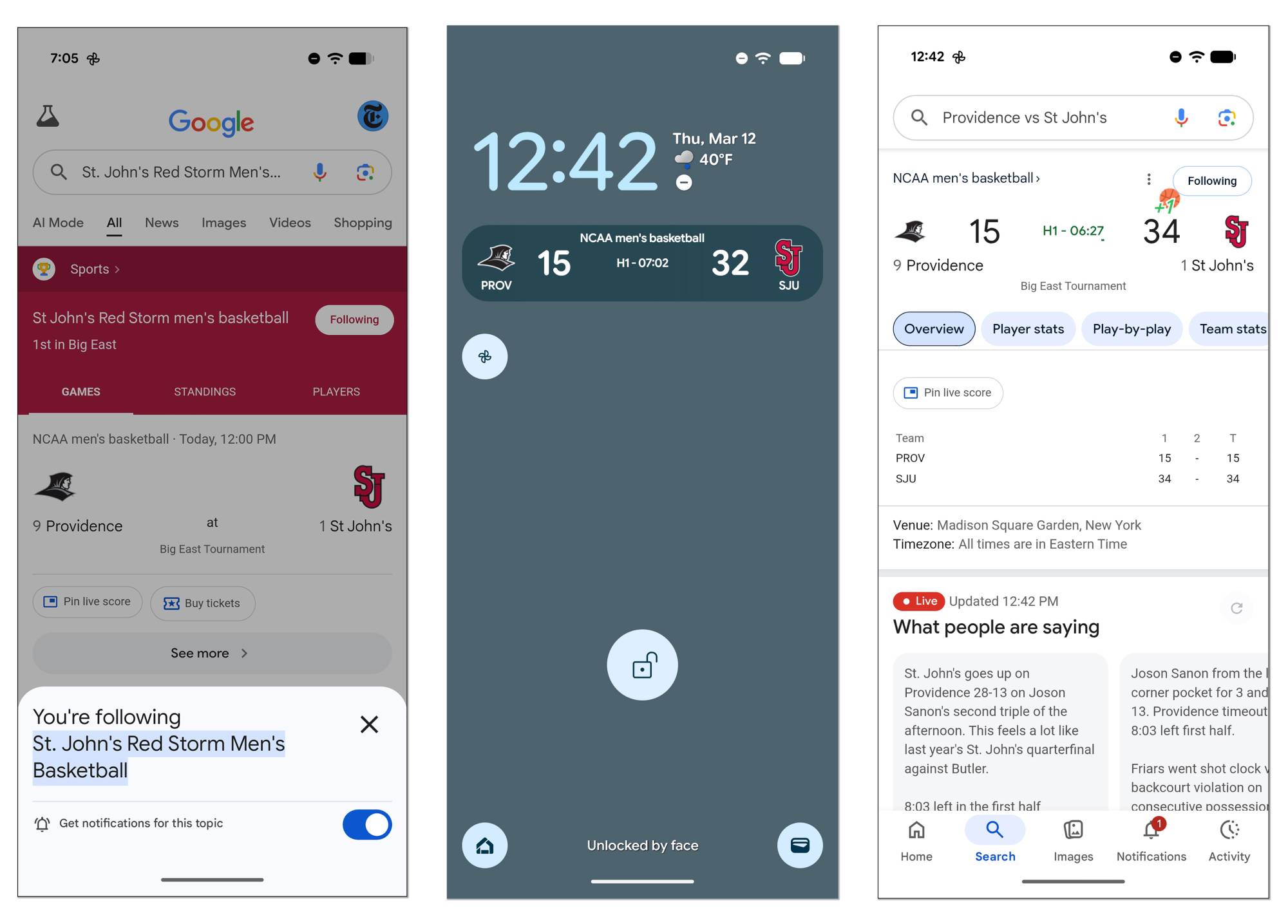

• «وكلاء الذكاء الاصطناعي». تُعلِّم شركات التقنية أنظمة الذكاء الاصطناعي كيفية التعامل مع المسائل الصعبة خطوة بخطوة، وبنفس الطريقة، يمكنها أيضاً تحسين قدرة روبوتات المحادثة على استخدام التطبيقات البرمجية والمواقع الإلكترونية نيابة عن المستخدم.

يعمل الباحثون بجدّ على تحويل روبوتات المحادثة إلى نوعٍ جديد من الأنظمة الآلية المستقلّة التي تُسمّى «وكلاء الذكاء الاصطناعي»، وهذا يعني أنّ روبوت المحادثة سيصبح قادراً على استخدام تطبيقات البرمجة، والمواقع الإلكترونية، وغيرها من الأدوات الإلكترونية، كالتقويم ومواقع السفر، ليتمكّن النّاس أخيراً من توكيله للقيام بأعمالهم. ولكنّ هذا الأمر قد يفضي أيضاً إلى سيطرة وكلاء الذكاء الاصطناعي على بعض الوظائف بشكلٍ كامل.

تعمل روبوتات المحادثة اليوم وكأنّها وكلاء في بعض الأمور البسيطة، حيث إنها تسجّل مواعيد الاجتماعات، وتعدّل الملفات، وتحلّل البيانات، وتضع الرسوم البيانية. ولكنّ أداء هذه الأدوات لا يرقى دائماً إلى الجودة المطلوبة، وهي قابلة للانهيار في لحظة عند التعامل مع مهام أكثر تعقيداً.

هذا العام، من المتوقع أن تكشف شركات الذكاء الاصطناعي النقاب عن وكلاء أكثر كفاءة؛ فقد رجّح لوان أنّ «المستخدمين سيتمكنون من توكيل أي مهام مملّة ومتعبة من أعمالهم اليومية على جهاز الكومبيوتر إلى وكيل من هذا النوع».

وتشمل هذه المهام متابعة النفقات باستخدام تطبيقٍ مثل «كويك بوكس»، أو تثبيت أيّام العطلة في تطبيق كـ «ووركداي». وعلى المدى الطويل، ستتوسع قدرات الوكلاء لتتجاوز خدمات البرمجيات والإنترنت إلى عالم الروبوتات.

• روبوتات أذكى. في الماضي، كانت الروبوتات تُبرمج لأداء المهمّة نفسها مرّة بعد مرّة، كحمل الصناديق التي تتشابه حجماً وشكلاً. أمّا اليوم، فيستخدم الباحثون نفس التقنية التي تشغّل روبوتات المحادثة لمنح الروبوتات التقليدية القوّة اللازمة للتعامل مع مهام أكثر تعقيداً وربّما غير مألوفة.

وكما يتعلّم روبوت المحادثة توقّع الكلمة التالية في جملة من خلال تحليل كميات كبيرة من النصوص الرقمية، يستطيع الروبوت تعلّم توقّع ما سيحصل في العالم الحقيقي من خلال تحليل عددٍ غير محدود من الفيديوهات التي تستعرض أشياء وأجساماً تُرفع وتُنقل.

سيكون هذا العام عام دمج قوى الذكاء الاصطناعي في الروبوتات التي تعمل غالباً خلف الكواليس، كالأذرع الميكانيكية التي تطوي القمصان في متاجر خدمات الغسيل، أو ترتّب البضائع في المخازن. ويعمل عمالقة التقنية أيضاً، ومنهم إيلون ماسك، على إيصال الروبوتات الشبيهة بالبشر إلى بيوت المستخدمين.

* خدمة «نيويورك تايمز»