في حين تفجر الإنترنت في الآونة الأخيرة بقصة اعتقال الطفل المسلم، البالغ من العمر 14 عاما، لأخذه ساعة صنعها لنفسه في منزله - اعتقد خطأ أنها قنبلة - إلى مدرسته في تكساس، لم يهدر الجيش الصغير - المكون من بعض متخصصي وسائل الإعلام الاجتماعي - الخاص بالرئيس الأميركي باراك أوباما، أي وقت.

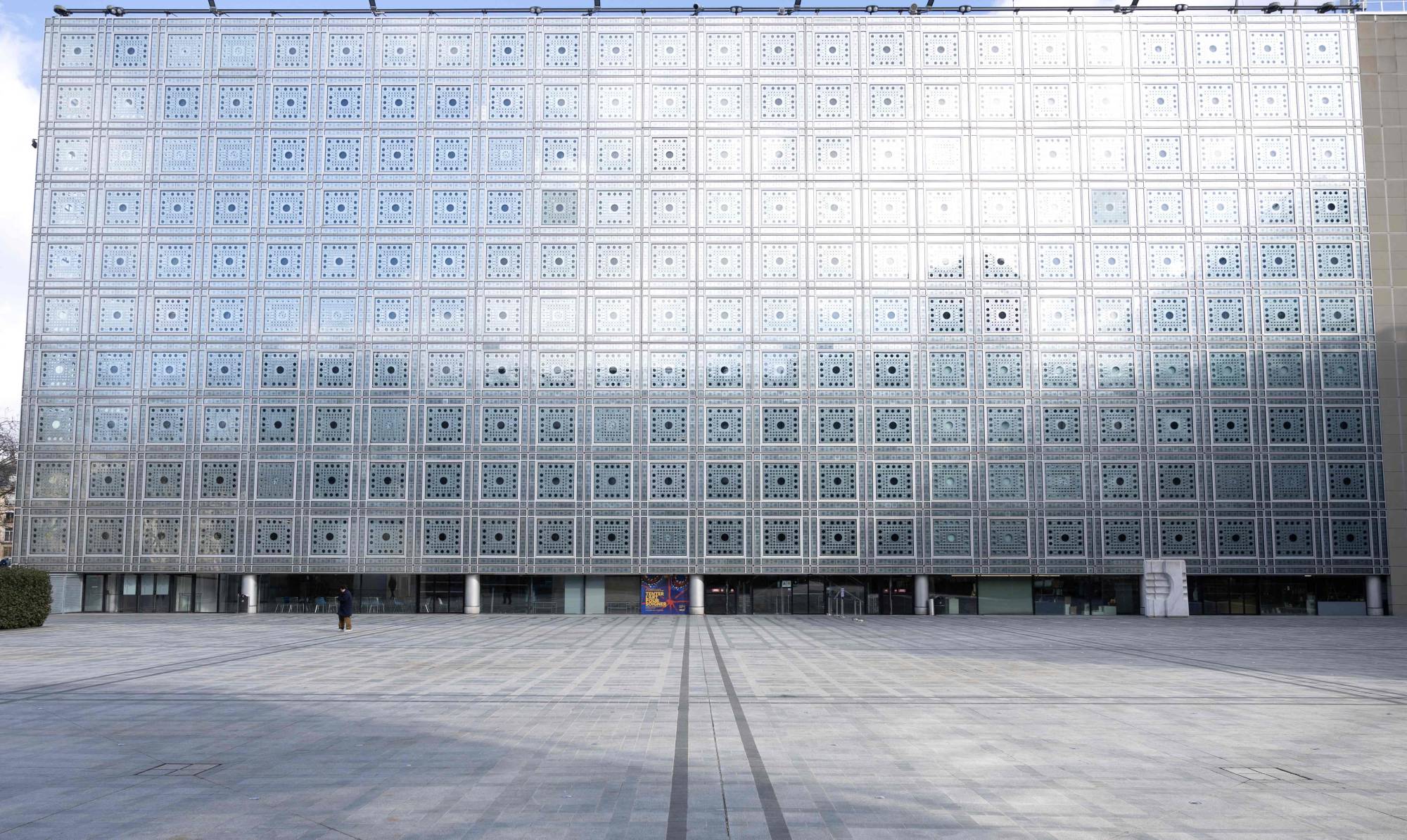

ومن مقرهم في مبنى مكتب آيزنهاور التنفيذي بالبيت الأبيض، قرر مساعدو أوباما أن الرئيس يجب أن ينشر تغريدة سريعا على موقع تويتر بشأن الطفل صانع الساعة، أحمد محمد، الذي أثار ذهوله وتكبيل يديه بالأصفاد جدلا وطنيا حول التنميط العرقي والديني في الولايات المتحدة.

وقال أوباما، في رسالة عبر حسابه الشخصي على «تويتر»، الذي يتابعه نحو خمسة ملايين شخص، بعد ساعات من الحادث: «ساعة لطيفة يا أحمد. هل تود جلبها إلى البيت الأبيض؟».

ورغم أن أوباما نادرا ما ينشر تغريداته بنفسه، ولا يُعرَف من كتب تغريدته بشأن قضية أحمد، فإن التغريدة عكست دفعة في البيت الأبيض للتحدث بلسان الرئيس في وسائل الإعلام الاجتماعي. والهدف من ذلك هو خلق شعور بالتلقائية والوصول إلى أكثر الأحداث إثارة للجدل في العالم.

ويتبع ذلك الفريق لمكتب الاستراتيجية الرقمية لأوباما، وهو فريق مكون من نحو 20 من مساعديه، يقضون أيامهم في إدارة حساب الرئيس على تويتر، وصفحة البيت الأبيض على فيسبوك، وحساب إنستغرام، وقناة يوتيوب.

ويتولى الفريق - بقيادة جايسون غولدمان، 39 عاما، المدير التنفيذي السابق لتويتر وبلوغر وميديام - مجموعة متنوعة من المهام، من بينها نشر تغريدات حية مكونة من 140 حرفا للخطابات الرئاسية عبر حساب البيت الأبيض على تويتر، واستخدام التحليلات لمعرفة أكثر القضايا انتشارا على الإنترنت لبث مقاطع فيديو أو صور بشأنها.

والأهم من ذلك كله، يبحث الفريق عن طرق لإنشاء هوية رقمية للرئيس أوباما. ويقولون إن سبل الاتصالات القديمة المتبعة في البيت الأبيض - خطاب سياسي مطول، أو مقابلة على التلفزيون أو مع صحيفة، أو بيان مكتوب - أقل فعالية.

وذكرت كوري شولمان، نائبة جايسون غولدمان، وتعمل مع الفريق الرقمي للرئيس منذ عام 2009: «يتكلف مكتبنا بمهام كثيرة، ويبحث عن سبل لجلب صوت الرئيس مباشرة إلى الشعب». وأضافت: «إنه توازن بين التركيز على أولويات الرئيس والمرونة وانتهاز الفرص وفقا للمناقشات المنعقدة على الإنترنت المتعلقة بالرئيس».

وتعد التكنولوجيا حاسمة لسياسات أوباما منذ فترة طويلة. فقد ساعد تحليل حملته للبيانات في الدفع به إلى البيت الأبيض، حيث كان أول رئيس يستخدم البريد الإلكتروني، والآن نادرا ما يظهر من دون كومبيوتره اللوحي «آيباد». وفي أبريل (نيسان)، جرى تعيين غولدمان كأول رئيس للمكتب الرقمي الخاص بأوباما، والمخطط لمبادرات البيت الأبيض الرقمية.

وقالت جنيفر بساكي، مديرة الاتصالات، عن الرئيس أوباما: «كان أحد الأشياء التي أرادها هو فتح البيت الأبيض، لسحب الستار وعرض كيفية عمل الحكومة على الشعب، وكان هذا الأمر تطورا طبيعيا». وتابعت: «دائما ما يأتي إلينا، ويبحث عن سبل لمشاركتنا، وهذا الشيء صعب القيام به من البيت الأبيض، لأن إدارة البلاد ليست بالأمر الهين».

ويحضر السيد غولدمان والسيدة شولمان الاجتماعات الخاصة بالاتصالات صباح كل يوم في الجناح الغربي للبيت الأبيض للمساعدة في معرفة متى ينبغي إدراج الرئيس نفسه في الوسائل الرقمية، وتنبيهه عندما تتصدر قضية ما تويتر، أو تثير الجدل على فيسبوك.

وفي نوفمبر (تشرين الثاني) 2013، أثارت صور مايلز سكوت، طفل يبلغ من العمر 5 سنوات، ومريض بسرطان الدم، وهو يرتدي زي باتمان الذي يكافح الجريمة في موطنه سان فرانسيسكو، مشاعر فياضة على الإنترنت. واقترح مساعدو أوباما أن «باتمان الطفل» ينبغي أن يسمع شيئا من الرئيس. واستخدم الفريق 30 ثانية من نهاية خطاب الرئيس الإذاعي الذي يلقيه كل سبت، لجعله يقول جملتين في 6 ثوان: «استمر في طريقك يا مايلز. عليك إنقاذ غوثام».

وخلال الآونة الأخيرة، أصبح كبار المسؤولين الأميركيين أكثر انفتاحا على تخصيص وقت للرئاسة على وسائل الإعلام الاجتماعي، بعد أن أوضح فريق أوباما الرقمي بالبيانات كيف أن ظهوره على وسائل الإعلام الاجتماعي - مثل فيديوهات يوتيوب التي ظهر فيها للترويج لمحاور خطابه عن حالة الاتحاد في يناير (كانون الثاني) - ساعد في نشر رسالته.

* خدمة «نيويورك تايمز»