تتعقب مجموعات من الباحثين والشركات كل أثر رقمي يتركه مستخدمو الهواتف الذكية، كما تتعقب كثافة الكتابات والرسائل التي يرسلها ويسجلها على مواقع التواصل الاجتماعي، وسرعة بحثه في أرقام جهات الاتصال، وعدد مرّات تفقده الهاتف في وقت متأخر من الليل... لأن كل هذه المعلومات تحمل دلالات عن صحته النفسية والجسدية، كما تقول.

تحليل نمط الاتصالات

هذه هي النظرية التي يرتكز عليها مجال جديد يعرف بـ«النمط الظاهري الرقمي digital phenotyping»، الذي يسعى إلى تقييم صحة الناس بالاعتماد على تفاعلاتهم مع الأجهزة الرقمية. ويعمل الباحثون والشركات التقنية على تعقّب منشورات الناس على مواقع التواصل الاجتماعي، واتصالاتهم، وبحوثهم، ونقراتهم، بحثاً عن تغيرات سلوكية قد تكون مرتبطة بعوارض مرضية معينة.

وتظهر الإحصاءات أن الأفراد يستخدمون هواتفهم عادة 2617 مرّة في اليوم، بحسب إحدى الدراسات، هذا إن لم يكن أكثر من ذلك. ويقول الدكتور ساشين جاين، الرئيس التنفيذي في «كير مور هيلث»، وهو نظام صحي ساعد في دراسة تسجيلات «تويتر» بحثاً عن مؤشرات على مشكلات النوم، إن «تفاعلاتنا مع العالم الرقمي يمكن أن تكشف عن كثير من الأمراض المخفية، حتى إن مقاربات كهذه قد تساهم يوماً ما في معرفة ما إذا كانت الأدوية التي يتناولها المرضى مفيدة أم لا». ويضيف جاين أنها أيضاً قد تساعد في فهم مدى فعالية العلاجات.

ولكن هذا المجال الجديد لا يزال يفتقر إلى كثير من الدراسة، مما دفع بعض المناوئين له إلى التحذير من أن بعض الأنماط الظاهرية الرقمية قد لا تتعدّى مصداقيتها في رصد المشكلات الصحية، مصداقية كرة البلور التي يستخدمها العرافون والمنجمون.

وعدّ الدكتور ستيف ستينهوبل، مدير الطب الرقمي في «سكريبس ترانسليشنل ساينس إنستيتوت» في سان دييغو في حديث لوسائل إعلام أميركية، أنّ توقّف أحد الأشخاص الاجتماعيين فجأة عن مراسلة أصدقائه مثلاً، قد يشير إلى أنه أصيب بالاكتئاب، أو إلى أنه ذهب ببساطة في رحلة تخييم أدّت إلى تغيّر في سلوكه المعتاد، واصفاً هذه المقاربة بأنها النسخة الجديدة من بدعة «زيت الأفعى».

ولكن هذا التشكيك لا يعرقل مسارعة البعض إلى المجال، ومنها شركات عملاقة مثل «فيسبوك»، رغم الأسئلة الكثيرة التي تطرح حول الخصوصية والفعالية.

قراءة الميول الانتحارية

وتقود «فيسبوك» الجهود الأكبر في هذا المجال، فقد أعلنت الشركة أخيراً أنها تستخدم الذكاء الصناعي للتدقيق في الكتابات والمنشورات والبثّ الحي لمقاطع الفيديو على الشبكة بحثاً عن مؤشرات محتملة على وجود ميول انتحارية. وعندما يضبط النظام أنماطاً معينة من الحديث تتضمن تعليقات مثل: «أيمكنني المساعدة؟» أو: «هل أنت بخير» من قبل الأصدقاء، يعمل فوراً على تسجيل نتائج خوارزمية (الخوارزمية برنامج ذو نهج محدد) خاصة لمعالجة مثل هذه الكتابات، ويخطر فريق «فيسبوك» المتخصّص بالمراجعة.

في بعض الحالات، يرسل «فيسبوك» إلى المستخدمين إشعاراً مع اقتراحات مثل «اتصل بخطّ المساعدة». وفي الحالات الطارئة، ينسّق مع السلطات المحلية لإرسال المساعدة إلى موقع المستخدم. يقول الموقع إن فريق استجابته الخاص تعاون مع عمال الطوارئ أكثر من 100 مرّة في شهر واحد.

ورحّب بعض الباحثين في المجال الصحي بالجهود التي يقوم بها «فيسبوك»، والتي تغوص في أعماق العالم المعقّد للصحة النفسية. ولكنهم في المقابل تخوّفوا من أمر واحد، وهو أن «فيسبوك» لم ينشر دراسة حول دقّة نظامه ومخاطره المحتملة، كالمبالغة المحتملة وغير المقصودة للأزمة التي يعيشها المستخدم.

هذا غير أن «فيسبوك» يعمل على التدقيق في منشورات المستخدمين في الولايات المتحدة وغيرها من الدول بحثاً عن مؤشرات على نوايا انتحارية دون أن يعطي هؤلاء الحقّ في رفض الخضوع لهذا التدقيق. وتساءل فرنك باسكوال، الأستاذ في القانون بجامعة ماريلاند والذي يدرس التقنيات الصحية الناشئة: «هل تلازم صفة (الانتحارية) المستخدم الذي يحمل مؤشراتها بشكل دائم؟ ومن يمكنه الوصول إلى هذه المعلومة؟»

من جهته، قال ويل نيفيوس، المتحدّث باسم «فيسبوك» إن الموقع يزيل النتائج الخوارزمية المرتبطة بالمنشورات بعد 30 يوماً، ولكنّه يحتفظ بالحالات التي تضمّ استجابات للطوارئ في نظام منفصل غير مرتبط بملف المستخدم الشخصي.

وكان موقع «فيسبوك» قد أكّد أنه أثناء تطويره هذه الجهود، تعاون مع مجموعات معنية بالوقاية من الانتحار. وعدّ نيفيوس أن نشر دراسة مستفيضة حول هذه الجهود خطوة معقّدة بسبب صعوبة التخلّص من المعلومات الشخصية و«الطبيعة الحساسة للمنشورات».

رصد الاكتئاب

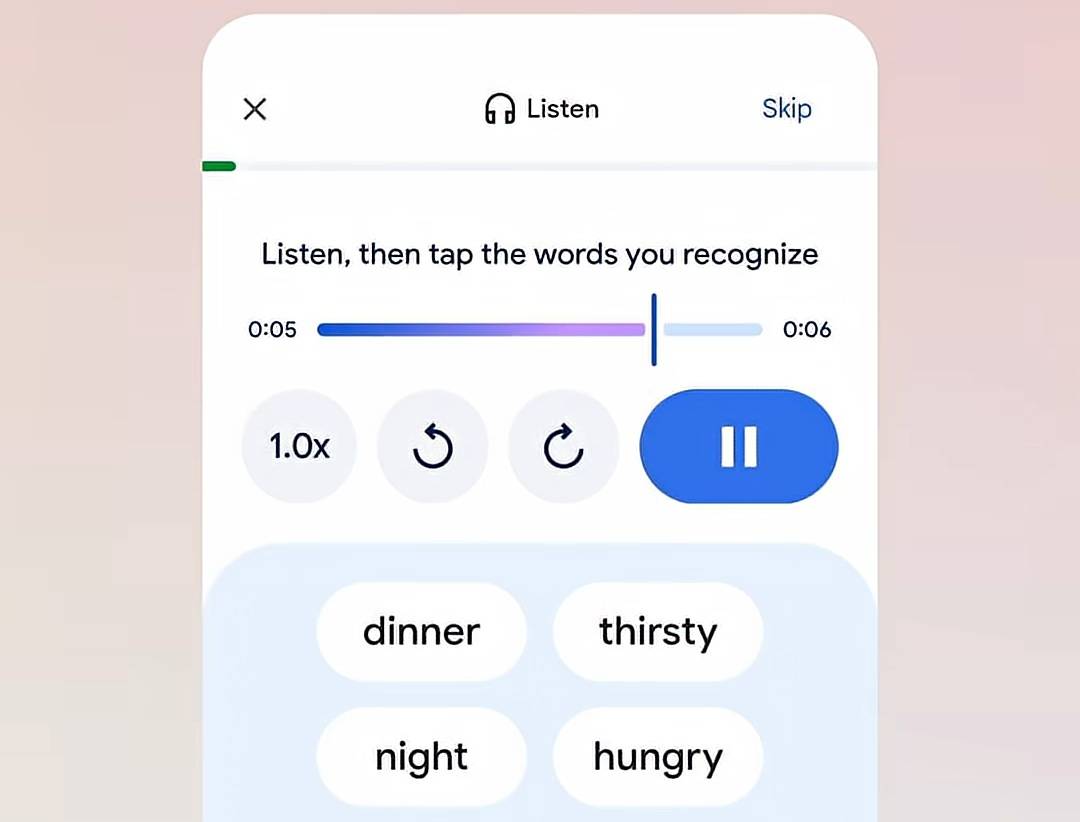

يشخّص المعالجون النفسيون عادة الاكتئاب بعد مراقبة المرضى وسؤالهم عما يشعرون به. ولكن «مايند سترونغ هيلث»، شركة ناشئة جديدة متخصصة بدراسة الصحة النفسية في «بالو التو»، تشخصه عن طريق مراقبة استخدام الناس هواتفهم الذكية.

طوّرت الشركة منصة بحثية تراقب عادات المستخدمين في استعمال هواتفهم الذكية بشكل دائم، بحثاً عن أي تغييرات في أنماط النقر والضغط، للوصول إلى دلالات محتملة حول تغيرات في المزاج والذاكرة قد تكون مرتبطة بالاكتئاب.

وقال الدكتور توماس إنسل، مؤسس الشركة ومدير سابق في «المعهد الوطني للصحة النفسية»، إن شركته تعمل على تطوير إنذار دخاني رقمي خاص بالأشخاص الذين يعانون من أمراض نفسية.

يتتبع تطبيق «مايند سترونغ هيلث» البحثي ألف نقطة بيانات متصلة بالهواتف الذكية، تشمل معلومات؛ كالمدة التي يتطلبها شخص ما للبحث عن اسم معيّن في جهات الاتصال والنقر على الاسم. وظّفت هذه الشركة مائتي متطوع للمشاركة في دراسات تجريبية، وقال إنسل إنّ الباحثين يمكن أن يستفيدوا في اختباراتهم من بعض الإشارات، كالتغييرات في دقّة وسرعة الشخص أثناء استخدامه لوحة المفاتيح، والمرتبطة أيضاً مع تغيرات حركية مشابهة.

وتشارك الشركة حالياً في دراسة حكومية كبيرة حول مرضى الصدمات، تعتمد في جزء منها على منصة «مايند سترونغ» لدراسة ما إذا كان المرضى الذين يعانون من اضطراب ما بعد الصدمة يشهدون أيضاً تغيرات في استخدامهم الهاتف الذكي.

وقال إنسل: «حصلنا على إشارات إحصائية مهمة مرتبطة بشكل كبير بهذه الحالات. ولكننا حالياً نبحث ما إذا كانت هذه الإشارات ستستخدم فعلياً في عالم العناية العيادية». وأضاف أن الشركة استعانت بخبراء أخلاقيين وقانونيين لمساعدتها في التدقيق في تأثيرات تقنيتها، وفي تنظيم إطار أخلاقي لاستخداماتها. وأخيراً، لفت إنسل إلى أنه يجب ومنذ البداية أخذ جميع النتائج غير المتعمّدة بعين الاعتبار، حتى لا تعود وترتدّ بشكل عكسي لاحقاً.

7:53 دقيقه

هل تراقب الشركات حياتنا الرقمية بحثاً عن المعلومات الصحية؟

https://aawsat.com/home/article/1210036/%D9%87%D9%84-%D8%AA%D8%B1%D8%A7%D9%82%D8%A8-%D8%A7%D9%84%D8%B4%D8%B1%D9%83%D8%A7%D8%AA-%D8%AD%D9%8A%D8%A7%D8%AA%D9%86%D8%A7-%D8%A7%D9%84%D8%B1%D9%82%D9%85%D9%8A%D8%A9-%D8%A8%D8%AD%D8%AB%D8%A7%D9%8B-%D8%B9%D9%86-%D8%A7%D9%84%D9%85%D8%B9%D9%84%D9%88%D9%85%D8%A7%D8%AA-%D8%A7%D9%84%D8%B5%D8%AD%D9%8A%D8%A9%D8%9F

هل تراقب الشركات حياتنا الرقمية بحثاً عن المعلومات الصحية؟

وسائل لتحليل أنماط السلوك الظاهري لمستخدمي الهواتف الذكية

هل تراقب الشركات حياتنا الرقمية بحثاً عن المعلومات الصحية؟

لم تشترك بعد

انشئ حساباً خاصاً بك لتحصل على أخبار مخصصة لك ولتتمتع بخاصية حفظ المقالات وتتلقى نشراتنا البريدية المتنوعة