هل أصبت بحيرة عندما اقترحت عليك شبكة «فيسبوك» الاجتماعية، صديقا كنت قد قابلته للتو أو صديقا قديما درست معه قبل 20 سنة؟ لا شك أنك قد مررت بهذه التجربة واعتراك الشك في أن «فيسبوك» يتجسس عليك، ولكن في الحقيقة أنا وأنت من يقوم بتزويد جميع المعلومات والبيانات التي تريدها خوارزمية «فيسبوك» المعقدة في اقتراح الأصدقاء.

«حسابات الظل»

كما لا يخفى على الكل بأن قائمة الأشخاص المقترحة تعتمد أساسا على المعلومات التي زودتها بنفسك لفيسبوك أثناء تسجيلك في الموقع بالإضافة إلى بيانات أخرى كالأصدقاء المشتركين، الموقع الجغرافي، مكان العمل، شبكات WI - FI التي قمت بالاتصال بها، عناوين IP التي تستخدمها في الولوج لفيسبوك، اسم الجامعة التي درست بها والكثير من المعلومات الأخرى.

ومع ذلك، فإن أهم عامل ترتكز عليه خوارزمية اقتراح الأصدقاء هو «جهات الاتصال» (Contacts) الموجودة بهاتفك والتي قمت بإعطاء «فيسبوك» الصلاحية الكاملة في الوصول إليها ورفعها أثناء تنصيبك لتطبيقي Facebook وMessenger.

وكما أشار تقرير من موقع ماشابل التقني (Mashable.com) فإن «فيسبوك» تنشئ حسابا جديدا لك خلف الكواليس لا تستطيع الاطلاع عليه يسمى حساب الظل (Shadow Profile). يحوي هذا الحساب على جميع البيانات التي استخلصها «فيسبوك» من كل الهواتف وجهات الاتصال والرسائل الإلكترونية من مستخدمي «فيسبوك» الآخرين ليكوّنوا فكرة عنك وعن المجتمع الذي تعيش فيه والأشخاص الذين تتواصل معهم.

> معرفة العنوان: وعلى سبيل المثال لو أن أحد أصدقائك أضاف عنوانك السكني لجهة الاتصال الخاصة به، ثم أعطى إذنا لفيسبوك بأن ترفع هذه المعلومات فإن «فيسبوك» سيعرف عنوان بيتك دون أن تقوم أنت بإعطائه، وفي الواقع لا تستطيع أن تحاسبهم على ذلك، فهم يعتقدون أن هذه المعلومات ليست معلوماتك أنت بل تنتمي للشخص الذي وافق على رفعها وأنهم هم الوحيدون الذين لديهم حرية التصرف في هذه المعلومات بعد أن أخذوا الإذن مسبقا من صديقك.

> معرفة بريد العمل. مثال آخر، لو قمت بإضافة بريد العمل الإلكتروني الخاص بصديق لك في جهة الاتصال في هاتفك فإن «فيسبوك» سيربطك بأي شخص آخر قام بإضافة نفس البريد الإلكتروني، وهنا تكمن قوة وعمق الخوارزمية التي طورتها «فيسبوك» طوال العقد الفائت منذ تأسيسها.

أيضا، هذه الخوارزمية ستعرف حين تجد رقم جوالك في جهات الاتصال لشخصين مختلفين أن هذين الشخصين يعرفان بعضهما البعض بمجرد التقائهما في مكان معين أو إرسالهما لرسالة معايدة لك مثلا.

هذه الخوارزمية تنطبق أحيانا على الأشخاص غير المسجلين في «فيسبوك» أساساً؛ فمثلا لو أضفت رقم هاتف والدك الذي لم يسجل في «فيسبوك» وقام شخص آخر بإضافة رقم والدك أيضا فإن الخوارزمية ستجد رقما مشتركا بينكما، مما يوحي بأن هناك احتمالية بأنك تعرف هذه الشخص.

الحقيقة التي لا يدركها الكثيرون أن أرقام الهواتف تكاد تكون بأهمية أرقام البطاقات الوطنية، إذ تستطيع هذه الشركات التعرف عليك من خلالها. والمشكلة الكبرى أننا نجد نفسنا مضطرين لإعطاء صلاحية الوصول إلى أرقامنا لمعظم التطبيقات التي نقوم بتحميلها من المتجر.

التحكّم بالمعلومات

ولكن ماذا تفعل حيال ذلك وكيف تمنع «فيسبوك» من معرفة هذه المعلومات عن حياتك الاجتماعية؟ يتطلب منك ذلك أن تذهب لكل شخص تعرفه وتطلب منه أن يزيل رقمك عن طريق أداة تنظيم جهات الاتصال التي يوفرها «فيسبوك» على موقعه، وللأسف هذا الأمر أشبه بالمستحيل.

وكإجراء احتياطي، يمكنك تغيير إعدادات الخصوصية في الموقع بحيث تمنع الآخرين من إيجاد حسابك عن طريق البحث عنك برقم هاتفك أو بريدك الإلكتروني. في هذه الحالة، حتى وإن رفع صديق لك جهات الاتصال الخاصة به لفيسبوك فإن خوارزمية اقتراح الأصدقاء لن تقترحك كصديق لأي شخص آخر بناء على هاتفك أو بريدك الإلكتروني.

الآن عرفت كيف تمنع الخوارزمية من استعمال هاتفك وبريدك؛ ولكن ماذا عن حساب الظل الذي ذكرناه في مقدمة المقال؟ للأسف فإنك لا تستطيع فعل شيء حيال ذلك، فهو تحت سيطرة «فيسبوك» وهي الوحيدة التي يمكنها توظيف هذه المعلومات كما تشاء.

كيف تحد من كمية المعلومات التي من الممكن مشاركتها مع «فيسبوك»؟

> اجعل حسابك أكثر خصوصية. اذهب إلى إعدادات - الخصوصية - من يمكنه رؤية محتواي - من يستطيع رؤية منشوراتك المقبلة؟ غيّر الخيار إلى «الأصدقاء» بدل «العامة». أيضا قم بتقييد المنشورات السابقة من نفس قائمة الإعدادات.

> تحكم بمن يمكنه الاطلاع على قائمة أصدقائك. اذهب إلى إعدادات - الخصوصية - من يمكنه رؤية محتواي - من يمكنه الاطلاع على قائمة أصدقائك؟

قم بتغيير هذا الخيار إلى «أنا فقط» بدل «العامة»

> احجب رقمك وبريدك الإلكتروني من خوارزمية اقتراح الأصدقاء. اذهب إلى إعدادات - الخصوصية - من يستطيع البحث عني؟ ستجد ثلاث طرق تمكن الآخرين بالبحث عنك سواء عن طريق الهاتف، البريد الإلكتروني أو مشاركة منشوراتك مع محركات البحث. قم بتغيير هذه الخيارات إلى «الأصدقاء» فقط.

> تحكم بمن يستطيع الاتصال بك. اذهب إلى إعدادات - الخصوصية - من يستطيع الاتصال بي؟ غيّر الخيار من «الكل» إلى «أصدقاء الأصدقاء»

> امنع المنشورات التي يذكر فيها اسمك من الظهور من دون موافقتك. اذهب إلى إعدادات - الخصوصية - اليوميات والإشارة.

غيّر خيار «من يمكنه النشر على يومياتك» إلى الأصدقاء فقط والأهم من ذلك أن تفعل «خيار المراجعة» حتى توافق مسبقا على المنشورات التي تتم الإشارة إليكم فيها.

> قم بإبطال خدمات الموقع في هاتفك. بالنسبة لهواتف آبل آيفون فيمكنك إبطالها بالذهاب إلى إعدادات - الخصوصية - خدمات الموقع - ثم الذهاب إلى تطبيق «فيسبوك» وتغيير الخيار إلى «مطلقا»، ولكن تذكر أنه لن يمكنك أن تستعمل خيار «مكان» عند كتابتك لمنشور جديد. بالنسبة لأجهزة آندرويد فهي تختلف من جهاز لآخر، لذلك حاول إيجادها في الإعدادات.

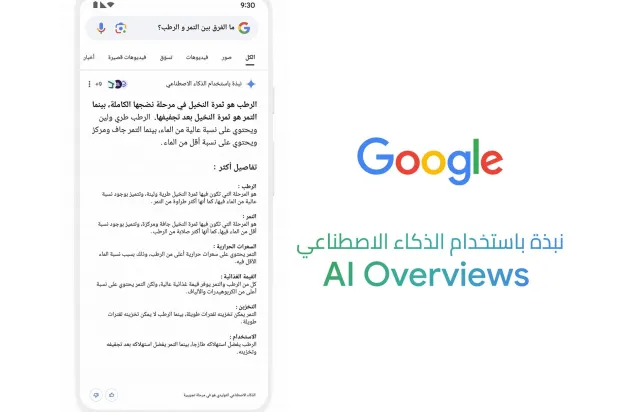

كانت هذه بعض إعدادات الخصوصية التي من الممكن أن تعدّلها لكي تُحد من الكم الهائل من المعلومات التي تزودها طواعية لفيسبوك، ولكن تذكر أنه في عصر التكنولوجيا والشبكات الاجتماعية يصعب كثيرا أن تخفي هويتك مهما حاولت، فشركات مثل «فيسبوك» و«غوغل» تعرف عنا أكثر مما نعرفه نحن عن أنفسنا.

أداة لتحليل قائمة الأسماء

طور مجموعة مهندسين من موقع «غيزمودو» (gizmodo.com) أداة رائعة تمكنك من معرفة قائمة «أشخاص قد تعرفهم» التي تجهزها لك «فيسبوك» بشكل يومي. كل ما عليك فعله هو تحميل وتنصيب أداة «People You May Know Inspector» (تشتغل على MacOS فقط) وقم بتزويدها ببيانات الدخول لحساب «فيسبوك» خاصتك وستقوم الأداة بتسجيل جميع الأشخاص الذين اقترحتهم «فيسبوك» لك كل 6 ساعات وسيتسنى لك تحميل هذه القائمة من الأشخاص بعد أن تترك الأداة تعمل لمدة أسبوع مثلا. يمكنك من خلال تحليل القائمة أن تدرك كيف عرفت «فيسبوك» أن هؤلاء الأشخاص يمكن أن يكونوا أحد أصدقائك وربما تكتشف أن هناك معلومات يجب ألا تعرفها فيسبوك عنك فيمكنك حينها إزالتها من حسابك.