قبل أسابيع، راسل أحد طلاب المرحلة الثانوية، عالم الرياضيات مارتن هايرر، المعروف بإبداعاته المذهلة. كان الطالب المراهق يطمح لأن يصبح عالم رياضيات، ولكن الشكوك بدأت تراوده مع صعود الذكاء الاصطناعي، كما كتبت شيوبان روبرتس (*).

هل ستفقد الرياضيات سحرها؟

قال الطالب في رسالته: «من الصعب فهم ما يحدث حقاً. يبدو أن هذه النماذج تتحسن يوماً بعد يوم، وسرعان ما ستجعلنا عاجزين عن العمل».

وتساءل: «إذا كانت لدينا آلة أفضل منا بكثير في حل المشكلات، ألا تفقد الرياضيات جزءاً من سحرها؟».

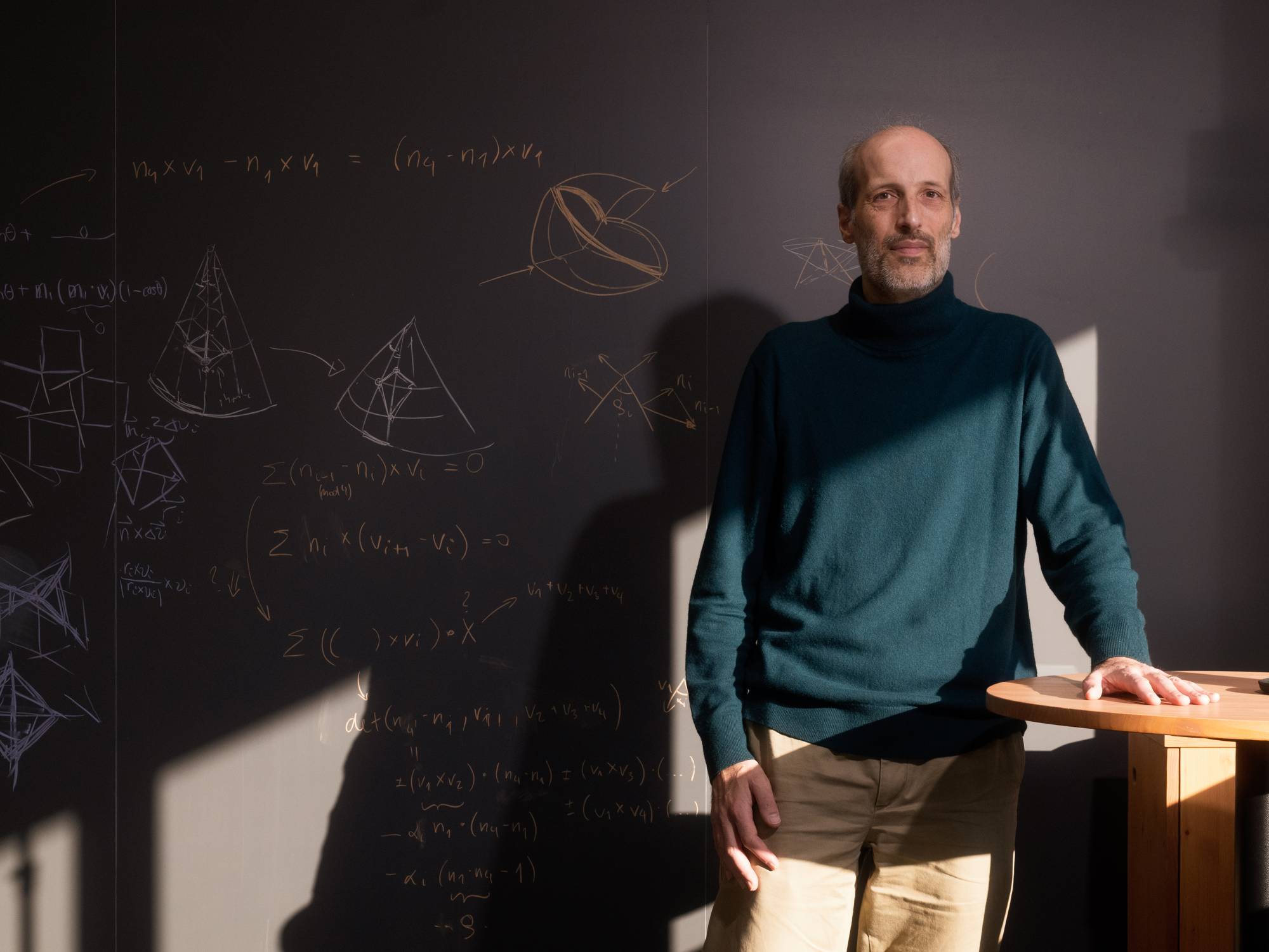

ويقسم هايرر -الحائز على «ميدالية فيلدز» عام 2014، وهي أرفع جائزة في الرياضيات، و«جائزة بريكثرو» المرموقة عام 2021- وقته بين المعهد الفيدرالي السويسري للتكنولوجيا في لوزان، وجامعة «إمبريال كوليدج» في لندن. وفي رده على الطالب، أشار إلى أن كثيراً من المجالات تواجه خطر التقادم الناتج عن الذكاء الاصطناعي.

الذكاء الاصطناعي لا يولِّد فكرة ولا يصوغ مفهوماً

قال هايرر: «أعتقد أن الرياضيات في الواقع مجالٌ آمنٌ تماماً». وأشار إلى أن نماذج اللغات الكبيرة، وهي التقنية الأساسية في برامج الدردشة الآلية، أصبحت الآن بارعة في حلّ مسائل مُصطنعة. ولكنه أضاف: «لم أرَ أي مثالٍ مُقنعٍ لنموذج لغة كبير يتوصل إلى فكرة، أو يصوغ مفهوماً جديداً حقاً».

البرهان الأول

ذكر هايرر هذا الكلام في أثناء مناقشة ورقة بحثية جديدة بعنوان «البرهان الأول» (First Proof)، شارك في كتابتها مع عددٍ من علماء الرياضيات، من بينهم محمد أبو زيد من جامعة ستانفورد، ولورين ويليامز من جامعة هارفارد، وتمارا كولدا التي تُدير شركة «ماث ساي. إيه آي» (MathSci.ai) الاستشارية في منطقة خليج سان فرانسيسكو.

قياس الكفاءة الرياضية للذكاء الاصطناعي

وتصف الورقة البحثية تجربة بدأت أخيراً؛ حيث تم جمع أسئلة اختبارٍ حقيقية، مُستقاة من بحوث غير منشورة بعد لهؤلاء المؤلفين، وذلك بهدف توفير مقياسٍ ذي دلالة للكفاءة الرياضية للذكاء الاصطناعي.

يأمل الباحثون أن يُسهم هذا البحث في إضفاء مزيد من الدقة على الخطاب المُبالغ فيه حول قدرة الذكاء الاصطناعي على «حلِّ» مسائل الرياضيات، وأن يُخفف من آثار هذه الضجة، مثل تنفير طلاب الجيل القادم وإبعاد ممولي البحوث.

شكوك في القدرة على حل مسائل رياضية بحثية

وكتب الباحثون: «مع أن أنظمة الذكاء الاصطناعي التجارية قد وصلت بلا شك إلى مستوى يجعلها أدوات مفيدة لعلماء الرياضيات، فإنه لم يتضح بعد مدى قدرة هذه الأنظمة على حلّ مسائل رياضية بحثية بمفردها، دون تدخل خبير».

تقييم مختلف للشركات المنتجة للذكاء الاصطناعي

وتستخدم شركات الذكاء الاصطناعي ما يصفها بعض علماء الرياضيات بأنها مسائل «مُصطنعة» أو «مُقيّدة» لتقييم أداء أنظمة الذكاء الاصطناعي، وقياس كفاءتها عند العمل دون مساعدة بشرية. وفي بعض الأحيان يُدعى علماء الرياضيات للمساهمة، ويتقاضون نحو 5 آلاف دولار أميركي لكل مسألة.

رفض علماء الرياضيات خدمة الشركات

وتجدر الإشارة إلى أنه لا توجد أي صلة بين مؤلفي مشروع «فيرست بروف» وبين شركات الذكاء الاصطناعي.

في أبريل (نيسان) الماضي، رفض محمد أبو زيد، الحائز على جائزة «آفاق جديدة في الرياضيات» عام 2017، دعوة مماثلة. وقال: «أعتقد أنه ينبغي بذل جهد أوسع نطاقاً؛ جهد مستقل وعلني». وأضاف أن «فيرست بروف» (البرهان الأول) هي المحاولة الأولى.

من جهتها، قالت لورين ويليامز، الحاصلة على زمالة «غوغنهايم» و«ماك آرثر» أخيراً: «الهدف هو الحصول على تقييم موضوعي لقدرات الذكاء الاصطناعي البحثية».

اختبارات نماذج الدردشة

في هذه التجربة، ساهم كل مؤلف (يمثلون مجالات رياضية متنوعة) بسؤال اختباري واحد استُخلص من بحث كانوا يعملون عليه ولم ينشروه بعد. كما حددوا الإجابات. وتم تشفير هذه الحلول على الإنترنت حتى نشرها يوم الجمعة المقبل.

وقالت تمارا كولدا، وهي إحدى عالمات الرياضيات القليلات اللواتي انتُخبن عضوات في الأكاديمية الوطنية للهندسة: «الهدف هنا هو فهم الحدود: إلى أي مدى يمكن للذكاء الاصطناعي أن يتجاوز بيانات التدريب والحلول الموجودة التي يجدها على الإنترنت؟».

أجرى الفريق اختبارات أولية على نموذج «ChatGPT-5.2 Pro» من شركة «أوبن إيه آي» ونموذج «Gemini 3.0 Deep Think» من «غوغل». وكتب الباحثون أنه عند إعطاء النموذج فرصة واحدة فقط للإجابة: «تواجه أفضل أنظمة الذكاء الاصطناعي المتاحة للجمهور صعوبة في حل كثير من مشكلاتنا».

«التخمير الأولي لصنع العجينة»

ويقدم الباحثون في مقدمة البحث شرحاً لعنوانه –بمقارنته مع عملية صنع رغيف الخبز- قائلين: «عند صنع الخبز، فإن البرهان الأول -أي عملية التخمير الأولي لمجموع العجينة- تعد خطوة حاسمة؛ حيث تُترك عجينة الخبز بأكملها لتتخمر ككتلة واحدة، قبل تقسيمها وتشكيلها إلى أرغفة».

وبعد نشر فريق البحث المجموعة الأولى من مسائل الاختبار، فإنه يدعو المجتمع الرياضي لاستكشافها. وبعد بضعة أشهر، وبعد تبادل الآراء والأفكار، ستُجرى جولة ثانية أكثر تنظيماً لتقييم الأداء باستخدام مجموعة جديدة من المسائل.

وكان الفريق قد نشر «البرهان الأول» في الوقت المناسب تماماً لـ«يوم أويلر» -7 فبراير (شباط)- الذي سُمّي تيمناً بعالم الرياضيات السويسري ليونارد أويلر من القرن الثامن عشر. يتوافق التاريخ مع «عدد أويلر»، وهو ثابت رياضي متعدد الاستخدامات، مثل «باي-pi » (ط- النسبة الثابتة للدائرة)؛ ويساوي تقريباً 2.71828. ويُرمز له بالحرف (العدد الثابت ه) «e».

ويعتمد تدريب أنظمة الذكاء الاصطناعي القائمة على الشبكات العصبية على تقنية اكتشفها أويلر لحل المعادلات التفاضلية العادية، وتُعرف باسم «طريقة أويلر».

* باختصار، خدمة «نيويورك تايمز».