تكنولوجيا الذكاء الاصطناعي في التعليم ليست دخيلة عليه لأنها موجودة فيه فعلاً... والسؤال هو: ما مدى فاعليتها؟

نظم لتدريس 8 مليارات إنسان

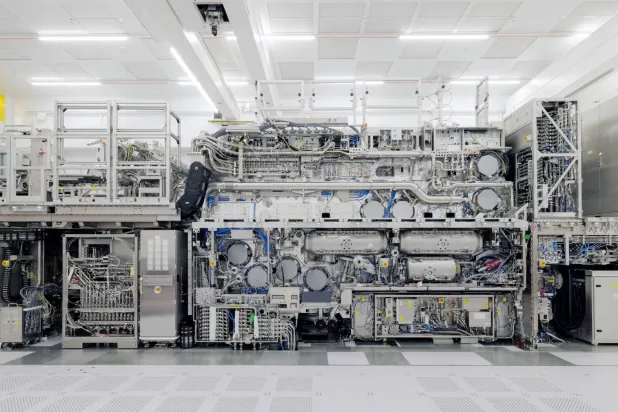

كتبت الدكتورة أنيت في Annette Vee(*) أن التاريخ يُظهِر أن الحلول التكنولوجية في التعليم غالباً ما تفشل. في حين يتصور أندريه كارباثي، المؤسس المشارك لشركة «أوبن إيه آي OpenAI»، عالَماً يمكن فيه تحويل نظم الذكاء الاصطناعي إلى خبراء في الموضوع، أي مثل البشر: «عاطفيين للغاية، ورائعين في التدريس، وصابرين صبراً لا حدود له، ويتمتعون بطلاقة في جميع لغات العالم»... ومن خلال هذه الرؤية، ستكون الروبوتات متاحة «لتدريس 8 مليارات منا شخصياً عند الطلب».

ويظهر تجسيد هذه الفكرة في مشروعه الأخير «يوريكا لابز Eureka Labs»، وهو مجرد أحدث مثال بارز لكيفية سعي رواد الأعمال في مجال التكنولوجيا إلى استخدام الذكاء الاصطناعي لإحداث ثورة في التعليم.

ويعتقد كارباثي أن الذكاء الاصطناعي يمكن أن يحل تحدياً طويل الأمد: ندرة المعلمين الجيدين الذين هم أيضاً خبراء في الموضوع.

وهو ليس وحده في هذه التصورات، إذ يحلم سام ألتمان الرئيس التنفيذي للشركة، وكذلك سال خان الرئيس التنفيذي لأكاديمية خان، ومارك أندريسن رجل الأعمال، وستيوارت راسل عالم الكومبيوتر بجامعة كاليفورنيا في بيركلي، بأن تصبح الروبوتات معلمين حسب الطلب ومستشارين إرشاديين وربما حتى بدائل للمعلمين البشر.

حلول التعليم التكنولوجية فاشلة

بصفتي باحثة تركز على الذكاء الاصطناعي وتقنيات الكتابة الجديدة الأخرى، فقد رأيت العديد من حالات «الحلول» عالية التقنية لمشكلات التدريس التي فشلت.

من المؤكد أن الذكاء الاصطناعي قد يعزز جوانب التعليم، لكن التاريخ يُظهر أن الروبوتات ربما لن تكون بديلاً فعالاً للبشر. وذلك لأن الطلاب أظهروا منذ فترة طويلة مقاومة للآلات، مهما كانت متطورة، وتفضيلاً طبيعياً للتواصل مع البشر الآخرين والاستلهام منهم.

تحديات تعليم الكتابة للجمهور

بصفتي مديرة برنامج التأليف الإنجليزي في جامعة بيتسبرغ، أُشرفُ على تعليم نحو 7000 طالب سنوياً. لقد عانت برامج مثل برنامجي لفترة طويلة من كيفية تدريس الكتابة بكفاءة وفاعلية لعدد كبير من الناس في وقت واحد. وأفضل إجابة حتى الآن هي الحد من أحجام الفصول الدراسية إلى ما لا يزيد على 15 طالباً.

تُظهر الأبحاث أن الطلاب يتعلمون الكتابة بشكل أفضل في الفصول الأصغر حجماً لأنهم يستطيعون المشاركة. ومع ذلك، تتطلب الفصول الصغيرة المزيد من المعلمين، وقد يكون ذلك مكلفاً للمدارس والكليات.

إحياء العلماء الراحلين

والآن دخل الذكاء الاصطناعي. تخيل، كما يفترض كارباثي، أن الفيزيائي النظري العظيم ريتشارد فاينمان، الذي توفي منذ أكثر من 35 عاماً، يمكن إعادته إلى الحياة كروبوت لتعليم الطلاب.

بالنسبة لكارباثي، فإن تجربة التعلم المثالية ستكون العمل من خلال مادة الفيزياء «جنباً إلى جنب مع فاينمان، الذي هو هناك لتوجيهك في كل خطوة على الطريق». يمكن لفاينمان، المشهور بطريقته السهلة في تقديم مواضيع الفيزياء النظرية، أن يعمل مع عدد غير محدود من الطلاب في نفس الوقت.

وفي هذه الرؤية، يظل المدرسون البشريون هم الذين يصممون مواد الدورة، لكنهم مدعومون بمساعد تدريس الذكاء الاصطناعي. وكتب كارباثي أن فريق المدرسين والذكاء الاصطناعي «يمكنه تشغيل منهج دراسي كامل على منصة مشتركة... إذا نجحنا، فسيكون من السهل على أي شخص أن يتعلم أي شيء»، سواء كان ذلك عدداً كبيراً من الأشخاص يتعلمون عن موضوع واحد، أو شخصاً واحداً يتعلم عن العديد من الموضوعات.

جهود تخصيص التعلّم الأخرى قاصرة

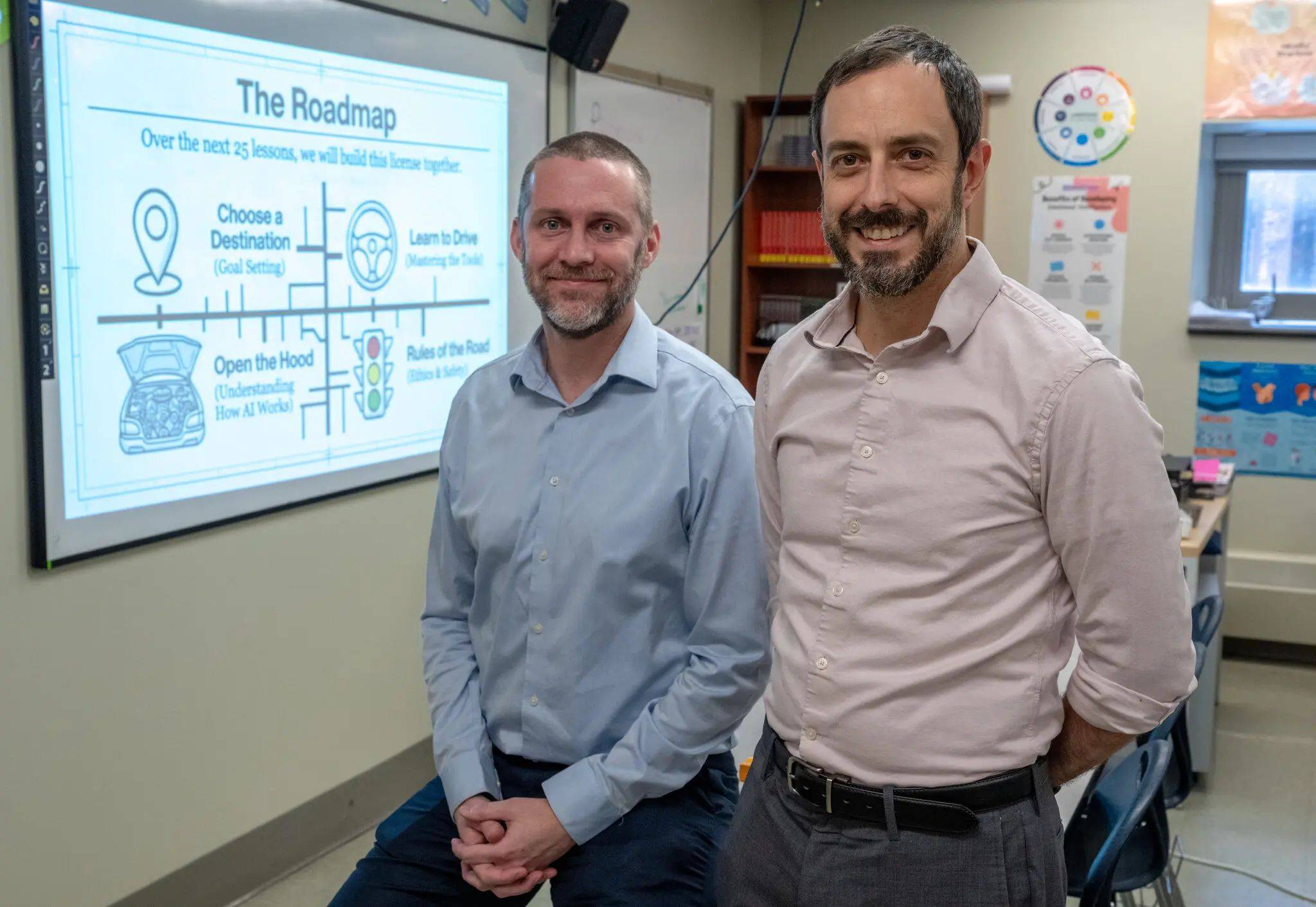

- «معلم آلي» و«آلات التدريس». إن تقنيات التعلّم الشخصي ليست جديدة. قبل 100 عام بالضبط، في اجتماع الجمعية الأمريكية لعلم النفس عام 1924، كشف المخترع سيدني بريسي عن «معلم آلي automatic teacher» مصنوع من أجزاء آلة كاتبة تطرح أسئلة متعددة الخيارات.

وفي الخمسينات من القرن الماضي، صمم عالم النفس ب. ف. سكينر «آلات التدريس teaching machines»؛ إذا أجاب الطالب على سؤال بشكل صحيح، تتقدم الآلة لتسأل عن الخطوة التالية لحل المسائل. إذا لم يقدم الطالب الإجابة الصحيحة فإنه يبقى في تلك الخطوة من المسالة حتى يحلها.

في كلتا الحالتين، تلقى الطلاب تحبيذاً للإجابات الصحيحة، مما منحهم الثقة بالإضافة إلى اكتسابهم المهارات في الموضوع.

إلا أن المشكلة كانت هي أن الطلاب لم يتعلموا الكثير -ووجدوا هذه الأساليب غير البشرية مملة، كما وثّقت الكاتبة التربوية أودري واترز، في كتابها «آلات التدريس».

- دورات التعليم الإنترنتية. وفي الآونة الأخيرة، شهد عالم التعليم صعود وهبوط «الدورات التدريبية المفتوحة الضخمة عبر الإنترنت massive open online courses». وقد أشادت صحيفة «نيويورك تايمز» وغيرها بهذه الفصول الدراسية، التي قدمت مقاطع فيديو واختبارات، لكونها واعدة بإضفاء الطابع الديمقراطي على التعليم.

مرة أخرى، فقد الطلاب الاهتمام بها وفضلوا الخروج منها.

ثم بُذلت جهود أخرى لمنصات قائمة على الويب، بما في ذلك منصات الدورات التدريبية مثل Coursera و Outlier. لكن نفس المشكلة لا تزال قائمة: لا يوجد تفاعل حقيقي لإبقاء الطلاب منخرطين. وكانت إحدى أحدث الضحايا في التعلم عبر الإنترنت هي شركة 2U، التي استحوذت على شركة edX الرائدة في مجال الدورات التدريبية المفتوحة الضخمة عبر الإنترنت في عام 2021، إذ تقدمت في يوليو (تموز) 2024 بطلب إعادة هيكلة إفلاس لتقليل عبء ديونها البالغة 945 مليون دولار أمريكي. وكان الجاني: انخفاض الطلب على الخدمات.

والآن تأتي المنصات المنشرة العاملة بالذكاء الاصطناعي. ولكن إلى أي حد ستكون فعالة؟ إذ يستخدم «خانأميغو Khanmigo» مدرس الذكاء الاصطناعي، كما كتب سال خان في كتابه الأخير، لـ«تخصيص التدريب، بالإضافة إلى التكيف مع احتياجات الفرد في أثناء التدريب».

عيوب التعلم بالذكاء الاصطناعي

يعتقد بعض قادة التكنولوجيا أن النظم الذكية الجديدة يمكنها تخصيص التدريس واستبدال المدرسين البشريين، ولكن من المرجح أن تواجه النظم نفس المشكلة التي واجهتها مثيلاتها في المحاولات السابقة: قد لا يحب الطلاب ذلك. وهناك أسباب مهمة لذلك أيضاً.

- فقدان الطلاب الإلهام والحماسة. من غير المرجح أن يشعر الطلاب بالإلهام والحماس بالطريقة التي يمكن أن يشعروا بها من خلال التعامل مع مدرس مباشر.

غالباً ما يلجأ الطلاب في الأزمات إلى الأشخاص البالغين الموثوق بهم مثل المعلمين والمدربين للمساعدة. هل سيفعلون الشيء نفسه مع الروبوت؟ وماذا سيفعل الروبوت إذا فعلوا ذلك؟ لا نعرف بعد.

- الافتقار إلى خصوصية البيانات والأمان

يمكن أن يكون رادعاً أيضاً؛ إذ تجمع هذه المنصات كميات هائلة من المعلومات حول الطلاب وأدائهم الأكاديمي والتي يمكن إساءة استخدامها أو بيعها.

وقد تحاول التشريعات منع ذلك، ولكنّ مقرات بعض المنصات الشعبية في الصين بعيدة عن متناول القانون الأميركي.

- فقدان الأصالة والتنوع

أخيراً، هناك مخاوف حتى لو أصبح المعلمون والمعلمون بالذكاء الاصطناعي مشهورين. إذا قام الروبوت بتعليم ملايين الطلاب في وقت واحد، فقد نفقد تنوع الفكر.

من أين يأتي الإبداع عندما يتلقى الجميع نفس التعاليم؟ خصوصاً إذا كان «النجاح الأكاديمي» يعتمد على تكرار ما يقوله مدرس الذكاء الاصطناعي؟ إن فكرة وجود مدرس ذكاء اصطناعي في كل جيب تبدو مثيرة. أود أن أتعلم الفيزياء من ريتشارد فاينمان، أو الكتابة من مايكل أنغلو، أو علم الفلك من كارل ساجان. لكنَّ التاريخ يُذكّرنا بأن نكون حذرين ونراقب عن كثب ما إذا كان الطلاب يتعلمون بالفعل. إن وعود التعلم الشخصي لا تضمن نتائج إيجابية.

(*) بروفسورة في الإنجليزية بجامعة بيتسبرغ الأميركية، مجلة «فاست كومباني»، خدمات «تريبيون ميديا».

الطلاب أظهروا منذ فترة طويلة مقاومة للآلات مهما كانت متطورة وتفضيلاً طبيعياً للتواصل مع البشر الآخرين والاستلهام منهم

البروفسورة أنيت في

حقائق

8 مليارات

من الروبوتات ستكون متاحة لـ«التدريس شخصياً عند الطلب»... أندريه كارباثي المؤسس المشارك لشركة «أوبن إيه آي»